-

论文背景及工作

a. 一篇关于对CNN进行攻击的文章。

b. 主要工作是对于“black-box”attack 提出了一种不需要训练出替代模型,而直接进行攻击的方法,并提出了若干个减少攻击范围,降低攻击复杂度的方法。 -

背景知识及名字定义

a. “open-box” (white-box) attack:即我们知道整个网络的所有结构信息,训练信息,参数信息。

b. “black-box” attack and substitute models:我们不知道网络的具体信息,但可以对网络进行若干次的询问,并得到具体的置信度。替代模型是利用若干次查询,将被攻击网络作为teacher net,训练出的student net。

c. “no-box” attack:我们不知道网络的任何信息,也不能对其查询。

d. Transferability:CNN通常具有一定的迁移能力,相近的网络对于特征的提取和响应是相近的,所以对于替代模型的生成样本对于被攻击网络也有一定的效果。

e. adversarial examples :生成样本,生成出的用于欺骗神经网络的图像样本。

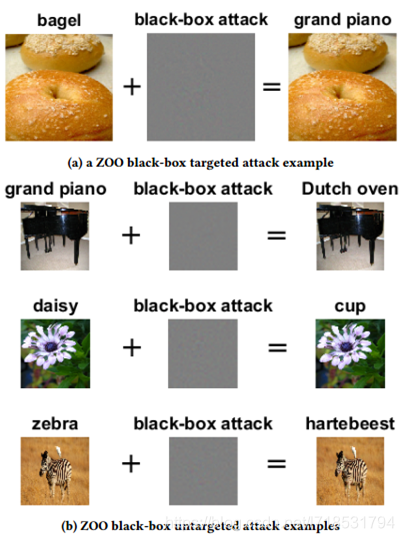

f. 效果如下,左边为原分类标签,右边为经过加上噪声后生成的对抗样本的分类结果。

-

ZOO

a. ZOO:Zeroth order optimization,也就是我们不需要知道一阶导二阶导,直接进行优化。

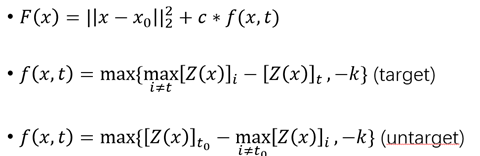

b. Loss Function:

可以看到,分为两个部分,前一半控制相似度,后一半控制输出的置信度 -

那么是如何进行优化的呢,其实就是对于每个像素值,通过导数定义,估计出他近似的导数。

-

算法流程见论文,在步长选择上,加入了Adam,使得其收敛速度更快。

-

降低攻击的复杂度:设置一个掩模,每次对于掩模内的一块进行更新,然后上采样掩模,使得每次更新可以更新一小块的区域而不是单一的像素点,掩模大小随着迭代上升。

-

首先更新重要的像素:若干次更新后,对图片进行MaxPooling,对结果归一化,然后作为一个补偿参数,也就是频繁更新的地方,我们认为他更加的重要,于是着重更新那一块儿位置的像素。

-

基于这个思路,实现了对于Inception这样的大型网络和ImageNet这样的大规模数据集的攻击。

-

PS

a. 这篇是我密码学随便找的一篇关于安全的文章,理解并不深,应该说许多地方其实并不是很理解,如有问题,欢迎指正。

ZOO论文笔记

版权声明:本文为博主原创文章,未经博主允许不得转载。 https://blog.csdn.net/l718531794/article/details/85247279

猜你喜欢

转载自blog.csdn.net/l718531794/article/details/85247279

今日推荐

周排行