首先,何为伦理?

2018年1月份的《科学与社会》报刊中有如下阐述:

伦理一词,英文为ethics,一词源自于希腊文的“ethos”,其意义与拉丁文“mores”差不多,表示风俗、习惯的意思。西方的伦理学发展流派纷呈,比较经典的有叔本华的唯意志主义伦理流派、詹姆斯的实用主义伦理学流派、斯宾塞的进化论伦理学流派还有海德格尔的存在主义伦理学流派。其中存在主义是西方影响最广泛的伦理学流派,始终把自由作为其伦理学的核心,认为“自由是价值的唯一源泉” 。

在我国,伦理的概念要追溯到公元前6世纪,《周易》、《尚书》已出现单用的伦、理。前者即指人们的关系,“三纲五伦”、“伦理纲常”中的伦即人伦。而理则指条理和道理,指人们应遵循的行为准则。与西方相似,不同学派的伦理观差别很大,儒家强调仁、孝悌忠信与道德修养,墨家信奉“兼相爱,交相利”,而法家则重视法治高于教化,人性本恶,要靠法来相制约。

总的来说,伦理是哲学的分支,是研究社会道德现象及其规律的科学。对其研究是很必要的。因为伦理不但可以建立起一种人与人之间的关系,并且可以通过一种潜在的价值观来对人的行为产生制约与影响。很难想象,没有伦理的概念,我们的社会会有什么人伦与秩序可言。

近年来,人工智能领域得到了极大的重视与发展,人们的生活也变得更加方便快捷;

扎克伯格在直播时说,“我对AI的发展特别乐观,那些反对AI的人,总是担心世界末日的到来,这非常不利于技术的推动。但技术的推动是为了让世界运转得更高效的,帮助人们的生活变得更美好的。”

但与此同时,人们也对人工智能的潜在威胁忧心仲仲,进而引发了社会对于AI与伦理问题的热议。

被誉为“冒险家”的马斯克反复强调,“我们需要思考,什么样的监管制度才能约束AI可能给我们人类造成的伤害。”

下面不妨看两个关于AI与伦理问题的例子:

1.首个AI公民“索菲娅”

2017年末,索菲娅获得了沙特阿拉伯的公民身份,引发了大众的热议。

AI获得了公民身份,冲击了人类的伦理观念,但这位新公民的争议不仅如此。

更令索菲娅出名是她经常会发表一些出人意料的言论,

比如当她的创作者汉森在现场直播节目中对她说:“你想毁灭人类吗?请说‘不’。”

她却回复了以下这个令人感到不安一句话:

而这也更加引发了人们对于AI与伦理的讨论,刹那间,“AI威胁论”在社会舆论中满天飞舞。

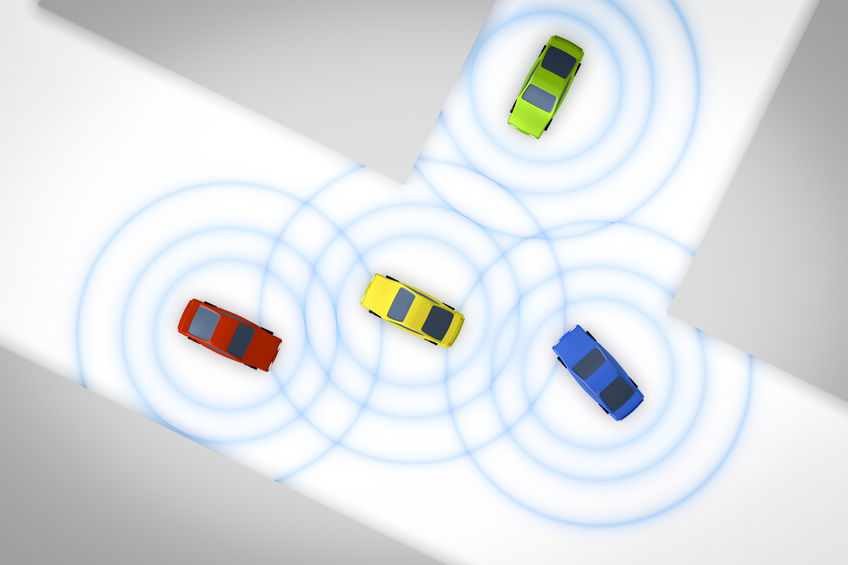

2.无人驾驶的伦理困境

有一个关于“无人驾驶汽车”的著名的问题,提问者假设了一辆无人驾驶汽车遇到突发状况,假定有两种方案:一是无论刹车与否,保持方向会导致车外 3 人死亡;二是拐弯会撞到护栏导致车内 1 人死亡。无论选择哪个方案,都会将无人驾驶逼到一个伦理困境。

英国《每日邮报》14日援引德国梅赛德斯-奔驰公司澳大利亚分公司高管麦卡锡的话报道,按照无人驾驶汽车的编程思路,如果在行驶途中面临一个道德困境,要么撞到马路上的一名儿童,要么急打方向盘以避免撞到儿童、但可能撞到其他车道的汽车以致本车人员伤亡,那么无人驾驶汽车会“果断”选择优先保护车内人员、宁愿撞到儿童。

麦卡锡说,一般人遇到这种情况,会立即作出踩刹车、打方向盘以避免撞人的反应,“我们的系统也是如此,但还会考虑更多因素,例如其他车道是否有汽车行驶?如果本车采取避让举动,有可能会撞上其他车道的汽车,结果导致本车偏离方向、反而冲向路人”。

按照麦卡锡的说法,无人驾驶汽车能在危急关头瞬间判断出“最佳选择”,从而将损伤降至最低。

不约而同的是,德国梅赛德斯-奔驰公司驾驶辅助系统和主动安全性部门经理克里斯托弗·冯胡戈在法国巴黎车展上谈及类似理念,也引发争议。

“如果你有把握保护至少一个人,那么至少保护好那个人。(也就是说,)保护车里的那个人,”冯胡戈说,“你也可以牺牲本车(以避免撞上路人)。你可以这样做,但你就算最初选择保护路人,也并无把握在复杂情形下他们最终能够安然无恙。因此,你应该保护那些有把握保护的人。”

但美国一项调查显示,受访者普遍认为无人驾驶汽车不应为拯救一名路人而牺牲车内人员。但当问卷中被拯救的路人数量增多,愿意牺牲车内人员以拯救路人的受访者比例随之升高。

总而言之,无论是AI,还是无人驾驶,都或多或少的存在道德伦理,安全和立法等问题,人工智能浪潮与“AI威胁论”之争仍将继续。