版权声明:本文为博主原创文章,未经博主允许不得转载。 https://blog.csdn.net/qq_38038143/article/details/84102716

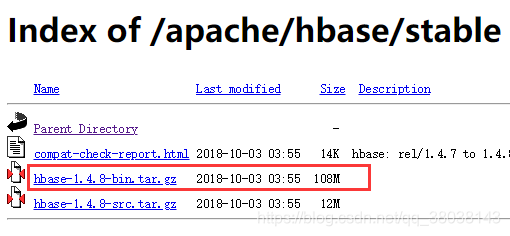

1.下载HBase

链接:http://mirrors.cnnic.cn/apache/hbase/

选择 stable 目录,下载 bin 文件:

在Linux上解压,博客中解压在/home/hadoop 目录下:

进入解压目录:

2.修改配置

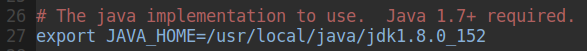

- 修改JDK路径、启用HBase自带zookeeper

vim conf/hbase-env.sh

JDK路径按照安装路径配置:

启用自带zookeeper:

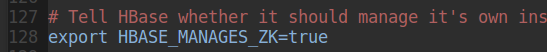

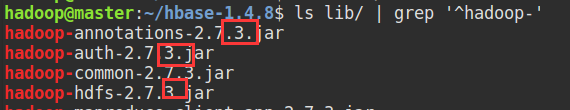

- 修改HBase所基于的Hadoop版本:

ls lib | grep '^hadoop-'

博主第一次查询出来的为2.7.4,由于后面已经替换为2.7.3,所以查询出来的为2.7.3.

假设还没有执行替换操作,则查询出来的应为2.7.4,如果安装的Hadoop为2.7.4就可以不用再进行替换操作。但是,如果不是,则需要进行替换。

博主安装的Hadoop为2.7.3,这里以2.7.3为例(若不是2.7.3,只需要将下面出现2.7.3的改为相应的版本即可):

分别执行如下两条命令:

将已安装版本的Hadoop相应jar包复制到 lib目录:

ls lib | grep '^hadoop-' | \

sed 's/2.7.4/2.7.3/' | \

xargs -i find $HADOOP_HOME -name {} | \

xargs -i cp {} /home/hadoop/hbase-1.4.8/lib/

删除HBase原有版本的jar包:

rm -rf lib/hadoop-*2.7.4.jar

做完第1、2 步是必须的操作,下面进行单节点、伪分布式、完全分布式文件的配置。

3.单节点配置文件

vim conf/hbase-site.xml

使用Linux文件系统。内容如下,以下的目录不用自己创建,启动HBase时会自动创建:

<configuration>

<property>

<name>hbase.rootdir</name>

<value>file:///home/hadoop/hbase</value>

</property>

<property>

<name>hbase.zookeeper.property.dataDir</name>

<value>/home/hadoop/zookeeper</value>

</property>

</configuration>

启动HBase:

HBase的所有服务均运行在一个JVM,所以只会看到HMaster。

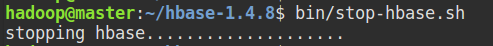

关闭命令:

4.伪分布式配置

vim conf/hbase-site.xml

使用HDFS文件系统:

<configuration>

<property>

<name>hbase.rootdir</name>

<value>hdfs://master:9000/hbase</value>

</property>

<property>

<name>hbase.zookeeper.property.dataDir</name>

<value>/home/hadoop/zookeeper</value>

</property>

<property>

<name>hbase.cluster.distributed</name>

<value>true</value>

</property>

</configuration>

启动(先关闭),先启动Hadoop:

bin/start-hbase.sh

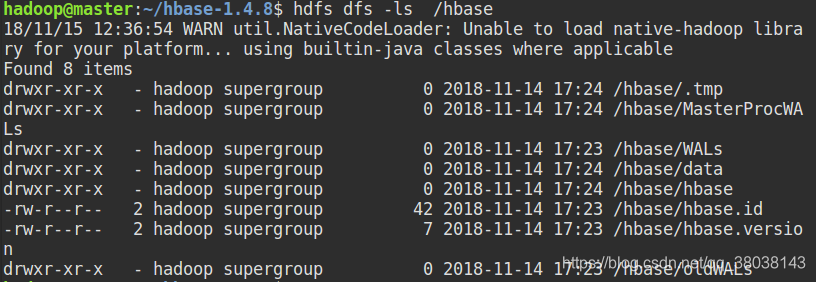

查看HDFS:

5.完全分布式配置

vim conf/hbase-site.xml

这里master为NameNode,slave4, slave5, slave6, slave7为DataNode(可根据自己集群做相应设置):

<configuration>

<property>

<name>hbase.rootdir</name>

<value>hdfs://master:9000/hbase</value>

</property>

<property>

<name>hbase.zookeeper.property.dataDir</name>

<value>/home/hadoop/zookeeper</value>

</property>

<property>

<name>hbase.cluster.distributed</name>

<value>true</value>

</property>

<property>

<name>hbase.zookeeper.quorum</name>

<value>master, slave4, slave5, slave6, slave7</value>

</property>

</configuration>

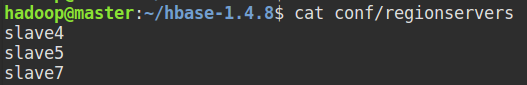

添加想要运行RegionServer的节点名:

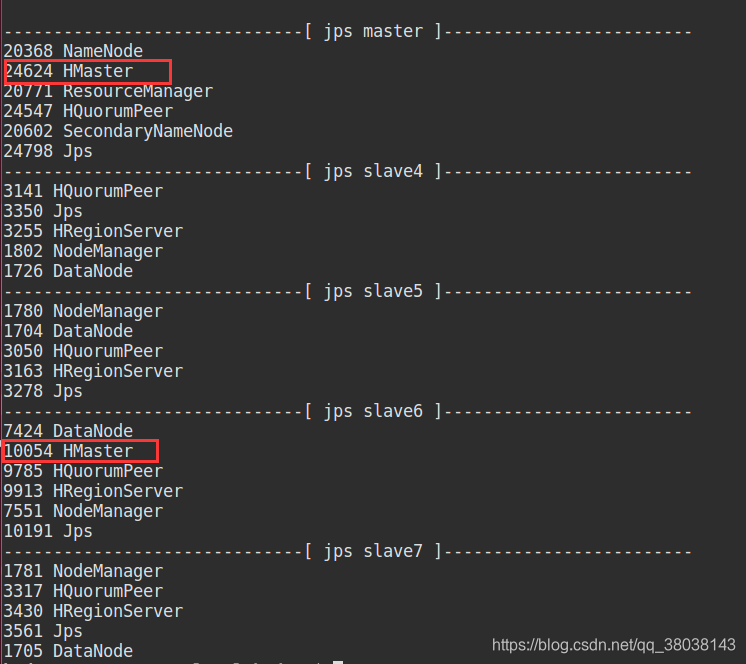

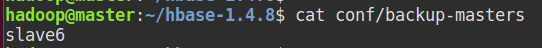

设置slave6为运行HMaster的备用节点,该文件不存在需要创建:

启动(先关闭),先启动Hadoop集群:

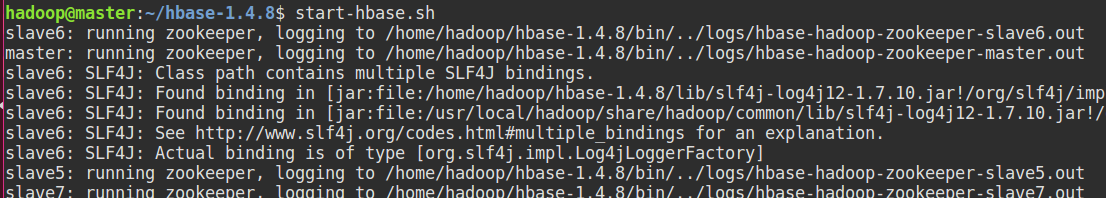

bin/start-hbase.sh

查看集群: