原文主要转载于:https://www.cnblogs.com/charlotte77/p/5629865.html

本文主要分两个部分描述:

第一部分为原理知识主要是涉及到数学微积分和理论推导

第二部分为代码实践(Python实现)两种实现方式

1、第一种代码(根据理论公式推导一步步实现代码)

2、第二种代码(根据转换为向量实现简单的代码)

一、理论说明(需要有简单的神经网络原理知识,建议看吴恩达deep learning学习视频):

最近在看深度学习的东西,一开始看的吴恩达的UFLDL教程,有中文版就直接看了,后来发现有些地方总是不是很明确,又去看英文版,然后又找了些资料看,才发现,中文版的译者在翻译的时候会对省略的公式推导过程进行补充,但是补充的又是错的,难怪觉得有问题。反向传播法其实是神经网络的基础了,但是很多人在学的时候总是会遇到一些问题,或者看到大篇的公式觉得好像很难就退缩了,其实不难,就是一个链式求导法则反复用。如果不想看公式,可以直接把数值带进去,实际的计算一下,体会一下这个过程之后再来推导公式,这样就会觉得很容易了。

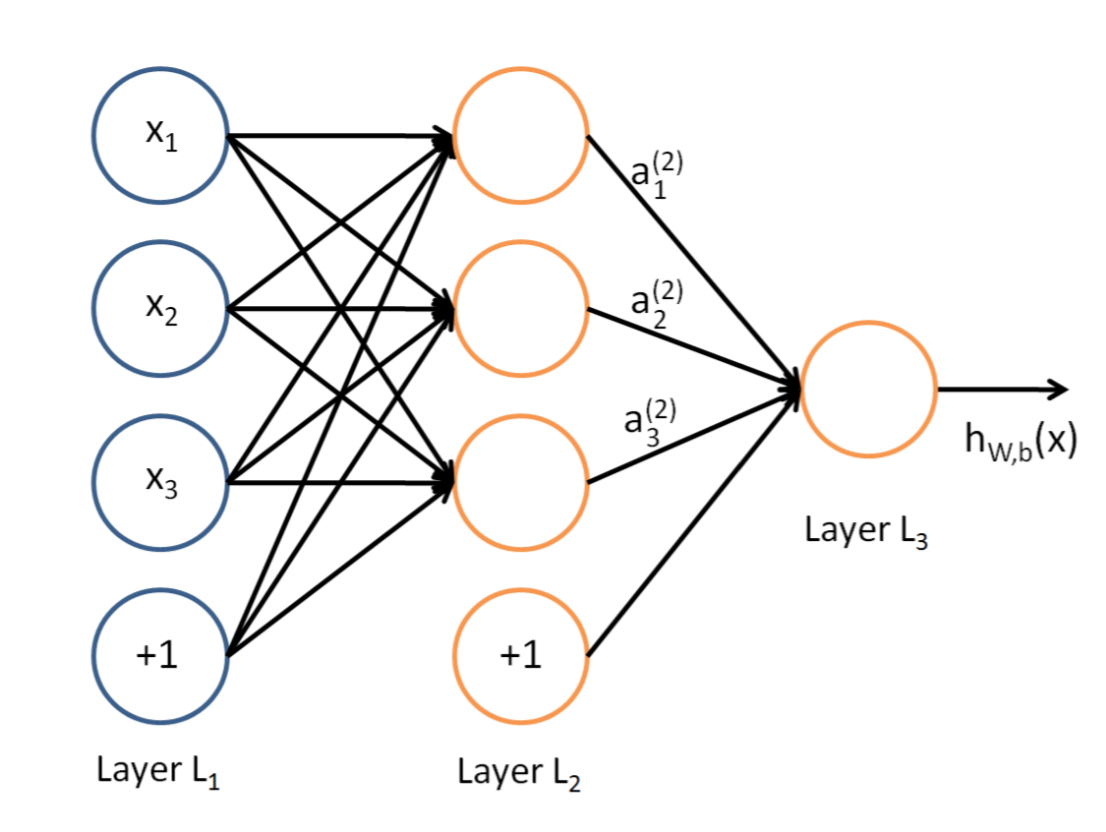

说到神经网络,大家看到这个图应该不陌生:

这是典型的三层神经网络的基本构成,Layer L1是输入层,Layer L2是隐含层,Layer L3是隐含层,我们现在手里有一堆数据{x1,x2,x3,...,xn},输出也是一堆数据{y1,y2,y3,...,yn},现在要他们在隐含层做某种变换,让你把数据灌进去后得到你期望的输出。如果你希望你的输出和原始输入一样,那么就是最常见的自编码模型(Auto-Encoder)。可能有人会问,为什么要输入输出都一样呢?有什么用啊?其实应用挺广的,在图像识别,文本分类等等都会用到,我会专门再写一篇Auto-Encoder的文章来说明,包括一些变种之类的。如果你的输出和原始输入不一样,那么就是很常见的人工神经网络了,相当于让原始数据通过一个映射来得到我们想要的输出数据,也就是我们今天要讲的话题。

本文直接举一个例子,带入数值演示反向传播法的过程,公式的推导等到下次写Auto-Encoder的时候再写,其实也很简单,感兴趣的同学可以自己推导下试试:)(注:本文假设你已经懂得基本的神经网络构成,如果完全不懂,可以参考Poll写的笔记:[Mechine Learning & Algorithm] 神经网络基础)

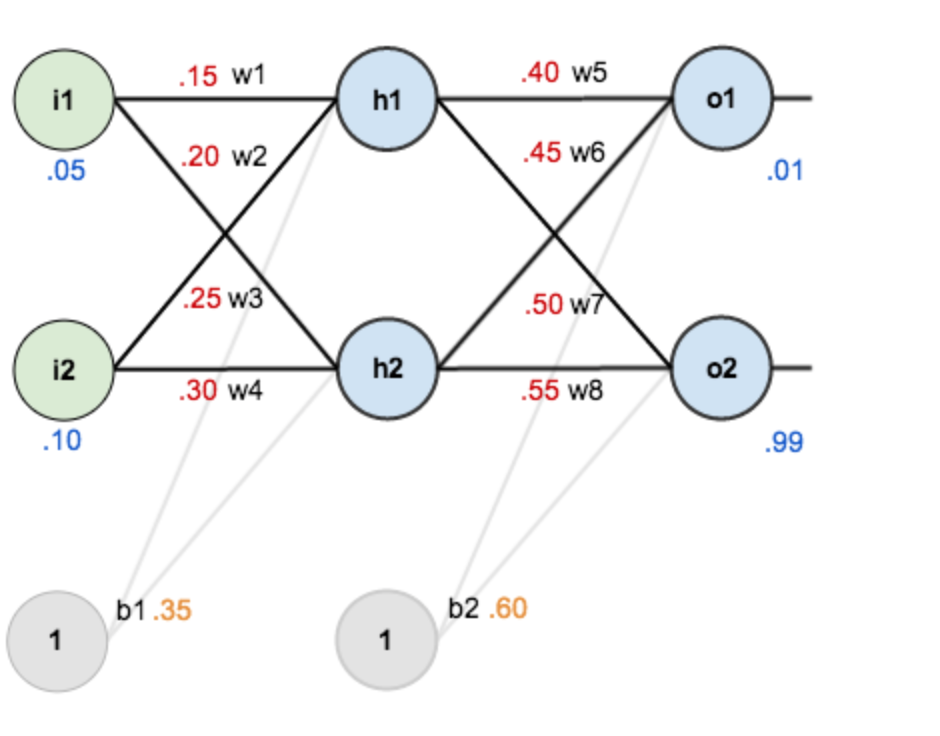

假设,你有这样一个网络层:

第一层是输入层,包含两个神经元i1,i2,和截距项b1;第二层是隐含层,包含两个神经元h1,h2和截距项b2,第三层是输出o1,o2,每条线上标的wi是层与层之间连接的权重,激活函数我们默认为sigmoid函数。

现在对他们赋上初值,如下图:

其中,输入数据 i1=0.05,i2=0.10;

输出数据 o1=0.01,o2=0.99;

初始权重 w1=0.15,w2=0.20,w3=0.25,w4=0.30;

w5=0.40,w6=0.45,w7=0.50,w8=0.55

目标:给出输入数据i1,i2(0.05和0.10),使输出尽可能与原始输出o1,o2(0.01和0.99)接近。

Step 1 前向传播

1.输入层---->隐含层:

计算神经元h1的输入加权和:

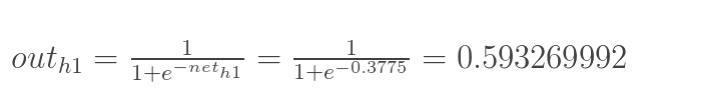

神经元h1的输出o1:(此处用到激活函数为sigmoid函数):

同理,可计算出神经元h2的输出o2:

![]()

2.隐含层---->输出层:

计算输出层神经元o1和o2的值:

![]()

这样前向传播的过程就结束了,我们得到输出值为[0.75136079 , 0.772928465],与实际值[0.01 , 0.99]相差还很远,现在我们对误差进行反向传播,更新权值,重新计算输出。

Step 2 反向传播

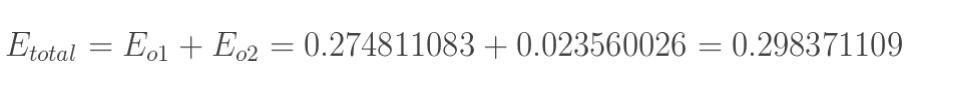

1.计算总误差

总误差:(square error)

但是有两个输出,所以分别计算o1和o2的误差,总误差为两者之和:

2.隐含层---->输出层的权值更新:

以权重参数w5为例,如果我们想知道w5对整体误差产生了多少影响,可以用整体误差对w5求偏导求出:(链式法则)

下面的图可以更直观的看清楚误差是怎样反向传播的:

现在我们来分别计算每个式子的值:

计算![]() :

:

计算 :

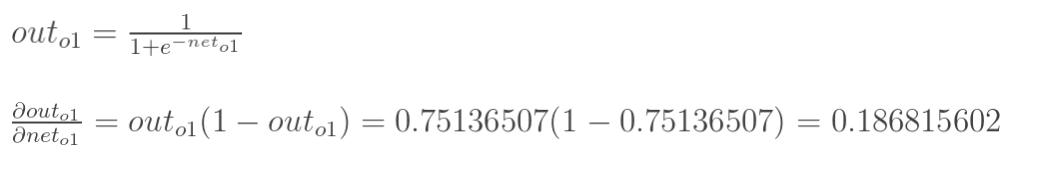

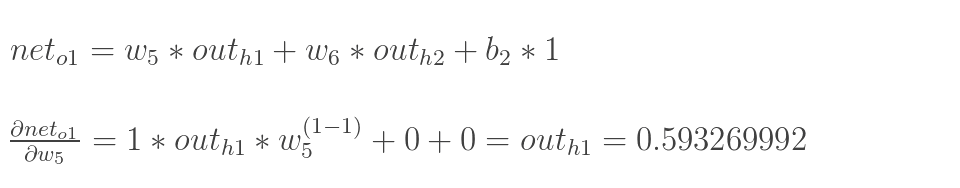

:

(这一步实际上就是对sigmoid函数求导,比较简单,可以自己推导一下)

计算 :

:

最后三者相乘:

这样我们就计算出整体误差E(total)对w5的偏导值。

回过头来再看看上面的公式,我们发现:

为了表达方便,用![]() 来表示输出层的误差:

来表示输出层的误差:

因此,整体误差E(total)对w5的偏导公式可以写成:

如果输出层误差计为负的话,也可以写成:

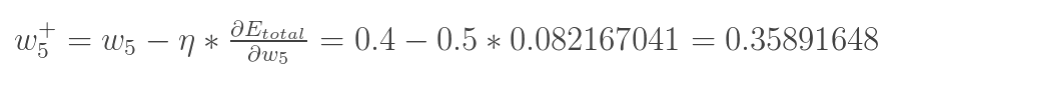

最后我们来更新w5的值:

(其中,![]() 是学习速率,这里我们取0.5)

是学习速率,这里我们取0.5)

同理,可更新w6,w7,w8:

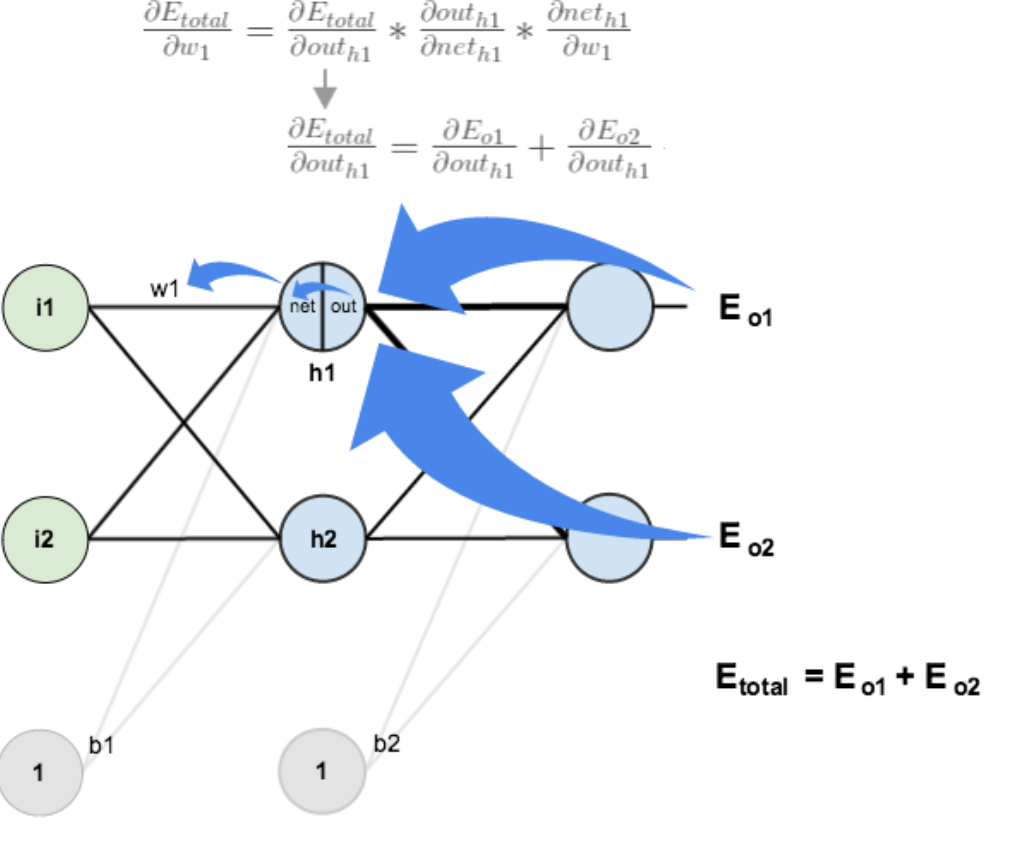

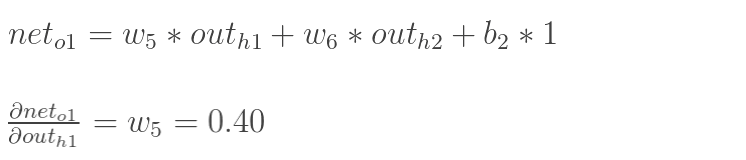

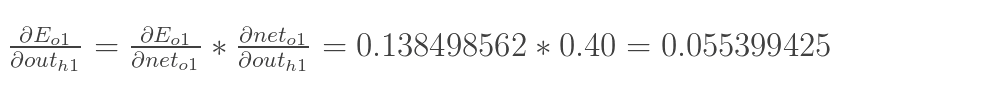

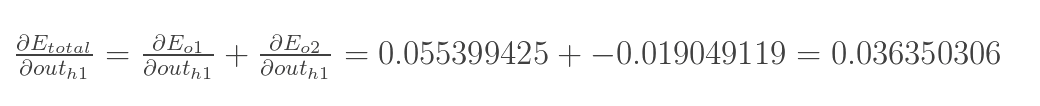

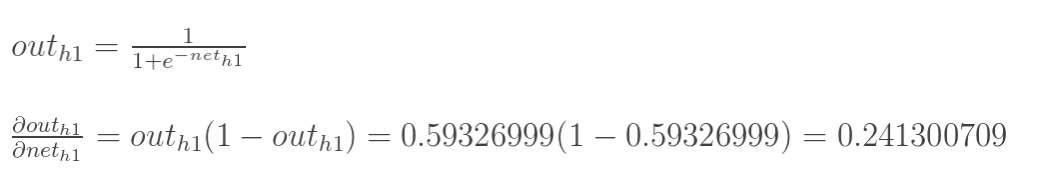

3.隐含层---->隐含层的权值更新:

方法其实与上面说的差不多,但是有个地方需要变一下,在上文计算总误差对w5的偏导时,是从out(o1)---->net(o1)---->w5,但是在隐含层之间的权值更新时,是out(h1)---->net(h1)---->w1,而out(h1)会接受E(o1)和E(o2)两个地方传来的误差,所以这个地方两个都要计算。

计算![]() :

:

先计算 :

:

![]()

![]()

同理,计算出:

![]()

两者相加得到总值:

再计算![]() :

:

再计算![]() :

:

最后,三者相乘:

为了简化公式,用sigma(h1)表示隐含层单元h1的误差:

最后,更新w1的权值:

![]()

同理,额可更新w2,w3,w4的权值:

这样误差反向传播法就完成了,最后我们再把更新的权值重新计算,不停地迭代,在这个例子中第一次迭代之后,总误差E(total)由0.298371109下降至0.291027924。迭代10000次后,总误差为0.000035085,输出为[0.015912196,0.984065734](原输入为[0.01,0.99]),证明效果还是不错的。

二、代码实践(Python实现)两种实现方式

1、第一种代码(根据理论公式推导一步步实现代码)

import numpy as np

# "pd"偏导

'''

激活函数

'''

def sigmoid(x):

return 1/(1/+np.exp(-x))

'''

计算激活函数的偏微分

'''

def sigmoidDerivationx(y):

return y*(1-y)

if __name__ == "__main__":

#初始化

bias = [0.35, 0.60]

weight = [0.15,0.2,0.25,0.3,0.4,0.45,0.5,0.55]

output_layer_weights = [0.4,0.45,0.5,0.55]

#初始值

i1 = 0.05

i2 = 0.10

#目标值

target1 = 0.01

target2 = 0.99

alpha = 0.5 #学习率

numIter = 10000 #迭代次数

for i in range(numIter):

#正向传播

neth1 = i1*weight[1-1] + i2*weight[2-1] + bias[0]

neth2 = i1*weight[3-1] + i2*weight[4-1] + bias[0]

outh1 = sigmoid(neth1)

outh2 = sigmoid(neth2)

neto1 = outh1*weight[5-1] + outh2*weight[6-1] + bias[1]

neto2 = outh2*weight[7-1] + outh2*weight[8-1] + bias[1]

outo1 = sigmoid(neto1)

outo2 = sigmoid(neto2)

print(str(i)+ ",target1 :" + str(target1-outo1)+",target2 : "+ str(target2-outo2))

if i == numIter-1:

print("lastst result :"+str(outo1)+" "+ str(outo2))

#反向传播

#计算w5-w8(输出层权重)的误差

pdEOuto1 = - (target1-outo1) #对o1输出的微积分

pdOuto1Neto1 = sigmoidDerivationx(outo1)#对o1激活函数的积分

pdNeto1W5 = outh1 #对得到neto1的函数中变量w5的微积分

pdEW5 = pdEOuto1 * pdOuto1Neto1 * pdNeto1W5 #用整体的误差对w5求偏导

pdNeto1W6 = outh2

pdEW6 = pdEOuto1 * pdOuto1Neto1 * pdNeto1W6 #用整体的误差对w6求偏导

'''

同理用同样的方法对w7和w8更新

'''

pdEOuto2 = - (target2 - outo2)

pdOuto2Neto2 = sigmoidDerivationx(outo2)

pdNeto1W7 = outh1

pdEW7 = pdEOuto2 * pdOuto2Neto2 * pdNeto1W7

pdNeto1W8 = outh2

pdEW8 = pdEOuto2 * pdOuto2Neto2 * pdNeto1W8

#计算w1-w4(输出层权重)的误差

pdEouto1 = -(target1 - outo1) #之前算过

pdEouto2 = -(target2 - outo2) #之前算过

pdOuto1Neto1 = sigmoidDerivationx(outo1) #之前算过

pdOuto2Neto2 = sigmoidDerivationx(outo2) #之前算过

'''

由h1输出out1到o1的neto1 相当于 y=w*x + b

y为Neto1 和x为Outh1 然后对Outh1微积分得到的值为w

'''

pdNeto1Outh1 = weight[5-1] #对Outh1到Neto1函数中输入值的

pdNeto2Outh2 = weight[7-1]

'''

求出h1输出的误差占总的误差的比重

'''

pdEOuth1 = pdEOuto1 * pdOuto1Neto1 * pdNeto1Outh1 + pdEOuto2 * pdOuto2Neto2 * pdNeto1Outh1

pdOuth1Neth1 = sigmoidDerivationx(outh1) #对激活函数微积分

pdNeth1W1 = i1

pdNeth1W2 = i2

'''

参考公式

'''

pdEW1 = pdEOuth1 * pdOuth1Neth1 * pdNeth1W1

pdEW2 = pdEOuth1 * pdOuth1Neth1 * pdNeth1W2

pdNeto1Outh2 = weight[6-1]

pdNeto2Outh2 = weight[8-1]

pdOuth2Neth2 = sigmoidDerivationx(outh2)

'''

由输入的公式微积分y = w*x + b可知

'''

pdNeth2W3 = i1

pdNeth2W4 = i2

pdEOuth2 = pdEOuto1 * pdOuto1Neto1 * pdNeto1Outh2 + pdEOuto2 * pdOuto2Neto2 * pdNeto2Outh2

pdEW3 = pdEOuth2 * pdOuth2Neth2 * pdNeth2W3

pdEW4 = pdEOuth2 * pdOuth2Neth2 * pdNeth2W4

#权重更新

weight[1-1] = weight[1-1] - alpha*pdEW1

weight[2-1] = weight[2-1] - alpha*pdEW2

weight[3-1] = weight[3-1] - alpha*pdEW3

weight[4-1] = weight[4-1] - alpha*pdEW4

weight[5-1] = weight[5-1] - alpha*pdEW5

weight[6-1] = weight[6-1] - alpha*pdEW6

weight[7-1] = weight[7-1] - alpha*pdEW7

weight[8-1] = weight[8-1] - alpha*pdEW8

2、第二种代码(根据转换为向量实现简单的代码)

import numpy as np

#设置激活函数

def sigmoid(x):

return 1/(1+np.exp(-x))

#计算激活函数的偏微分

def sigmoidDerivationx(y):

return y * (1-y)

if __name__ == "__main__":

alpha = 0.05 #设置学习率

numIter = 100000 #迭代次数

w1 = [[0.15,0.20],[0.25,0.30]] #输出层的权重

w2 = [[0.40,0.45],[0.50,0.55]] #权重矩阵的维度

b1 = 0.35

b2 = 0.60

x = [0.05,0.10] #初始化输入

y = [0.01,0.99] #初始化对应的输出label

z1 = np.dot(w1,x) + b1

a1 = sigmoid(z1) #激活函数,第一层激励值

z2 = np.dot(w2,x) + b2

a2 = sigmoid(z2) #第二层激励值

for n in range(numIter):

'''

反向传播,使用代价函数c = 1/(2n)*sum[y-a2]^2

最后一层的梯度delta

'''

delta2 = np.multiply(-(y - a2),np.multiply(a2,1-a2))

'''

delta2这两项乘积由来,第一个参数是代价函数对a2求的偏导(实际上得到的就是真实输出值与预测值之间的误差而已)

第二个参数是激励值得导数,二者相乘最后得梯度的变化值

非最后一层的梯度delta(即隐含层),算法与最后一层不一样,因为其没有输出预测值,我们用下一层误差的加权和来代替真实值与预测值的差

'''

delta1 = np.multiply(np.dot(np.array(w2).T, delta2), np.multiply(a1, 1 - a1))

# 关键是要明白计算的过程与理论基础

# 计算完权重的变化后(即delta),更新权重,delta也可以称为梯度的变化

for i in range(len(w2)):

w2[i] = w2[i] -alpha*delta2[i]*a1

for i in range(len(w1)):

w1[i] = w1[i] -alpha*delta1[i]*np.array(x)

#继续向前传播,算出误差值

s

z1 = np.dot(w1,x) + b1 #用新的权重值在计算一遍激励值

a1 = sigmoid(z1)

z2 = np.dot(w2,a1) + b2

a2 = sigmoid(z2)

print(str(n) + "result: "+str(a2[0])+",result: "+str(a2[1]))

# 输出迭代后的预测值

print(str(n) + "error1: "+str(y[0] - a2[0])+ ",error2: "+str(y[1] - a2[1]))

# 输出误差,可以通过改变迭代次数来查看效果

实验结果:

目录

一、理论说明(需要有简单的神经网络原理知识,建议看吴恩达deep learning学习视频):