Tensorflow学习笔记之池化

在深度学习网络中,经常会遇到池化操作,并且往往是在卷积之后,池化操作的意义是降低卷积层输出特征向量的维度,并且通过不同的池化方法使不同维度的卷积层输出结果得到相同维度的特征向量结果。

1、一般池化

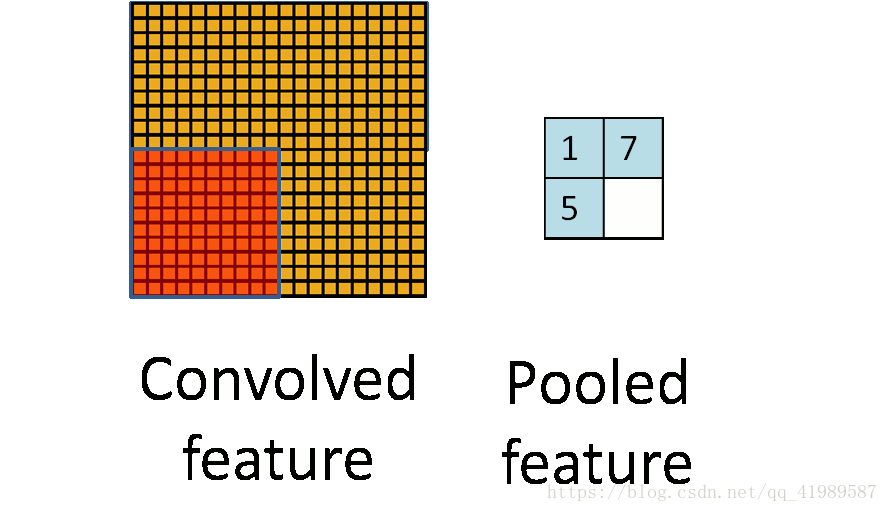

池化过程作用于不重叠区域

我们定义池化窗口的大小为sizeX,即下图中红色正方形的边长,定义两个相邻池化窗口的水平位移/竖直位移为stride。一般池化由于每一池化窗口都是不重复的,所以sizeX=stride。

2、重叠池化

重叠池化正如其名字所说的,相邻池化窗口之间会有重叠区域,此时sizeX>stride。

3、空金字塔池化

空间金字塔池化可以把任何尺度的图像的卷积特征转化成相同维度,这不仅可以让CNN处理任意尺度的图像,还能避免cropping和warping操作,导致一些信息的丢失,具有非常重要的意义。

一般的CNN都需要输入图像的大小是固定的,这是因为全连接层的输入需要固定输入维度,但在卷积操作是没有对图像尺度有限制,所有作者提出了空间金字塔池化,先让图像进行卷积操作,然后转化成维度相同的特征输入到全连接层,这个可以把CNN扩展到任意大小的图像。