版权声明:本文为博主原创文章,未经博主允许不得转载。 https://blog.csdn.net/qq_40883132/article/details/83142165

读取Iris数据集细节资料:

#导入iris数据加载器

from sklearn.datasets import load_iris

#使用加载器读取数据并存入变量iris

iris=load_iris()

#查验数据规模

#print(iris.data.shape)

#查看数据说明

#print(iris.DESCR)对Iris数据集进行数据分割:

#对数据进行随机分割

from sklearn.cross_validation import train_test_split

X_train,X_test,y_train,y_test=train_test_split(iris.data,iris.target,test_size=0.25,random_state=33)

使用K近邻分类器对数据进行类别预测:

#使用K近邻分类器对数据进行类别预测

#导入标准化模块

from sklearn.preprocessing import StandardScaler

from sklearn.neighbors import KNeighborsClassifier

#对训练数据的测试的特征数据进行标准化

ss=StandardScaler()

X_train=ss.fit_transform(X_train)

X_test=ss.transform(X_test)

#使用K近邻分类器对测试数据进行类别预测,预测结果保存在y_predict中

knc=KNeighborsClassifier()

knc.fit(X_train,y_train)

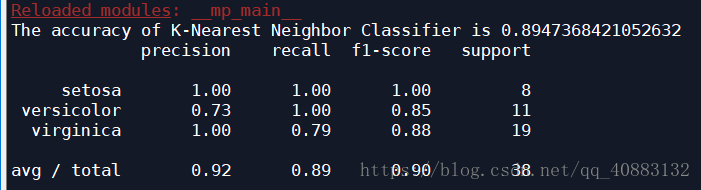

y_predict=knc.predict(X_test)对K近邻分类器数据的预测性能进行评估:

#对K近邻分类器数据的预测性能进行评估

print('The accuracy of K-Nearest Neighbor Classifier is',knc.score(X_test,y_test))

#详情分析

from sklearn.metrics import classification_report

print(classification_report(y_test,y_predict,target_names=iris.target_names))

特点分析:改模型并没有训练参数,这样的决策算法,导致了其非常高的计算复杂度和内存消耗。这是一个平方级的算法复杂度。

每一个 测试样本,都需要预先加载在内存中的训练样本进行遍历、逐一计算相似度,、排序并选取K个最近邻的训练样本的标记,进而做出分类决策。

完整代码参考:

# -*- coding: utf-8 -*-

"""

Created on Thu Oct 18 09:41:46 2018

@author: asus

"""

#导入iris数据加载器

from sklearn.datasets import load_iris

#使用加载器读取数据并存入变量iris

iris=load_iris()

#查验数据规模

#print(iris.data.shape)

#查看数据说明

#print(iris.DESCR)

#对数据进行随机分割

from sklearn.cross_validation import train_test_split

X_train,X_test,y_train,y_test=train_test_split(iris.data,iris.target,test_size=0.25,random_state=33)

#使用K近邻分类器对数据进行类别预测

#导入标准化模块

from sklearn.preprocessing import StandardScaler

from sklearn.neighbors import KNeighborsClassifier

#对训练数据的测试的特征数据进行标准化

ss=StandardScaler()

X_train=ss.fit_transform(X_train)

X_test=ss.transform(X_test)

#使用K近邻分类器对测试数据进行类别预测,预测结果保存在y_predict中

knc=KNeighborsClassifier()

knc.fit(X_train,y_train)

y_predict=knc.predict(X_test)

#对K近邻分类器数据的预测性能进行评估

print('The accuracy of K-Nearest Neighbor Classifier is',knc.score(X_test,y_test))

#详情分析

from sklearn.metrics import classification_report

print(classification_report(y_test,y_predict,target_names=iris.target_names))