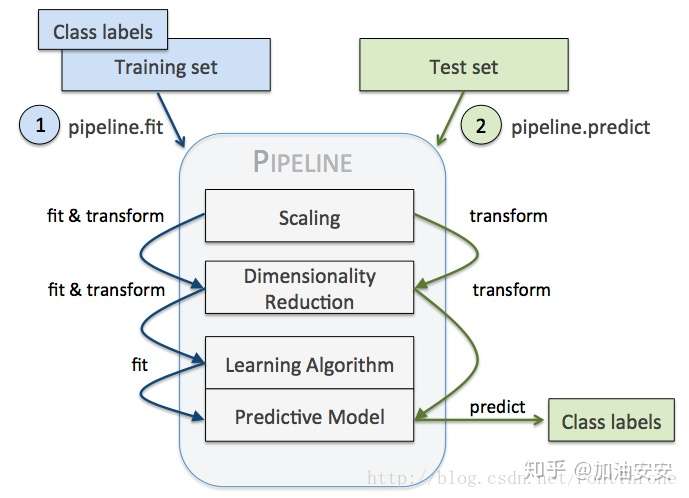

当我们对训练集应用各种预处理操作时(特征标准化、主成分分析等等), 我们都需要对测试集重复利用这些参数,以免出现数据泄露(data leakage)。

pipeline 实现了对全部步骤的流式化封装和管理(streaming workflows with pipelines),可以很方便地使参数集在新数据集(比如测试集)上被重复使用。

Pipeline可以将许多算法模型串联起来,比如将特征提取、归一化、分类组织在一起形成一个典型的机器学习问题工作流。主要带来两点好处:

1. 直接调用fit和predict方法来对pipeline中的所有算法模型进行训练和预测。

2. 可以结合grid search对参数进行选择。

1 官方文档

Parameters

- steps : 步骤:列表(list)

被连接的(名称,变换)元组(实现拟合/变换)的列表,按照它们被连接的顺序,最后一个对象是估计器(estimator)。 - memory:内存参数,Instance of sklearn.external.joblib.Memory or string, optional (default=None)

- 属性,name_steps:bunch object,具有属性访问权限的字典

只读属性以用户给定的名称访问任何步骤参数。键是步骤名称,值是步骤参数。或者也可以直接通过”.步骤名称”获取

funcution

- Pipline的方法都是执行各个学习器中对应的方法,如果该学习器没有该方法,会报错

- 假设该Pipline共有n个学习器

- transform,依次执行各个学习器的transform方法

- fit,依次对前n-1个学习器执行fit和transform方法,第n个学习器(最后一个学习器)执行fit方法

- predict,执行第n个学习器的predict方法

- score,执行第n个学习器的score方法

- set_params,设置第n个学习器的参数

- get_param,获取第n个学习器的参数

等等,详情可以参看官方文档。

⭐如何设定参数比便用于网格调参。

2 举例

这个例子是最简单的例子,在参考文献【1】【2】【3】中有许多更为复杂也更实用的例子。这个例子只是用于分析pipeline的流程。

⭐问题是要对数据集 Breast Cancer Wisconsin 进行分类,

它包含 569 个样本,第一列 ID,第二列类别(M=恶性肿瘤,B=良性肿瘤),第 3-32 列是实数值的特征。

from pandas as pd

from sklearn.cross_validation import train_test_split

from sklearn.preprocessing import LabelEncoder

df = pd.read_csv('https://archive.ics.uci.edu/ml/machine-learning-databases/'

'breast-cancer-wisconsin/wdbc.data', header=None)

# Breast Cancer Wisconsin dataset

X, y = df.values[:, 2:], df.values[:, 1]

encoder = LabelEncoder()

y = encoder.fit_transform(y)

>>> encoder.transform(['M', 'B'])

array([1, 0])

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=.2, random_state=0)

我们要用 Pipeline 对训练集和测试集进行如下操作:

- 先用

StandardScaler对数据集每一列做标准化处理,(是 transformer) - 再用

PCA将原始的 30 维度特征压缩的 2 维度,(是 transformer) - 最后再用模型

LogisticRegression。(是 Estimator)

调用 Pipeline 时,输入由元组构成的列表,每个元组第一个值为变量名,元组第二个元素是 sklearn 中的 transformer 或 Estimator。

注意中间每一步是 transformer,即它们必须包含 fit 和 transform 方法,或者 fit_transform。

最后一步是一个 Estimator,即最后一步模型要有 fit 方法,可以没有 transform 方法。

然后用 Pipeline.fit对训练集进行训练,pipe_lr.fit(X_train, y_train)

再直接用 Pipeline.score 对测试集进行预测并评分 pipe_lr.score(X_test, y_test)

from sklearn.preprocessing import StandardScaler

from sklearn.decomposition import PCA

from sklearn.linear_model import LogisticRegression

from sklearn.pipeline import Pipeline

pipe_lr = Pipeline([('sc', StandardScaler()),

('pca', PCA(n_components=2)),

('clf', LogisticRegression(random_state=1))

])

pipe_lr.fit(X_train, y_train)

print('Test accuracy: %.3f' % pipe_lr.score(X_test, y_test))

# Test accuracy: 0.947

⭐Pipeline 的工作方式:

当管道 Pipeline 执行 fit 方法时,

首先 StandardScaler 执行 fit 和 transform 方法,

然后将转换后的数据输入给 PCA,

PCA 同样执行 fit 和 transform 方法,

再将数据输入给 LogisticRegression,进行训练。

注意中间每一步是transformer,即它们必须包含 fit 和 transform 方法,或者fit_transform。

最后一步是一个Estimator,即最后一步模型要有 fit 方法,可以没有 transform 方法。

⭐当然,还可以用来选择特征,也可以应用 K-fold cross validation,详见参考文献【5】。

3 参考文献

【1】 Managing Machine Learning Workflows with Scikit-learn Pipelines Part 2: Integrating Grid Search

【2】Managing Machine Learning Workflows with Scikit-learn Pipelines Part 2: Integrating Grid Search

【4】Using AutoML to Generate Machine Learning Pipelines with TPOT

【5】Automate Machine Learning Workflows with Pipelines in Python and scikit-learn