作为一名python的初学者,有必要在学习的过程中记录笔记,方便以后查看。另外,现在的技术更新很快,通过书籍和视频学习python时,有些内容可能已经过时,所以在此将更新过的内容记录下来。

由于requests应用起来比urllib方便很多,而正则表达式是HTML解析的基础方法,因此本文利用requests+正则表达式将猫眼电影的相关信息爬取下来,然后以文件的形式保存下来。

(1)目标站点分析

首先打开猫眼电影http://maoyan.com/,依次点击“榜单”和“TOP100榜”,页面显示出TOP100榜单的电影信息:

拉到最底部,发现每页有10部推荐电影,点击“下一页”,网页URL中的“offset”变为10:

下面进行网页代码的分析。在网页中点击右键--》“检查”,审查网页元素,可以发现每部电影均包含在一个“<dd>...</dd>”标签之中:

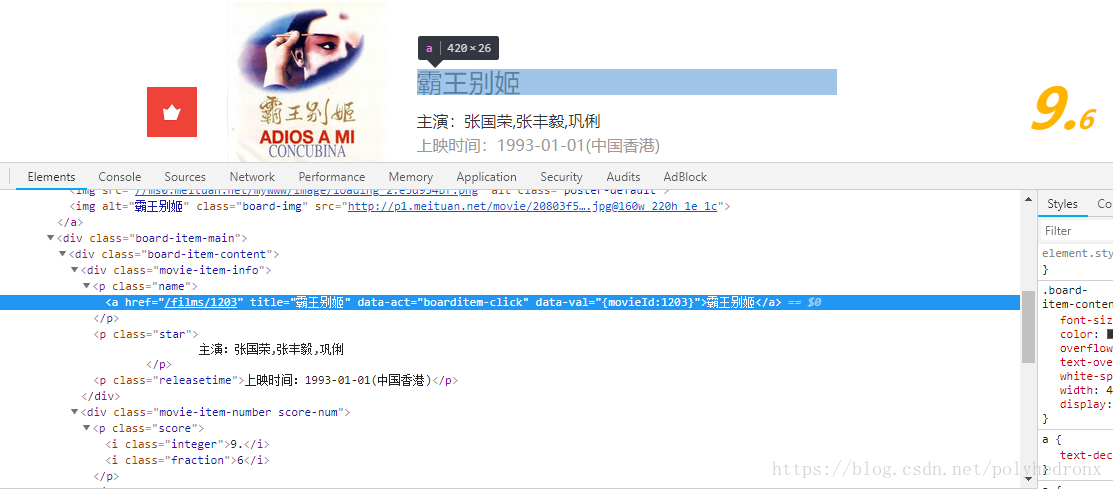

打开标签,可以很容易地找到电影的图片链接、标题、主演、上映时间和评分等信息,也就可以方便地用正则表达式提取出来:

(2)流程框架

1.抓取单页内容

利用requests请求目标站点,得到单个网页HTML代码,返回结果。

2.正则表达式分析

根据HTML代码分析得到电影的名称、主演、上映时间、评分、图片链接等信息。

3.保存至文件

通过文件的形式将结果保存,每一部电影一个结果一行json字符串。

4.开启循环及多线程

对多页内容遍历,开启多线程提高抓取速度。

(3)爬虫代码

# maoyan_top100.py

import requests

from requests.exceptions import RequestException

import re

import json

from multiprocessing import Pool

def get_one_page(url):

try:

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) '

+'Chrome/67.0.3396.99 Safari/537.36'

}

response = requests.get(url, headers=headers) # 模拟成浏览器

if response.status_code == 200:

return response.text

return None

except RequestException:

return None

def parse_one_page(html):

pattern = re.compile('<dd>.*?board-index.*?>(\d+)</i>.*?data-src="(.*?)".*?name"><a'

+'.*?>(.*?)</a>.*?star">(.*?)</p>.*?releasetime">(.*?)</p>'

+'.*?integer">(.*?)</i>.*?fraction">(.*?)</i>.*?</dd>', re.S)

items = re.findall(pattern, html)

for item in items:

yield{

'index': item[0],

'image': item[1],

'title': item[2],

'actor': item[3].strip()[3:],

'time': item[4].strip()[5:],

'score': item[5]+item[6]

}

def write_to_file(content):

with open('E:/PycharmProjects/maoyan_top100.txt', 'a', encoding='utf-8') as f:

f.write(json.dumps(content, ensure_ascii=False) + '\n') # 字典转换为字符串

f.close()

def main(offset):

url = 'http://maoyan.com/board/4?offset=' + str(offset)

html = get_one_page(url)

for item in parse_one_page(html):

print(item)

write_to_file(item)

# 多进程

if __name__ == '__main__':

pool = Pool()

pool.map(main, [i*10 for i in range(10)])

'''

if __name__ == '__main__':

for i in range(10):

main(i*10)

'''