数学建模系列——CNN原理与实践

——————————————————————————

大概建模一年多了吧,准备趁着这个暑假,把建模的东西整理一下,留个笔记和纪念,万一哪天不会了还能翻翻笔记。众所周知,建模这东西入门不难,网上各种教程一大把一大把,人家写的也很专业,我写的东西基本登不了大雅之堂,跟人家没法比就写点下里巴人的东西吧。

概念引入

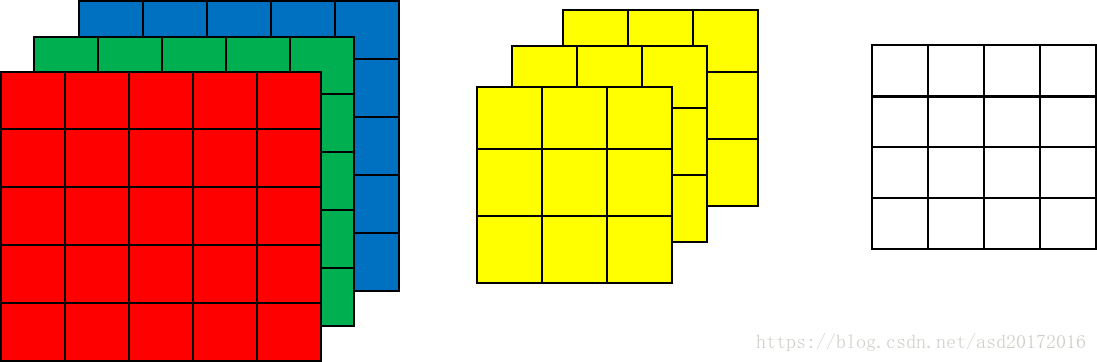

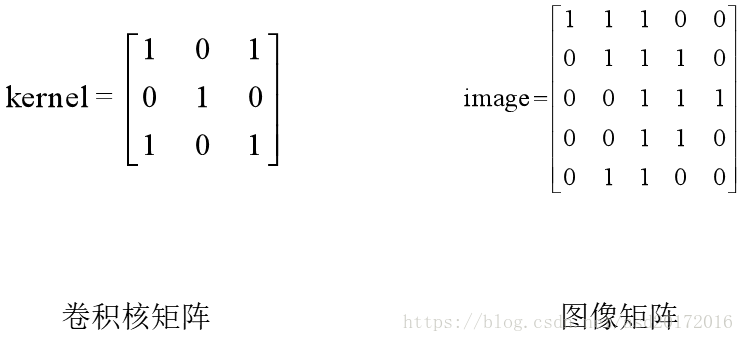

图像处理中的卷积运算。看个图生动形象的理解一下下:

在设置好矩阵之后,又该如何运算呢,来,看下面的动图。矩阵对应相乘相加得到卷积的结果。比如,对于左上角的元素4而言,它的运算方式就是:

填充padding。上面的操作看着貌似很好,但是有没有缺陷呢?当然有,第一个问题, 的矩阵和 的矩阵的卷积结果会得到 的输出矩阵,也就是原始图像在提取特征的过程中被缩小了,一直卷积的话图像会被一直缩小到一个像素,显然不是想要的结果;第二个问题,原始图像左上角的像素只参与一次运算,而他右边的像素参与了两次运算,是不是不公平?是的。那么如何解决这两个问题呢?

不失一般性,设原始图像为 的矩阵,卷积核为 的矩阵,那么输出结果就是 的矩阵。言归正传,怎么解决上面的问题呢?答案是填充。在imange矩阵的周围在添加一层像素,使其变成 的矩阵,而填充内容是随意的,如果添加 层像素,原始图像就会变为 的矩阵,为了使输出矩阵和原始矩阵的维度相同,就要满足下面的等式:

卷积步长stride。上面的例子中,卷积的移动步长是1,当移动步长 的时候呢, 和 的矩阵卷积输出的结果是 的矩阵(自己脑补,就不画图了),于是又得到一个规律,卷积输出结果的维度是 。

卷积步长stride。上面的例子中,卷积的移动步长是1,当移动步长 的时候呢, 和 的矩阵卷积输出的结果是 的矩阵(自己脑补,就不画图了),于是又得到一个规律,卷积输出结果的维度是 。

立体卷积与多特征输出

立体卷积。其实感觉立体卷积这个名字不好,确切的说应该是RGB图像的卷积,容我解释一下应该就能理解的更加透彻了。众所周知,RGB图像有三个通道,也就是意味着RGB图像是 的矩阵,那么怎么对这个立方体进行卷积呢?

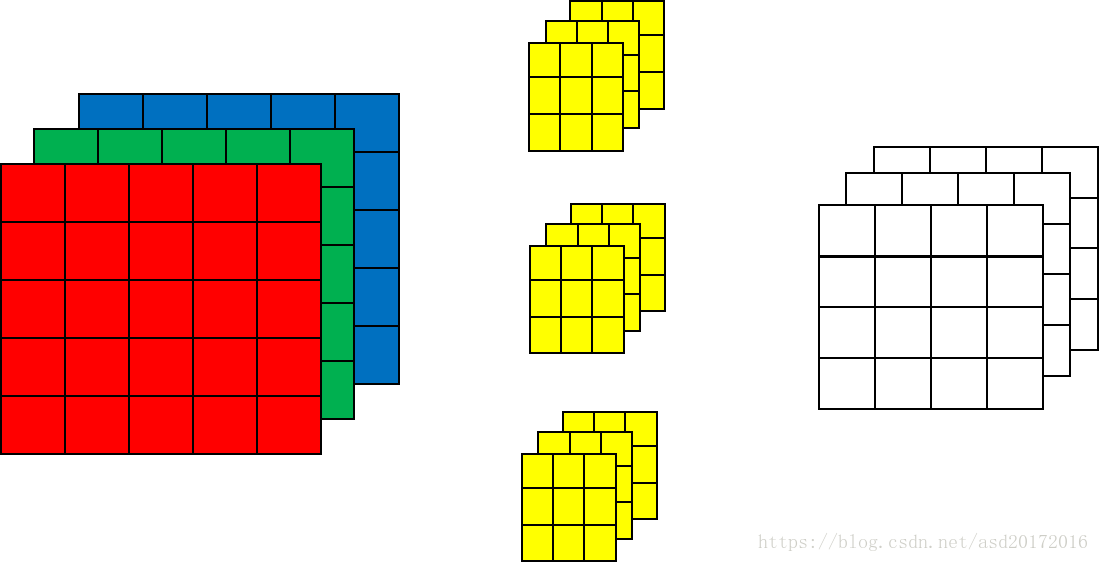

看上图,左边是RGB三色通道下的图 ,黄色的是卷积核 ,当卷积步长 时,最右边是输出图像 ,具体是怎么运算的呢,同二维卷积,卷积核与原图像相乘相加,第一层卷积核和R做二维卷积,第二层卷积核和G做二维卷积,第三层卷积核和B做卷积,(卷积层数和输入的层数保持一致)将三者的结果相加求和,得到输出的第一个元素,以此类推,得到输出矩阵。

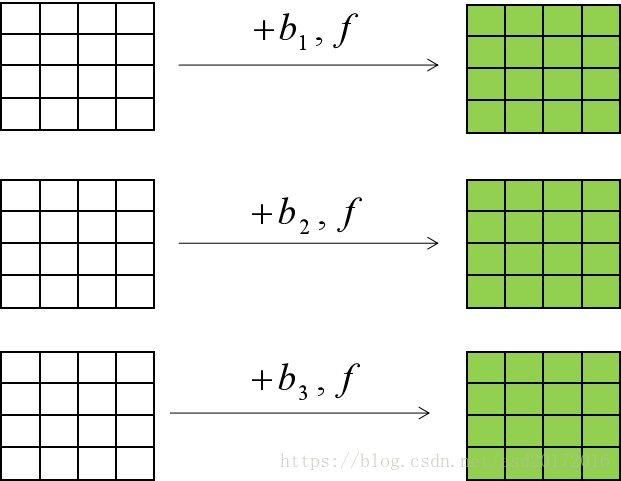

多特征输出。先乱入一个重点,关于卷积核提取水平特征,竖直特征等特征的方法,可以先看看我的这个博客,介绍的比较简单。卷积核。在了解了如何提取想要的特诊之后,那么如何同时输出这些特征呢?看下图。通过设置多个卷积核来提取不同的特征,每增加一个卷积核,输出图像的维度就会加一,比如,有 个卷积核,输出的图像就是 的矩阵。

单层卷积网络

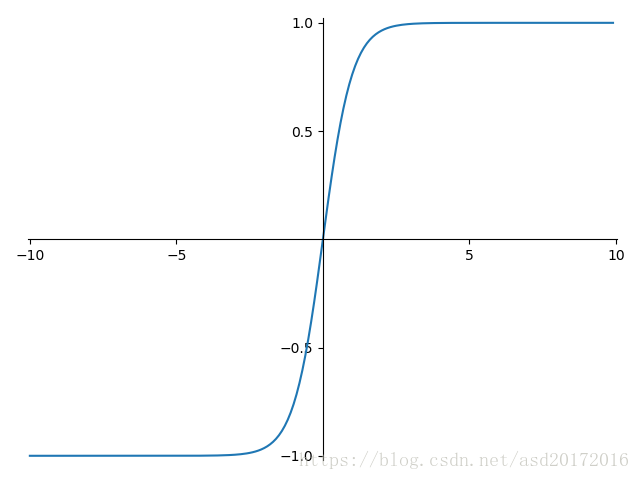

激活函数与偏向。偏向可能翻译的不好,他的英文表达是bias,可能看了英文就理解的更生动吧。用最简单的形式介绍下激活函数和偏向。假设有一个输入 , 即为所求的输入加偏向, 是随机常数。然后对 进行激活,激活函数有很多种,举一个例子说明,看下图sigmoid的函数,(就是高中生物的那个S型增长曲线)。当输入的 在 内,得到的 在 之间;当输入的 在 之间时,得到的 在 之间,因此激活函数可以理解为一种映射关系,将输入的 映射为 。

偏向、激活函数在卷积中的应用。

如上图所示,承接上文,在得到卷积的输出之后,对输出的每一个像素做偏向、激活的操作,得到新的输出结果。

第一个卷积神经网络。接着看上面那个图,一次卷积之后会得到三个 的输出矩阵,将输出矩阵的元素排列成一个 的向量,在导入lofistic、softmax中去判断,你输入的图片是一只猫还是一只狗。当然还可以有多个卷积层,除了卷积层(conv)之外还可以有池化层(pool)和全连接层(FC),接下来介绍池化层和全连接层。

池化层

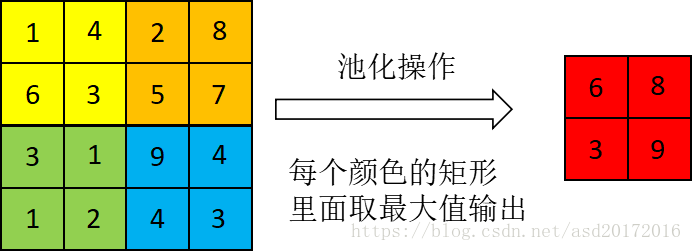

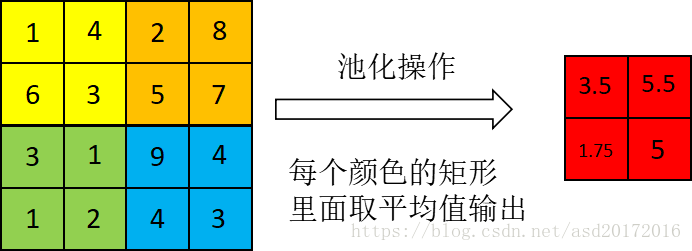

最大池化。(用的比较广泛)。可以理解为取出特征值最大的做为输出或者取其平均值作为输出。

平均池化

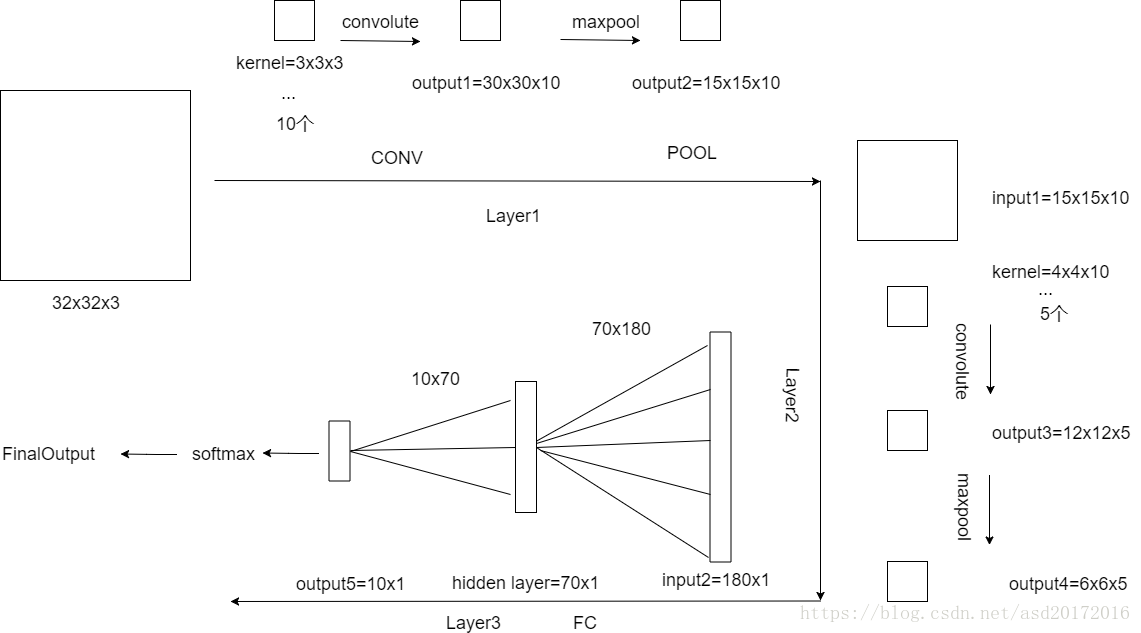

含有常见模块的最简单的卷积神经网络

结构很简单,首先是 的图像输入,第一层的内容是卷积,池化;第二层的内容是卷积,池化,第三层是全连接,全连接的形式和普通的神经网络一样,嗯,起码得有一丢丢神经网络的基础。然后得到最终的输出。

python实践

做一个简单的猫狗识别的CNN网络。数据下载地址

待续。