1.本地运行

(1)exclipse、idea运用的这两个工具中需要添加两个依赖

启动最小的集群,进行测试

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-minicluster</artifactId>

<version>2.7.6</version>

</dependency>

定义运行的客户端

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-client</artifactId>//运行的客户端

<version>2.7.6</version>

</dependency>

(2)因此就可以开发mapreduce,处理windows上的文件

操作的文件路径为Windows 中的D:/a/1下的文件

eclipse 中进行传参

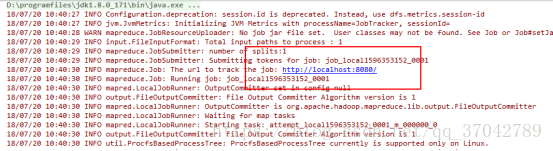

从日志中也可以看出是本地执行:

2.本地运行+HDFS文件

(1)添加配置文件+java代码中添加:(两种方式)

法1:

法2:

(2)可以操作hdfs的文件,即输入输出文件可以是HDFS 上的文件。

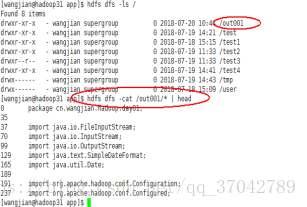

输入文件:

输出的结果:(在HDFS 上可以查看)

(3)原因:因为它的默认的配置:

1)yarn.nodemanager.hostname=0.0.0.1

默认${yarn.nodemanager.hostname}:0,即随机使用临时端口,官方解释是"The address of the container manager in the NM"。NodeManager不能对RPC server使用临时端口,因为NM在重启后会更换端口,会打断重启前的container与NodeManager的连接,设置后可以固定使用同一个的端口

2) mapreduce.framework.name=local 本地。

新框架支持第三方 MapReduce 开发框架以支持如 SmartTalk/DGSG 等非 Yarn 架构,注意通常情况下这个配置的值都设置为 Yarn,如果没有配置这项,那么提交的 Yarn job 只会运行在 locale 模式,而不是分布式模式。

3.本地开发提交运行

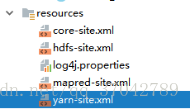

步一:将配置文件放到

步二:

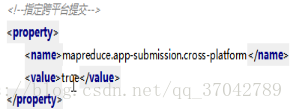

(1)在mapred-site.xml中添加(因为是跨平台提交)

(2)在yarn-site.xml (resourcemanager的hostname)

步三:打Jar包

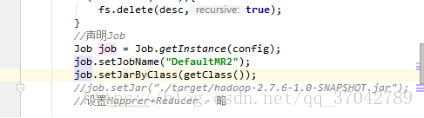

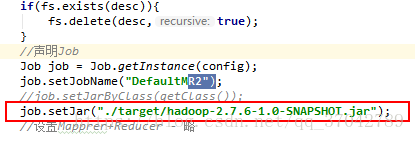

(1)打Jar包的时候,一定要把job.setJarByClass()的参数换成getClass();

设置job中的资源所在的jar包,该方法的作用是 通过传入的class 找到job的jar包,我们设置的class 跟我们的job类位于同一个包中,通过public void setJarByClass(Class cls) 返回的是就是我们job包的jar。

(2)运行时

以上三种方式,即为MapReduce运行方式运行的三种方式,如果您有不同的见解可以随时联系我。