如果我们使用梯度下降作为我们的优化算法,那么梯度检查是很有用的。但是,如果我们使用的是高级优化方法之一(比如fminunc),它几乎没有什么作用。

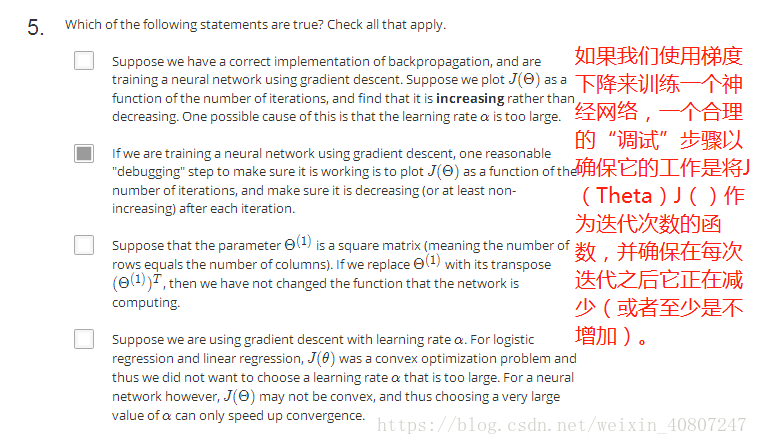

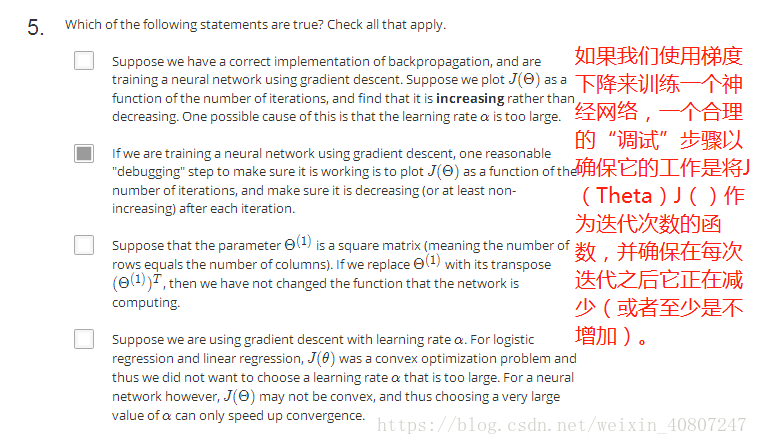

假设我们有一个正确的反向传播的实现,并且使用梯度下降来训练一个神经网络。假设我们把J(Theta)J()作为迭代次数的函数,并且发现它是递增的而不是递减的。一个可能的原因是,学习速率太大了。

如果我们使用梯度下降作为我们的优化算法,那么梯度检查是很有用的。但是,如果我们使用的是高级优化方法之一(比如fminunc),它几乎没有什么作用。

假设我们有一个正确的反向传播的实现,并且使用梯度下降来训练一个神经网络。假设我们把J(Theta)J()作为迭代次数的函数,并且发现它是递增的而不是递减的。一个可能的原因是,学习速率太大了。