下面内容从端到端的自动驾驶的方案看相关技术脉络:

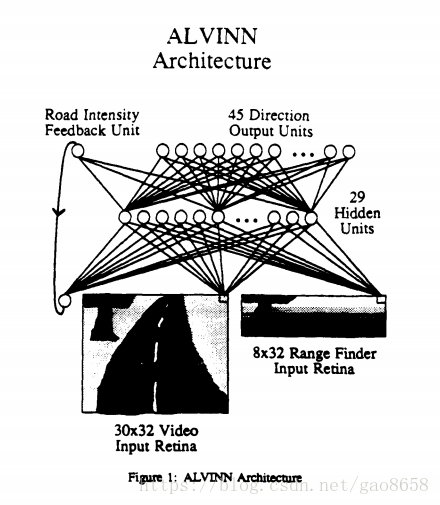

1988年,ALVINN: An Autonomous Land Vehicle In a Neural Network

已经有人开始尝试使用End-to-End。但局限于30×32像素,还没有CNN,这样也能在简单道路上实现自动驾驶。

方案:

采用全连接神经网络,输入viedo和laser range finder作为输入。

输出方向和道路密集程度反馈:

道路密集程度反馈:The road intensity feedback unit indicates whether the road is lighter or darker than the non-road in the previous image.

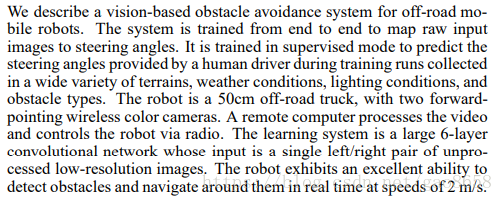

2005年,Off-Road Obstacle Avoidance through End-to-End Learning

LeCUN也做了无人驾驶探索。2015年,提出了中间状态自动驾驶,无需生成各种复杂过程,只需要找出关键点生成决策控制。

05年方案:

- 端到端直接预测

- 输入为双目的图像

- 输出为转向角度

- 6层CNN模型

方案细节:

实验:

采用小车在野外进行路测。

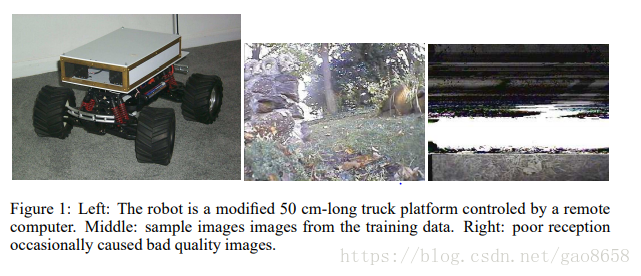

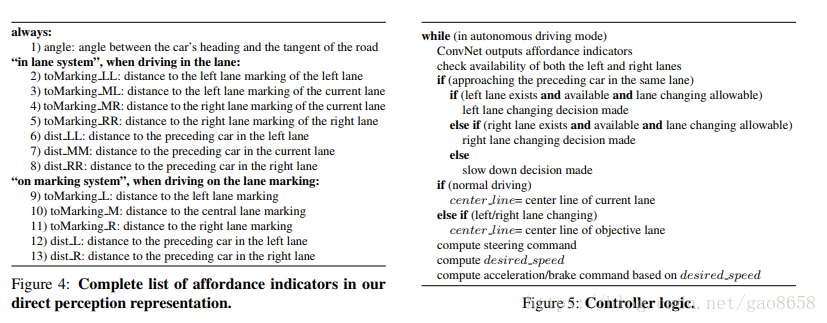

2015年,DeepDriving: Learning Affordance for Direct Perception in Autonomous Driving

将方案分为三类,提出自己的方案为折中方案:

(1) Mediated Perception

流程:

- 各个子模块提取特征:such as lanes, traffic signs, traffic lights, cars, pedestrians, etc

- AI engine进行行动控制

问题:模块多,产生的特征有冗余对预测来说不一定用到。

(2) Behaivior reflex

直接对输入图像通过CNN模型预测输出车辆控制动作预测

问题:

ill-posed:当输入图像相似,不同驾驶员不同的操作行为产生不同的训练数据,造成回归器难以训练

环境状态抽象出来的层级和预测的层级之间缺乏过渡。

模型需要学习哪个部分对预测有相关性

(3) Direct Perception

流程:

- CNN提取特征

- CNN进行车辆控制动作预测

实验:

数据采用torcs模拟器生成的方案

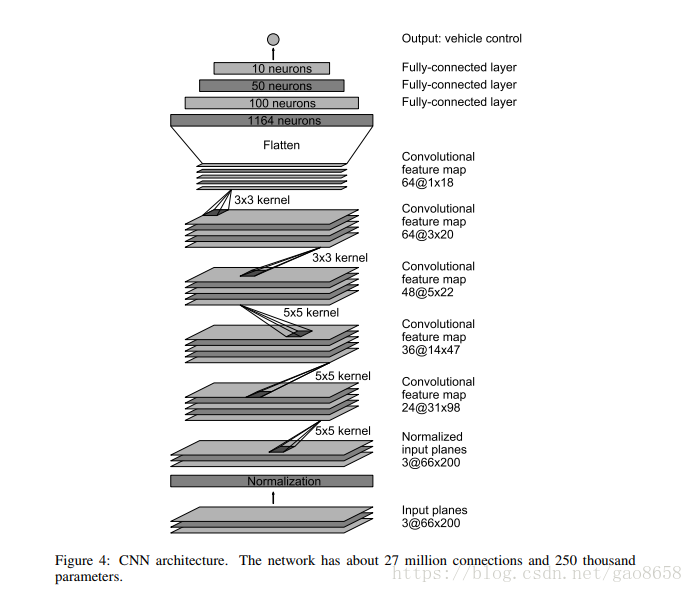

2016年, End to End Learning for Self-Driving Cars

在DAVE2基础之上,提供相机、卷积网络,更关键的是实车上路——在美国的很多路上进行测试。有评估体系和三目相机采集End-to-End数据。

方案:

Compared to explicit decomposition of the problem, such as lane marking detection, path planning, and control, our end-to-end system optimizes all processing steps simultaneously. 端到端系统将道路线检测,路径规划和控制等子步骤通过CNN模型同时完成。

模型输入图像,输出转向角度。采用CNN模型,模型架构如下:

2016年至今

Comma.ai,Drive.ai,Auto X等都相应进行了探索。

参考文献:

ALVINN: AN AUTONOMOUS LAND VEHICLE IN A NEURAL NETWORK

End to End Learning for Self-Driving Cars

DeepDriving: Learning Affordance for Direct Perception in Autonomous Driving

资深架构师深度剖析:基于深度学习的End-to-End