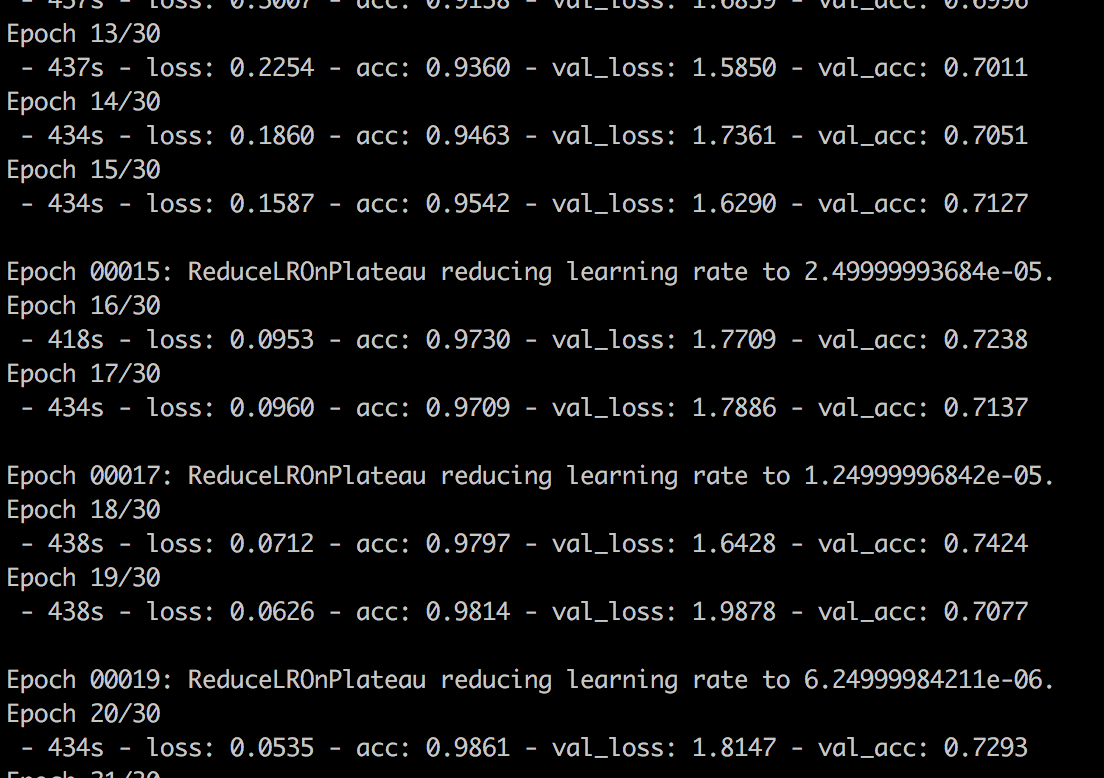

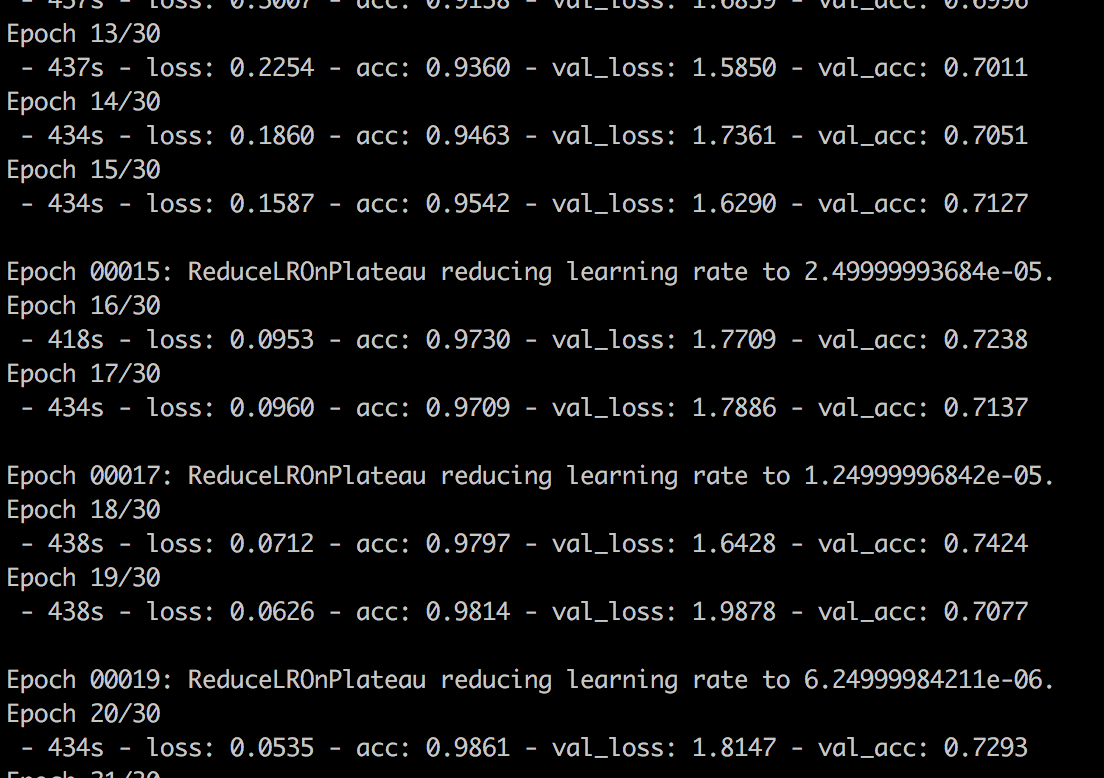

一、学习率衰减实验

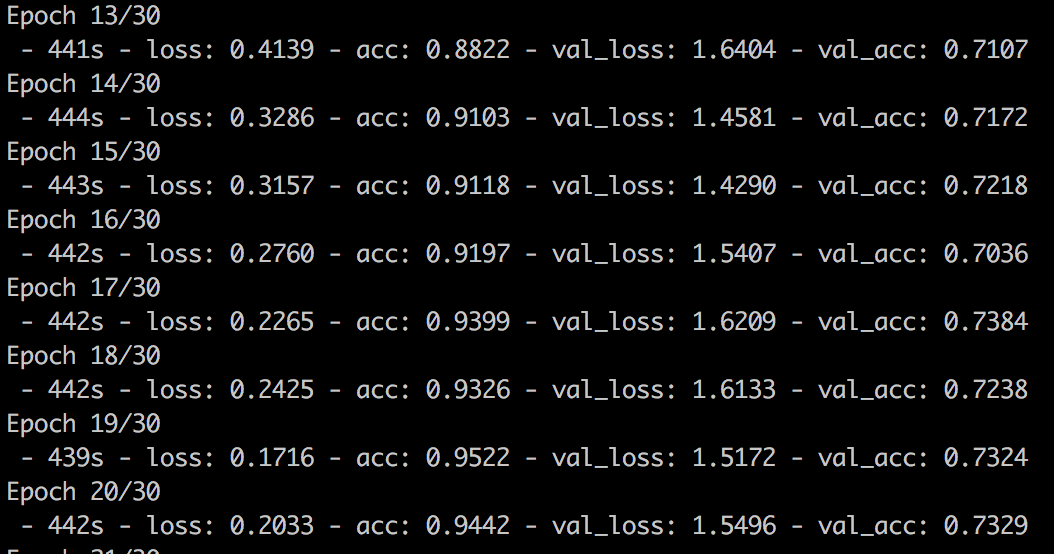

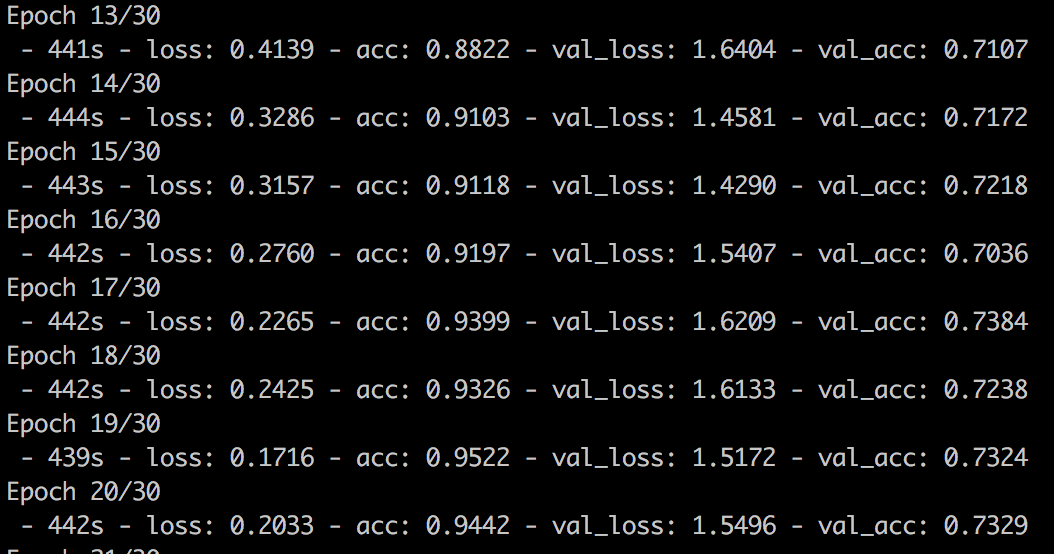

二、不做衰减

三、结论

由此可见,使用学习率衰减,使得训练集上的loss下降更快,迭代20轮时,不使用衰减,训练集loss是0.2033,而使用衰减的是0.05。所以,对于训练集loss难以进一步下降的场景,可以使用学习率衰减。

但是,验证集上的loss和准确率并没有显著区别,都是1.6和0.73左右,原因是模型早已过拟合,验证集收敛的loss远远大于训练集。

猜想,在不过拟合的情况下,衰减学习率能同时提高训练集和验证集的效果。

一、学习率衰减实验

二、不做衰减

三、结论

由此可见,使用学习率衰减,使得训练集上的loss下降更快,迭代20轮时,不使用衰减,训练集loss是0.2033,而使用衰减的是0.05。所以,对于训练集loss难以进一步下降的场景,可以使用学习率衰减。

但是,验证集上的loss和准确率并没有显著区别,都是1.6和0.73左右,原因是模型早已过拟合,验证集收敛的loss远远大于训练集。

猜想,在不过拟合的情况下,衰减学习率能同时提高训练集和验证集的效果。