How regularization reduces overfitting?

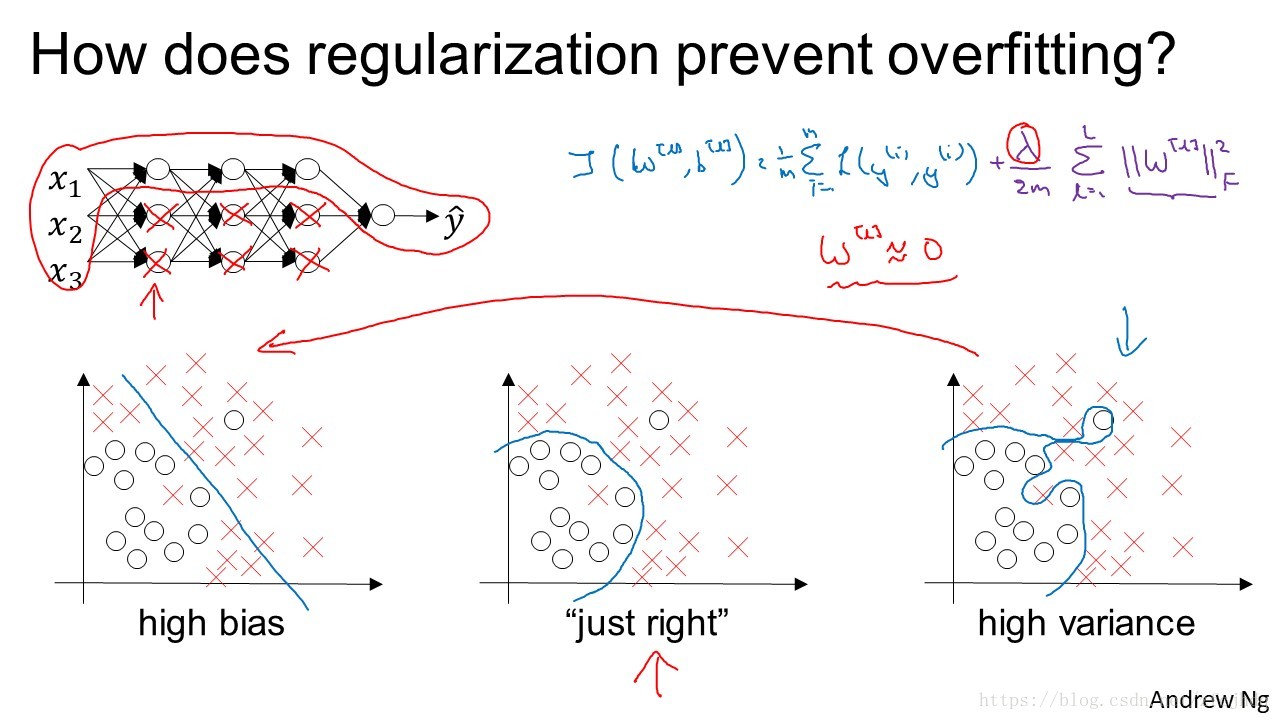

- 解释 1 通过regularization, 使得神经网络各个层级的参数

都更小更趋近于零,从而使得一个复杂的神经网络变得更像一个简单的神经网络(当参数真为零是,就是简单的神经网络了),从而减小过拟合。

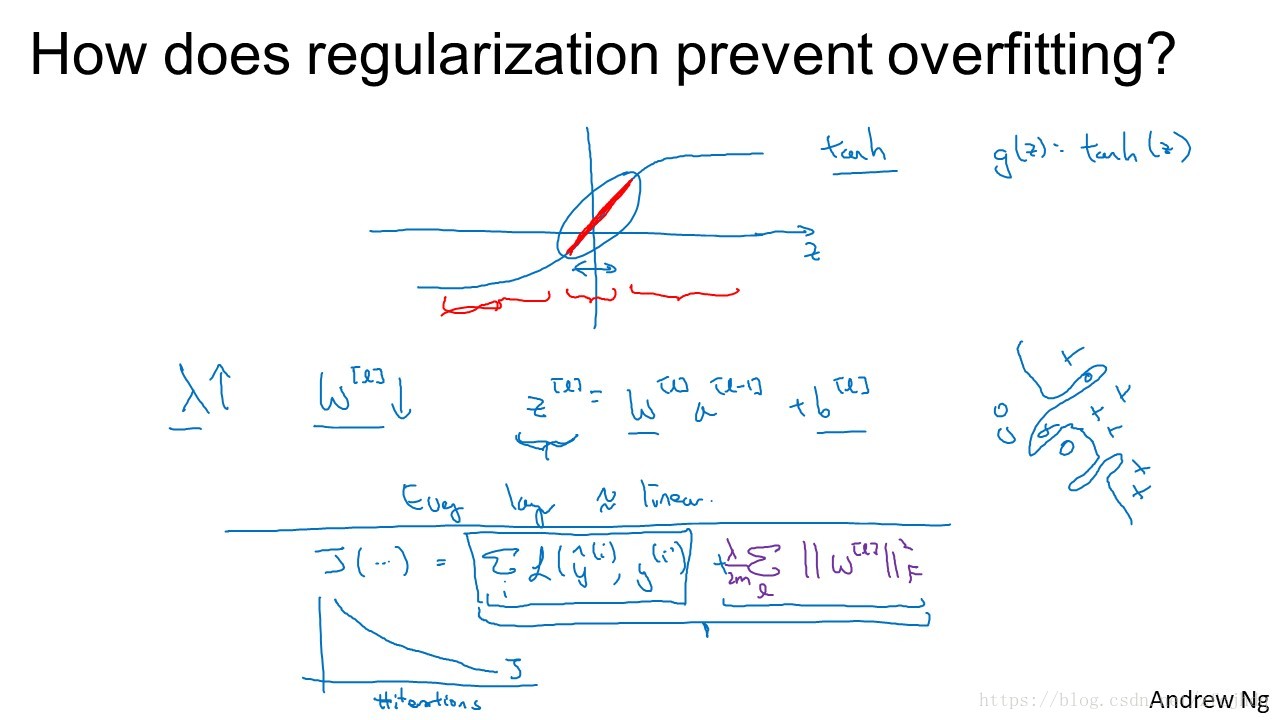

- 解释 2 以

激励函数为例,当

较小时,则

也会更小,所以在使用激励函数的时候,对应其靠近零的线性部分,所以整个网络都会更加趋于线性函数,从而无法计算很复杂的非线性函数,从而防止过拟合。