1.摘要

颜色在人类视觉感知中起着重要作用,反映了物体的光谱。然而,现有的红外和可见图像融合方法很少探索如何直接处理多光谱/通道数据并实现高颜色保真度。本文通过提出一种新的扩散模型方法,称为DifFusion,来生成多通道输入数据的分布,从而增强多源信息聚合能力和颜色保真度。具体而言,我们不像现有的融合方法将多通道图像转换为单通道数据,而是在潜在空间中使用去噪网络创建多通道数据分布,并进行正向和反向扩散过程。然后,我们使用去噪网络提取具有可见光和红外信息的多通道扩散特征。最后,我们将多通道扩散特征输入多通道融合模块,直接生成三通道融合图像。为了保留纹理和强度信息,我们提出了多通道梯度损失和强度损失。除了当前用于测量纹理和强度保真度的评估指标外,我们引入了一种新的评估指标来量化颜色保真度。大量实验证明我们的方法比其他最先进的图像融合方法更有效,尤其是在颜色保真度方面。

2.引言

现有的方法通常将存储在三个通道中的可见图像(即,RGB通道)从RGB空间到YCbCr空间,并使用Y通道进行融合。单通道融合图像生成后,需要通过后处理转换为三通道图像。由于输入数据中并非所有通道都呈现,因此难以构造多通道分布和提取多通道互补信息,从而导致颜色失真。针对上述问题,提出了一种基于扩散模型的红外与可见光图像融合方法,即DifFusion方法。

首先,我们直接馈送由三通道可见光图像和一通道红外图像组成的多通道数据,并通过扩散过程在潜空间中构造多通道分布。扩散过程是一个马尔可夫过程,分为正向过程和反向过程。在前向过程中,高斯噪声被递增地添加到多通道输入数据,并且在反向过程中,在前向过程中添加的噪声以多个时间步长被消除。通过在反向过程中训练去噪网络来估计在正向过程中添加的噪声,从而构造多通道分布。其次,我们从去噪网络中提取多通道扩散特征,其中包括红外和可见光特征。第三,将多通道扩散特征送入多通道融合模块,直接生成三通道融合图像。在此基础上,提出了多通道梯度损失LMCG和多通道强度损失LMCI算法,以保持三通道融合图像的纹理和梯度信息。

本文的主要贡献如下:

• 我们提出了一种基于扩散模型的红外和可见图像融合框架,能够直接生成色彩融合图像,并同时实现颜色、梯度和强度的保真度。

• 我们将多通道分布的构建形式化为一个扩散过程,据我们所知,这是首次将扩散模型应用于红外和可见图像融合的研究。

• 为了衡量融合图像的颜色保真度,引入了一种新的评估指标来量化颜色保真度。大量实验表明,所提出的方法优于现有的最先进方法。

3.方法

在本节中,我们详细描述了用于多模态数据的基于扩散的图像融合框架。所提出方法的主要思想如图2所示。可见光图像和红外图像对被沿通道维度连接起来,形成多通道输入用于扩散模型。在正向过程中,逐渐向多通道数据添加高斯噪声,直到数据接近纯噪声(例如 P ( I t ∣ I t − 1 ) P(I_t|I_{t−1}) P(It∣It−1)),如图2所示。然后,通过反向过程利用去噪网络(例如 Q ( I t − 1 ∣ I t ) Q(I_{t−1}|I_t) Q(It−1∣It)))尝试预测并消除添加的噪声。随后,可以从扩散模型中提取扩散特征,并将其馈送到所提出的多通道融合模块,如图2所示。在所提出的多通道损失的指导下,该框架直接产生色彩融合图像。

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-5TF8NkAZ-1690438702624)(/Users/zhangkai/Library/Application Support/typora-user-images/image-20230718145150661.png)]](https://img-blog.csdnimg.cn/e57101dc11a341b9b471df76f582ec65.png)

在接下来的子节中,我们首先介绍了扩散模型如何学习多通道分布并生成新的图像对。然后,详细介绍了基于扩散模型的多源信息聚合方法。最后,我们介绍了多通道强度损失和多通道梯度损失,以指导融合网络的训练过程。

3.1. Joint Diffusion with Infrared and Visible Images

给定一对配准的红外图像 I i r ∈ R H × W × 1 I_{ir} \in R^{H \times W \times 1} Iir∈RH×W×1 和可见图像 I v i s ∈ R H × W × 3 I_{vis} \in R^{H \times W \times 3} Ivis∈RH×W×3,其中 H H H 和 W W W 分别表示高度和宽度。为了学习多通道数据的联合潜在结构,将1通道的红外图像和3通道的可见图像连接起来形成一个4通道图像,表示为 I ∈ R H × W × 4 I \in R^{H \times W \times 4} I∈RH×W×4。我们采用 Denoising Diffusion Probabilistic Model (DDPM) 中提出的扩散过程来构建多通道数据的分布。多通道图像的正向扩散过程是逐步添加噪声,共进行 T T T 个时间步。在反向过程中,噪声通过 T T T 个时间步逐步消除。使用正向和反向过程训练扩散模型的目的是通过在潜在空间中建模4通道图像的扩散来学习红外和可见图像的联合潜在结构。

1)正向扩散过程:正向扩散过程受非平衡热力学的启发,可以看作是一个随着T个时间步逐渐向数据添加高斯噪声的马尔可夫链。在时间步骤t,嘈杂的多通道图像 I t I_t It可以表示为:

P ( I t ∣ I t − 1 ) = N ( I t ; α t I t − 1 , ( 1 − α t ) Z ) ( 1 ) P(I_t|I_{t-1})=N(I_t;\sqrt{\alpha_t I_{t-1}},(1-\alpha_t)Z) \quad (1) P(It∣It−1)=N(It;αtIt−1,(1−αt)Z)(1)

其中Z表示标准正态分布。 I t I_t It和 I t − 1 I_{t−1} It−1分别表示通过t和t−1次添加高斯噪声生成的嘈杂的4通道图像。 γ ∈ R H W 4 γ∈R^{HW4} γ∈RHW4是高斯噪声。 α t α_t αt是方差调度,控制在时间步骤t添加的高斯噪声的方差。更具体地,对于第一个时间步骤,嘈杂的4通道图像 I 1 I_1 I1可以表示为:

I 1 = α 1 I 0 + 1 − α 1 γ ( 2 ) I_1=\sqrt{\alpha_1I_0}+\sqrt{1-\alpha_1}\gamma \quad (2) I1=α1I0+1−α1γ(2)

其中 I 0 = I I_0=I I0=I表示原始输入。通过式(1)和式(2)可以推导出It的表达式:

P ( I t ∣ I 0 ) = N ( I t ; α ˉ t I 0 , ( 1 − α t ˉ ) Z ) ( 3 ) P(I_t|I_0)=N(I_t;\sqrt{\bar{\alpha}_tI_0},(1-\bar{\alpha_t})Z) \quad (3) P(It∣I0)=N(It;αˉtI0,(1−αtˉ)Z)(3)

其中 α t ˉ = ∑ i = 1 t α i \bar{\alpha_t}=\sum_{i=1}^t\alpha_i αtˉ=∑i=1tαi。在正向扩散过程中,给定时间步骤t、方差调度α1,…,αt和采样噪声,可以通过式(3)直接计算时间步骤t的嘈杂的多通道样本。

2)反向扩散过程:在反向扩散过程中,使用神经网络执行一系列小的去噪操作以获得原始的多通道图像。在反向过程的每个时间步骤中,对嘈杂的多通道图像 I t I_t It执行去噪操作以获得前一张图像 I t − 1 I_{t−1} It−1 。在条件 I t I_t It下, I t − 1 I_{t−1} It−1的概率分布可以表示为:

Q ( I t − 1 ∣ I t ) = N ( I t − 1 ; μ θ ( I t , t ) , σ t 2 Z ) ( 4 ) Q(I_{t-1}|I_t)=N(I_{t-1};\mu_{\theta}(I_t,t),\sigma_t^2Z) \quad (4) Q(It−1∣It)=N(It−1;μθ(It,t),σt2Z)(4)

其中 σ t 2 \sigma_t^2 σt2是条件分布 Q ( I t − 1 ∣ I t ) Q(I_{t−1}|I_t) Q(It−1∣It)的方差,可以表示为:

σ t 2 = 1 − α ˉ t − 1 1 − α ˉ t β t ( 5 ) \sigma_t^2=\frac{1-\bar{\alpha}_{t-1}}{1-\bar{\alpha}_t}\beta_t \quad (5) σt2=1−αˉt1−αˉt−1βt(5)

其中 β t = 1 − α t \beta_t=1-α_t βt=1−αt。条件分布 Q ( I t − 1 ∣ I t ) Q(I_{t−1}|I_t) Q(It−1∣It)的均值 μ θ ( I t , t ) \mu_{\theta}(I_t,t) μθ(It,t)可以表示为:

μ θ ( I t , t ) = 1 α t ( I t − β t 1 − α t ˉ θ ( I t , t ) ) ( 6 ) \mu_{\theta}(I_t,t)=\frac{1}{\sqrt{\alpha_t}}(I_t-\beta_t\sqrt{1-\bar{\alpha_t}}\theta(I_t,t)) \quad (6) μθ(It,t)=αt1(It−βt1−αtˉθ(It,t))(6)

其中 θ ( ⋅ , ⋅ ) \theta(\cdot,\cdot) θ(⋅,⋅)是去噪网络。 θ ( ⋅ , ⋅ ) \theta(\cdot,\cdot) θ(⋅,⋅)的输入是时间步骤t和嘈杂的多通道图像 I t I_t It。

3)扩散过程的损失函数:首先,从训练集中随机抽样一对配准的可见和红外图像对 ( I i r , I v i s ) (I_{ir}, I_{vis}) (Iir,Ivis),形成多通道图像I。然后,从标准正态分布中采样噪声γ。第三步,从均匀分布U({1,…,T})中采样时间步骤t。完成上述采样后,扩散模型的损失函数可以表示为:

L d i f f = ∥ γ − θ ( α ˉ t I 0 + 1 − α t ˉ γ , t ) ∥ 2 ( 7 ) L_{diff}=\|γ-\theta(\sqrt{\bar{\alpha}_tI_0}+\sqrt{1-\bar{\alpha_t}}\gamma,t)\|_2 \quad (7) Ldiff=∥γ−θ(αˉtI0+1−αtˉγ,t)∥2(7)

4)去噪网络的结构:为了预测正向扩散过程中添加的噪声,去噪网络 θ ( ⋅ , ⋅ ) \theta(\cdot,\cdot) θ(⋅,⋅)采用了SR3中使用的U-Net结构。SR3主干由5个卷积层组成的收缩路径、5个卷积层组成的扩张路径和一个扩散头组成。收缩路径和扩张路径分别由5个卷积层组成。扩散头由一个单独的卷积层组成,用于生成预测的噪声。

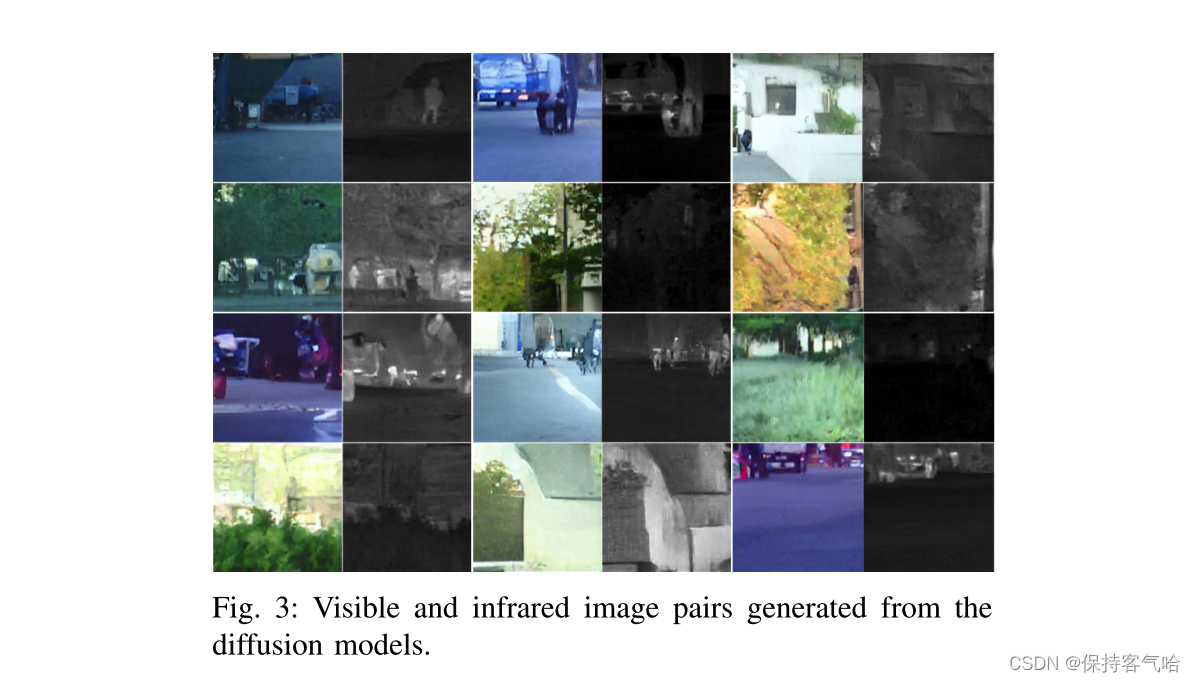

图3显示了我们训练的扩散模型生成的一些配对的可见和红外图像。这些图像对在视觉上类似于真实的可见和红外图像。在对应的红外图像中突出显示的目标也看起来合理。这些结果表明,扩散模型是构建多通道数据分布的强大工具。

3.2 Fusion with Multi-channel Diffusion Features

在训练完去噪网络后,我们使用该去噪网络来提取多通道特征。在图像融合训练阶段,我们使用两种损失(即多通道梯度损失和多通道强度损失)进行训练。值得注意的是,通过使用多通道损失,可以直接生成三通道融合图像,无需进行颜色空间转换。

1)多通道扩散特征:对于SR3主干,其扩张路径包含五个卷积层,其输出特征图的大小分别为W/16 H/16,W/8 H/8,W/4 H/4,W/2 H/2 和 WH。我们使用一个多通道融合模块来融合来自去噪网络的5个阶段的多通道扩散特征。对于这五个扩张层的五个阶段特征,我们将它们相加并将其送入融合头,生成融合图像$ I_f ∈ R^{HW3}$。具体来说,我们采用3×3卷积层将高维度的融合特征映射为3通道输出。Leaky ReLU和Tanh被用作激活函数。去噪网络和多通道融合模块的结构如图4所示。

2)融合过程的损失函数:由于可见图像具有丰富的纹理信息,为了在最终融合图像中保留足够的纹理信息,我们应用了梯度损失来保持梯度的准确性。然而,现有的梯度损失是针对单通道融合图像设计的。为了在保持梯度的同时直接生成三通道融合图像,我们扩展了现有的梯度损失并提出了多通道梯度损失 L M C G L_{MCG} LMCG,其可以表示为: L M C G = 1 H W ∑ i = 1 3 ∣ ∣ ∇ I i f − max ( ∇ ∣ I i r ∣ , ∇ ∣ I i v i s ∣ ) ∣ ∣ L_{MCG} = \frac{1}{HW} \sum_{i=1}^{3} || \nabla I_{i_{f}} - \max(\nabla |I_{i_{r}}| , \nabla |I_{i_{vis}}| )|| LMCG=HW1i=1∑3∣∣∇Iif−max(∇∣Iir∣,∇∣Iivis∣)∣∣

这里,∇表示梯度算子。 I f 1 、 I f 2 和 I f 3 I^1_f、I^2_f和I^3_f If1、If2和If3代表融合图像If的三个通道(即红色、绿色和蓝色)。 I v i s 1 、 I v i s 2 和 I v i s 3 I^1_{vis}、I^2_{vis}和I^3_{vis} Ivis1、Ivis2和Ivis3表示输入可见图像 I v i s I_{vis} Ivis的三个通道。热辐射通常由像素强度来表征。我们应用强度损失,使得融合图像具有类似红外图像和可见图像的强度分布。然而,类似于梯度损失,现有的强度损失是为生成单通道融合图像而设计的。我们将现有的强度损失扩展为多通道强度损失 L M C I L_{MCI} LMCI,其可以表示为: L M C I = 1 H W ∑ i = 1 3 ( ∣ I i f ∣ − max ( I i r , I i v i s ) ) L_{MCI} = \frac{1}{HW} \sum_{i=1}^{3} \left( |I_{i_{f}}| - \max(I_{i_{r}}, I_{i_{vis}}) \right) LMCI=HW1i=1∑3(∣Iif∣−max(Iir,Iivis))

现有的融合方法通常通过颜色空间转换来保留颜色信息。为了解决这个问题并充分利用扩散特征,本文直接通过使用多通道梯度和强度损失来生成三通道融合图像。最终的损失函数 L f L_f Lf可以表示为: L f = L M C G + L M C I L_f = L_{MCG} + L_{MCI} Lf=LMCG+LMCI