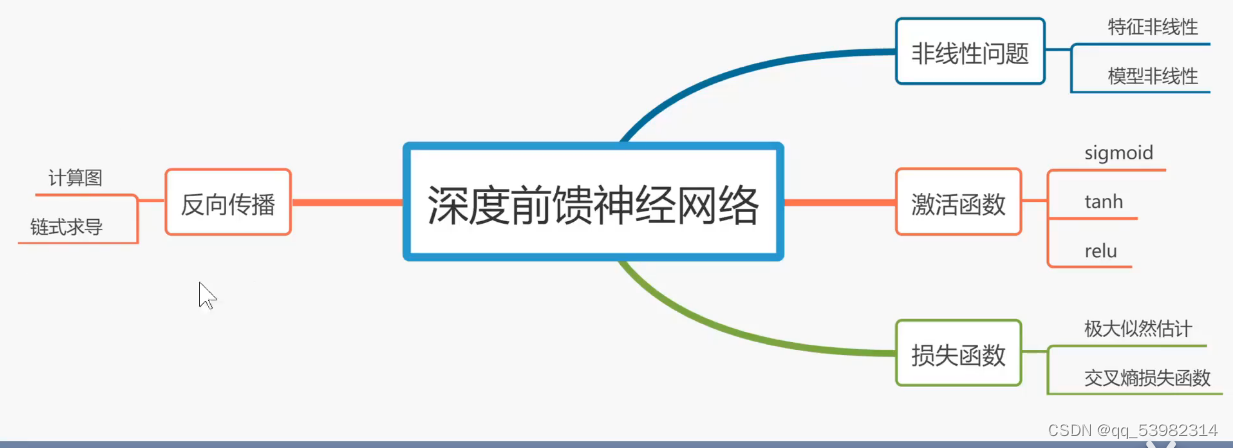

深度学习和机器学习

深度学习是一种机器学习。深度学习使用深度神经网络,这些网络由多个神经网络层组成,每个层都包含许多神经元。深度神经网络的层数和参数量通常很大,使其能够处理更复杂的任务和大规模数据。

- 传统机器学习通常需要手工设计特征,即从原始数据中提取有用的特征,并将其作为输入进行学习和预测。

- 深度学习的一个关键特点是能够自动学习特征表示。通过层层堆叠的神经网络,深度学习模型可以从原始数据中学习高级的特征表示,无需手动定义特征。

数据决定了模型的上限,预处理和特征提取是核心。

深度学习解决了如何去提取特征的问题。

一.神经网络

从输入 -》到输出的映射 f(x,W) 。w是权重参数。

f(x,W)=Wx+b ,训练改变w,使损失函数L的值最小。

神经网络为什么能解决非线性问题?

使用了非线性的激活函数。例如tanh。

1.激活函数

最常见的激活函数有

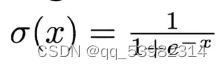

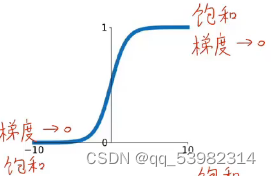

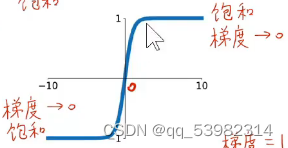

-

sigmoid

也叫做挤压函数。一般用于二分类,但是饱和时,梯度会消失;优化时间消耗大。 -

tanh

-

relu

max(0,x)

优化快,收敛快。但是当x<0时无法学习。常用。 -

leaky relu

max(0.1x,x)

非常的常用。解决了relu的问题。 -

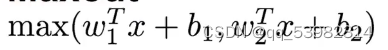

maxout

-

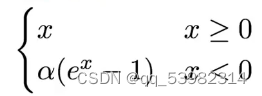

elu

2.前馈神经网络