原创 | 文 BFT机器人

腾讯混元大模型“霸气”亮相

9月7号,在深圳举行的2023腾讯全球数字生态大会上,腾讯混元大模型正式亮相,并宣布通过腾讯云对外开放。腾讯混元大模型是由腾讯全链路自研的通用大语言模型,拥有超千亿参数规模,预训练语料超2万亿tokens,具备强大的中文创作能力,复杂语境下的逻辑推理能力,以及可靠的任务执行能力。

面对“百模大战”的市场环境,混元突胜关键在哪

腾讯集团副总裁蒋杰说:“腾讯的策略:第一是从中文领域做攻克,让大模型具备更强的中文创作能力,完善服务中国企业时的本土化能力;第二是在复杂推理过程中,增强对大模型安全的管控能力。”

值得关注的是,混元大模型虽然现阶段还处在成熟度和对复杂任务处理的能力还不够,属于在完善中的初级模型。即使混元模型还不够成熟,但是混元还是能在众多国外研发模型中具有突胜点,这在于混元模型主攻中文领域,服务国内大部分的企业,对于在众多外国英文模型的对比下,国内企业为了更加方便与提高效率,加上对国家技术的认同感,都会选择混元。

混元的“天罗地网”已覆盖腾讯50多个产业

腾讯混元大模型是“从实践中来,到实践中去”的实用级大模型。腾讯云、腾讯广告、腾讯游戏、腾讯金融科技、腾讯会议、腾讯文档、微信搜一搜、QQ浏览器等超过50个腾讯业务和产品,已经接入腾讯混元大模型测试,并取得初步效果。

据腾讯集团副总裁汤道生表示,千行百业也可以通过API调用混元,或者将混元作为基底模型,为不同产业场景构建大模型应用。为此,腾讯已经和1万1千家生态伙伴展开紧密合作,推出了覆盖100多个产业场景的行业解决方案。

从零到一,坚持全链路技术自研

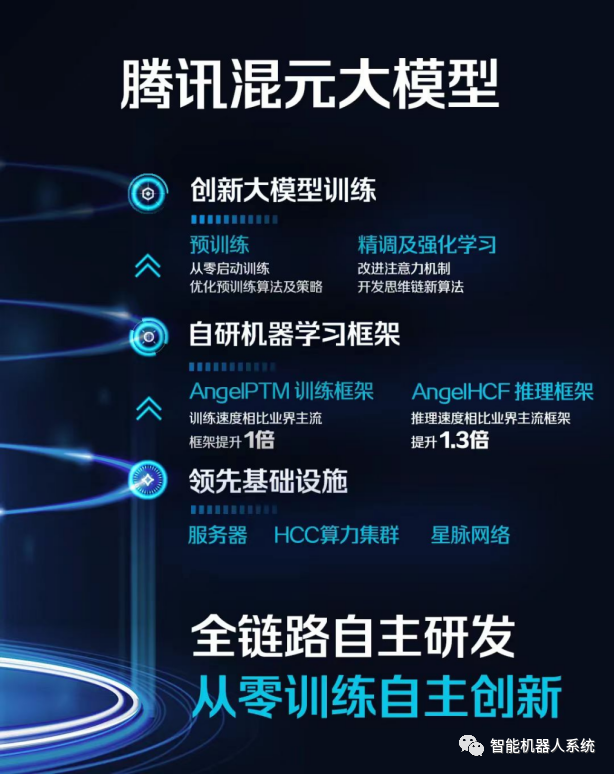

据了解,腾讯混元大模型是从第一个token开始就从零开始训练,掌握了从模型算法到机器学习框架,再到AI基础设施的全链路自研技术。

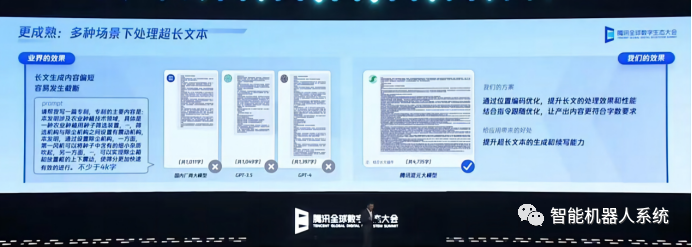

对此腾讯副总裁蒋杰总结了混元大模型的三大特点:具备强大的中文创作能力、复杂语境下的逻辑推理能力以及可靠的任务执行能力。在过去以及现今,众多大模型不论在性能还是算法上都有局限性,且多数用于一些简单的场景,还不能满足对于复杂的场景的应变能力里。例如:在文档处理方面,腾讯混元大模型支持数十种文本创作场景,在腾讯文档推出的智能助手功能中已有应用。同时,混元还能够一键生成标准格式文本,精通数百种Excel公式,支持自然语言生成函数,并基于表格内容生成图表。而chatGOT4连4000字的文档内容都不能很好的满足。

蒋杰表示:“腾讯坚持自研技术是因为,如果企业不从头开始做自研的话,就缺乏对这个技术的完全掌握。腾讯大模型的自研,能够加速后续的迭代,加快与其他业务的深度结合和绑定。对于腾讯那么多海量高并发的业务来说,开源架构无法应对冲击,对腾讯来说是并不合适的。所以我们一定要走出一条基于自主体系的研发道路。”至此腾讯走出了一条适合自己发展的康庄大道。另外蒋杰还表示,腾讯的自研机器学习框架Angel让训练速度相比业界主流框架提升1倍,推理速度比业界主流框架提升1.3倍。

对于腾讯混元大模型的降世,开启属于在中国大模型发展模式的新时代,这是值得肯定与支持的。另外腾讯云已经全面接入Llama 2、Bloom等20多个主流模型,并支持直接部署调用。客户可以根据实际需求,既可以基于混元大模型,也可以基于开源模型,打造自己的行业大模型。

作者 | 春花

排版 | 春花

审核 | 橙橙

若您对该文章内容有任何疑问,请与我们联系,将及时回应。想要了解更多资讯,请关注BFT智能机器人系统~