这个问题很简单,并不是没有使用softmax,而是没有显式使用softmax。

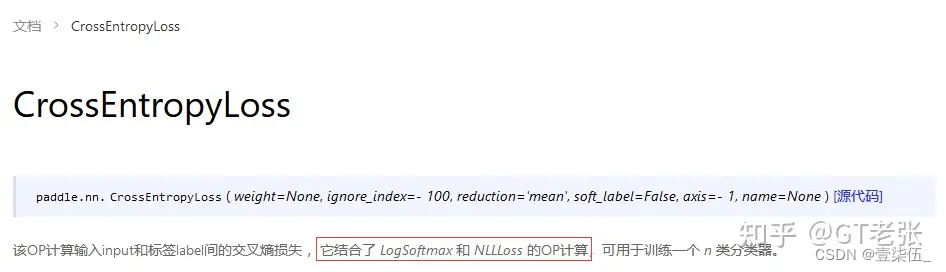

随着深度学习框架的发展,为了更好的性能,部分框架选择了在使用交叉熵损失函数时默认加上softmax,这样无论你的输出层是什么,只要用了nn.CrossEntropyLoss就默认加上了softmax。不仅是Pytorch,国内的飞桨PaddlePaddle2.0等框架也是这样。但在更早的一些版本,默认是不隐式添加softmax的,所以会有一部分教程/资料,要求在撰写对应代码时手动添加softmax。当然,自己的框架是否需要手动在输出层添加softmax,推荐看对应的API文档。道听途说不一定可取,毕竟一个softmax可以做分类,俩softmax搞不好就不收敛了