集成学习(Emsemble Learning)–融合学习

分类和回归的延续和升华

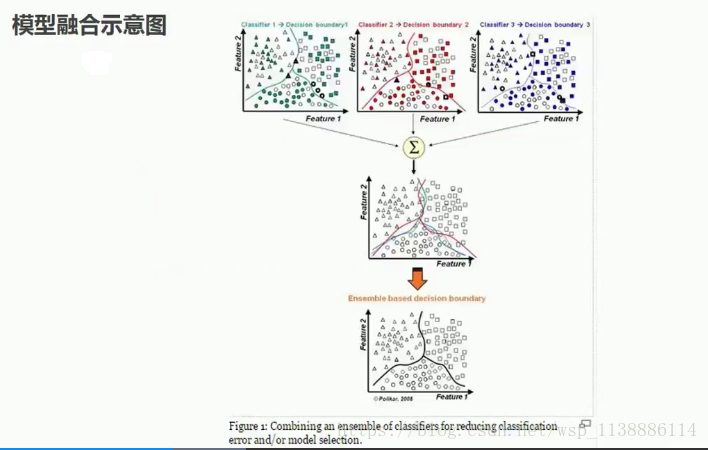

使用一系列学习器进行学习,把各个学习结果进行融合,

从而获得比单个学习器更好的学习效果的一种机器学习方法。

1. 模型融合

单个模型容易发生过拟合,多个模型提高泛化能力(提升预测能力)

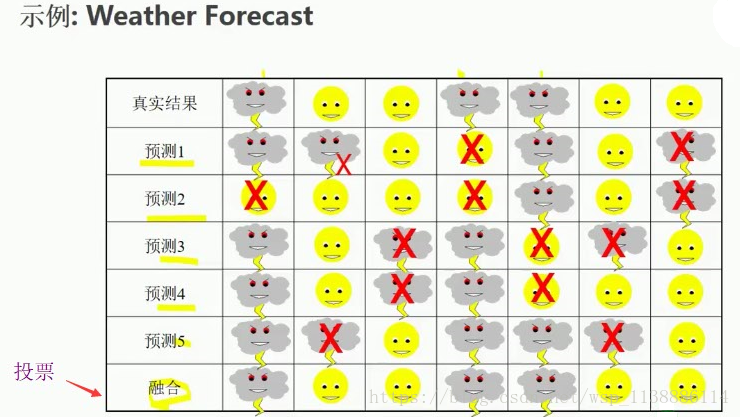

2. Voting 和 Averaging 融合

Voting: 投票法 --针对分类问题

硬投票(hard):基于分类标签投票

软投票(soft):基于分类标签概率投票

代码:

sklearn.ensemble.VotingClassifier(

estimators,

voting = 'hard',

weights = None,

flatten_transform = None

)

一些重要的参数:

estimators: list if (string,estimators)tuples 需要融合的多个分类器

voting: str,{'hard','soft'}(default = 'hard') 投票方式

weights: array-like,shape = [n_classifiers],optional(default = 'None') 是否加权Averaging: 平均法 --针对回归问题

简单平均

加权平均

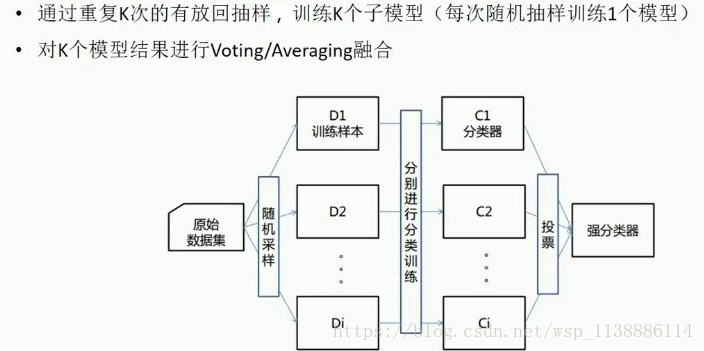

3. Bagging 融合—并行训练

有放回K次取样--并行训练(K个子模型)分类器--投票/平均--强分类器

优点:多个分类器噪声控制好,结果具有稳定性。

不易出现过拟合现象---是一种减少方差(variance)

Bagging 融合典型代表算法--随机深林算法

4. Boosting 融合—-串行(迭代)训练

每次训练都关心上次分类错误的样例--给分类错误的样例更大的权重

---下一次训练识别上一次的错误

---最终将多次迭代训练得到的弱分类器进行加权相加得到最终的强分类器

优点:多个分类器噪声控制好,结果具有稳定性。

不易出现过拟合现象---是一种减少篇差(bias)

Boosting 融合典型代表算法--Adaboost

GBDT(Gradient Boosting Decision Tree)

XGBoost