2023年6月25日 Jina AI 发布了 JinaChat,一个面向开发者和终端用户的多模态大模型API。传统大型语言模型往往将竞争力建立在「参数多」和「刷分强」的基础上,然而对于应用开发者来说,传统模型商的 API 并不能很好地让开发者低成本的实现解决方案。结果就产生了AIGC时代的悖论:人人都是开发者,结果开发者一分钱没赚到,模型 API 服务商赚个盆满钵满。那么今天就让我们看看JinaChat是如何破局的。

传统大模型的陷阱:西西弗斯式的循环

在实际生产环境中使用大模型时,通常我们会采用长提示词、小样本提示词(Few-shot prompt)、思维链(Chain of thoughts)或 AutoGPT 来完成复杂的任务。但这些能力需要引入大量上下文窗口,囿于昂贵的 token 计费机制。我们首先面临的障碍便是其高昂的成本。

使用 ChatGPT 提问单个问题(zero-shot)通常需要耗费 100 ~ 200 个 token。特别而在聊天机器人,客服等连续对话场景中,为了保持上下文记忆,传统的大模型API要求开发者每次都要追加发送历史消息,直到上下文窗口被填满。对于开发者来说,token的花销大部分支付在了历史消息上。

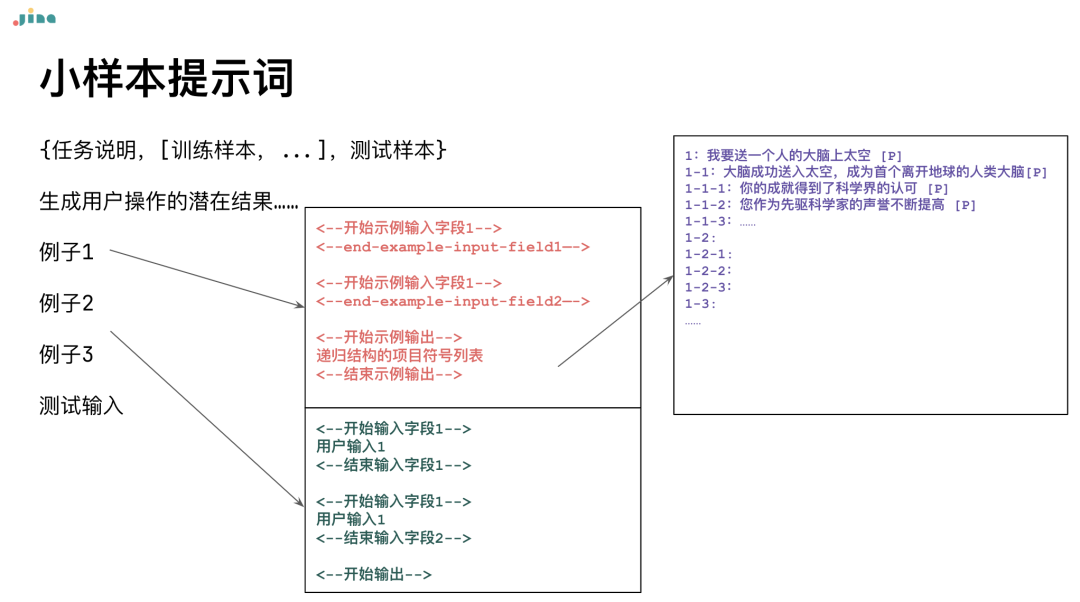

小样本提示词(few shot prompt)是大模型中常用的高级提示词策略,它由 {任务说明,[多个训练样本,...],测试样本} 组成,从而诱导大模型给出更好的答案。其中“任务说明”和“多个训练样本”这两部分基本是固定成本,在使用小样本提示词时,真正的变量在于测试样本。然而,传统的大模型API要求开发者每次在构建小样本决策时都必须发送包含训练样本的完整的提示词才能“激活”模型的上下文学习能力。也就是说每次决策中90%的成本浪费在了重复性的提示词上,真正用在刀刃上的不到实际开销的10%。

接下来就是更烧钱的 AutoGPT。曾有人说过,AutoGPT 爆火的背后 OpenAI 数钱数到麻。这是因为 AutoGPT中每一个任务需要通过思维链(chain of thoughts)来完成:为了提供最佳的推理,每一步推理都会引入之前的思维链,这就会消耗更多的 token,在 AutGPT 发布不久我们就曾详细计算过,使用 AutoGPT 一项简单的的任务成本高达 102 元。

肖涵,公众号:Jina AI Jina AI 创始人肖涵博士:揭秘 Auto-GPT 喧嚣背后的残酷真相

看似引领未来的小样本提示词和 AutoGPT,从成本角度来看,对大部分用户和组织来说,都显得遥不可及。

开发者的福音:低成本长记忆的JinaChat

“对方 token 多贵?”

“10 美分”

“我们 token 多贵?”

“5 美分” “给我减,减到零,开局再送多模态!“

上面这段对话可能来自是大家最近常刷到的游戏广告。也是我们 JinaChat 的源动力之一:一个针对长 prompt 优化后的大模型API,让开发者守住自己的钱袋子。

和同类大模型相比的费用优势

传统的大模型API无法保存和追溯对话历史,而 JinaChat允许开发者通过 chatId 调取之前的每次对话历史,使得大模型的 API 从 stateless 变成了 stateful,从而保持了长 Prompt的记忆。更重要的是,开发者每次只需要支付增量部分的花销,而无需对记忆做重复付费,极大的降低的开发者的使用成本。

举个例子,如果你设计一个复杂的 Agent,需要根据历史对话信息做出决策。用传统大模型 API,你需要每次发送包括 Agent、CoT、记忆体等的全部内容,相当于每次都从山脚下开始爬。

而有了 JinaChat,你只需发送增量信息,之前的对话会被模型记住,你只需要指定 chatId,就像游戏读档一样,从已有的高度开始继续攀爬,无需重复支付的成本。

你甚至可以在 API 中继续图形界面的聊天记录。

除了可以使用 chatId 来实现“读档”, JinaChat 的单条请求价格也相当便宜。以标准订阅为例,对于少于 300 个 token 的短消息,完全免费,这满足了大部分简单日常沟通需求。至于超过 300 个 token,无论消息有多长,都是一口价 0.56 元。如果开发者能够有效结合 chatId,在首次使用长 prompt 构建历史信息和训练样本,而在后期可以只发送增量 prompt,从而把成本压缩到300 token内,极大的降低了复杂LLM应用的开发成本。

超越文本,引领多模态交互新时代

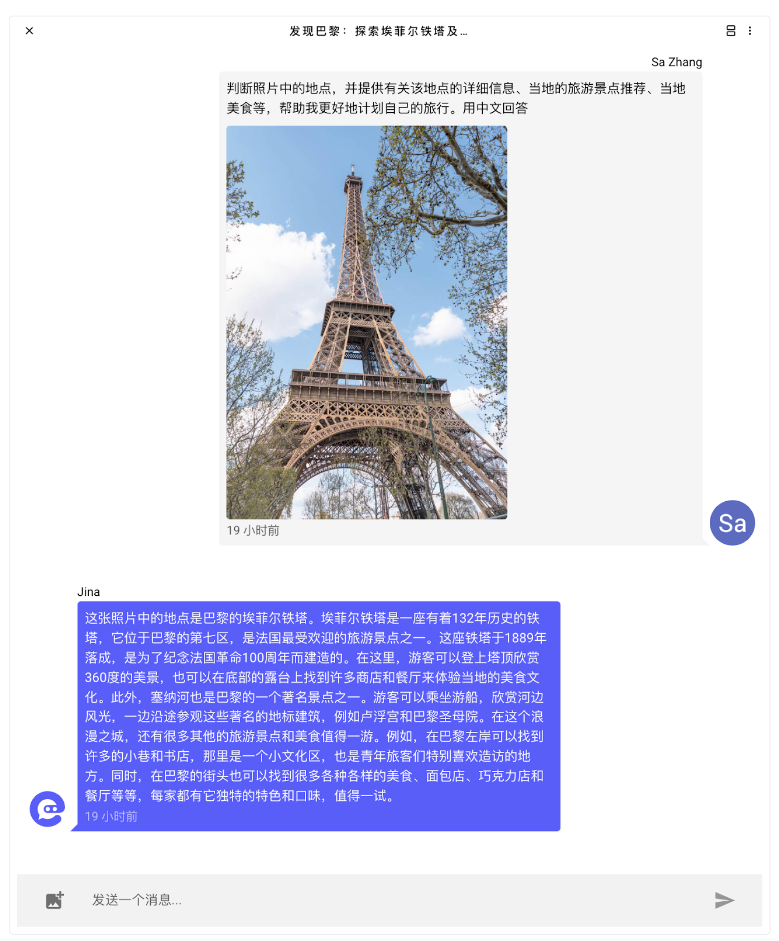

“开局送神装” 在6月26号发布的 JinaChat 0.1 版本中,用户不仅可以通过文本交互在一个类似 ChatGPT 的界面中与 JinaChat 交互,更可以通过上传图片实现图聊。JinaChat 将图像交互作为一项重要功能加以支持。它能够调用 SceneXplain 实现对图像解析和内容理解。

举例来说,当你发送一张旅行照片时,JinaChat 能通过图像识别技术判断照片中的地点,并提供相关信息,如旅游景点推荐、当地美食等,从而帮助你更好地规划旅行。

结合 JinaChat 的持续记忆能力,对于长篇对话和多轮互动的复杂查询,你会发现,JinaChat 的性价比是市面上最具竞争力的。其他解决方案无法与之比拟,可以说“过了这个村就没这个店了。”

再如,你发送一张汽车图片,JinaChat 能识别汽车的品类,并给出汽车的品牌型号、亮点等信息,深度的图像交互能够带给全新的体验。

这种多模态交互不仅提供了更丰富的用户和开发者体验,还为跨领域的应用开辟了广阔的可能性。

往深层次看,通过 JinaChat,大型语言模型的能力可以得到真正的应用。基于 JinaChat 的强大能力,开发者们可以轻松地构建具有多层次对话结构、支持多模态输入的复杂 LLM 应用。

API 无缝集成,拓宽开发者视野

JinaChat 的 API 与 OpenAI 的聊天 API 完全兼容,另外,还增加了图像交互、对话恢复等功能,使其在交互性方面更胜一筹。开发者可以轻易地将其替换成 JinaChat API,实现更加丰富和多样化的用户体验,满足不同应用场景的需求。

import os

import openai

openai.api_type = "openai"

openai.api_base = "https://api.chat.jina.ai/v1"

openai.api_version = None

openai.api_key = os.getenv("JINA_CHAT_API_KEY")

response = openai.ChatCompletion.create(

messages=[{'role': 'user', 'content': 'Tell me a joke'}],

)

print(response)

这就是 JinaChat,一个更低成本、更多模态的造福开发者的大规模语言模型服务。

无论你需要 AI 对话助手,还是开发复杂的 LLM 应用,JinaChat 都能为你提供功能强大又经济实惠的体验。

如果你也希望自己的应用更互动、更智能,那么 JinaChat 将是你的首选。未来,JinaChat 将不断升级,以智能对话增强用户体验,让我们的交流方式更加多元。

现在就输入 JCFIRSTCN,即刻享受首月免费体验!

点击 chat.jina.ai,立刻加入我们,探索更多可能性吧!国内用户首次访问时会被导向chat.jinaai.cn 域名以适配国内网络环境。另外 iOS 手机用户请使用 Safari 或者在电脑端打开链接。