之前跟着教程学写Unity3D的shader,回过头来看看,都忘了前面写了什么了,马上就要秋招了,一遍复习,写点零散的知识点总结吧。

原文https://catlikecoding.com/unity/tutorials/rendering/

译文http://gad.qq.com/program/translateview/7173930

另外推荐一个入门文章

猫都能学会的Unity3D Shader入门指南(一):https://onevcat.com/2013/07/shader-tutorial-1

第二章 着色器基础

1概念

Unity中编写Shader的语言叫做ShaderLab,而ShaderLab说白了就是裹着一层皮的CG着色器语言而已。Cg,即C forgraphics,即用于图形的C语言,是微软Microsoft和英伟达NVIDIA相互协作在标准硬件光照语言的语法和语义上达成的一种一致性协议。

HLSL和CG其实是同一种语言(参见Cg教程_可编程实时图形权威指南29页的致谢部分)。很多时候,我们会发现用HLSL写的代码可以直接当中Cg代码使用。

Microsoft和NVIDIA联手推出CG语言,想在经济和技术上实现双赢,从而通过这种方式联手打击他们共同的对手GLSL。

既然Unity主打Shader编程的语言ShaderLab是CG语言披上一层皮,而CG语言又约等于HLSL。这就是说,在Unity中写Shader约等于用HLSL写Shader,也就约等于给DirectX写Shader。虽然有点绕orz,最后总结一下也就是:

在Unity中写Shader约等于给DirectX写Shader

2.Unityshader中的基本类型

1.固定功能着色器(Fixed Function Shader)

这里的固定功能着色器可以说是Unity为Shader的书写自带的一层壳,Unity已经在内部为我们做了大量的工作,我们只要稍微记住一些关键字、一些规范就可以实现出很多不错的效果。固定功能着色器是我们初学Unity Shader的最近几篇文章中的主要学习对象。而后面的表面着色器、顶点着色器以及片段着色器就是在固定功能着色器的基础上嵌套了CG语言的代码而成的更加复杂的着色器。我们来看看他们的一些基本概念。

2.表面着色器(Surface Shader)

表面着色器(Surface Shader)这个概念更多的只是在Unity中听说,可以说是Unity自己发扬光大的一项使Shader的书写门槛降低和更易用的技术。我们会在接下来的学习中逐渐意识到Unity是如何为我们把Shader的复杂性包装起来,使其书写的过程更便捷和易用的。

3.顶点着色器&片段着色器 (Vertex Shader & Fragment Shader)

顶点着色器:产生纹理坐标,颜色,点大小,雾坐标,然后把它们传递给裁剪阶段。

片段着色器:进行纹理查找,决定什么时候执行纹理查找,是否进行纹理查找,及把什么作为纹理坐标

顾名思义,其中的固定功能着色器便是我们所说的固定功能渲染管线(fixed-functionrendering pipelines)的具体表现,而表面着色器、顶点着色器以及片段着色器便属于可编程渲染管线。下面分别对其进行简单的介绍。

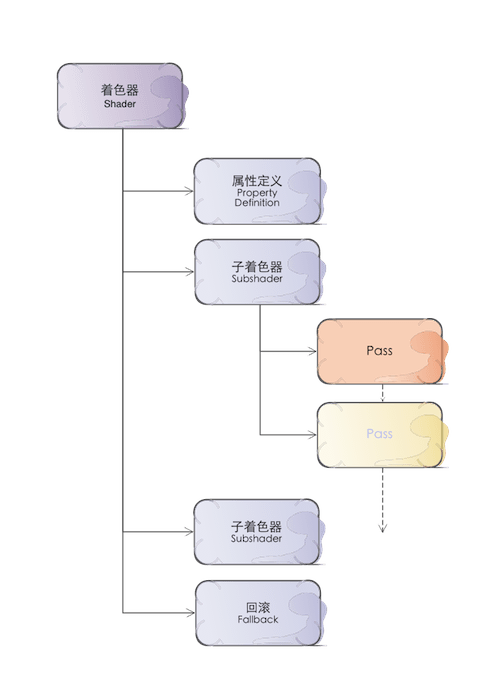

Shader程序的基本结构

一个简单的shader

// Upgrade NOTE: replaced 'mul(UNITY_MATRIX_MVP,*)' with 'UnityObjectToClipPos(*)'

Shader "Custom/My First Shader" {

Properties {

_Tint ("Tint", Color) = (1, 1, 1, 1)

_MainTex ("Texture", 2D) = "white" {}

}

SubShader {

Pass {

CGPROGRAM

#pragma vertex MyVertexProgram

#pragma fragment MyFragmentProgram

#include "UnityCG.cginc"

float4 _Tint;

sampler2D _MainTex;

float4 _MainTex_ST;

struct VertexData {

float4 position : POSITION;

float2 uv : TEXCOORD0;

};

struct Interpolators {

float4 position : SV_POSITION;

float2 uv : TEXCOORD0;

};

Interpolators MyVertexProgram (VertexData v) {

Interpolators i;

i.position = UnityObjectToClipPos(v.position);

i.uv = TRANSFORM_TEX(v.uv, _MainTex);

return i;

}

float4 MyFragmentProgram (Interpolators i) : SV_TARGET {

return tex2D(_MainTex, i.uv) * _Tint;

}

ENDCG

}

}

}

属性

在Properties{}中定义着色器属性,在这里定义的属性将被作为输入提供给所有的子着色器。每一条属性的定义的语法是这样的:

_Name("Display Name", type) = defaultValue[{options}]

- _Name - 属性的名字,简单说就是变量名,在之后整个Shader代码中将使用这个名字来获取该属性的内容

- Display Name - 这个字符串将显示在Unity的材质编辑器中作为Shader的使用者可读的内容

- type - 这个属性的类型,可能的type所表示的内容有以下几种:

- Color - 一种颜色,由RGBA(红绿蓝和透明度)四个量来定义;

- 2D - 一张2的阶数大小(256,512之类)的贴图。这张贴图将在采样后被转为对应基于模型UV的每个像素的颜色,最终被显示出来;

- Rect - 一个非2阶数大小的贴图;

- Cube - 即Cube map texture(立方体纹理),简单说就是6张有联系的2D贴图的组合,主要用来做反射效果(比如天空盒和动态反射),也会被转换为对应点的采样;

- Range(min, max) - 一个介于最小值和最大值之间的浮点数,一般用来当作调整Shader某些特性的参数(比如透明度渲染的截止值可以是从0至1的值等);

- Float - 任意一个浮点数;

- Vector - 一个四维数;

- defaultValue 定义了这个属性的默认值,通过输入一个符合格式的默认值来指定对应属性的初始值(某些效果可能需要某些特定的参数值来达到需要的效果,虽然这些值可以在之后在进行调整,但是如果默认就指定为想要的值的话就省去了一个个调整的时间,方便很多)。

- Color - 以0~1定义的rgba颜色,比如(1,1,1,1);

- 2D/Rect/Cube - 对于贴图来说,默认值可以为一个代表默认tint颜色的字符串,可以是空字符串或者"white","black","gray","bump"中的一个

- Float,Range - 某个指定的浮点数

- Vector - 一个4维数,写为 (x,y,z,w)

- 另外还有一个{option},它只对2D,Rect或者Cube贴图有关,在写输入时我们最少要在贴图之后写一对什么都不含的空白的{},当我们需要打开特定选项时可以把其写在这对花括号内。如果需要同时打开多个选项,可以使用空白分隔。可能的选择有ObjectLinear, EyeLinear, SphereMap, CubeReflect, CubeNormal中的一个,这些都是OpenGL中TexGen的模式,具体的留到后面有机会再说。

所以,一组属性的申明看起来也许会是这个样子的

//Define a color with a default value of semi-transparent blue("Main Color", Color) = (0,0,1,0.5)

//Define a texture with a default of white("Texture", 2D) = "white" {}

现在看懂上面那段Shader(以及其他所有Shader)的Properties部分应该不会有任何问题了。接下来就是SubShader部分了。

Tags

表面着色器可以被若干的标签(tags)所修饰,而硬件将通过判定这些标签来决定什么时候调用该着色器。比如我们的例子中SubShader的第一句

Tags { "RenderType"="Opaque" }

告诉了系统应该在渲染非透明物体时调用我们。Unity定义了一些列这样的渲染过程,与RenderType是Opaque相对应的显而易见的是"RenderType" = "Transparent",表示渲染含有透明效果的物体时调用。在这里Tags其实暗示了你的Shader输出的是什么,如果输出中都是非透明物体,那写在Opaque里;如果想渲染透明或者半透明的像素,那应该写在Transparent中。

另外比较有用的标签还有"IgnoreProjector"="True"(不被Projectors影响),"ForceNoShadowCasting"="True"(从不产生阴影)以及"Queue"="xxx"(指定渲染顺序队列)。这里想要着重说一下的是Queue这个标签,如果你使用Unity做过一些透明和不透明物体的混合的话,很可能已经遇到过不透明物体无法呈现在透明物体之后的情况。这种情况很可能是由于Shader的渲染顺序不正确导致的。Queue指定了物体的渲染顺序,预定义的Queue有:

- Background - 最早被调用的渲染,用来渲染天空盒或者背景

- Geometry - 这是默认值,用来渲染非透明物体(普通情况下,场景中的绝大多数物体应该是非透明的)

- AlphaTest - 用来渲染经过Alpha Test的像素,单独为AlphaTest设定一个Queue是出于对效率的考虑

- Transparent - 以从后往前的顺序渲染透明物体

- Overlay - 用来渲染叠加的效果,是渲染的最后阶段(比如镜头光晕等特效)

这些预定义的值本质上是一组定义整数,Background = 1000, Geometry = 2000, AlphaTest = 2450, Transparent = 3000,最后Overlay = 4000。在我们实际设置Queue值时,不仅能使用上面的几个预定义值,我们也可以指定自己的Queue值,写成类似这样:"Queue"="Transparent+100",表示一个在Transparent之后100的Queue上进行调用。通过调整Queue值,我们可以确保某些物体一定在另一些物体之前或者之后渲染,这个技巧有时候很有用处。

LOD

LOD很简单,它是Level of Detail的缩写,在这里例子里我们指定了其为200(其实这是Unity的内建Diffuse着色器的设定值)。这个数值决定了我们能用什么样的Shader。在Unity的Quality Settings中我们可以设定允许的最大LOD,当设定的LOD小于SubShader所指定的LOD时,这个SubShader将不可用。Unity内建Shader定义了一组LOD的数值,我们在实现自己的Shader的时候可以将其作为参考来设定自己的LOD数值,这样在之后调整根据设备图形性能来调整画质时可以进行比较精确的控制。

- VertexLit及其系列 = 100

- Decal, Reflective VertexLit = 150

- Diffuse = 200

- Diffuse Detail, Reflective Bumped Unlit, Reflective Bumped VertexLit = 250

- Bumped, Specular = 300

- Bumped Specular = 400

- Parallax = 500

- Parallax Specular = 600