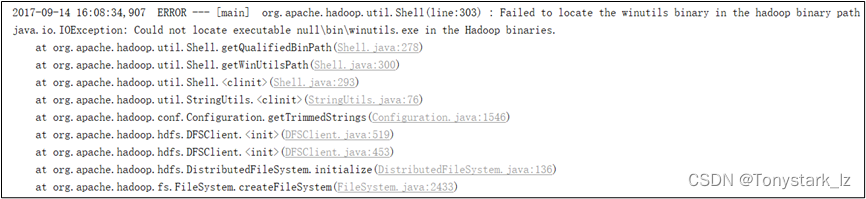

如果在程序中使用了Hadoop相关的东西,比如写入文件到HDFS,则会遇到如下异常:

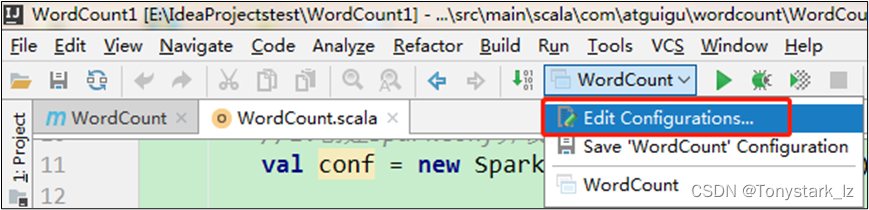

出现这个问题的原因,并不是程序的错误,而是用到了Hadoop相关的服务,解决办法:

配置HADOOP_HOME环境变量

如果出现这个问题,是因为windows上面的hadoop权限不够。

Exception in thread "main" java.lang.UnsatisfiedLinkError: org.apache.hadoop.io.nativeio.NativeIO$Windows.access0(Ljava/lang/String;I)Z

at org.apache.hadoop.io.nativeio.NativeIO$Windows.access0(Native Method)

at org.apache.hadoop.io.nativeio.NativeIO$Windows.access(NativeIO.java:645)

at org.apache.hadoop.fs.FileUtil.canRead(FileUtil.java:1230)

at org.apache.hadoop.fs.FileUtil.list(FileUtil.java:1435)

at org.apache.hadoop.fs.RawLocalFileSystem.listStatus(RawLocalFileSystem.java:493)

at org.apache.hadoop.fs.FileSystem.listStatus(FileSystem.java:1868)

at org.apache.hadoop.fs.FileSystem.listStatus(FileSystem.java:1910)

at org.apache.hadoop.fs.FileSystem$4.<init>(FileSystem.java:2072)

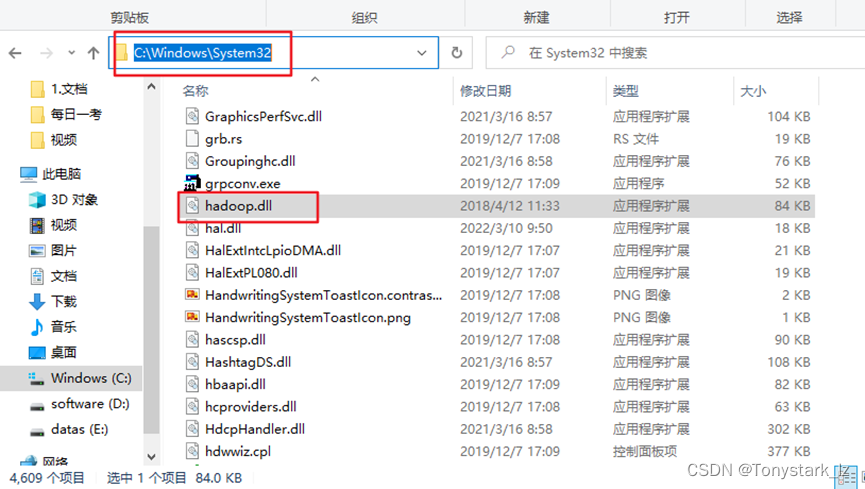

解决方法是把安装在windows上面的hadoop的bin文件夹中的hadoop.dll复制到C:\Windows\System32文件夹中

如果依然出现这个问题,是因为本地没有C++的依赖库