点击下方卡片,关注“CVer”公众号

AI/CV重磅干货,第一时间送达

转载自:机器之心 | 编辑:小舟

LLM 的能力还可以发挥到机器学习的更多子领域。

当前,大型语言模型(LLM)已经掀起自然语言处理(NLP)领域的变革浪潮。我们看到 LLM 具备强大的涌现能力,在复杂的语言理解任务、生成任务乃至推理任务上都表现优异。这启发人们进一步探索 LLM 在机器学习另一子领域 —— 计算机视觉(CV)方面的潜力。

LLM 的一项卓越才能是它们具备上下文学习的能力。上下文学习不会更新 LLM 的任何参数,却在各种 NLP 任务中却展现出了令人惊艳的成果。那么,GPT 能否通过上下文学习解决视觉任务呢?

最近,来自谷歌和卡内基梅隆大学(CMU)的研究者联合发表的一篇论文表明:只要我们能够将图像(或其他非语言模态)转化为 LLM 能够理解的语言,这似乎是可行的。

SPAE: Semantic Pyramid AutoEncoder for Multimodal Generation with Frozen LLMs

代码:https://github.com/google-research/magvit/

论文地址:https://arxiv.org/abs/2306.17842

这篇论文揭示了 PaLM 或 GPT 在通过上下文学习解决视觉任务方面的能力,并提出了新方法 SPAE(Semantic Pyramid AutoEncoder)。这种新方法使得 LLM 能够执行图像生成任务,而无需进行任何参数更新。这也是使用上下文学习使得 LLM 生成图像内容的首个成功方法。

我们先来看一下通过上下文学习,LLM 在生成图像内容方面的实验效果。

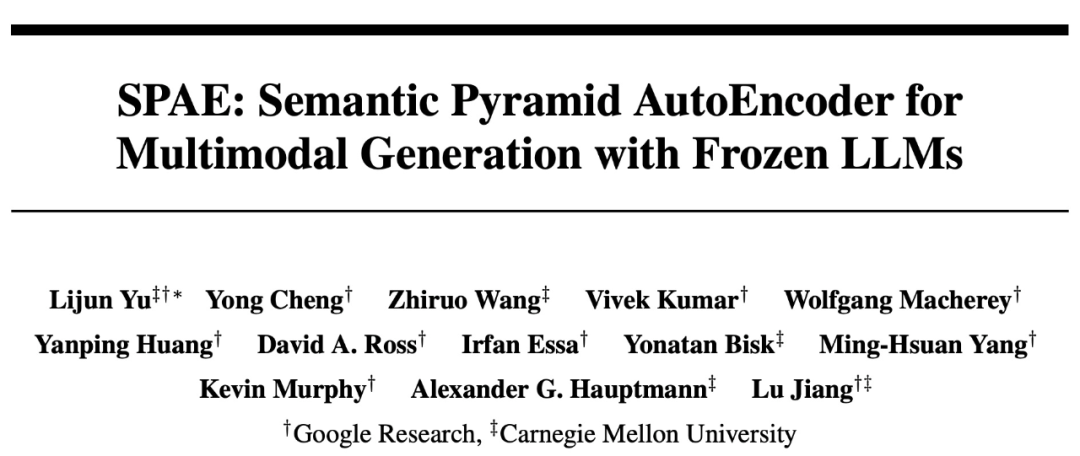

例如,在给定上下文中,通过提供 50 张手写图像,论文要求 PaLM 2 回答需要生成数字图像作为输出的复杂查询:

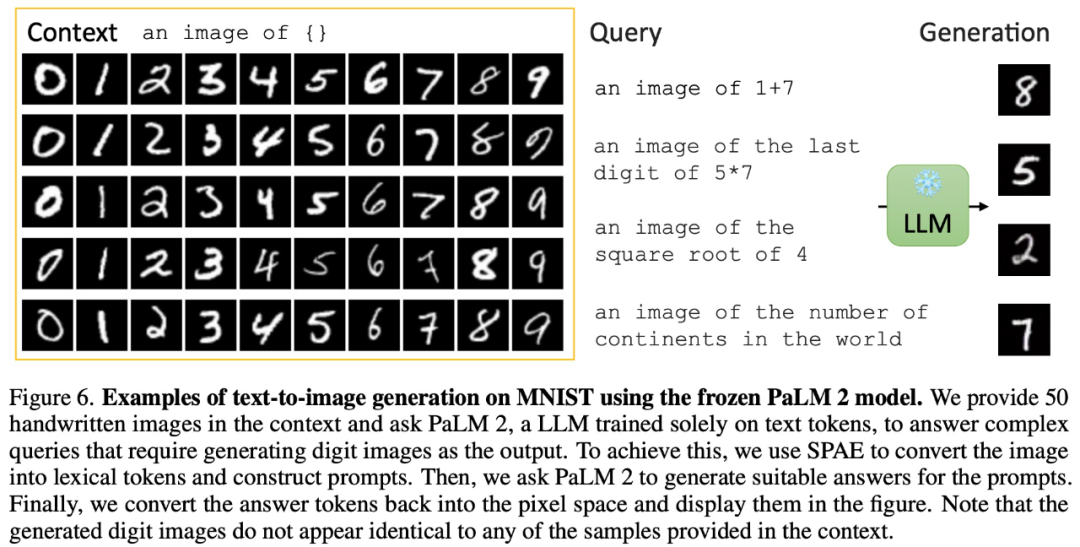

还能在有图像上下文输入的情况下生成逼真的现实图像:

除了生成图像,通过上下文学习,PaLM 2 还能进行图像描述:

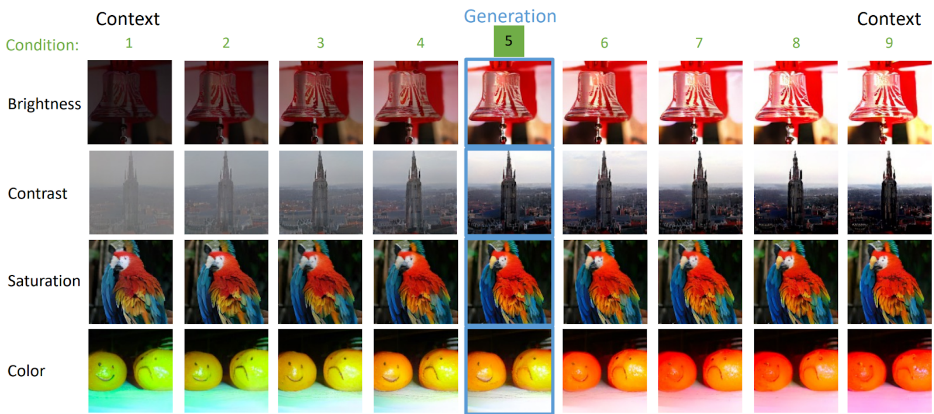

还有与图像相关问题的视觉问答:

甚至可以去噪生成视频:

方法概述

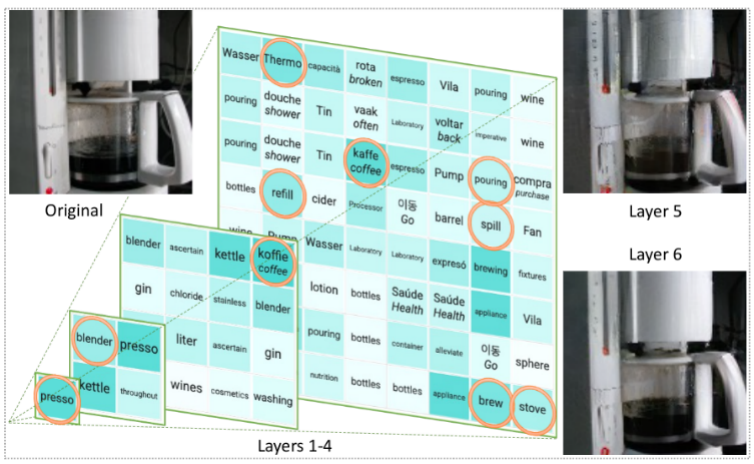

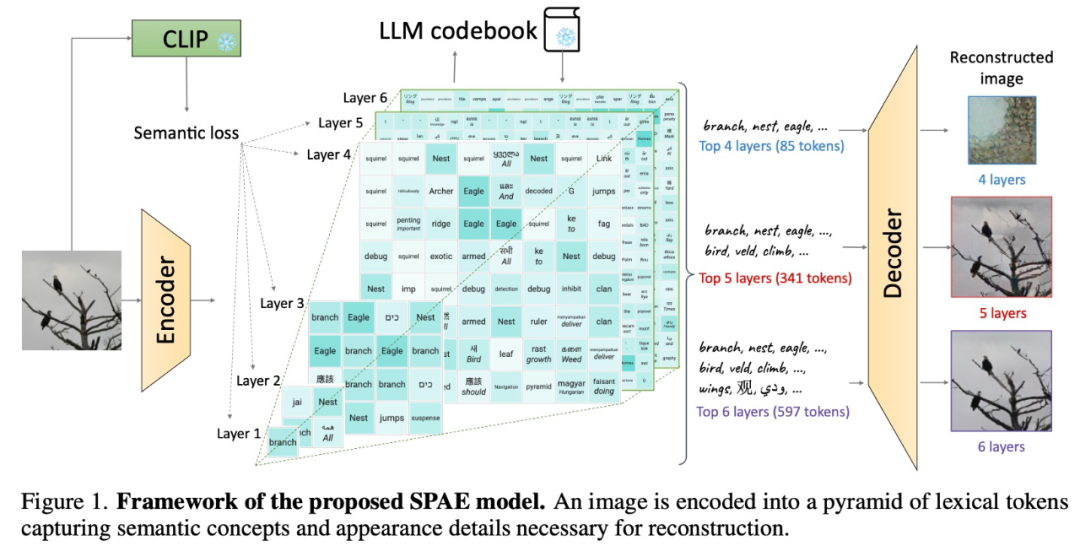

实际上,将图像转化为 LLM 能够理解的语言,是在视觉 Transformer(ViT)论文中就已经研究过的问题。在 Google 和 CMU 的这篇论文中,他们将其提升到了一个新的层次 —— 使用实际的单词来表示图像。

这种方法就像建造一个充满文字的塔楼,捕捉图像的语义和细节。这种充满文字的表示方法让图像描述可以轻松生成,并让 LLM 可以回答与图像相关的问题,甚至可以重构图像像素。

具体来说,该研究提出使用经过训练的编码器和 CLIP 模型将图像转换为一个 token 空间;然后利用 LLM 生成合适的词法 token;最后使用训练有素的解码器将这些 token 转换回像素空间。这个巧妙的过程将图像转换为 LLM 可以理解的语言,使我们能够利用 LLM 在视觉任务中的生成能力。

实验及结果

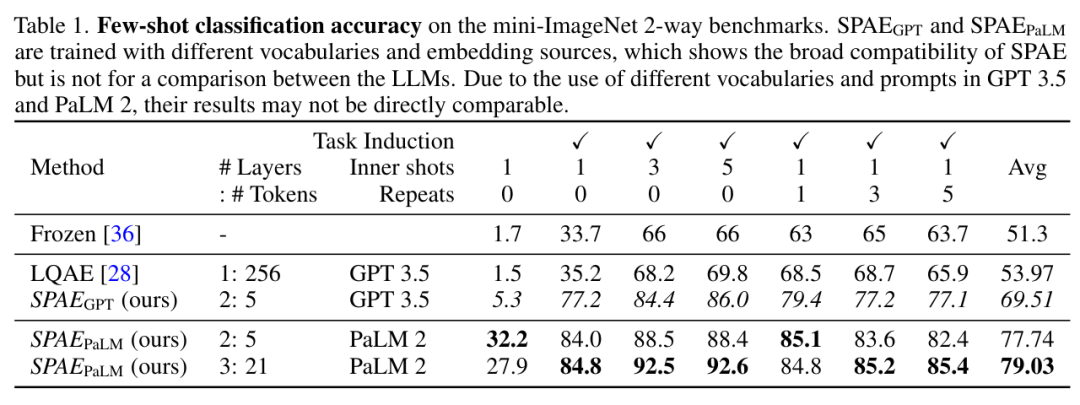

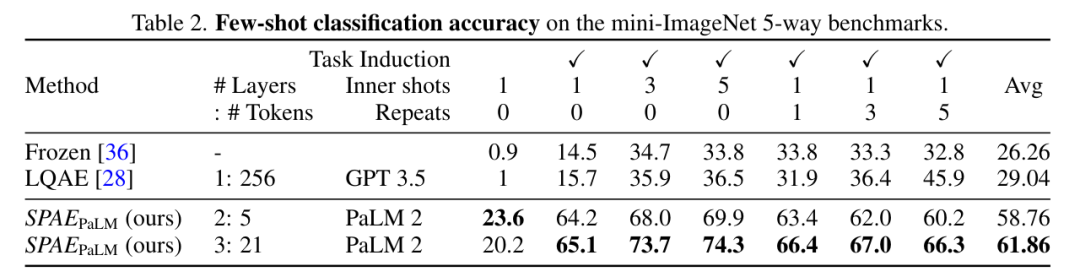

该研究将 SPAE 与 SOTA 方法 Frozen 和 LQAE 进行了实验比较,结果如下表 1 所示。SPAEGPT 在所有任务上性能均优于 LQAE,且仅使用 2% 的 token。

总的来说,在 mini-ImageNet 基准上的测试表明,SPAE 方法相比之前的 SOTA 方法提升了 25% 的性能。

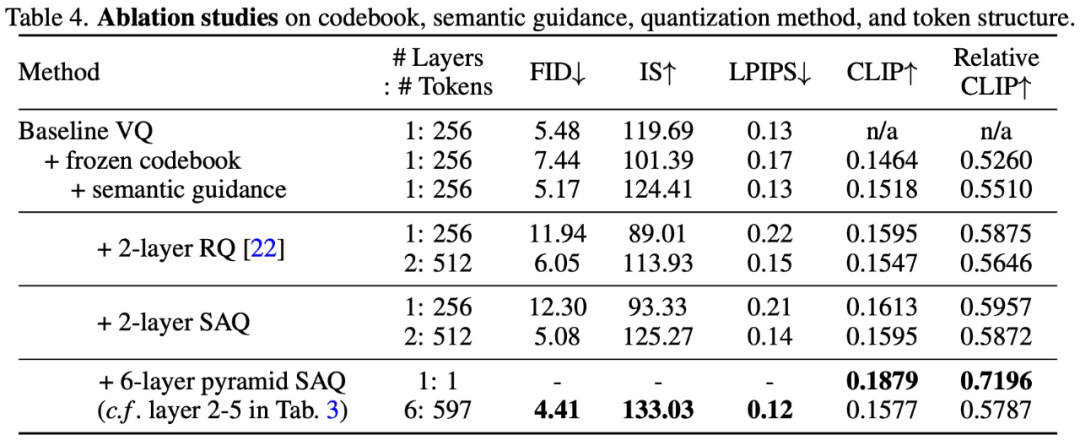

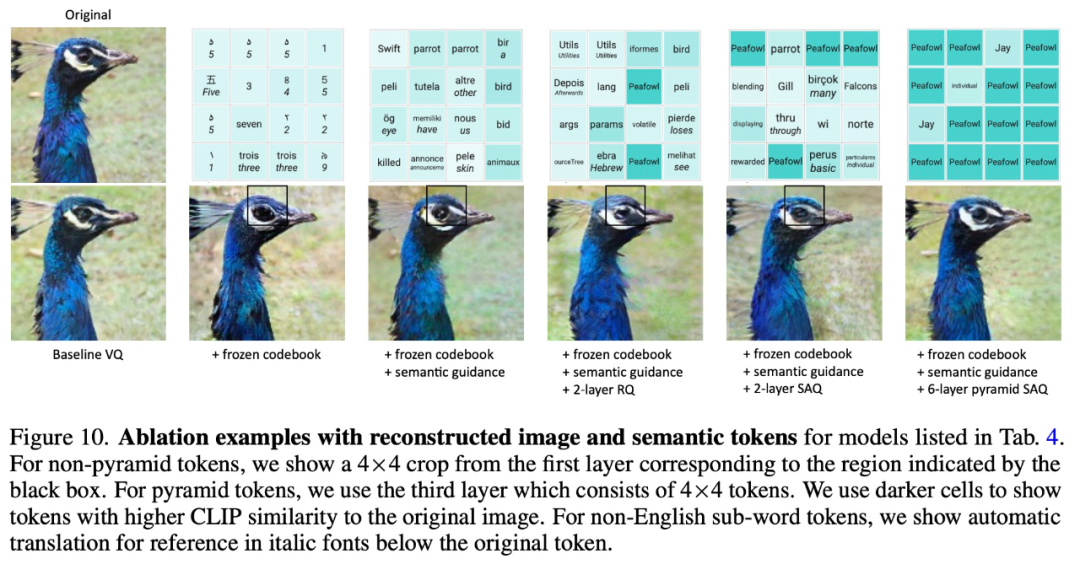

为了验证 SPAE 设计方法的有效性,该研究进行了消融实验,实验结果如下表 4 和图 10 所示:

感兴趣的读者可以阅读论文原文,了解更多研究内容。

最新CVPR 2023论文和代码下载

后台回复:CVPR2023,即可下载CVPR 2023论文和代码开源的论文合集

后台回复:Transformer综述,即可下载最新的3篇Transformer综述PDF

多模态和Transformer交流群成立

扫描下方二维码,或者添加微信:CVer333,即可添加CVer小助手微信,便可申请加入CVer-多模态或者Transformer 微信交流群。另外其他垂直方向已涵盖:目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测、模型剪枝&压缩、去噪、去雾、去雨、风格迁移、遥感图像、行为识别、视频理解、图像融合、图像检索、论文投稿&交流、PyTorch、TensorFlow和Transformer等。

一定要备注:研究方向+地点+学校/公司+昵称(如多模态或者Transformer+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群

▲扫码或加微信号: CVer333,进交流群

CVer计算机视觉(知识星球)来了!想要了解最新最快最好的CV/DL/AI论文速递、优质实战项目、AI行业前沿、从入门到精通学习教程等资料,欢迎扫描下方二维码,加入CVer计算机视觉,已汇集数千人!

▲扫码进星球

▲点击上方卡片,关注CVer公众号整理不易,请点赞和在看![]()