注1:本文系“简要介绍”系列之一,仅从概念上对基于深度学习的姿态估计技术进行非常简要的介绍,不适合用于深入和详细的了解。

注2:"简要介绍"系列的所有创作均使用了AIGC工具辅助

基于深度学习的姿态估计技术

背景介绍

姿态估计 是计算机视觉领域的一个重要研究方向,它主要关注如何从图像或视频中提取人体的三维姿态信息。随着深度学习技术的快速发展,基于深度学习的姿态估计方法在近年来取得了显著的进展。本文将对这一领域的背景、原理、研究现状、挑战和未来展望进行详细介绍。

原理介绍与推导

1. 姿态估计基本概念

-

关节点检测:姿态估计的第一步是检测人体的关键点,如头、肩、手腕等。这些关键点可以用二维坐标表示,如 ( x , y ) (x, y) (x,y)。

-

骨架表示:姿态估计的第二步是根据关键点的位置构建人体的骨架模型,以表达人体的姿态。

2. 深度学习模型

基于深度学习的姿态估计方法主要依赖卷积神经网络(CNN)来检测关键点。其中,Hourglass网络 和 Stacked Hourglass网络 是两个具有代表性的深度学习模型。

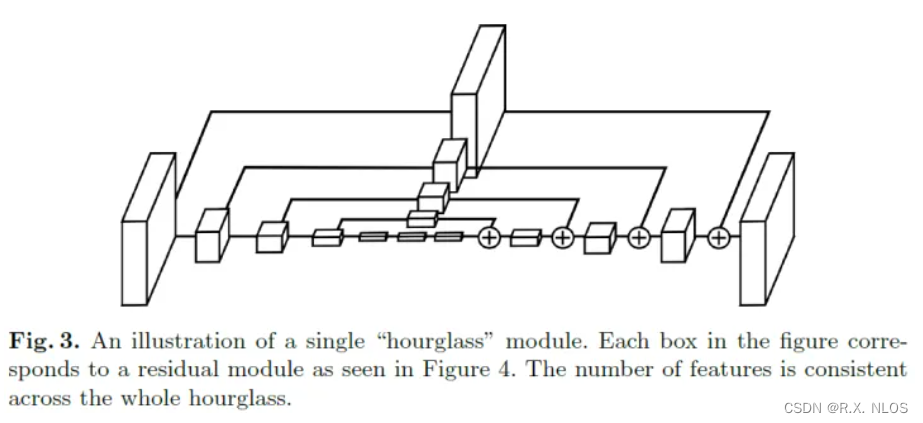

2.1 Hourglass网络

Hourglass网络具有对称的编码器-解码器结构,通过多尺度信息处理和跳跃连接来提高关键点检测的精度。Hourglass网络的基本结构如下图所示:

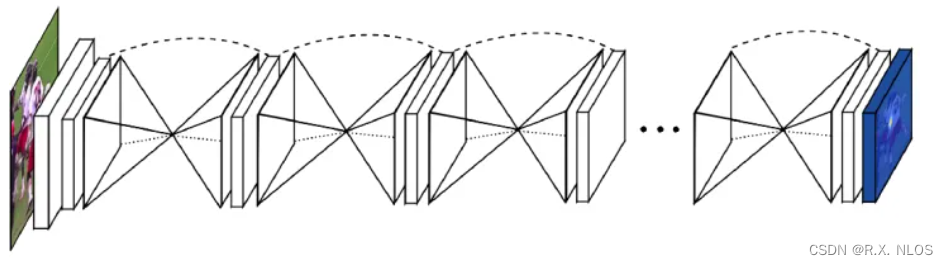

2.2 Stacked Hourglass网络

Stacked Hourglass网络是一种多级Hourglass网络的结构,通过堆叠多个Hourglass网络来实现更精确的关键点检测。Stacked Hourglass网络的基本结构如下图所示:

研究现状

近年来,基于深度学习的姿态估计技术在各种应用中取得了显著的成果,如虚拟现实、增强现实、人机交互、运动分析、医学影像等。这一领域的研究现状可以从以下几个方面进行介绍:

1. 数据集

为了训练和评估姿态估计模型,研究者们构建了许多具有挑战性的数据集,如 MPII Human Pose Dataset、COCO Keypoint Challenge 和 LSP Dataset 等。

2. 姿态估计方法

基于深度学习的姿态估计方法可以分为两大类:自顶向下方法 和 自底向上方法。

-

自顶向下方法:先检测图像中的所有人体,然后对每个人体进行关键点检测。这类方法的优点是可以针对每个人体单独进行姿态估计,但同时也需要更多的计算资源。

-

自底向上方法:先检测图像中的所有关键点,然后根据关键点之间的关系将它们组合成人体姿态。这类方法的优点是可以在关键点检测阶段就并行处理多个人体,从而降低计算复杂度。

3. 评价指标

在姿态估计领域,常用的评价指标包括:

-

平均精度(Average Precision,AP)和平均召回率(Average Recall,AR):这两个指标通常用于评价目标检测算法。在姿态估计中,可以将每个关键点视为一个目标,然后计算AP和AR。具体来说,对于每个关键点,可以计算其预测的置信度(confidence score)和与真实关键点之间的距离,然后根据置信度对所有关键点进行排序,最后根据不同的阈值计算AP和AR。AP和AR的计算方法比较复杂,可以参考目标检测领域的相关文献进行学习。

-

PCK(Percentage of Correct Keypoints):PCK指标是衡量预测关键点与真实关键点之间距离是否小于一定阈值的百分比。通常情况下,阈值取头部尺寸的一定比例,即PCKh指标。假设 d i d_i di表示预测关键点 i i i与真实关键点之间的距离, s s s表示头部尺寸的一半,则PCKh计算公式为:

P C K h = 1 n ∑ i = 1 n [ d i ≤ α s ] PCKh = \frac{1}{n}\sum_{i=1}^{n}[d_i \leq \alpha s] PCKh=n1i=1∑n[di≤αs]

其中, α \alpha α是一个预定义的常数,通常取0.5。PCKh指标的计算比较简单,但它只考虑了预测关键点与真实关键点之间的距离,而没有考虑它们之间的相对位置关系。

- PCK3D(Percentage of Correct Keypoints in 3D):PCK3D指标是PCK指标的扩展,考虑了预测关键点与真实关键点在三维空间中的距离。假设 d i d_i di表示预测关键点 i i i与真实关键点之间的欧氏距离, s s s表示头部尺寸的一半,则PCK3D计算公式为:

P C K 3 D = 1 n ∑ i = 1 n [ d i ≤ α s ] PCK3D = \frac{1}{n}\sum_{i=1}^{n}[d_i \leq \alpha s] PCK3D=n1i=1∑n[di≤αs]

与PCKh指标类似,PCK3D指标也只考虑了预测关键点与真实关键点之间的距离,而没有考虑它们之间的相对位置关系。

- MPJPE(Mean Per Joint Position Error):MPJPE指标是评价预测关键点与真实关键点之间平均欧氏距离的指标。具体来说,假设 p i p_{i} pi表示预测关键点 i i i的位置, q i q_{i} qi表示真实关键点 i i i的位置,则MPJPE计算公式为:

M P J P E = 1 n ∑ i = 1 n ∣ ∣ p i − q i ∣ ∣ MPJPE = \frac{1}{n}\sum_{i=1}^{n}||p_i - q_i|| MPJPE=n1i=1∑n∣∣pi−qi∣∣

MPJPE指标比较直观,但对于不同关键点之间的重要性没有进行区分,可能会忽略某些关键点的重要性。

除了上述指标,还有一些基于人体姿态相似性的评价指标,如PCK-Skeleton和PCK-Object,这些指标可以更加直观地反映姿态估计模型的性能。

挑战

尽管基于深度学习的姿态估计技术已经取得了显著的进展,但仍然面临着以下挑战:

- 遮挡:当人体的一部分被遮挡时,关键点检测和姿态估计的准确性可能会受到影响。

- 姿态多样性:人体姿态的多样性是一个巨大的挑战,需要姿态估计模型具有很高的泛化能力。

- 实时性:为了满足实际应用的需求,姿态估计模型需要在较短的时间内完成关键点检测和姿态估计,这对模型的计算效率提出了很高的要求。