决策树–泰坦尼克号乘客生存预测–baseline

项目介绍:使用决策树模型对泰坦尼克号乘客生存预测,此项目为建立一个简单的baseline模型,对机器学习一整个流程进行梳理,以便掌握机器学习的流程框架。

数据来源:kaggle数据集上的tannic数据集,感兴趣的可以去下载下来实操练习

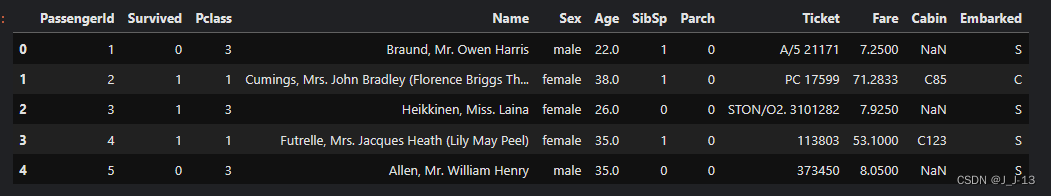

数据介绍:

| 字段名称 | 解释说明 |

|---|---|

| PassengerId | 乘客ID |

| Pclass | 乘客等级 |

| Name | 乘客姓名 |

| Sex | 性别 |

| Age | 年龄 |

| SibSp | 堂兄妹个数 |

| Parch | 父母与小孩个数 |

| Fare | 票价 |

| Cabin | 客舱 |

| Embarked | 登船港口 |

项目流程

- 获取数据集

- 数据基本处理

- 查看数据集

- 获取特征值,目标值

- 缺失值,异常值处理

- 数据集划分 - 特征工程 字典特征抽取

- 机器学习 决策树模型训练

- 模型预测与评估

- 导入需要模块

import pandas as pd

import numpy as np

from sklearn.feature_extraction import DictVectorizer #字典抽取模块

from sklearn.model_selection import train_test_split#数据集划分

from sklearn.tree import DecisionTreeClassifier,export_graphviz#决策树

- 获取并查看数据

df = pd.read_csv('../input/titanic/train.csv')

df.head()

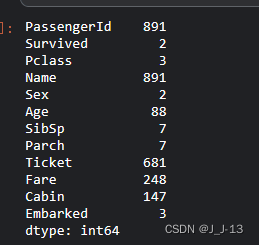

3. 查看各列指标值分布情况

df.nunique()#查看各列值的分布情况

发现乘客id与名字均是891条,生存情况为2种情况,pclass乘客等级有3种,说明有三种不同的乘客等级,性别分布为2种,正常

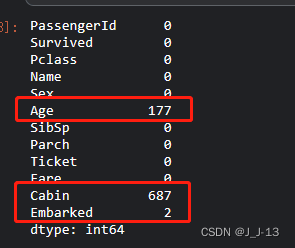

- 查看缺失值情况

df.isnull().sum()#查看缺失值

通过查看发现,Age列存在177个缺失值,考虑填补的方法。而Cabin列有687个缺失值,该列存在大量缺失,无实际参考意义,直接删除该列数据,Embarked存在2个缺失值,可直接填补

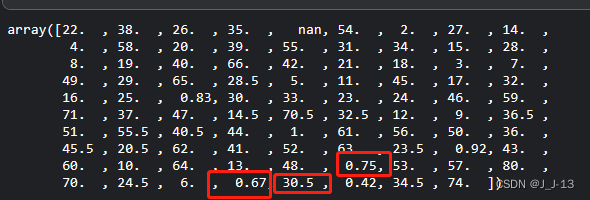

- 异常值查看

df['Age'].unique() #发现年龄一列存在异常值,为小于0的小数

通过查看发现,年龄一列数据里面存在大量的小于1的数值,这显然不符合实际,我们需要对其进行删除处理。同时也将缺失值过多的Cabin列进行删除

df = df[df['Age']>=1]#取年龄大于1的正常数据

df1 = df.drop('Cabin',axis =1) #删除缺失值过多的列

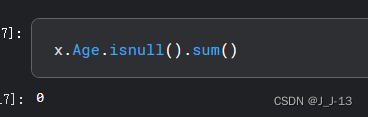

将年龄一列和Cabin一列数据进行筛选删除后,我们再次对其进行缺失值查看,发现此时已无缺失值。

- 获取特征值与目标值

数据集中包含了PassengerId、Survived、Pclass 、Age等在内的12个指标数据,其中Survived为乘客是否生存的指标依据,0为否,1表示生存,是我们需要的目标值。而其余11个指标是否都会对目标值有很大的影响呢?在本次项目,我们猜测,其中Pclass乘客等级、Age年龄、Sex性别会对是否生存产生较大的影响。因为不同的乘客等级可能会存在优先级待遇,年轻力壮的小伙子可能更容易逃生又或者尊老爱幼,女士优先,让他们先逃亡。所以本次项目选取Pclass乘客等级、Age年龄、Sex性别为特征值进行训练。

# 确定特征值,目标值

x = df1[['Pclass','Age','Sex']]

y = df1['Survived']

- 数据集划分

#数据集划分,训练集与测试集八二分

x_train,x_test,y_train,y_test = train_test_split(x,y,random_state=22,test_size=0.2)

- 特征抽取

由于原始数据的值Sex性别的取值为male和femal,并不是我们计算机所识别的数值型数据,所以需要对其进行特征抽取,转换成计算机所能识别的形式,在此我们使用DictVectorizer进行字典特征抽取

#特征工程 字典特征抽取

# 1.先转换为字典

x_train =x_train.to_dict(orient = 'records')

x_test = x_test.to_dict(orient = 'records')

#2. 特征抽取

transfer = DictVectorizer()

x_train = transfer.fit_transform(x_train)

x_test = transfer.fit_transform(x_test)

- 机器学习

完成特征工程处理后,我们就进入到模型训练阶段,在此我们选用机器学习中的决策树模型进行训练

#机器学习

clf = DecisionTreeClassifier()

clf.fit(x_train,y_train)

- 模型评估

y_pre = clf.predict(x_test)

y_pre

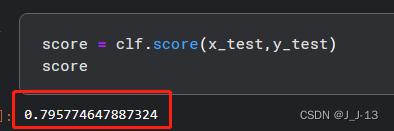

score = clf.score(x_test,y_test)

score

最后在验证集中进行验证,进行评估得分,发现准确率在0.795左右,作为一个baseline的话还行

总结

基于决策树模型预测泰坦尼克号乘客生存的案例到此结束了。在本次案例中,包括了数据的读取,数据查看、数据预处理(缺失值处理、异常值处理)、特征工程、模型训练、模型评估一整个机器学习流程。适合刚学习机器学习的朋友快速上手机器学习。

然而本次的预测准确率仅在0.795左右,仅仅只能当一个baseline使用,还存在很多不足。

- 例如只选取了三列作为特征值,没有考虑其他特征,事实上其他特征也可能有着很大的影响

- 特征工程部分过于粗糙,仅仅是进行特征数值化,没有深度挖掘特征间的联系

- 决策树模型过于粗糙,没有传入任何的超参数,以及参数调优

感兴趣的朋友们可以再次对数据集进行深入挖掘,采取更为复杂的模型和处理方式,进行预测,提升预测精度。