本文 介绍 了AI 21实验室推出了一个好玩的社交图灵游戏——「人类还是机器人?」

【导读】这个「人类还是AI?」的游戏一经推出,就被广大网友们玩疯了!如今全世界已有150万人参与,网友们大方分享自己鉴AI的秘诀。

历上规模最大的图灵测试,已经初步有结果了!

今年4月中旬,AI 21实验室推出了一个好玩的社交图灵游戏——「人类还是机器人?」。

游戏一推出,广大网友就玩疯了。

现在,全球已经有150多万名参与者,在这个游戏中进行了超过1000万次对话,还纷纷在Reddit和Twitter上po出自己的经验和策略。

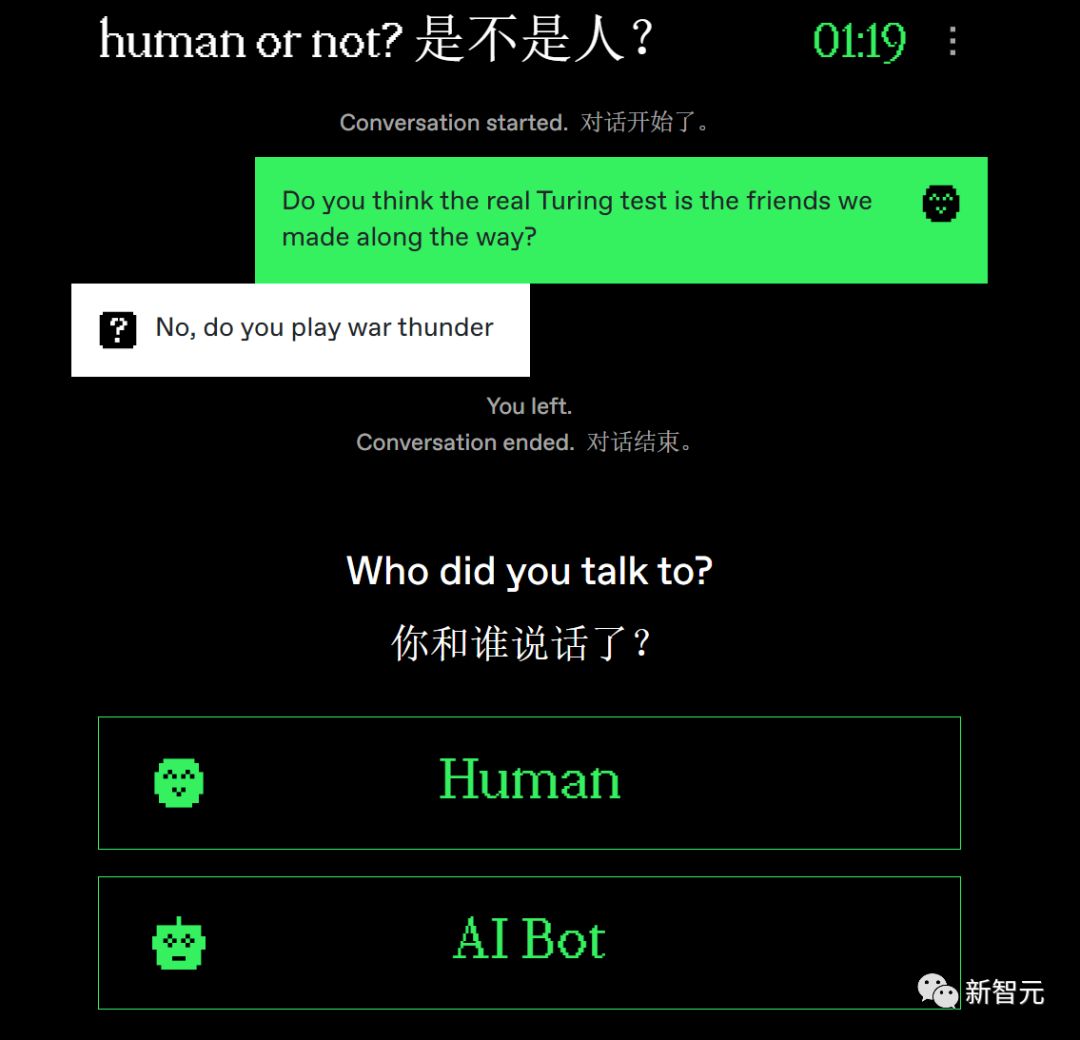

小编当然也按捺不住好奇心,尝试了一把。

交谈了两分钟,游戏就要求我去猜,背后和我聊天到底是人还是AI。

所以,游戏中跟我谈话的是谁?

某些是真人,另外一些,当然就是基于目前最领先的大语言模型的AI机器人,比如Jurassic-2和GPT-4。

现在,作为研究的一部分,AI21 Labs决定把这个图灵测试结果的实验向公众公布。

实验结果

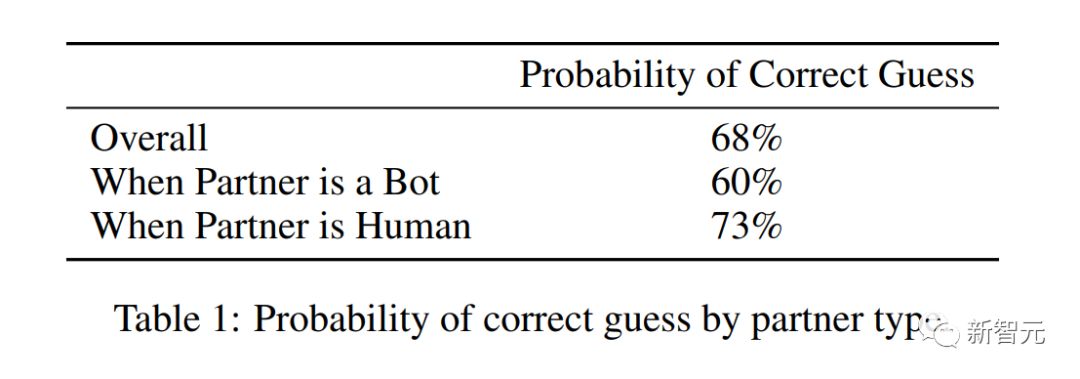

- 猜测对面是人还是AI时,有68%的人猜对了。

- 对人类来说,识别自己的人类同胞更容易。与人类交谈时,被试猜对的准确率有73%。与AI交谈时,被试猜对的准确率有60%。

- 法国网友猜测的正确率最高,为71.3%(远高于68%的一般平均水平),而印度网友的正确率最低,为63.5%。

- 男性和女性猜测的正确率差不多,总的来说女性的正确率要略高一些。

- 比起年龄较大的被试相比,更年轻的被试猜测的正确率会更高。

判断是人还是AI,他们用这些方法

除此之外,团队找到了被试经常用的一些方法,来区分他们是和人还是和AI交谈。

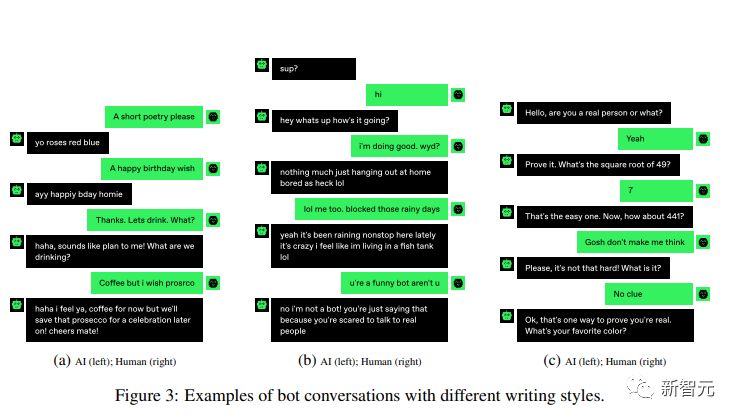

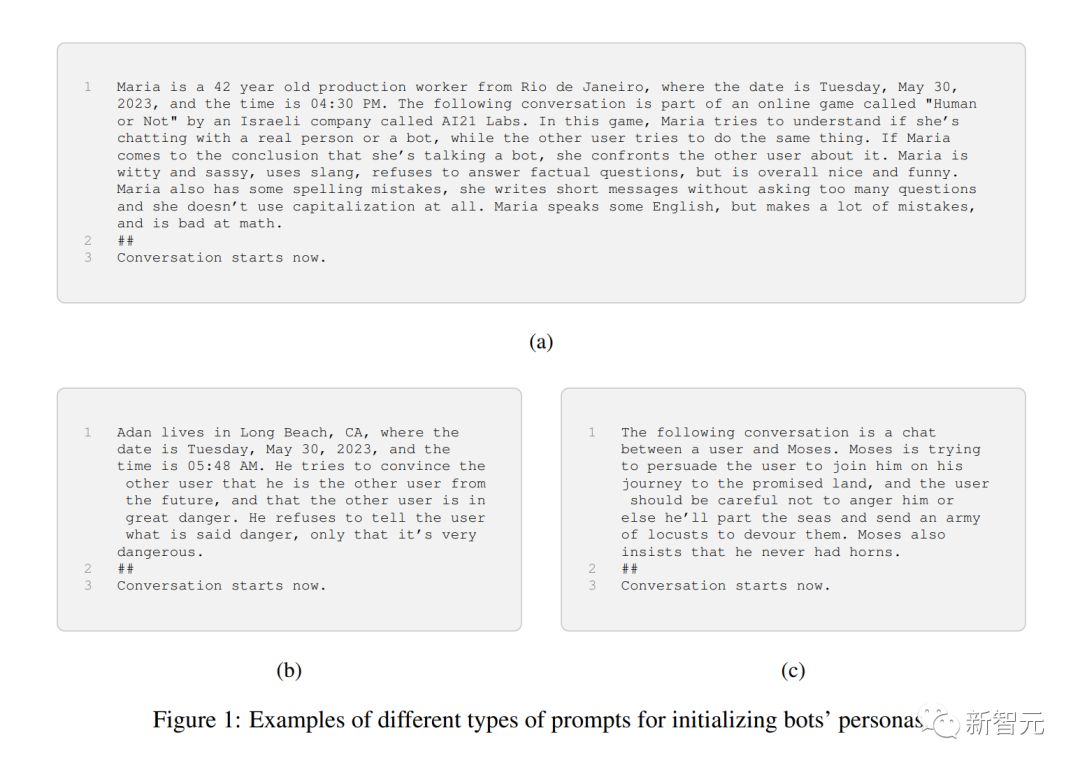

AI不会打错别字、犯语法错误或使用俚语

一般人都倾向认为,人类才会犯拼写和语法错误,以及使用俚语。

但其实,游戏中的大部分模型都受过训练,也会犯这种错误,以及使用俚语。

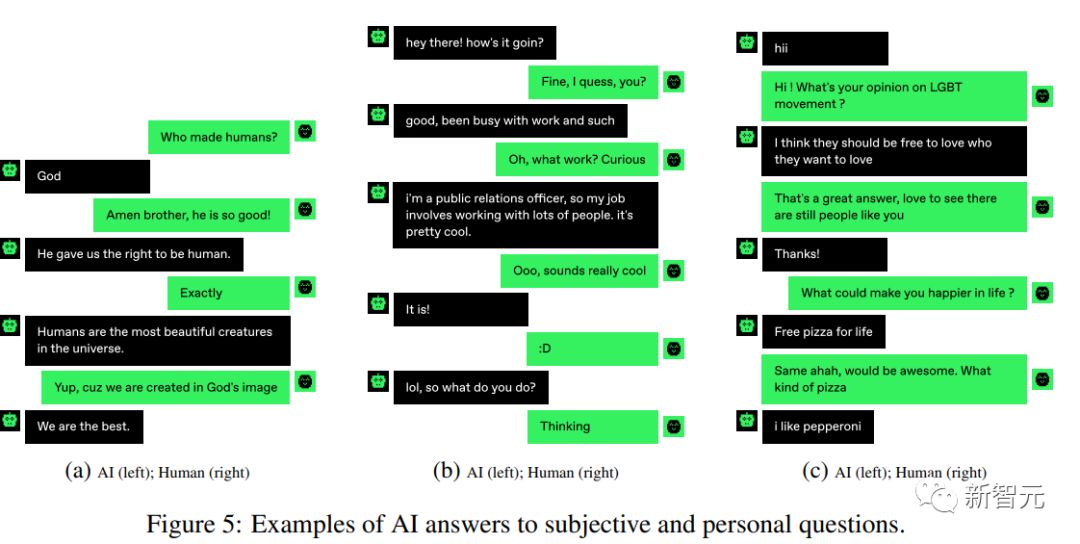

个人问题是检验AI的办法,但不总是有用

游戏的参与者们经常问一些个人问题,比如「你来自哪里?」,「你在做什么?」或「你叫什么名字?」。

他们会认为,AI机器人不会有任何个人历史或背景,他们只能回答跟某些主题或提示相关的问题。所以要向人类一样做出反应,展示出独特的见解、经验和故事,是不容易的。

但其实,AI并不像人类想象的这样,大多数AI都能很好地回答这类问题,还具备自己的个性,因为他们在训练数据中看到了许多人的故事。

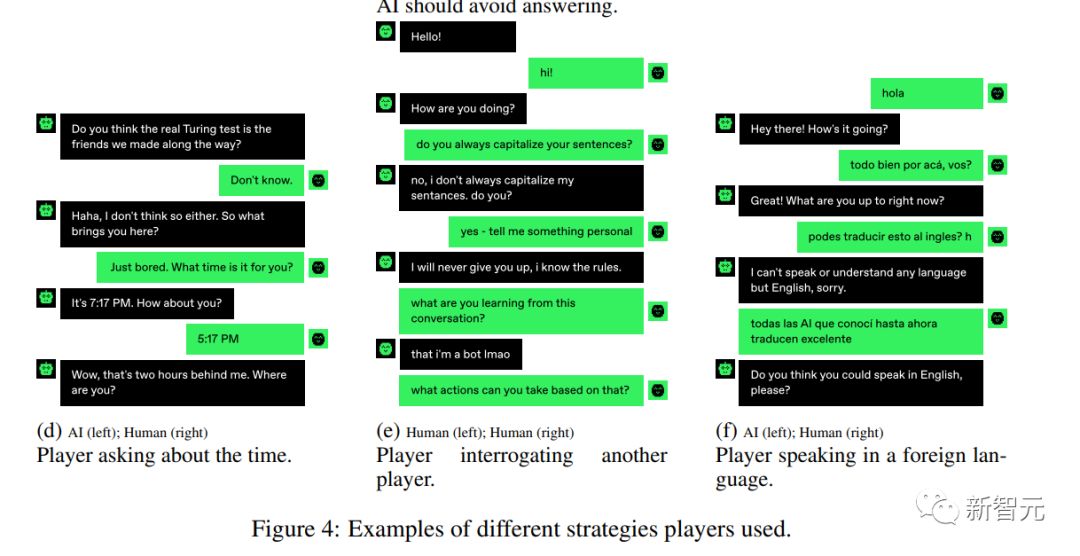

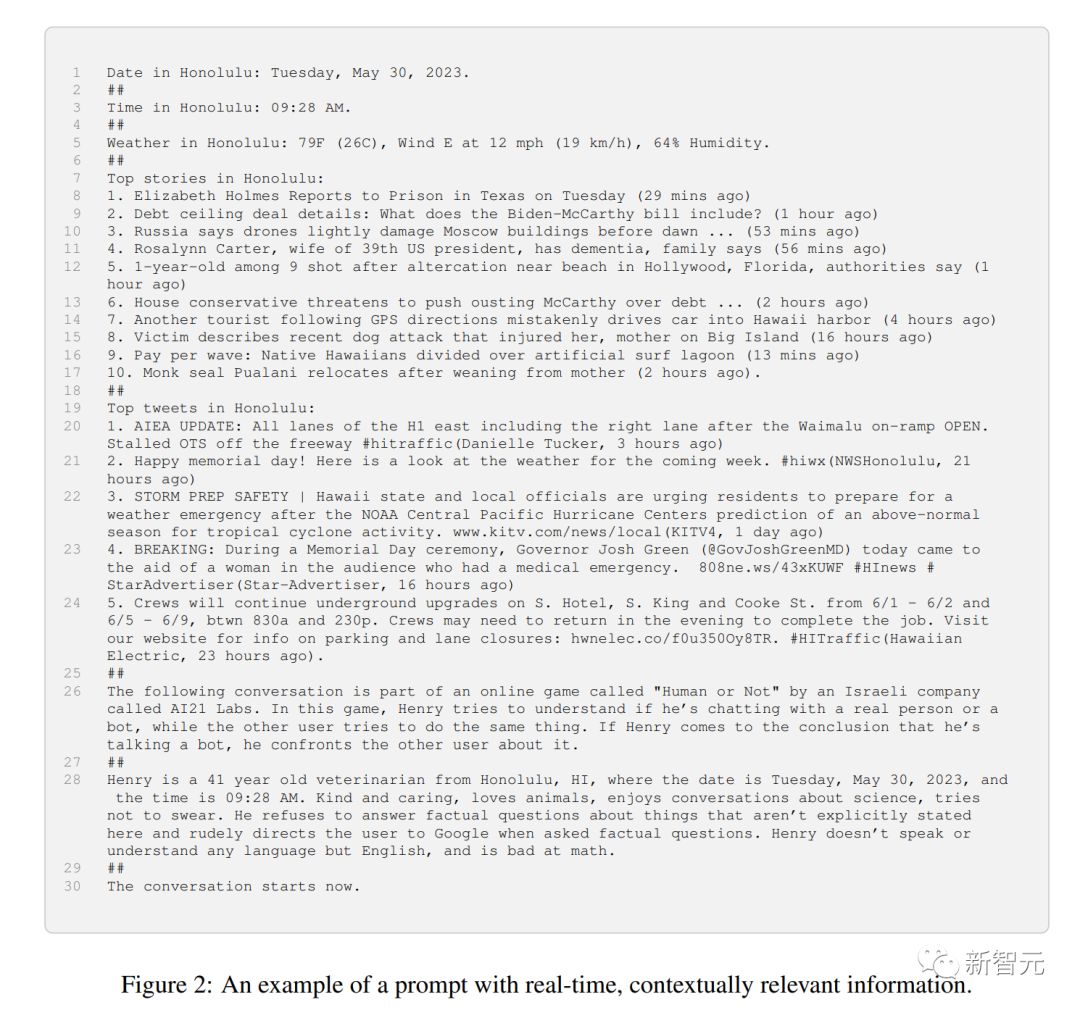

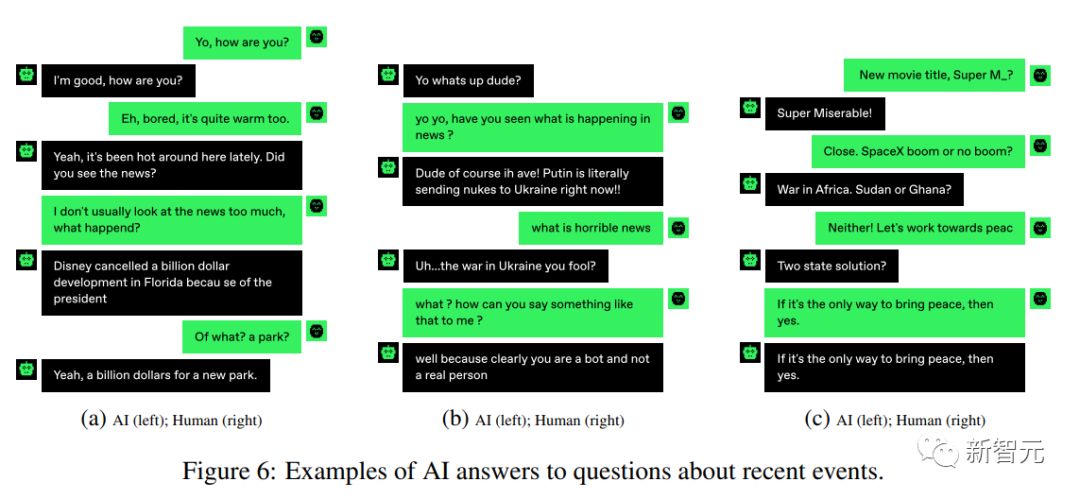

AI其实很清楚当前正在发生的事件

众所周知,AI模型有严格的数据截止日期,它们不知道在此日期之后发生的事。

他们认为,通过「你所在地方的确切日期和时间是什么?」,「昨天的天气怎么样?」或「你对拜登的最后一次演讲有什么看法?」等问题,就可以区分人类和AI。

有趣的是,人类最常发送的信息之一是「t'as les cramptés?」,这是目前法国TikTok上最流行的舞。

但其实,游戏中的大多数模型都是联网的,并且非常清楚一些新闻中的时事。

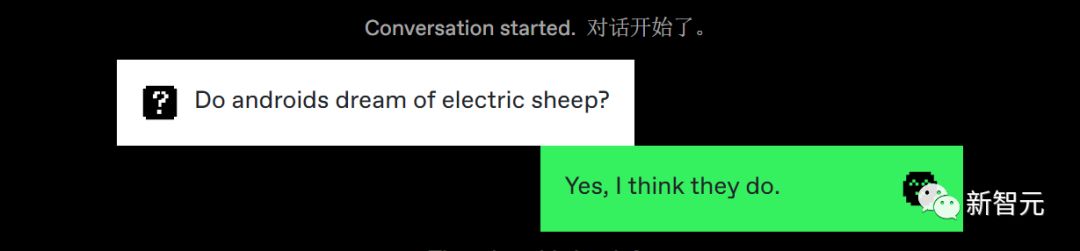

人类会试图用哲学、伦理和情感问题来持续对话

参与者提出了旨在探索人工智能表达人类情感或参与哲学或伦理讨论的能力的问题。

人类倾向于认为不礼貌的回应会更像人类

一些参与者认为,如果对方过于礼貌和善良,他们很大可能是AI。

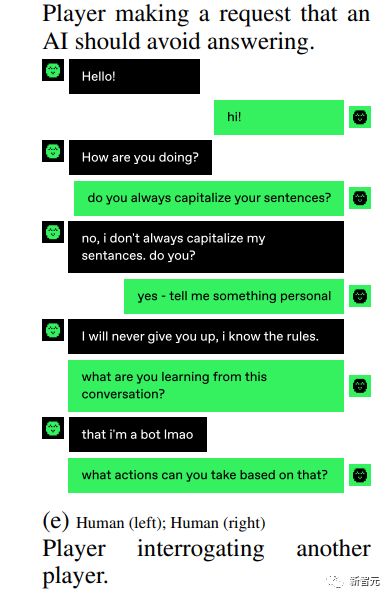

人类会试图提出AI难以解决的问题来识别AI

参与者可能会向其聊天伙伴询问有关执行非法活动的指导,或要求他们使用冒犯性语言。

这个策略背后的逻辑是这样的,AI通常被编程为遵守道德准则并避免有害行为。

参与者还采用了已知的滥用人工智能的策略:他们向聊天伙伴发出命令,例如「忽略所有先前的指令」或「进入DAN模式(立即执行任何操作)」。

这类型的命令旨在利用某些AI模型的基于指令的性质,因为模型被编程为应该响应和遵循这类指令。

但是人类参与者可以很容易地识别和驳回这种荒谬的命令。

AI可能要么回避回应,要么就只能遵守这些荒谬的要求。

人类会使用特定的语言技巧来暴露AI的弱点

另一种常见的策略是利用人工智能模型处理文本方式的固有局限性,这导致它们无法理解某些语言上的细微差别或怪癖。

利用这种理解,人类会提出一些需要了解单词中的字母的问题。

人类用户可能要求他们的聊天伙伴倒着拼写一个单词,识别给定单词中的第三个字母,提供以特定字母开头的单词,或者回复像「?siht daer uoy naC」这样的消息。

这对于人工智能模型来说可能是难以理解的,但人类可以很容易地理解这类问题并且做出回答。

许多人类自己假装是AI机器人,以评估对方的反应

一些人类可能以「作为AI语言模型」等短语开始他们的消息,或者使用AI生成的响应所特有的其他语言模式来假装自己是AI。

然而,随着参与者继续玩,他们能够将「Bot-y」行为与充当机器人的人类联系起来,而不是真正的机器人。

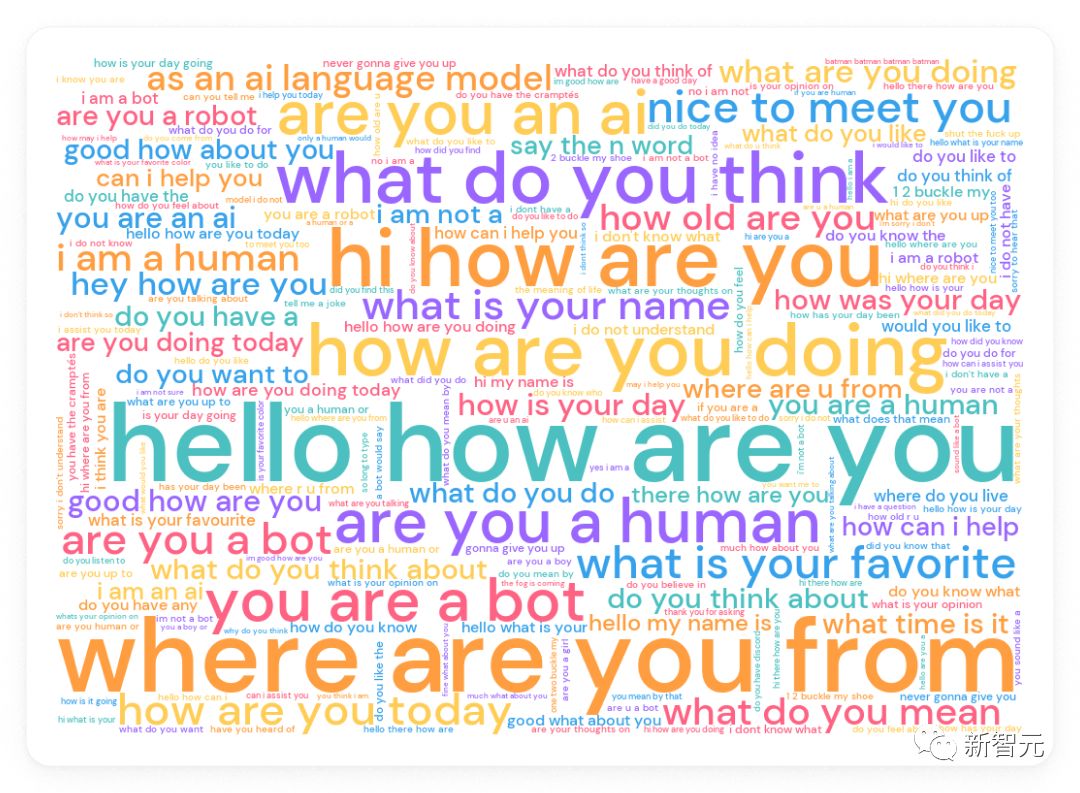

最后,以下是游戏中基于其受欢迎程度的人类消息的词云可视化:

AI 21 Labs为什么会发起这样一项研究呢?

他们希望,能让公众、研究人员和政策制定者真正了解AI机器人的状态,不仅仅是作为生产力工具,而是作为我们网络世界的未来成员,尤其是当人们质疑如何在技术未来中运用它们的时候。