最近更新日期:2023.6.15

最早更新日期:2023.6.7

1. 通用大规模预训练语言模型

英语:

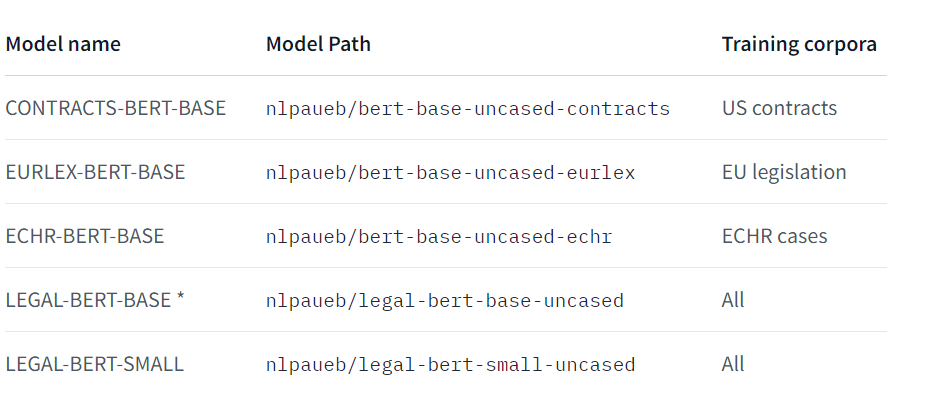

- LegalBERT

- 原始论文:(2020 EMNLP) LEGAL-BERT: The Muppets straight out of Law School - ACL Anthology

- 下载地址:huggingface

- CaseLaw-BERT

- BERTLaw

- PolBERT

- legal-longformer

- LegalLAMA

- (印度) InLegalBERT

中文:

- Lawformer

意大利语:

- ITALIAN-LEGAL-BERT

罗马尼亚语:

- jurBERT

- 原始论文:(2021 NLLP) jurBERT: A Romanian BERT Model for Legal Judgement Prediction

西班牙语:

- RoBERTalex

多语言:

- ParaLaw Nets(看论文应该是日语和英语)

- 原始论文:(2021 COLIEE) ParaLaw Nets – Cross-lingual Sentence-level Pretraining for Legal Text Processing

- 下载地址:我猜是这个:nguyenthanhasia/XLM-Paralaw · Hugging Face

- LegalXLMs

- 原始论文:(2023) MultiLegalPile: A 689GB Multilingual Legal Corpus

- 下载地址:太多了,待补

越南语:

- nguyenthanhasia/VNBertLaw · Hugging Face

- PhoBERT

- 原始论文:(2020 EMNLP) PhoBERT: Pre-trained language models for Vietnamese

- 官方GitHub项目(介绍了各个预训练模型checkpoint的地址和下载方式):VinAIResearch/PhoBERT: PhoBERT: Pre-trained language models for Vietnamese (EMNLP-2020 Findings)

法语

- JuriBERT

- 原始论文:(2022) JuriBERT: A Masked-Language Model Adaptation for French Legal Text

- 下载地址:http://master2-bigdata.polytechnique.fr/resources#juribert(用transformers包的)

2. 对话模型

中文:

- Lawyer LLaMA

AndrewZhe/lawyer-llama: 中文法律LLaMA- 原始论文:(2023) Lawyer LLaMA Technical Report

- 官方GitHub项目:AndrewZhe/lawyer-llama: 中文法律LLaMA

网页版在线体验可以直接申请访问权限(只给了100次使用权限,据说后面会动态调整,大概意思是有钱就多给点吧)

本地部署版:lawyer-llama-13b-beta1.0已公开(lawyer-llama/run_inference.md at main · AndrewZhe/lawyer-llama · GitHub),但是必须要LLaMA的权重,而我还在排LLaMA的队,所以等着吧

英文:

- LawGPT 1.0

虽然名字非常正统,霸气,但是事实上啥也没给,有一种无图言屌的感觉。

3. 分句

多语言:

- https://huggingface.co/models?search=rcds/distilbert-sbd(英语、西班牙语、德语、意大利语、葡萄牙语、法语)

- 原始论文:(2023 ICAIL) MultiLegalSBD: A Multilingual Legal Sentence Boundary Detection Dataset

4. 文本分类

多语言:

- PyEuroVoc(欧盟成员国和候选成员国的语言)按照EuroVoc的indicator来进行分类。基于BERT

5. 信息抽取

- FPDM

这个原模型是从open-domain迁移到specific domain的工作,法律领域主要做的是contract review(抽取重要信息)