简介

CNN网络在图像识别领域有着巨大的贡献,但是其关注于appearance和短时的motion,缺少处理长时间结构的能力。

目前密集间隔采样CNN方法尝试处理video,有着以下问题:

1、长时间视频的计算量大,不能实时应用

2、由于网络固定帧数的限制,视频过长会丢失重要信息

3、需要大量的训练集,然而目前公开数据集在大小和多样性上受限很大,过拟合的风险

TSN实际上是Two-Stream方法的升级版,它将稀疏时间采样策略和视频级监控相结合,使整个动作视频能够有效进行学习。文章要解决两个问题:

1、是长时间视频的行为判断问题(有些视频的动作时间较长)。

2、是解决数据少的问题,数据量少会使得一些深层的网络难以应用到视频数据中,因为过拟合会比较严重。

TSN网络介绍

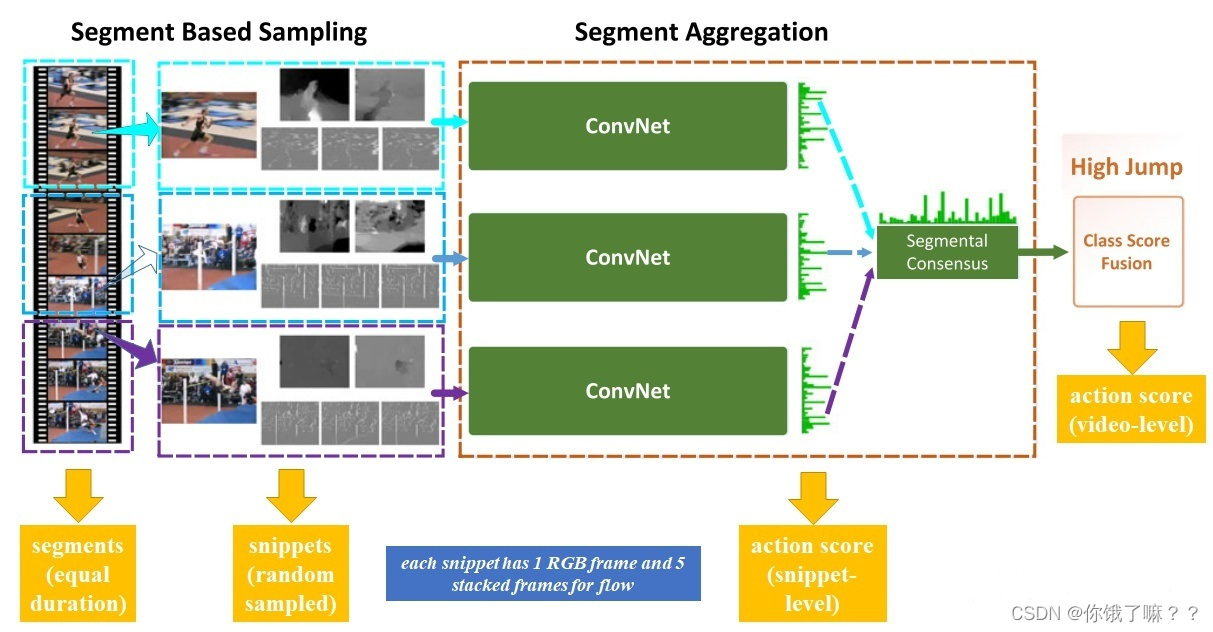

和two-stream一样,TSN也是由空间流卷积网络和时间流卷积网络构成。但不同于two-stream采用单帧或者单堆帧,TSN使用从整个视频中稀疏地采样一系列短片段,每个片段都将给出其本身对于行为类别的初步预测,从这些片段的“共识”来得到视频级的预测结果。在学习过程中,通过迭代更新模型参数来优化视频级预测的损失值。

由上图所示,一个输入视频被分为 KK 段(segment),一个片段(snippet)从它对应的段中随机采样得到。不同片段的类别得分采用段共识函数(The segmental consensus function)进行融合来产生段共识(segmental consensus),这是一个视频级的预测。然后对所有模式的预测融合产生最终的预测结果。

具体来说,给定一段视频 V,把它按相等间隔分为 K 段 {S1,S2,⋯,SK}。接着,TSN按如下方式对一系列片段进行建模:

其中:

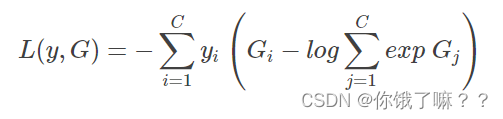

(T1,T2,⋯,TK)代表片段序列,每个片段 Tk从它对应的段 Sk中随机采样得到。F(Tk;W) 函数代表采用 W 作为参数的卷积网络作用于短片段 Tk,函数返回 Tk 相对于所有类别的得分。段共识函数 G(The segmental consensus function)结合多个短片段的类别得分输出以获得他们之间关于类别假设的共识。基于这个共识,预测函数 H 预测整段视频属于每个行为类别的概率(本文 H选择了Softmax函数)。结合标准分类交叉熵损失(cross-entropy loss),关于部分共识的最终损失函数 G 的形式为:

其中:

C 是行为总类别数,yi是类别 i的groundtruth,实验中片段的数量 K 设置为3。本工作中共识函数 G采用最简单的形式,即 Gi=g(Fi(T1),…,Fi(TK)),采用用聚合函数 g(aggregation function)从所有片段中相同类别的得分中推断出某个类别分数Gi。聚合函数 g 采用均匀平均法来表示最终识别精度。

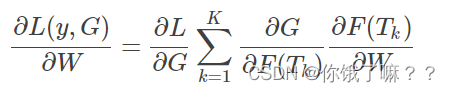

TSN是可微的,或者至少有次梯度,由 g 函数的选择决定。这使我们可以用标准反向传播算法,利用多个片段来联合优化模型参数 W。在反向传播过程中,模型参数 W 关于损失值 L 的梯度为:

其中,K是TSN使用的段数。TSN从整个视频中学习模型参数而不是一个短的片段。与此同时,通过对所有视频固定 K,作者提出了一种稀疏时间采样策略,其中采样片段只包含一小部分帧。与先前使用密集采样帧的方法相比,这种方法大大降低计算开销。

网络结构

一些工作表明更深的结构可以提升物体识别的表现。然而,two-stream网络采用了相对较浅的网络结构(ClarifaiNet)。本文选择BN-Inception (Inception with Batch Normalization)构建模块,由于它在准确率和效率之间有比较好的平衡。作者将原始的BN-Inception架构适应于two-stream架构,和原始two-stream卷积网络相同,空间流卷积网络操作单一RGB图像,时间流卷积网络将一堆连续的光流场作为输入。

网络输入

TSN通过探索更多的输入模式来提高辨别力。除了像two-stream那样,空间流卷积网络操作单一RGB图像,时间流卷积网络将一堆连续的光流场作为输入,作者提出了两种额外的输入模式:RGB差异(RGB difference)和扭曲的光流场(warped optical flow fields)。

单一RGB图像表征特定时间点的静态信息,从而缺少上下文信息。如上图所示,两个连续帧的RGB差异表示动作的改变,对应于运动显著区域。故试验将RGB差异堆作为另一个输入模式。

TSN将光流场作为输入,致力于捕获运动信息。在现实拍摄的视频中,通常存在摄像机的运动,这样光流场就不是单纯体现出人类行为。如上图所示,由于相机的移动,视频背景中存在大量的水平运动。受到iDT(improved dense trajectories)工作的启发,作者提出将扭曲的光流场作为额外的输入。通过估计估计单应性矩阵(homography matrix)和补偿相机运动来提取扭曲光流场。如图所示,扭曲光流场抑制了背景运动,使得专注于视频中的人物运动。

网络训练

1)交叉输入模式预训练

空间网络以RGB图像作为输入:故采用在ImageNet上预训练的模型做初始化。对于其他输入模式(比如:RGB差异和光流场),它们基本上捕捉视频数据的不同视觉方面,并且它们的分布不同于RGB图像的分布。作者提出了交叉模式预训练技术:利用RGB模型初始化时间网络。

首先,通过线性变换将光流场离散到从0到255的区间,这使得光流场的范围和RGB图像相同。然后,修改RGB模型第一个卷积层的权重来处理光流场的输入。具体来说,就是对RGB通道上的权重进行平均,并根据时间网络输入的通道数量复制这个平均值。这一策略对时间网络中降低过拟合非常有效。

2)数据增强

数据增强能产生不同的训练样本并且可以防止严重的过拟合。在传统的two-stream中,采用随机裁剪和水平翻转方法增加训练样本。作者采用两个新方法:角裁剪(corner cropping)和尺度抖动(scale-jittering)。

1、角裁剪(corner cropping):仅从图片的边角或中心提取区域,来避免默认关注图片的中心。

2、尺度抖动(scale jittering):将输入图像或者光流场的大小固定为 256×340256×340,裁剪区域的宽和高随机从 {256,224,192,168}{256,224,192,168} 中选择。最终,这些裁剪区域将会被resize到 224×224224×224 用于网络训练。事实上,这种方法不光包括了尺度抖动,还包括了宽高比抖动。

3)正则化

在学习过程中,Batch Normalization将估计每个batch内的激活均值和方差,并使用它们将这些激活值转换为标准高斯分布。这一操作虽可以加快训练的收敛速度,但由于要从有限数量的训练样本中对激活分布的偏移量进行估计,也会导致过拟合问题。因此,在用预训练模型初始化后,冻结所有Batch Normalization层的均值和方差参数,但第一个标准化层除外。由于光流的分布和RGB图像的分布不同,第一个卷积层的激活值将有不同的分布,于是,我们需要重新估计的均值和方差,称这种策略为部分BN。与此同时,在BN-Inception的全局pooling层后添加一个额外的dropout层,来进一步降低过拟合的影响。dropout比例设置:空间流卷积网络设置为0.8,时间流卷积网络设置为0.7。

实验过程及结果

数据集

实验在两个大型主流动作数据集HMDB51和UCF101上进行。UCF101数据集包含13,320个视频剪辑,其中共101类动作。HMDB51数据集是来自各种来源的大量现实视频的集合,比如:电影和网络视频,数据集包含来自51个动作分类的6,766个视频剪辑。

实验参数

作者使用小批量随机梯度下降算法(mini-batch stochastic gradient descent algorithm)来学习网络参数,batch size设置为256,momentum设置为0.9。用在ImageNet上预训练的模型对网络权重进行初始化。实验中learning rate设置较小:对于空间网络,初始化为0.01,并且每2,000次迭代降为它的 110110,训练过程共迭代4,500次;对于时间网络,初始化为0.005,并且在第12,000和18,000次迭代之后降为它的 110110,训练过程共迭代20,000次。

UCF101训练总时长(8块TITANX GPUs):

空间TSNs:大约2小时

时间TSNs:大约12小时

实验结果分析

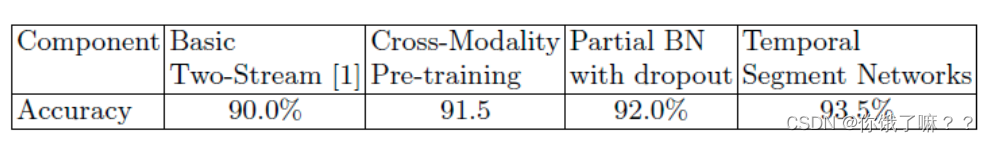

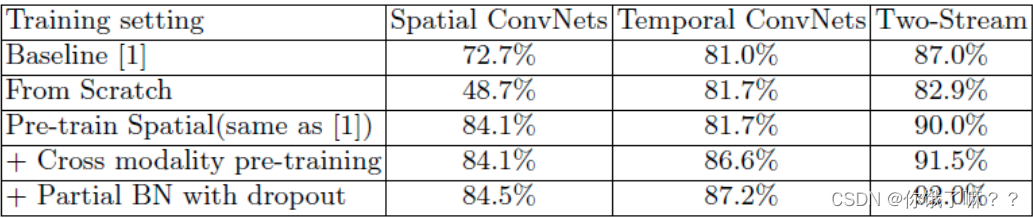

由上表(不同训练策略进行实验的结果)可以看出,从零开始训练比基线算法(two-stream卷积网络)的表现要差很多,证明需要重新设计训练策略来降低过拟合的风险,特别是针对空间网络。对空间网络进行预训练、对时间网络进行交叉输入模式预训练,取得了比基线算法更好的效果。之后还在训练过程中采用部分BN dropout的方法,将识别准确率提高到了92.0%。

由上表(不同输入模式的表现比较)可以看出:首先,RGB图像和RGB差异的结合可以将识别准确率提高到87.3%,这表明两者的结合可以编码一些补充信息。光流和扭曲光流的表现相近(87.2% vs 86.9%),两者融合可以提高到87.8%。四种模式的结合可以提高到91.7%。由于RGB差异可以描述相似但不稳定的动作模式,作者还评估了其他三种模式结合的表现(92.3% vs 91.7%)。作者推测光流可以更好地捕捉运动信息,而RGB差异在描述运动时是不稳定的。在另一方面,RGB差异可以当作运动表征的低质量、高速的替代方案。

TSN的评估

从上表(不同段共识函数的结果)我们发现平局池化函数达到最佳的性能。因此在接下来的实验中选择平均池化作为默认的聚合函数。然后比较了不同网络架构的表现。

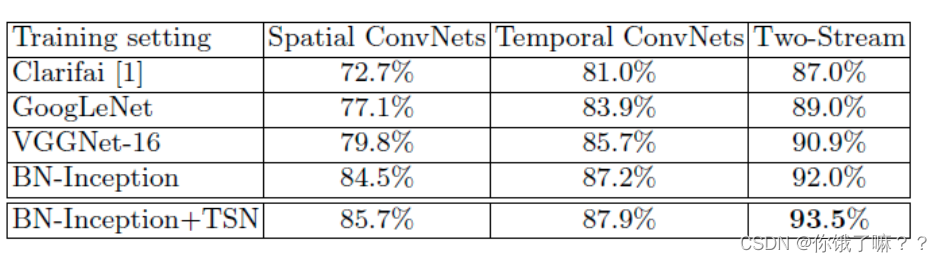

从上表(在不同深度卷积网络上的实验结果)来看,主要比较了3个非常深的网络架构:BN-Inception、GoogLeNet和VGGNet-16。在这些架构中,BN-Inception表现最好,故选择它作为TSN的卷积网络架构。

最后按照上述的设置实现TSN,从准确率的角度出发,结果如下: