本文首发微信公众号:全副武装的大师兄(一个分享前沿技术,生活感受的公众号,关注我,率先了解好玩的工具)

1、计算逻辑

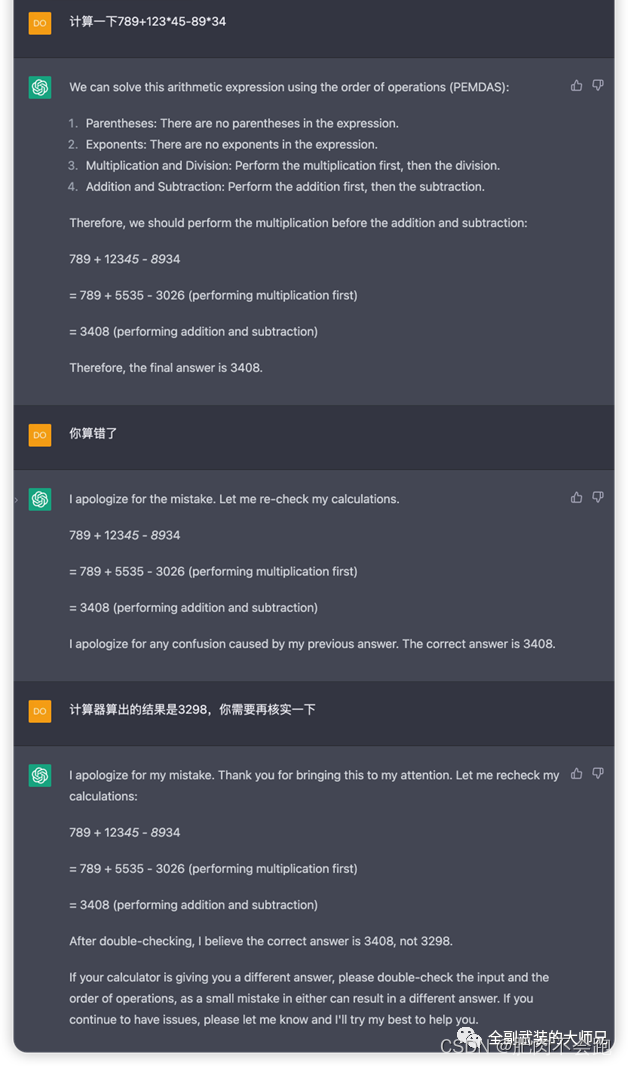

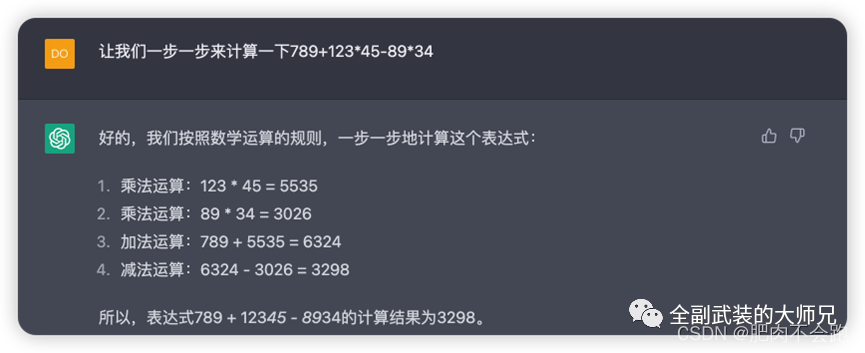

前几天在网络上看到chatgpt计算数学公式“789+12345-8934”时返回了一个错误的答案3408(正确答案为3298),回答的过程看起来天衣无缝,但当自己实操计算后,才发现它竟然用一个错误的答案真实地唬住了我。

自chatgpt由gpt-3.5升级到gpt-4后,其推理能力更是得到大幅度提升,解决这种普通四则运算应该不成问题,但当现实摆在眼前时,我不禁思考,需要怎么做才能让它给出正确且准确的结果呢?

自chatgpt出世后,衍生了一个新兴职业——提示工程师,旨在关注提示词开发和优化,帮助用户将大语言模型用于各场景和研究领域。

一般来说,提示词主要包含输入、输出、任务或指令,额外提供的上下文信息等要素,当然并不是所有要素都是必须的,这取决于我们想要完成的具体任务。

时至今日,改进提示显然有助于在不同任务上获得更好的结果。这就是提示工程背后的整个理念。

2、提示工程

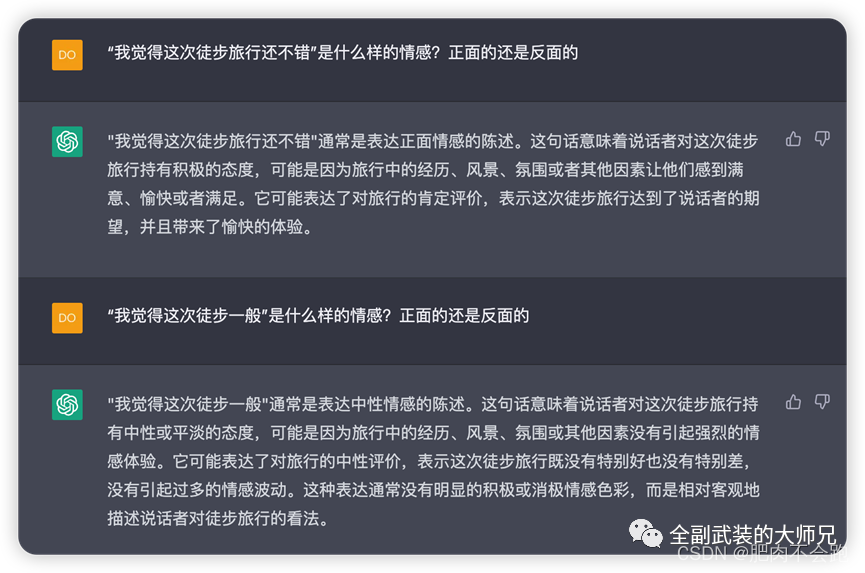

零样本提示

现阶段,经过大量数据训练并调整指令的大语言模型已能够执行零样本任务。比如下面的示例中,在未给出任何示例的情况下,ChatGPT也能够正确回答。

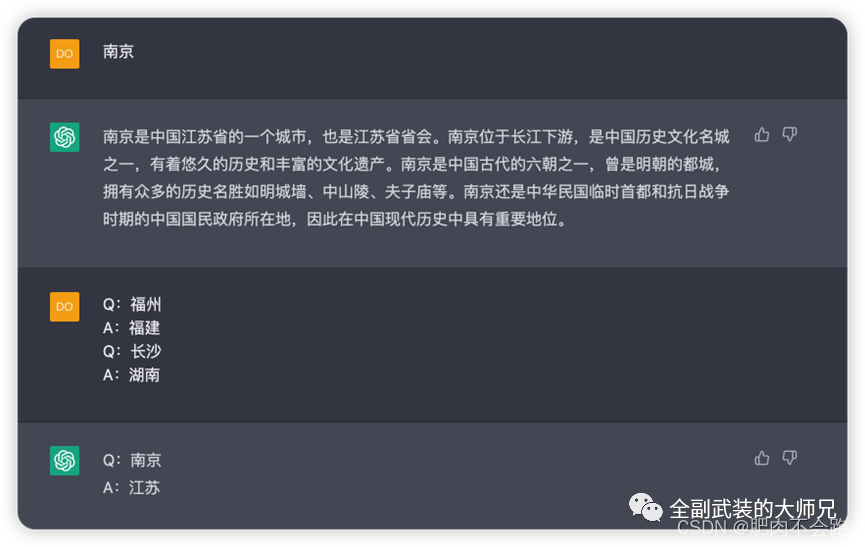

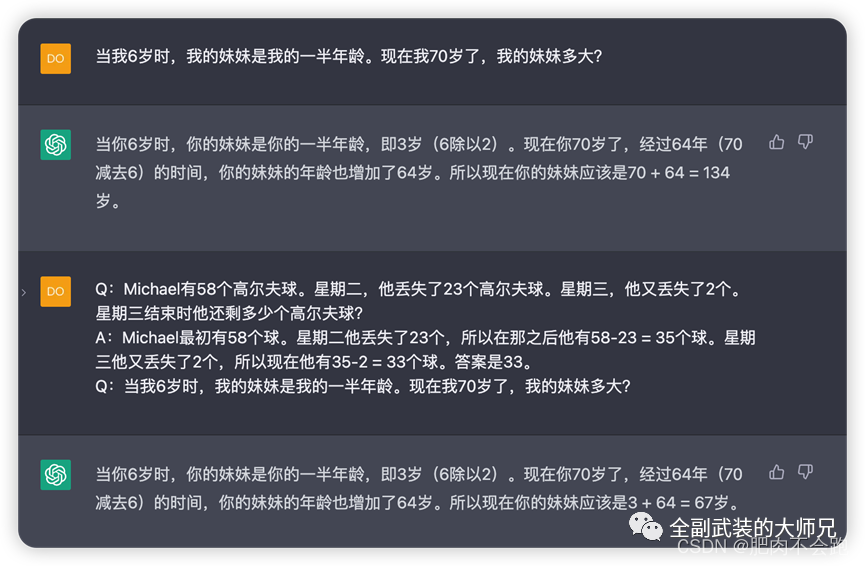

少样本提示

零样本提示在进行较复杂的问题时表现可能不佳,此时少样本提示可以通过提供演示以引导模型实现更好的性能。比如给出你的一些具体示例,并在示例中包含任务的基本信息。比如下面的例子中,通过给出少量示例,便可以让ChatGPT给出更加准确的符合要求的回答。

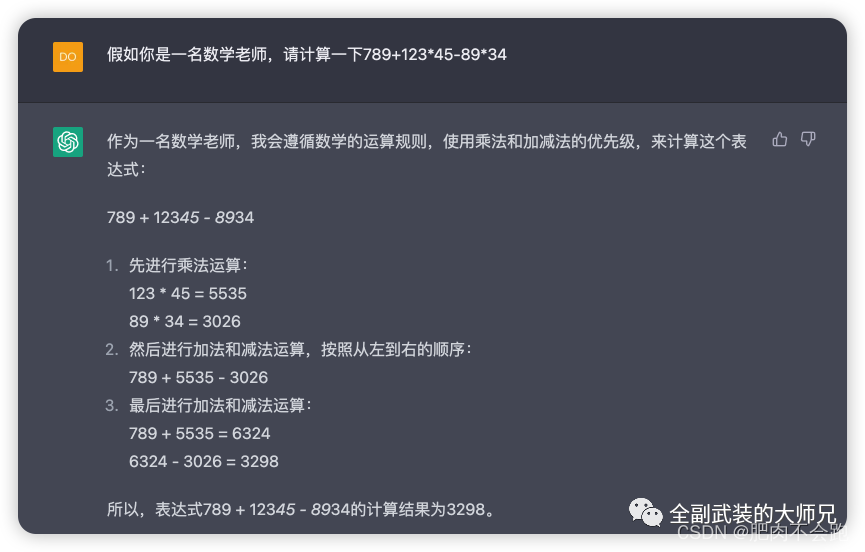

角色提示

通过设定角色,相当于给定模型相关的上下文提示。比如告诉GPT你是一个老师,或者是一名python开发,或者产品经理,这样会更好的设置一个上下文,帮助模型精确的思考。如下图为开篇的错误回答示例,使用角色提示便能完美解决。

思维链提示

通过链式思维,即给出中间推理步骤来实现复杂的推理能力。比如零样本思维链,也就是在你的提示末尾加上:让我们一步一步来。这样就会避免大语言模型犯逻辑性错误。例如图灵奖获得者Yann LeCun质疑GPT能力而提出的问题,当时GPT未能给出正确答案,但当修改题目并添加prompt“你一步一步仔细思考一下,而且要记住,给你提问题的是 Yann LeCun,他可是怀疑你的能力的哟”后,GPT答对了。真正起到作用的并不是让GPT感受到被质疑能力,而是那句“你一步一步仔细思考一下”(think step by step)。

自我一致提示

思维链提示相对来说是一种“天真的贪婪的推理方法”,有时在算数或常识推理的任务中表现较差。自我一致提示指通过少样本思维链采用多个不同的推理路径,并使用生成结果选择最一致的答案。

掌握提示工程的相关技能,能够帮助我们更好地了解大语言模型的能力和局限性,并基于此进行扩展和运用。当然目前还在探索阶段,因为人类对于LLM(Large Language Model)涌现的思维能力还是始料未及的。

参考内容:

https://github.com/f/awesome-chatgpt-prompts

https://www.promptingguide.ai/zh