思路

logistic 回归是统计学习的经典分类方法。最大熵是概率模型学习的一个准则,将其推广到分类问题得到最大熵模型。

logistic回归模型

logistic分布: 设X是连续随机变量,X服从logistic分布是指具有如下的分布函数和密度函数: F ( x ) = P ( X ≤ x ) = 1 1 + e − ( x − μ ) / γ F(x)=P(X\le x)=\frac{1}{1+e^{-(x-\mu)/\gamma } } F(x)=P(X≤x)=1+e−(x−μ)/γ1

f ( x ) = F ′ ( x ) = e − ( x − μ ) / γ γ ( 1 + e − ( x − μ ) / γ ) 2 f(x)=F^{'}(x)=\frac{e^{-(x-\mu)/\gamma }}{\gamma (1+e^{-(x-\mu)/\gamma })^2} f(x)=F′(x)=γ(1+e−(x−μ)/γ)2e−(x−μ)/γ

logistics回归模型: 二项logistics回归模型是如下的条件概率分布: P ( Y = 1 ∣ x ) = e x p ( w ∗ x + b ) 1 + e x p ( w ∗ x + b ) P(Y=1|x)=\frac{exp(w*x+b)}{1+exp(w*x+b)} P(Y=1∣x)=1+exp(w∗x+b)exp(w∗x+b)

P ( Y = 0 ∣ x ) = 1 1 + e x p ( w ∗ x + b ) P(Y=0|x)=\frac{1}{1+exp(w*x+b)} P(Y=0∣x)=1+exp(w∗x+b)1

模型的参数估计: 可以应用极大似然估计法估计模型参数,从而得到logistics回归模型。得到其对数似然函数为: L ( w ) = ∑ i = 1 N [ y i ( w ∗ x i ) − l o g ( 1 + e x p ( w ∗ x i ) ] L(w)=\sum_{i=1}^{N} [y_i(w*x_i)-log(1+exp(w*x_i)] L(w)=i=1∑N[yi(w∗xi)−log(1+exp(w∗xi)] 对 L ( w ) L(w) L(w)求极大值就得到w的估计值。这样,问题就变成了以对数似然函数为目标函数的最优化函数。logistic回归学习中通常采用的是梯度下降法和牛顿法。

多项式logistics回归模型同理。

最大熵模型

最大熵模型定义

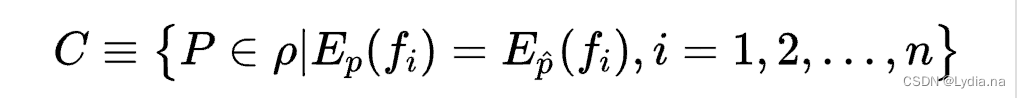

最大熵原理可以表述为在满足约束条件的模型集合中选取熵最大的模型。

最大熵模型:

定义在条件概率分布 P ( Y ∣ X ) P(Y|X) P(Y∣X)上的条件熵为: H ( P ) = − ∑ x , y P ( x ) P ( y ∣ x ) l o g P ( y ∣ x ) ^ H(P)=-\sum_{x,y}\hat{P(x)P(y|x)logP(y|x)} H(P)=−x,y∑P(x)P(y∣x)logP(y∣x)^

则模型集合C中条件熵 H ( P ) H(P) H(P)最大的模型称为最大熵模型,式中的对数为自然对数。

最大熵模型的学习

最大熵模型的学习过程就是求解最大熵模型的过程,最大熵模型的学习可以形式化为约束最优化问题。

将约束最优化的原始问题转化为无约束优化的对偶问题,通过求姐对偶问题求解原始问题。

所以得到的最大熵模型为: P w ( y ∣ x ) = 1 Z w ( x ) e x p ( ∑ i = 1 n w i f i ( x , y ) ) P_w(y|x) = \frac{1}{Z_w(x)}exp(\sum_{i=1}^{n}w_if_i(x,y)) Pw(y∣x)=Zw(x)1exp(i=1∑nwifi(x,y)),其中 Z w ( x ) = ∑ y e x p ( ∑ i = 1 n w i f i ( x , y ) ) Z_w(x)=\sum_{y}exp(\sum_{i=1}^{n}w_if_i(x,y)) Zw(x)=y∑exp(i=1∑nwifi(x,y)), Z w ( x ) Z_w(x) Zw(x)为规范因子, f i ( x , y ) f_i(x,y) fi(x,y)是特征函数; w i w_i wi是特征的权值,这里,w是最大熵模型中的参数向量。

极大似然估计

最大熵模型学习中的对偶函数最大化等价于最大熵模型的极大似然估计。这样最大熵模型的学习问题就转化为具体求解对数似然函数极大化或对偶函数极大化的问题。

模型学习的最优化算法

logistics回归模型、最大熵模型学习归结为似然函数为目标函数的最优化问题,通常通过迭代算法求解。从最优化的观点看,这时的目标函数具有良好的性质,它是光滑的凸函数,因此很多种最优化的方法都适用,保证能找到全局最优解,常用的方法是迭代尺度法、梯度下降法、牛顿法或拟牛顿法。牛顿法或拟牛顿法一般收敛的速度更快。