这次分享的是yolov3中的3.0版本,主要是因为其中使用的一些训练技巧不多,方便入门,在最新版本中作者使用了很多yolov5的训练技巧,不好理解,所以我们从最初版本一步一步学。在看源码之前建议大家对yolov3的原理学习一下可以对源码理解更简单,对理论会更深刻。

yolov3博客地址:YOLOv3论文笔记_crlearning的博客-CSDN博客

源码地址:GitHub - ultralytics/yolov3 at v3.0

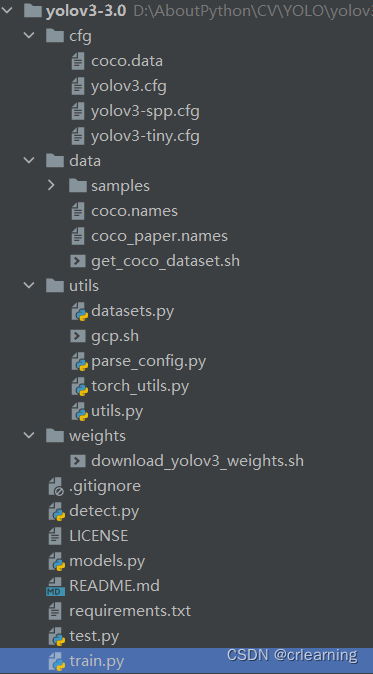

学习一个项目源码,第一步对其项目目录进行了解,其 次看主文件,在进入主函数中逐行调试,进而对代码全局有个了解。cfg文件夹存放yolo的配置文件主要是模型的配置,如卷积大小等。data中存放数据文件,数据集等。utils文件夹中包括自己写的一些工具包,比如对数据集进行处理提取、对box进行解码。weights中存放模型权值文件。接下来就是主文件,train.py训练文件、test.py测试文件(用于训练中每个epoch的测试)、models.py模型文件、detect.py预测文件、requirements.txt其中是项目需要的环境配置。

次看主文件,在进入主函数中逐行调试,进而对代码全局有个了解。cfg文件夹存放yolo的配置文件主要是模型的配置,如卷积大小等。data中存放数据文件,数据集等。utils文件夹中包括自己写的一些工具包,比如对数据集进行处理提取、对box进行解码。weights中存放模型权值文件。接下来就是主文件,train.py训练文件、test.py测试文件(用于训练中每个epoch的测试)、models.py模型文件、detect.py预测文件、requirements.txt其中是项目需要的环境配置。

了解了项目基本结构之后,现在进入到train文件当中,一般的项目都是直接从train.py开始看,首先看到train中的main函数:

if __name__ == '__main__':

parser = argparse.ArgumentParser()

parser.add_argument('--epochs', type=int, default=270, help='number of epochs')

parser.add_argument('--batch-size', type=int, default=16, help='size of each image batch')

# 在n个bacth后更新一次梯度

parser.add_argument('--accumulate', type=int, default=1, help='accumulate gradient x batches before optimizing')

parser.add_argument('--cfg', type=str, default='cfg/yolov3.cfg', help='cfg file path')

parser.add_argument('--data-cfg', type=str, default='cfg/coco.data', help='coco.data file path')

# 多尺度训练,输入图片不固定(在命令行加入--multi-scale就可以用)

parser.add_argument('--multi-scale', action='store_true', help='random image sizes per batch 320 - 608')

# 默认输入图片416

parser.add_argument('--img-size', type=int, default=32 * 13, help='pixels')

# 恢复训练,如果中止训练,使用这个可以接着训练

parser.add_argument('--resume', action='store_true', help='resume training flag')

opt = parser.parse_args()

print(opt, end='\n\n')

# 固定随机种子,使得每次运行的随机值一样,训练和验证集会固定,方便比较模型

init_seeds()

train(

opt.cfg,

opt.data_cfg,

img_size=opt.img_size,

resume=opt.resume,

epochs=opt.epochs,

batch_size=opt.batch_size,

accumulate=opt.accumulate,

multi_scale=opt.multi_scale,

)

首先是传入参数,每个参数的含义可以看我写的注释,然后进入到train函数

def train(

cfg,

data_cfg,

img_size=416,

resume=False,

epochs=270,

batch_size=16,

accumulate=1,

multi_scale=False,

freeze_backbone=False,

):

# os.sep就是 斜杠/

weights = 'weights' + os.sep

latest = weights + 'latest.pt'

best = weights + 'best.pt'

# 选择是GPU还是CPU

device = torch_utils.select_device()

if multi_scale:

img_size = 608 # initiate with maximum multi_scale size

else:

# 如果尺度不变,使用benchmark可以增加运行效率

torch.backends.cudnn.benchmark = True # unsuitable for multiscale

# 训练集路径

train_path = parse_data_cfg(data_cfg)['train']

# 初始化模型

model = Darknet(cfg, img_size)

# 加载数据集

dataloader = LoadImagesAndLabels(train_path, batch_size, img_size, augment=True)

# dataloader = torch.utils.data.DataLoader(dataloader, batch_size=batch_size, num_workers=0)

# 初始学习步长

lr0 = 0.001

# 这个参数表示backbone有多少层,方便冻结训练

cutoff = -1

start_epoch = 0

best_loss = float('inf')

下面是否使用恢复训练:

# 使用中断恢复训练(一般用不到)

if resume:

checkpoint = torch.load(latest, map_location='cpu')

# 加载要继续的模型权重

model.load_state_dict(checkpoint['model'])

# 设置优化器

optimizer = torch.optim.SGD(filter(lambda x: x.requires_grad, model.parameters()), lr=lr0, momentum=.9)

start_epoch = checkpoint['epoch'] + 1

if checkpoint['optimizer'] is not None:

optimizer.load_state_dict(checkpoint['optimizer'])

best_loss = checkpoint['best_loss']

del checkpoint # current, saved下面是从零开始训练:

else:

# 初始化模型

if cfg.endswith('yolov3.cfg'):

cutoff = load_darknet_weights(model, weights + 'darknet53.conv.74')

elif cfg.endswith('yolov3-tiny.cfg'):

cutoff = load_darknet_weights(model, weights + 'yolov3-tiny.conv.15')

# 设置优化器

optimizer = torch.optim.SGD(model.parameters(), lr=lr0, momentum=.9)是否是有多GPU:

# 多GPU训练

if torch.cuda.device_count() > 1:

model = nn.DataParallel(model)

model.to(device).train()

# 设置学习步长优化器

# scheduler = torch.optim.lr_scheduler.MultiStepLR(optimizer, milestones=[54, 61], gamma=0.1)上面的参数配置完成后,可以开始训练:

# 调整学习步长,对前1000个batch进行学习了warm up

n_burnin = min(round(len(dataloader) / 5 + 1), 1000)

for epoch in range(epochs):

model.train()

epoch += start_epoch

print(('\n%8s%12s' + '%10s' * 7) % (

'Epoch', 'Batch', 'xy', 'wh', 'conf', 'cls', 'total', 'nTargets', 'time'))

# 自动更新学习步长

# scheduler.step()

# 手动更新学习步长

if epoch > 250:

lr = lr0 / 10

else:

lr = lr0

for x in optimizer.param_groups:

x['lr'] = lr

# 如果使用冻结训练,第一个epoch规定backbone

if freeze_backbone and epoch < 2:

for i, (name, p) in enumerate(model.named_parameters()):

# cutoff就是backbone的层数,小于就属于backbone

if int(name.split('.')[1]) < cutoff: # if layer < 75

p.requires_grad = False if (epoch == 0) else True下面为每个epoch训练步骤:

ui = -1

rloss = defaultdict(float)

for i, (imgs, targets, _, _) in enumerate(dataloader):

targets = targets.to(device)

# 取出的个数,targets维度[batch_size, 1]

nT = targets.shape[0]

if nT == 0: # if no targets continue

continue

# SGD burn-in

# 学习步长前1000个使用warm up

if (epoch == 0) and (i <= n_burnin):

lr = lr0 * (i / n_burnin) ** 4

for x in optimizer.param_groups:

x['lr'] = lr

# 使用模型跑出训练结果

pred = model(imgs.to(device))

# 对GT标签进行处理

target_list = build_targets(model, targets, pred)

# 计算loss

loss, loss_dict = compute_loss(pred, target_list)

# 反向传播计算梯度

loss.backward()

# 累加accumulate个batchs在对梯度进行优化

if (i + 1) % accumulate == 0 or (i + 1) == len(dataloader):

optimizer.step()

optimizer.zero_grad()

# 计算每个epoch的loss均值,大家可以推到一下

ui += 1

for key, val in loss_dict.items():

rloss[key] = (rloss[key] * ui + val) / (ui + 1)

# 打印相关的训练信息

s = ('%8s%12s' + '%10.3g' * 7) % (

'%g/%g' % (epoch, epochs - 1),

'%g/%g' % (i, len(dataloader) - 1),

rloss['xy'], rloss['wh'], rloss['conf'],

rloss['cls'], rloss['total'],

nT, time.time() - t0)

t0 = time.time()

print(s)

# Multi-Scale training (320 - 608 pixels) 每10 batches改变一次imgsize

if multi_scale and (i + 1) % 10 == 0:

dataloader.img_size = random.choice(range(10, 20)) * 32

print('multi_scale img_size = %g' % dataloader.img_size)最后对每个结果进行处理,保存权值文件:

# 将最低的loss记录下来

if rloss['total'] < best_loss:

best_loss = rloss['total']

# 保存训练模型

save = True

if save:

# Save latest checkpoint

checkpoint = {'epoch': epoch,

'best_loss': best_loss,

'model': model.module.state_dict() if type(model) is nn.DataParallel else model.state_dict(),

'optimizer': optimizer.state_dict()}

torch.save(checkpoint, latest)

# Save best checkpoint

if best_loss == rloss['total']:

os.system('cp ' + latest + ' ' + best)

# 每5个epoch保存一次

if (epoch > 0) and (epoch % 5 == 0):

os.system('cp ' + latest + ' ' + weights + 'backup{}.pt'.format(epoch))

# 计算 mAP

with torch.no_grad():

P, R, mAP = test.test(cfg, data_cfg, weights=latest, batch_size=batch_size, img_size=img_size, model=model)

# 将每轮epoch的结果保存到txt中

with open('results.txt', 'a') as file:

file.write(s + '%11.3g' * 3 % (P, R, mAP) + '\n')以上就是整个train的训练文件,后续有需要会继续更新其中其他重要文件