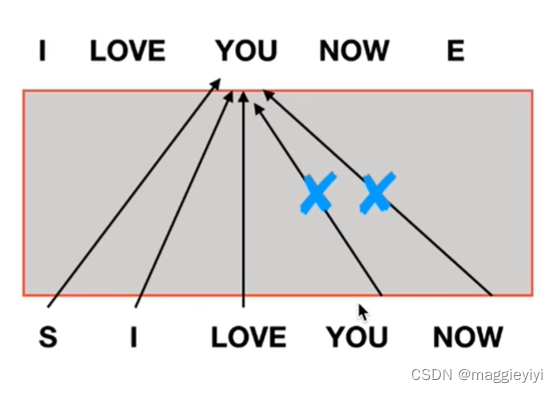

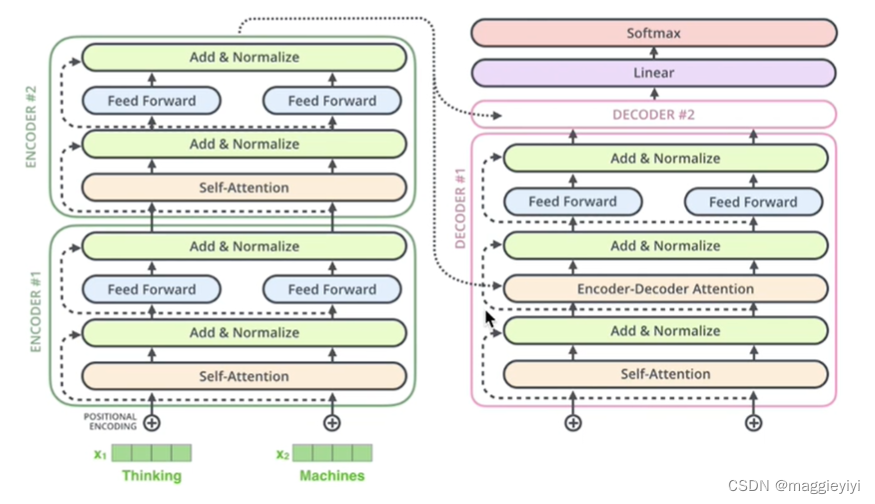

Transformer——Decoder

猜你喜欢

转载自blog.csdn.net/maggieyiyi/article/details/126991415

今日推荐

周排行