文章目录

- 2019

- 2020

- 2021

-

- Fruit Detection and Pose Estimation for Grape Cluster–Harvesting Robot Using Binocular Imagery Based on Deep Neural Networks

- Efficient and Robust Orientation Estimation of Strawberries for Fruit Picking Applications

- A mango picking vision algorithm on instance segmentation and key point detection from RGB images in an open orchard

- Geometry-Aware Fruit Grasping Estimation for Robotic Harvesting in Orchards

- 2022

2019

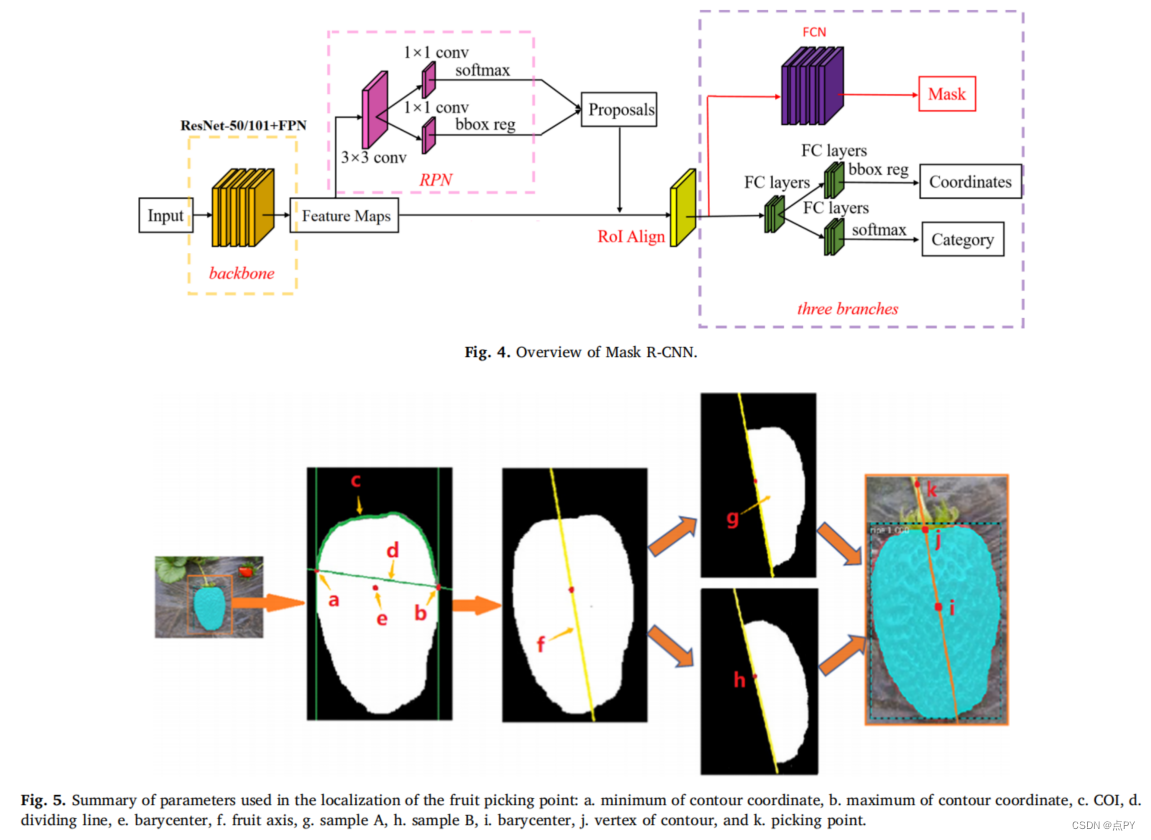

Fruit detection for strawberry harvesting robot in non-structural environment based on Mask-RCNN

摘要: 深度学习具有良好的图像特征学习能力,并被广泛应用于图像目标检测中。为了提高机器视觉在草莓采集机器人水果检测中的性能,引入了掩模区域卷积神经网络(Mask-RCNN)。采用Resnet50作为骨干网络,结合特征金字塔网络(FPN)架构进行特征提取。区域提案网络(RPN)接受了端到端训练,以便为每个特征地图创建区域提案。利用Mask R-CNN生成成熟果实的掩模图像后,对草莓采摘点进行视觉定位方法。100张测试图像的水果检测结果显示,平均检测精度为95.78%,召回率为95.41%,实例分割的平均联合交集(MIoU)率为89.85%。对573个成熟果实采摘点的预测结果显示,平均误差为± 1.2 mm。与四种传统方法相比,该方法在非结构环境下,特别是对重叠和隐藏的果实,以及在不同光照下的普遍性和鲁棒性。

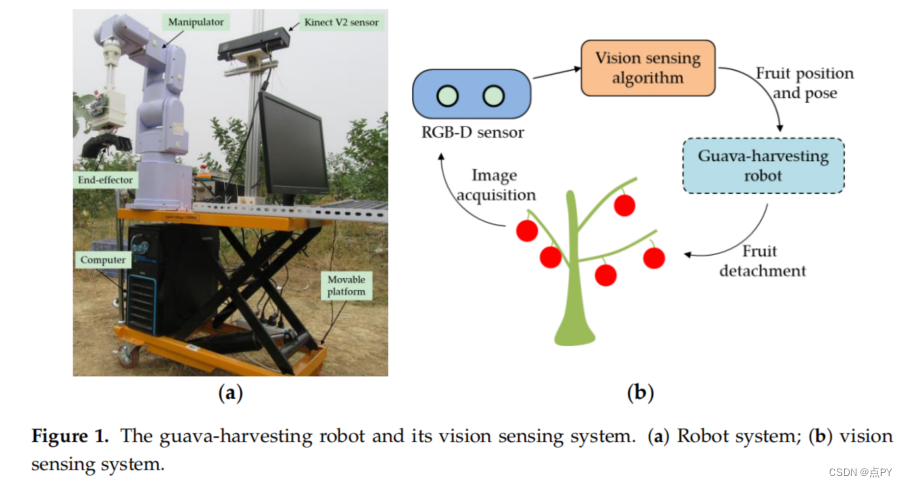

Guava Detection and Pose Estimation Using a Low-Cost RGB-D Sensor in the Field

paper: https://www.mdpi.com/1424-8220/19/2/428/htm

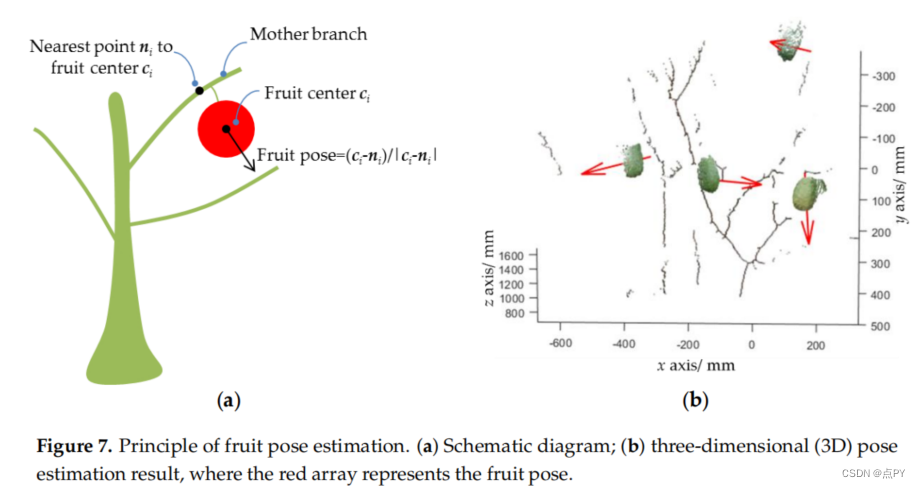

摘要: 在真实的室外条件下,果实检测是番石榴自动采集所需的必要条件,而果实的分支依赖姿势对于引导机器人接近目标果实而不碰撞目标果实也对其分离至关重要。为了进行自动、无碰撞的采摘,本研究研究了一种使用低成本的红绿蓝深度(RGB-D)传感器的水果检测和姿态估计方法。首先部署了一个最先进的全卷积网络来分割RGB图像,以输出一个水果和分支二进制映射。基于水果二值图和RGB-D深度图像,然后应用欧氏聚类方法将点云分组为一组单独的水果。接下来,提出了一种多三维(三维)线段检测方法来重建分段后的分支。最后,利用果实的中心位置和最近的分支信息,估计了果实的三维姿态。在一个室外果园中获得了一个数据集,以评价该方法的性能。定量实验表明,番石榴果实检测的精度和召回率分别为0.983和0.948,三维位姿误差为23.43◦±14.18◦,每个果实的执行时间为0.565 s。研究结果表明,该方法可应用于一种番石榴采集机器人。

2020

Real-Time Fruit Recognition and Grasping Estimation for Robotic Apple Harvesting

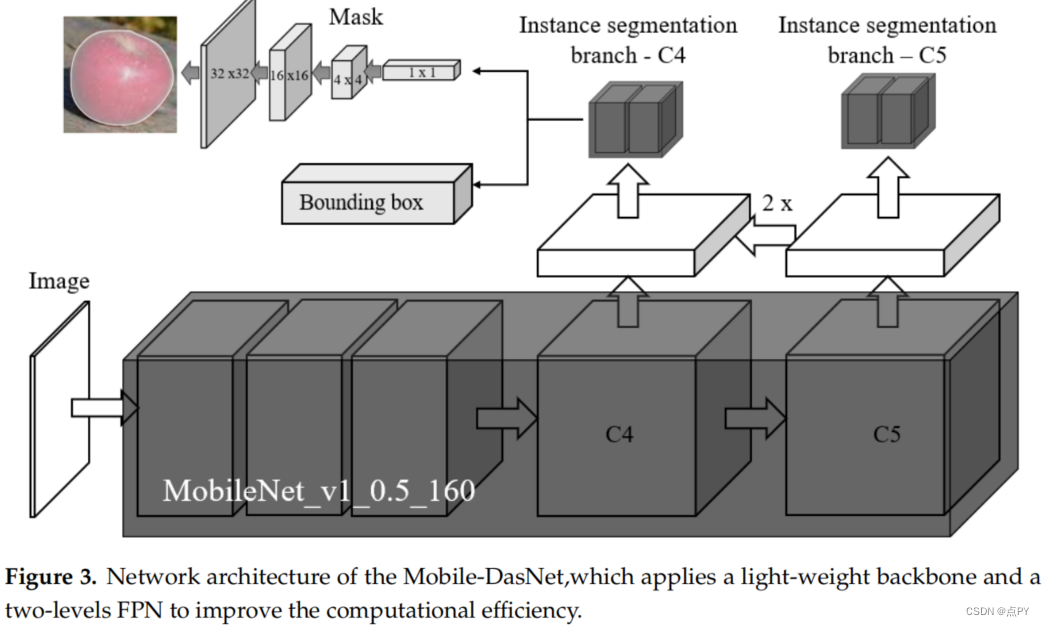

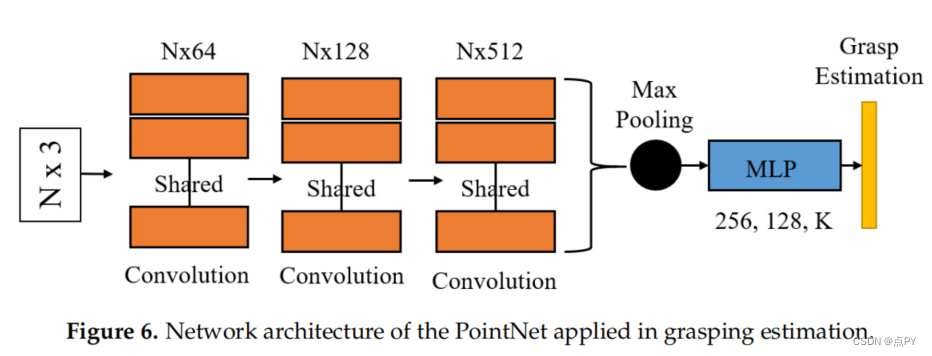

摘要: 机器人收获在未来的农业发展中具有广阔的前景。然而,在开发一个功能齐全的机器人采集系统时,仍存在许多挑战。愿景是这些挑战中最重要的关键之一。在真实的实现环境中,传统的视觉方法总是在准确性、鲁棒性和效率方面存在缺陷。在这项工作中,我们开发并评估了一种基于完全深度学习的自主苹果收获视觉方法。该方法包括一个轻量级的水果识别检测和分割网络和一个点网,并在获取前估计每个水果的正确方法姿态。水果识别网络从RGB-D摄像机中获取原始输入,对RGB图像进行水果检测和实例分割。点网抓取网络将深度信息和水果识别结果作为输入,输出每个水果的接近姿态,用于机械臂执行。所开发的视觉方法是根据从实验室和果园环境中收集的RGB-D图像数据进行了评估的。机器人在室内和室外条件下的收获实验也包括,以验证开发的收获系统的性能。实验结果表明,所开发的视觉方法能够高效、准确地指导机器人的采集。总的来说,所开发的机器人收获系统的收获成功率达到0.8秒,循环时间为6.5秒。

论文的贡献:

- 提出了一种计算效率高的轻量级一期实例分割网络Mobile-DasNet,用于对感官数据进行水果检测和实例分割。

- 提出了一种改进的基于点网的网络,利用RGB-D相机的点云进行水果建模和抓取估计。

- 将上述两个特性应用并结合起来,用于设计和构建精确的机器人系统的自主水果收获。

2021

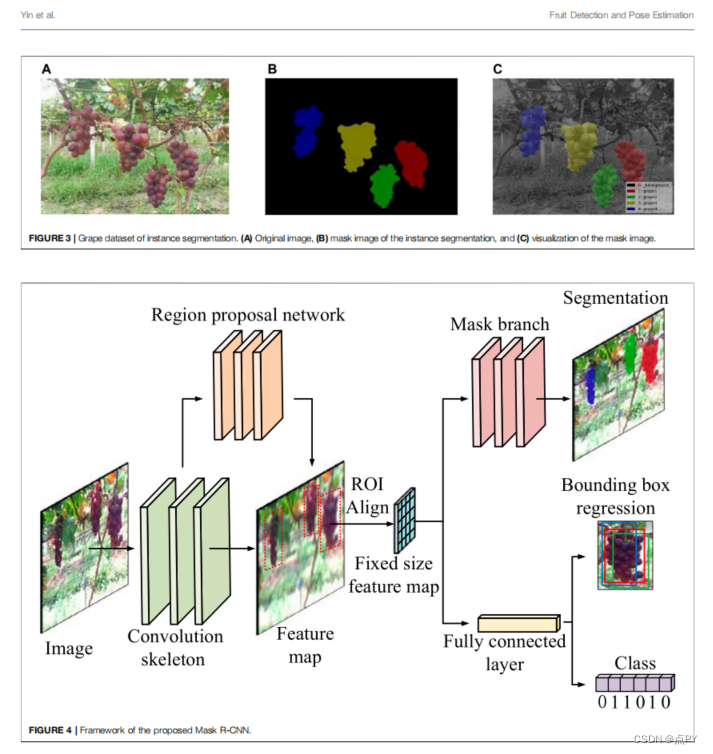

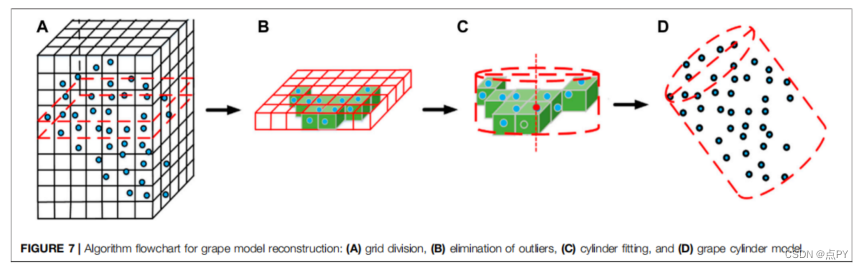

Fruit Detection and Pose Estimation for Grape Cluster–Harvesting Robot Using Binocular Imagery Based on Deep Neural Networks

paper: https://www.frontiersin.org/articles/10.3389/frobt.2021.626989/full

摘要: 在非结构环境中,可靠和鲁棒的水果检测算法对于有效利用收获机器人至关重要。水果的姿态是指导机器人接近目标水果进行无碰撞采摘的重要因素。为了实现准确的采摘,本研究研究了一种检测水果和估计其姿态的方法。首先,利用最先进的掩模区域卷积神经网络(Mask R-CNN)对双目图像进行分割,输出目标水果的掩模图像。然后,对从图像中提取的葡萄点云进行滤波和去噪,得到准确的葡萄点云。最后,利用精确的葡萄点云与RANSAC算法进行葡萄柱模型拟合,并利用葡萄柱模型的轴来估计葡萄的姿态。在一个葡萄园中获得了一个数据集,以评估所提出的方法在非结构性环境中的性能。210张测试图像的果实检测结果显示,平均精度、召回率和联合交集(IOU)分别为89.53、95.33和82.00%。每颗葡萄的检测和点云分割约需要1.7秒。该方法的性能证明表明,该方法可应用于葡萄收获机器人。

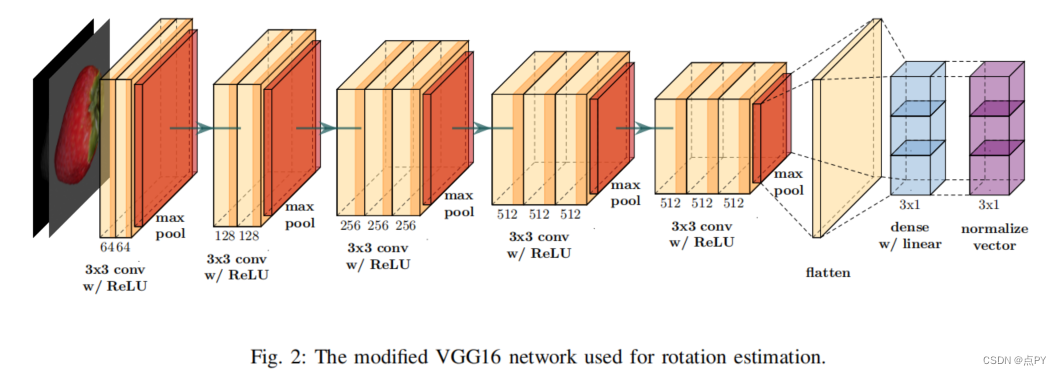

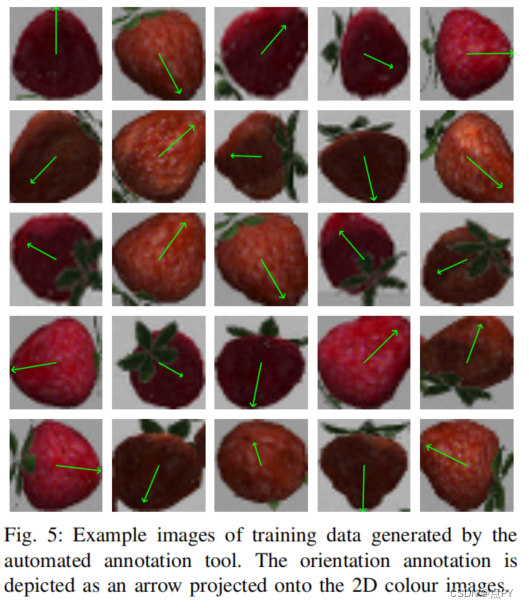

Efficient and Robust Orientation Estimation of Strawberries for Fruit Picking Applications

paper: https://eprints.lincoln.ac.uk/id/eprint/44426/7/paper_icra_2021_final_cright.pdf

摘要: 农业领域的最新发展突出了使用机器人技术的潜力和必要性。在该领域的各种过程可以受益于适当的使用最先进的技术[1],在效率和质量方面。其中一个领域是收获成熟的果实。

为了能够自动化这一过程,机器人收割机需要了解要收集的作物/水果的全部姿势,以便执行适当的路径和碰撞规划。目前的技术水平主要考虑水果的检测和分割问题,定位仅限于三维位置。对各自方向的可靠和实时的估计仍然是一个大多未解决的问题。

在本文中,我们提出了一种紧凑而高效的网络架构,用于从颜色和深度图像来估计草莓等软水果的方向。该系统可以在一个真实的仿真环境中进行自动训练。我们评估了该系统在模拟数据集上的性能,并验证了其在公开的草莓图像上的操作,以证明其实际应用。根据所使用的训练数据量、状态空间的覆盖范围以及仅对RGB-D或RGB数据的可用性,可以获得低至11个◦的平均误差。

论文的贡献:

- 一个紧凑和高效的网络架构,能够估计旋转对称物体的旋转配置,在我们的案例中,从颜色和额外的深度图像线索;

- 一个能够自动生成RGB和深度(RGB-D)数据的系统,我们用于训练过程,涵盖光照、外观和水果种类的巨大变化;

- 在公开的真实草莓数据集上验证提出的框架。

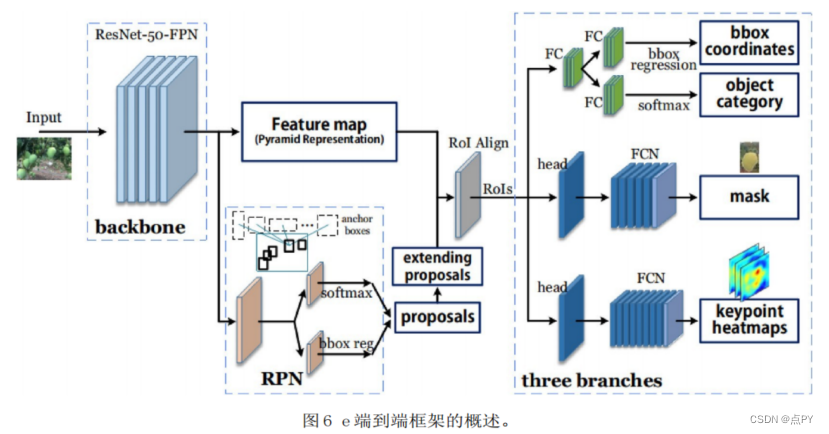

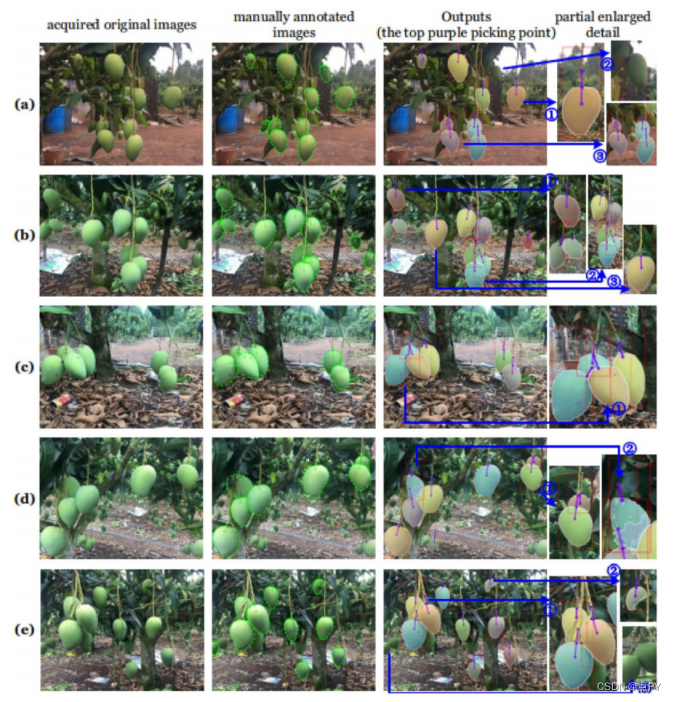

A mango picking vision algorithm on instance segmentation and key point detection from RGB images in an open orchard

paper: https://www.sciencedirect.com/science/article/abs/pii/S1537511021000738

摘要: 水果采摘机器人的视觉系统必须执行两个困难的任务,即水果的精确像素分割和采摘点的正确检测。由于视觉系统在这些任务上的不令人满意的性能,机器人的拾取性能不足,并且其应用不普遍。在本研究中,通过水果实例分割和采摘点定位,在深度学习框架中为潜在的芒果采摘机器人视觉系统设计了一种使用 RGB 图像的视觉算法。该算法不仅成功地完成了这两项任务,而且将它们集成到一个端到端的网络中,网络中的并行分支同时完成这两项任务。实例切分的平均精度(IoU 为 0.75)和平均召回率分别达到 0.947 和 0.929,拾取点检测的最佳精度和召回率分别达到 0.984 和 0.908。此外,这些任务面临户外果园中的各种照明和背景干扰,以及遮挡、重叠和对象比例方面的复杂问题。在本研究中,对视觉系统在各种复杂条件下的几个数据集和子集的性能进行了详细分析,并讨论了影响性能的主要因素。结果表明,该系统对各种光照和复杂背景具有很强的鲁棒性,对于轻微和中等遮挡或重叠,以及对

于中等和大芒果,都产生了令人满意的分割和拾取点检测性能。模型可视化和模型训练的影响分析展示了深度学习网络的训练过程和建模效果。

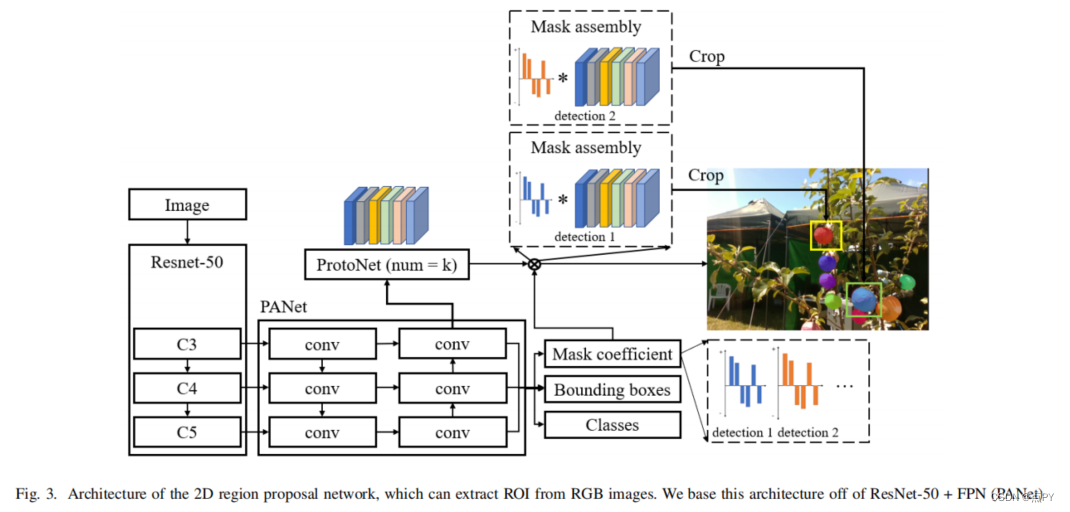

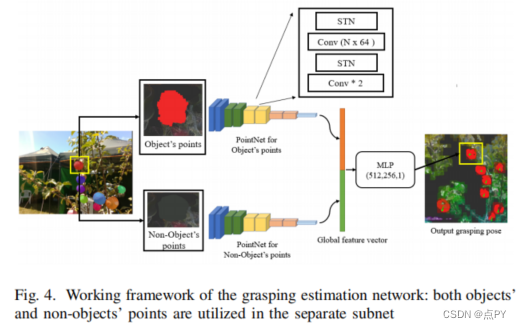

Geometry-Aware Fruit Grasping Estimation for Robotic Harvesting in Orchards

paper: https://paperswithcode.com/paper/geometry-aware-fruit-grasping-estimation-for

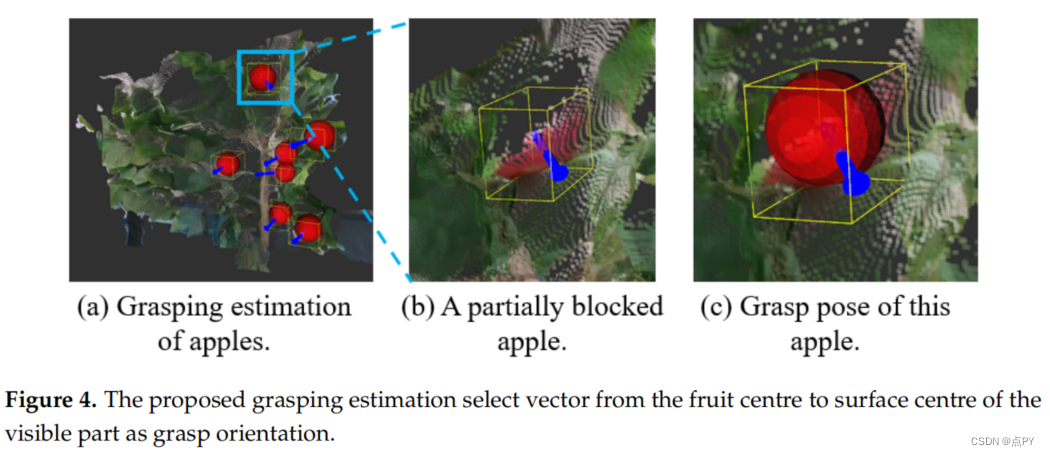

摘要: 野外机器人收获是近年来农业工业发展中的一种很有前途的技术。在天然果园收获之前,机器人识别和定位水果是至关重要的。然而,在果园中收割机器人的工作空间是复杂的:许多水果被树枝和树叶遮挡住了。在进行操作之前,估计每个水果的一个适当的抓握姿势是很重要的。在本研究中,提出了一种几何感知网络A3N,利用RGB-D相机的颜色和几何感知数据进行端到端实例分割和抓取估计。此外,工作空间几何建模也被用于辅助机器人的操作。此外,我们实现了一种全球到局部的扫描策略,使机器人能够通过两个消费者级的RGB-D相机在现场环境中准确地识别和检索水果。我们还在实验中全面地评价了所提出的网络的准确性和鲁棒性。实验结果表明,A3N在实例分割精度上达到了0.873,平均计算时间为35 ms。抓取估计的平均精度和中心精度分别为0.61 cm和4.8◦。总的来说,利用全球到局部扫描和A3N的机器人系统,在野外采集实验中获得了70% - 85%的收获成功率。

论文的贡献:

- 提出了一种新的端到端几何感知网络A3N,包括区域建议网络和抓取估计网络,分别进行水果分割和抓取姿态估计。

- 提出了一种包括水果检测、抓取姿态估计和工作空间建模在内的框架,可直接用于果园中精确和鲁棒的机器人收获。

- 实施了一种全球到局部的策略,当深度传感器的精度有限时,允许在果园中进行精确的视觉感知。广泛的定量评价也包括来验证所提出的方法。

2022

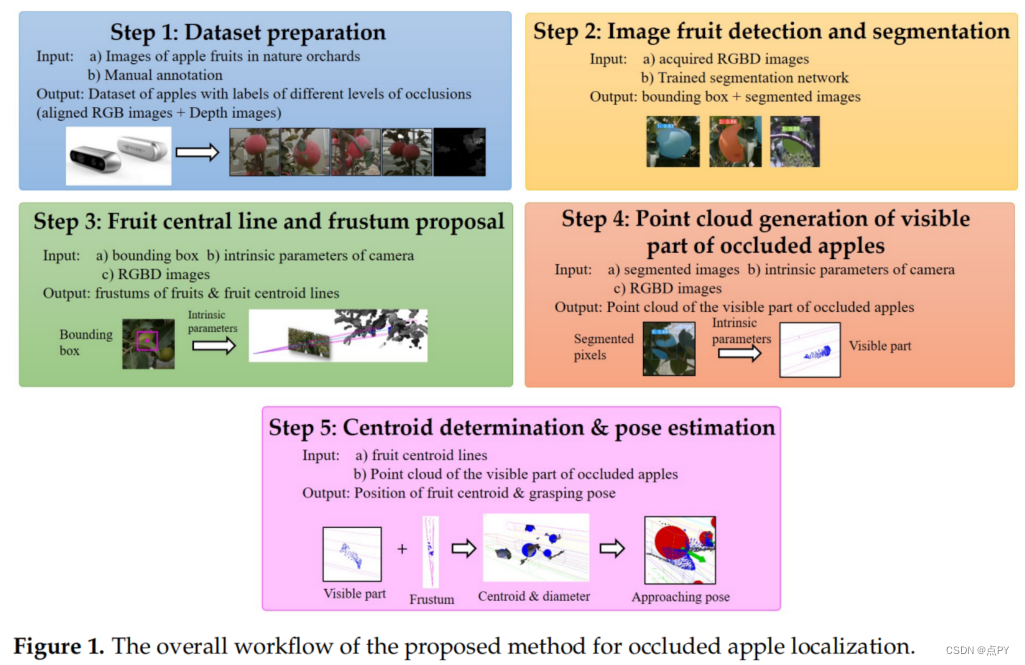

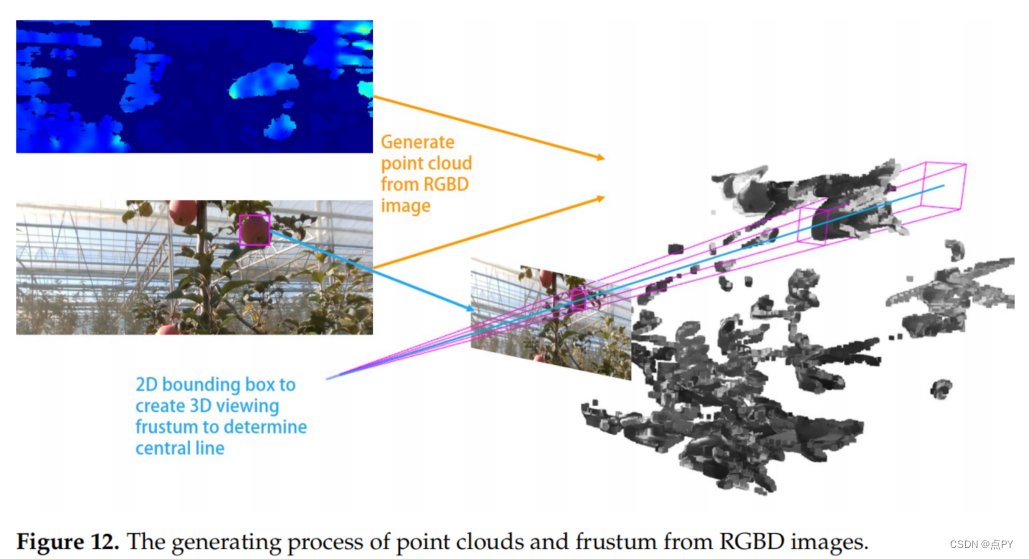

Occluded Apple Fruit Detection and Localization with a Frustum-Based Point-Cloud-Processing Approach for Robotic Harvesting

摘要: 在果园的精确定位是机器人收获的至关重要和具有挑战性的。来自树叶、树枝和其他果实的遮挡使得从红绿蓝深度(RGBD)相机获得的点云不完整。此外,RGBD摄像机的深度图像的填充率不足和噪声往往发生在不被遮挡的阴影下,导致点云的失真和碎片化。这些挑战给机器人收获水果的位置定位和大小估计带来了困难。本文提出了一种基于深度学习分割网络和一种基于水果的点云处理方法的三维水果定位方法。提出了一种单阶段深度学习分割网络,在RGB图像上定位苹果果实。利用掩模和二维边界盒的输出,构建了一个三维观察果体来估算果实中心的深度。通过质心坐标的估计,提出了一种部分遮挡果实的位置和大小估计方法,以确定机器人夹持的接近姿态。在果园中进行了实验,结果证明了该方法的有效性。根据300个测试样本,采用该方法,与传统方法相比,水果位置的中值误差和平均误差分别降低了59%和43%。此外,还可以正确地估计出接近的方向向量。

论文的贡献:

- 利用实例分割网络提供了叶遮挡、鳃遮挡、果实遮挡和非遮挡四种遮挡情况下果实的位置和几何信息;

- 提出了一个点云处理管道来细化部分遮挡果实的三维位置和姿态信息的估计,并为机器人夹具提供三维接近姿态向量。