上期思考题及参考解析

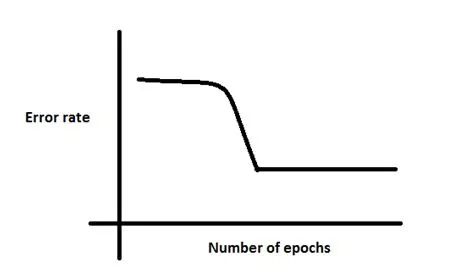

145.在训练神经网络时,损失函数(loss)在最初的几个epochs时没有下降,可能的原因是?()

A 学习率(learning rate)太低

B 正则参数太高

C 陷入局部最小值

D 以上都有可能

答案:(A)

146.下列哪项关于模型能力(model capacity)的描述是正确的?(指神经网络模型能拟合复杂函数的能力)

A 隐藏层层数增加,模型能力增加

B Dropout的比例增加,模型能力增加

C 学习率增加,模型能力增加

D 都不正确

答案:(A)

147.如果增加多层感知机(Multilayer Perceptron)的隐藏层层数,分类误差便会减小。这种陈述正确还是错误?

答案:错误

并不总是正确。过拟合可能会导致错误增加。

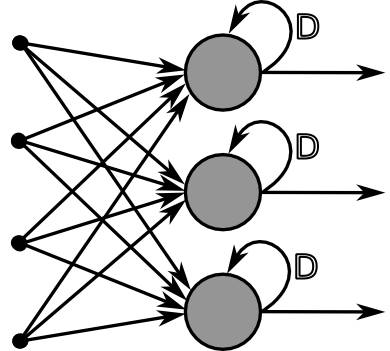

148.构建一个神经网络,将前一层的输出和它自身作为输入。

下列哪一种架构有反馈连接?

A 循环神经网络

B 卷积神经网络

C 限制玻尔兹曼机

D 都不是

答案:(A)

149.下列哪一项在神经网络中引入了非线性?在感知机中(Perceptron)的任务顺序是什么?

1.随机初始化感知机的权重

2.去到数据集的下一批(batch)

3.如果预测值和输出不一致,则调整权重

4.对一个输入样本,计算输出值

答案:1 - 4 - 3 - 2

本期思考题:

150.假设你需要调整参数来最小化代价函数(cost function),可以使用下列哪项技术?

A. 穷举搜索

B. 随机搜索

C. Bayesian优化

D. 以上任意一种

在评论区留言,一起交流探讨,让更多小伙伴受益。

参考答案在明天公众号上公布,敬请关注!