期思考题及参考解析

140.梯度下降算法的正确步骤是什么?

计算预测值和真实值之间的误差

重复迭代,直至得到网络权重的最佳值

把输入传入网络,得到输出值

用随机值初始化权重和偏差

对每一个产生误差的神经元,调整相应的(权重)值以减小误差

答案:正确步骤排序是:4, 3, 1, 5, 2

141.已知:

- 大脑是有很多个叫做神经元的东西构成,神经网络是对大脑的简单的数学表达。

- 每一个神经元都有输入、处理函数和输出。

- 神经元组合起来形成了网络,可以拟合任何函数。

- 为了得到最佳的神经网络,我们用梯度下降方法不断更新模型

给定上述关于神经网络的描述,什么情况下神经网络模型被称为深度学习模型?

A 加入更多层,使神经网络的深度增加

B 有维度更高的数据

C 当这是一个图形识别的问题时

D 以上都不正确

答案:(A)

更多层意味着网络更深。没有严格的定义多少层的模型才叫深度模型,目前如果有超过2层的隐层,那么也可以及叫做深度模型。

142.卷积神经网络可以对一个输入进行多种变换(旋转、平移、缩放),这个表述正确吗?

答案:错误

把数据传入神经网络之前需要做一系列数据预处理(也就是旋转、平移、缩放)工作,神经网络本身不能完成这些变换。

143.下面哪项操作能实现跟神经网络中Dropout的类似效果?

A Boosting

B Bagging

C Stacking

D Mapping

答案:B

Dropout可以认为是一种极端的Bagging,每一个模型都在单独的数据上训练,同时,通过和其他模型对应参数的共享,从而实现模型参数的高度正则化。

144.下列哪一项在神经网络中引入了非线性?

A 随机梯度下降

B 修正线性单元(ReLU)

C 卷积函数

D 以上都不正确

答案:(B)

修正线性单元是非线性的激活函数。

本期思考题:

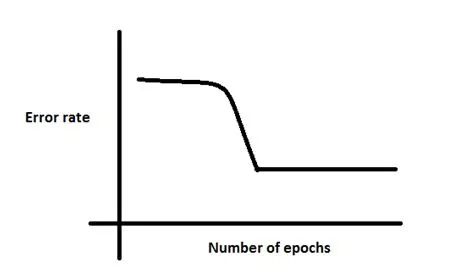

145.在训练神经网络时,损失函数(loss)在最初的几个epochs时没有下降,可能的原因是?()

A 学习率(learning rate)太低

B 正则参数太高

C 陷入局部最小值

D 以上都有可能

在评论区留言,一起交流探讨,让更多小伙伴受益。

参考答案在明天公众号上公布,敬请关注!