文章来源 | 恒源云社区(专注人工智能/深度学习GPU免费加速平台,官方体验网址:https://gpushare.com)

原文地址 | CE-FPN: Enhancing Channel Information forObject Detection(学霸季奖励计划)

声明:该论文本人也只是结合自身理解与翻译软件进行结合,难免会囫囵吞枣或者对原词义表达的南辕北辙,这里我提议一下,对任何paper都要自身亲自结合原文去阅读一篇,以免被翻译者带偏。

CE-FPN: Enhancing Channel Information forObject Detection

摘要

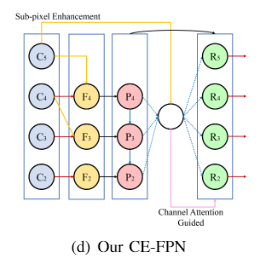

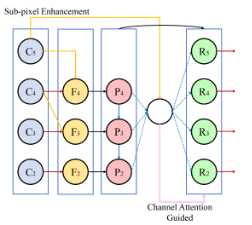

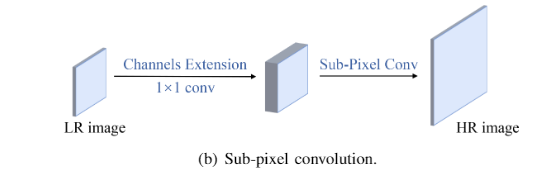

作者提出一种新的特征金字塔,用于改进特征提取。开头依旧是常规的对现有的FPN结构进行缺点说教,从而引出作者的CE-FPN结构。而这里面着重提到一个概念Sub-piexl亚像素卷积,这个概念我也是第一次接触,所以直接转载别人的链接,如果不理解的可以点击链接查看一下。

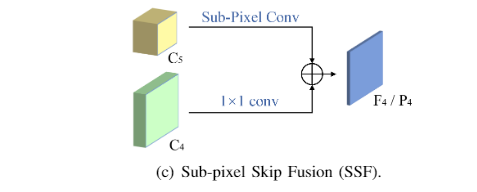

总得来说,受亚像素卷积的启发,作者提出了一种"亚像素跳跃"( a sub-pixel skip fusion)融合方法来实现信道增强和上采样。它取代了原来的1×1卷积和上采样,减少了信道缩减带来的信息损失。

在此基础上,提出了一种子像素上下文增强模块( a sub-pixelcontext enhancement module)来提取更多的特征表示,由于子像素卷积利用了丰富的通道信息,因此优于其他上下文方法。

此外,引入通道注意力引导模块来优化每个层次上的最终综合特征,只需很少的计算量就可以消除混叠效果。我们的实验表明,CE-FPN在MS Coco基准上与最先进的FPN相比获得了很好的性能。

第一章 简介

前面就不做过多描述,无非就是千遍一律的介绍FPN的历史。不过值得注意的就是这里作者提到几种有代表性的FPN结构,感兴趣的可以自行阅读。

[PAFPN](S. Liu, L. Qi, H. Qin, J. Shi, and J. Jia, “Path aggregation network forinstance segmentation,” inProceedings of the IEEE/CVF Conference onComputer Vision and Pattern Recognition, 2018, pp. 8759–8768.)

[Libra R-CNN](. Pang, K. Chen, J. Shi, H. Feng, W. Ouyang, and D. Lin, “Libra r-cnn: Towards balanced learning for object detection,” inProceedings ofthe IEEE/CVF Conference on Computer Vision and Pattern Recognition,2019, pp. 821–830.)

[AugFPN](C. Guo, B. Fan, Q. Zhang, S. Xiang, and C. Pan, “Augfpn: Improvingmulti-scale feature learning for object detection,” inProceedings of theIEEE/CVF Conference on Computer Vision and Pattern Recognition,2020, pp. 12 595–12 604)

另外提到了三个tips:

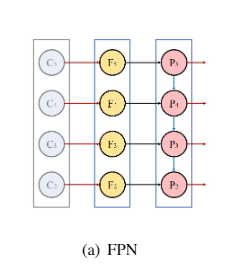

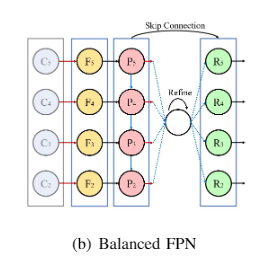

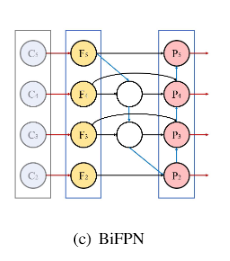

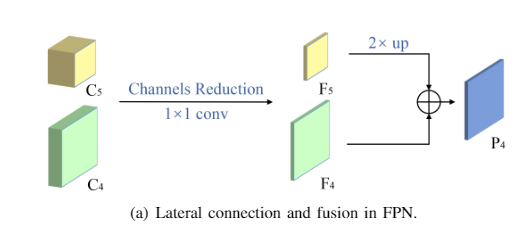

如图(a)所示,FPN的方法是采用1×1卷积层来降低输出特征图Ci的通道维数,但是同时这也丢失了通道信息,通常Ci中提取数千个通道,但是到Fi这就是有十几或者几百。(如2048到256)

现有的方法是(b)(c)两种,再格外的添加模块用来增强Fi信息,但是增加额外的模块又进行复杂连接,会大大增加计算量,这也会导致信息的丢失。所以作者们就提出了(d)。

-

Information decay during fusion

低维度信息和高维度信息对于目标检测来说是互补的,而语义信息在自上而下的特征融合过程中则会被稀释,PAFPN和Libra R-CNN提出了创新的融合方法,以充分利用每个层次上的特征。然而,高层语义任未得到最大程度的利用。利用上下文信息是改进特征表示的一种合适方法,它避免了直接增加更深的卷积层而增加机器的计算量。 -

Aliasing effects in cross-scale fusion

跨尺度融合和跳跃连接被广泛用于提高性能。然而,跨尺度特征映射在语义上存在差异,因此插值后的直接融合可能会造成混合效应。而繁杂的集成特征可能会对定位和识别不准。

作者提出三大改进。

1.受到亚像素卷积的启发,提出来一种亚像素跳跃融合方法,利用原始通道信息进行跨尺度输出。

2.我们提出了一种亚像素上下文增强模块,用于从最高层特征图中提取和整合不同的文本信息。亚像素卷积是一种先增加低分辨率图像信道维数的上采样方法,会带来额外的计算量和不可靠性。值得注意的是,FPN 中的高级特征已经获得了足够的信道量,从而可以直接使用亚像素卷积。该方法取代了原来的1×1卷积和上采样,可以减轻信道信息损失。因此,我们扩展了原有的亚像素卷积上采样函数来融合通道信息,这不同于Carafe。

3.我们提出了一个简单又高效的通道注意力模块,以优化各个层次上的最终特征。注意力模块只用了少量的计算量就减轻了混淆效应。我们将整个模型命名为(CE-FPN),该模型对各种基于FPN的检测器具有灵活性和通用性。

这一段我直接贴原文吧,感觉理解不到位。

第二章 相关工作

紧接着引出了,FPN的历史,FPN是一种自上而下的特征提取,经过PANet改进,添加了一种额外的自下而上的途径,以进一步增加深层中的低级信息。Libra R-cnn引入了平衡特征金字塔,融合和提炼多尺度特征要素。NAS-FPN采用神经结构搜索来学习所有跨尺度连接以达到更好的融合。EfficientDet提出了一种加权的双向FPN来进行简单快速的特征融合,AugFPN提出了一系列的FPN增强方法。(反正就是各比各的好呗)

另外在特征增强方面,上下文信息可以促进定位和分类的执行。PSPnet利用金字塔池来提取全局各层之间的上下文。并提出一种上下文提炼的方法。同时,在各种视觉任务中,通常采用注意机制来增强特征表征。

在上述方法的基础上,重点研究了如何减少FPN构建过程中信道衰落带来的信息损失,并对复杂集成化的层的最终特征进行了优化。

第三章 方法与建议

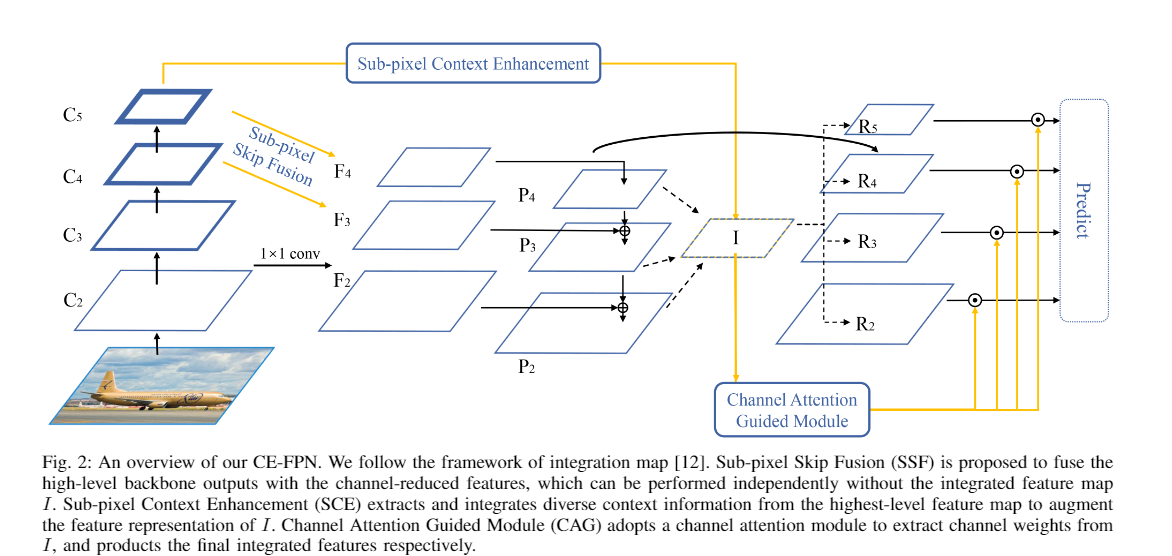

在这一部分中,我们介绍了一种信道增强特征金字塔网络(CE-FPN),以减轻信道信息损失,优化综合特性。在CE-FPN中,提出了三个组成部分:亚像素跳跃融合(SSF)、亚像素上下文增强(SCE)和信道注意引导模块(CAG)。我们将在下面对它们进行详细描述。

overall

我们将主干的输出表示为{ C2,C3,C4,C5} ,它们相对于输入图像具有{4,8,16,32}的像素。

{F2,F3,F4}是经过1×1卷积后具有相同通道数的特征层(256)。

特征金字塔FPN由{P2,P3,P4}自上而下生成。

我们去掉了F5和P5的节点,它们是原始的具有语义信息的FPN的最高层特征。因为我们提出的方法有效地利用了C5的信道信息。重复特征融合不仅会造成更严重的混叠效应,而且会带来不必要的计算负担。这一过程的效果会在第四节中进行了分析。集成映射 I是通过 interpolation和 max-pooling 生成的。并且在所有最终结果{ R2,R3,R4,R5} 上独立地执行预测,这与原始 FPN 的特征金字塔相对应。

sub-pixel skip fusion

在FPN中,残差网络被广泛用作骨架,输出通道为{256,512,1024,2048},其中高层特征{C4,C5}包含丰富的语义信息。如图所示(a),为了提高计算效率,采用1×1卷积层来降低信道维数,造成信道信息的严重丢失。进一步研究的基于FPN的方法一般集中在{256}就是C2通道的特征金字塔上开发有效的模块,而Ci 丰富的通道信息没有得到充分利用。

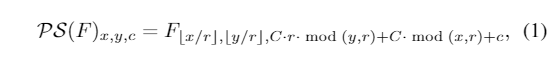

基于这一结果,我们希望可以开发丰富的通道特征{C4,C5}来改善所得到的特征金字塔的性能。为此,我们引入了一种直接融合方法,将低分辨率(LR)特征融合到高分辨率(HR)中,这是一种受亚像素卷积启发的上采样方法,它通过在通道维度上像素混淆来处理宽度和高度维度。像素混洗(The pixel shuffle),是指将H,W进行重新定义。

其中r表示放大比例,F使输入特征,PS(F)xyc表示坐标(x,y,c)上的输出特征像素。

如(b)所示,当使用亚像素卷积作为上采样时,需要首先增加LR图像信道的维数,这带来了额外的计算。并且HR图像不准确,还需要进行额外的训练,因此FPN采用最近邻上采样以简化操作。然而,我们观察到{ C4,C5}(1024,2048)中的通道数量足以进行亚像素卷积,因此,如图(c)所示,

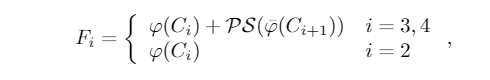

我们引入了亚像素跳过融合(SSF)对LR图像直接进行上采样,而无需减少通道。SSF利用{C4,C5}丰富的信道信息,将它们合并到Fi中,描述为

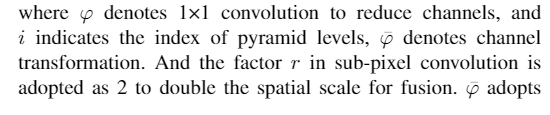

SUB-PIXEL CONTEXT ENHANCEMENT

在传统的FPN中,通过融合高层的信息,低层的特征地图自然地被赋予了不同的上下文信息。但是最高级别的特征只包含单个尺度的上下文信息,不能从其他特征中受益。

另一方面,更高分辨率的输入图像(例如,800像素的较短尺寸)需要具有更大接收野的神经元来获取更多的语义信息来捕获大对象。为了缓解这两个问题,我们采用了集成MAP的框架,并引入了亚像素上下文增强(SCE),以利用C5上更大的接受域来挖掘更多的上下文信息。

SCE的核心思想是融合大域局部信息和全局上下文信息,以生成更具区分性的特征。假设输入特征图C5的形状为2w×2h×8C,输出积分图为4w×4h×C.C为256。我们通过如图所示的并行路径执行三级上下文特征。

首先,我们在C5上应用3×3卷积来提取局部信息。同时,将通道维数变换为亚像素上采样。然后采用亚像素卷积形成双尺度上采样,类似于SSF。

其次,通过3 × 3最大池化将输入特征下采样到 w × h,经过1 × 1卷积层扩展信道尺寸。然后采用4 × 上采样的亚像素卷积算法。该通道为较大的感受野获得丰富的语境信息。

第三,我们在C5上执行全局平均池化,以获取全局上下文信息。然后,将1×1×8C的全局特征压缩到1×1×C,并放大到4w×4h的大小。第一条通道和第三条通道分别提取局部和全局上下文信息。

最后,将生成的三个特征图按映射的方式累加成图 I。SCE通过扩展三个尺度的特征表征,有效地扩大了C5的接受域,细化了 I 的表征能力。因此,FPN充分利用了最高层特征中的语义信息。为简单起见,删除了F5和P5的节点。