1 监控端口数据官方案例

1)案例需求:

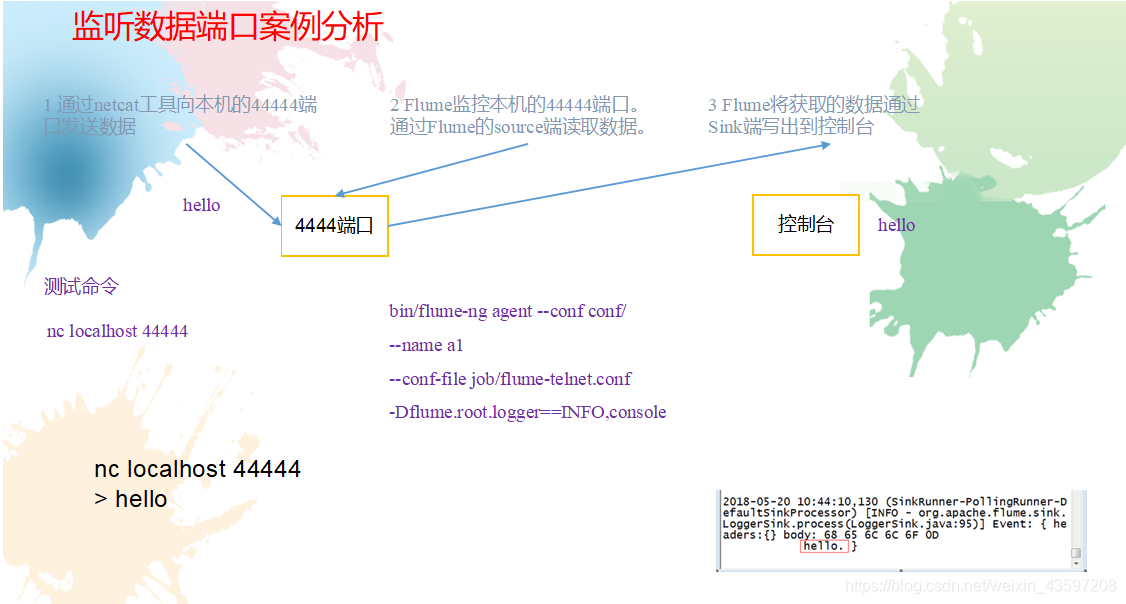

使用Flume监听一个端口,收集该端口数据,并打印到控制台。

2)需求分析:

3)实现步骤:

1.使用的组件

(1)netcat source :作用是监听某个tcp端口收到的数据,将每行封装成一个event

(2)Logger sink :使用logger(日志输出器)将event输出到文件或者控制台

(3)Memory Channel

1.安装netcat工具

[hadoop@hadoop101 software]$ sudo yum install -y nc

2.判断44444端口是否被占用

[hadoop@hadoop101 flume-telnet]$ sudo netstat -tunlp | grep 44444

3.创建Flume Agent配置文件flume-netcat-logger.conf

在flume目录下创建job文件夹并进入job文件夹。

[hadoop@hadoop101 flume]$ mkdir job

[hadoop@hadoop101 flume]$ cd job/

在job文件夹下创建Flume Agent配置文件flume-netcat-logger.conf。

[hadoop@hadoop101 job]$ vim flume-netcat-logger.conf

在flume-netcat-logger.conf文件中添加如下内容。

# Name the components on this agent

a1.sources = r1

a1.sinks = k1

a1.channels = c1

# Describe/configure the source

a1.sources.r1.type = netcat

a1.sources.r1.bind = localhost

a1.sources.r1.port = 44444

# Describe the sink

a1.sinks.k1.type = logger

# Use a channel which buffers events in memory

a1.channels.c1.type = memory

a1.channels.c1.capacity = 1000

a1.channels.c1.transactionCapacity = 100

# Bind the source and sink to the channel

a1.sources.r1.channels = c1

a1.sinks.k1.channel = c1

4.先开启flume监听端口

[hadoop@hadoop101 flume]$ bin/flume-ng agent -c conf/ -n a1 -f job/flume-netcat-logger.conf -Dflume.root.logger=INFO,console

参数说明:

-c:表示配置文件存储在conf/目录

-n:表示给agent起名为a1

-f:flume本次启动读取的配置文件是在job文件夹下的flume-telnet.conf文件。

-Dflume.root.logger=INFO,console :-D表示flume运行时动态修改flume.root.logger参数属性值,并将控制台日志打印级别设置为INFO级别。日志级别包括:log、info、warn、error。

5.使用netcat工具向本机的44444端口发送内容

[hadoop@hadoop101 ~]$ nc localhost 44444

hello

bigdata

6.在Flume监听页面观察接收数据情况