上一篇《SparkSQL快速入门系列(6)》,接下来给大家更新下一篇。

第一章 Spark Streaming引入

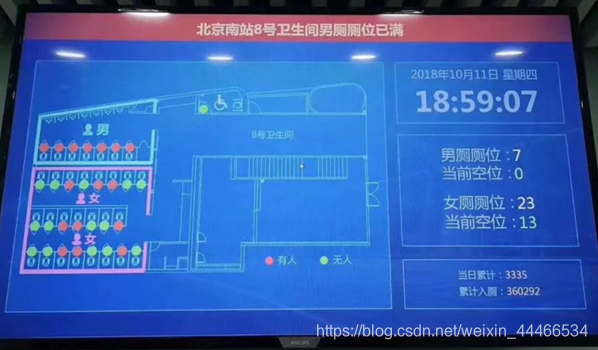

1.1. 新的场景需求

●集群监控

一般的大型集群和平台, 都需要对其进行监控的需求。

要针对各种数据库, 包括 MySQL, HBase 等进行监控

要针对应用进行监控, 例如 Tomcat, Nginx, Node.js 等

要针对硬件的一些指标进行监控, 例如 CPU, 内存, 磁盘 等

●还有很多很多

1.2. Spark Streaming介绍

●官网

http://spark.apache.org/streaming/

●概述

Spark Streaming是一个基于Spark Core之上的实时计算框架,

可以从很多数据源消费数据并对数据进行实时的处理,

具有高吞吐量和容错能力强等特点。

●Spark Streaming的特点

1.易用

可以像编写离线批处理一样去编写流式程序,支持java/scala/python语言。

2.容错

SparkStreaming在没有额外代码和配置的情况下可以恢复丢失的工作。

3.易整合到Spark体系

流式处理与批处理和交互式查询相结合。

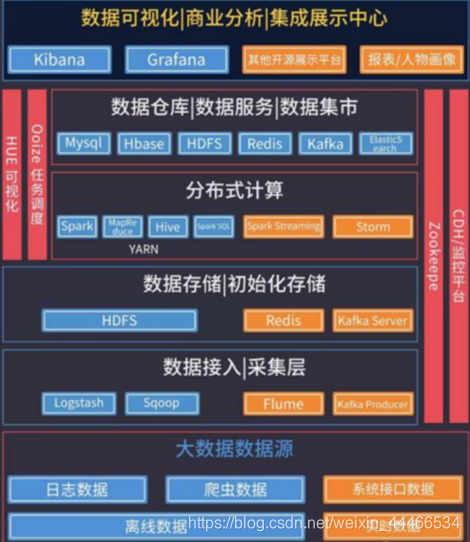

1.3. 实时计算所处的位置

第二章 Spark Streaming原理

2.1. SparkStreaming原理

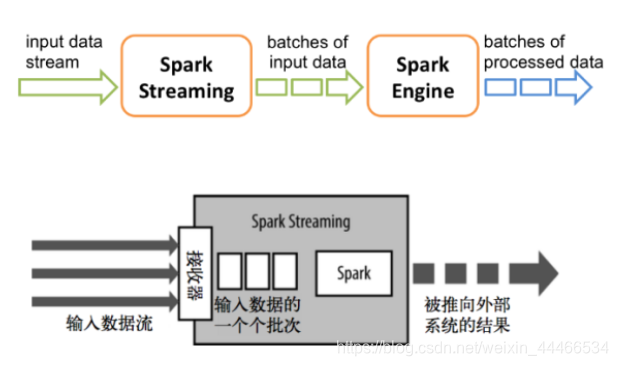

2.1.1. 整体流程

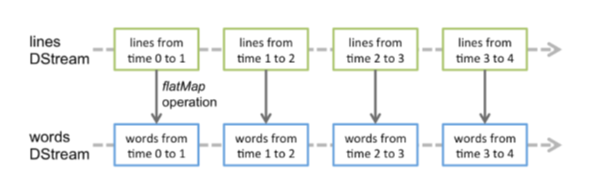

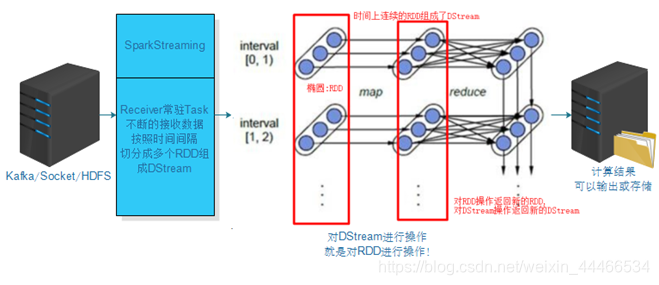

Spark Streaming中,会有一个接收器组件Receiver,作为一个长期运行的task跑在一个Executor上。Receiver接收外部的数据流形成input DStream

DStream会被按照时间间隔划分成一批一批的RDD,当批处理间隔缩短到秒级时,便可以用于处理实时数据流。时间间隔的大小可以由参数指定,一般设在500毫秒到几秒之间。

对DStream进行操作就是对RDD进行操作,计算处理的结果可以传给外部系统。

Spark Streaming的工作流程像下面的图所示一样,接收到实时数据后,给数据分批次,然后传给Spark Engine(引擎)处理最后生成该批次的结果。

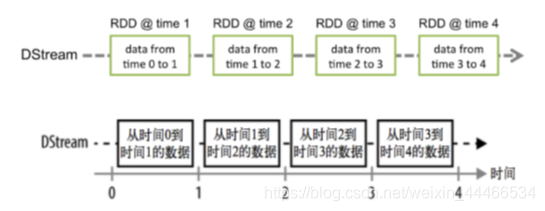

2.1.2. 数据抽象

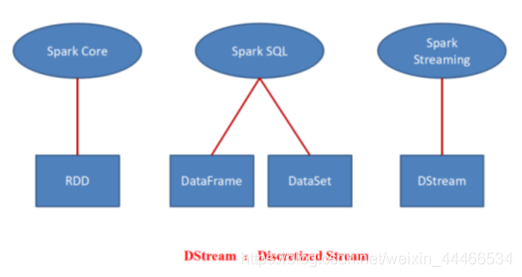

Spark Streaming的基础抽象是DStream(Discretized Stream,离散化数据流,连续不断的数据流),代表持续性的数据流和经过各种Spark算子操作后的结果数据流

●可以从以下多个角度深入理解DStream

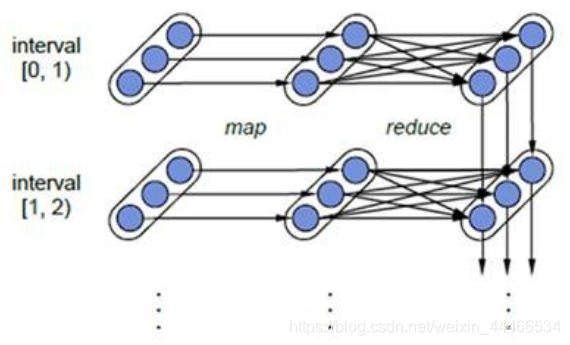

1.DStream本质上就是一系列时间上连续的RDD

2.对DStream的数据的进行操作也是按照RDD为单位来进行的

3.容错性

底层RDD之间存在依赖关系,DStream直接也有依赖关系,RDD具有容错性,那么DStream也具有容错性

如图:每一个椭圆形表示一个RDD

椭圆形中的每个圆形代表一个RDD中的一个Partition分区

每一列的多个RDD表示一个DStream(图中有三列所以有三个DStream)

每一行最后一个RDD则表示每一个Batch Size所产生的中间结果RDD

4.准实时性/近实时性

Spark Streaming将流式计算分解成多个Spark Job,对于每一时间段数据的处理都会经过Spark DAG图分解以及Spark的任务集的调度过程。

对于目前版本的Spark Streaming而言,其最小的Batch Size的选取在0.5~5秒钟之间

所以Spark Streaming能够满足流式准实时计算场景,对实时性要求非常高的如高频实时交易场景则不太适合

●总结

简单来说DStream就是对RDD的封装,你对DStream进行操作,就是对RDD进行操作

对于DataFrame/DataSet/DStream来说本质上都可以理解成RDD

2.2. DStream相关操作

DStream上的操作与RDD的类似,分为以下两种:

Transformations(转换)

Output Operations(输出)/Action

2.2.1. Transformations

●常见Transformation—无状态转换:每个批次的处理不依赖于之前批次的数据

| Transformation | Meaning |

|---|---|

| map(func) | 对DStream中的各个元素进行func函数操作,然后返回一个新的DStream |

| flatMap(func) | 与map方法类似,只不过各个输入项可以被输出为零个或多个输出项 |

| filter(func) | 过滤出所有函数func返回值为true的DStream元素并返回一个新的DStream |

| union(otherStream) | 将源DStream和输入参数为otherDStream的元素合并,并返回一个新的DStream. |

| reduceByKey(func, [numTasks]) | 利用func函数对源DStream中的key进行聚合操作,然后返回新的(K,V)对构成的DStream |

| join(otherStream, [numTasks]) | 输入为(K,V)、(K,W)类型的DStream,返回一个新的(K,(V,W)类型的DStream |

| transform(func) | 通过RDD-to-RDD函数作用于DStream中的各个RDD,可以是任意的RDD操作,从而返回一个新的RDD |

●特殊的Transformations—有状态转换:当前批次的处理需要使用之前批次的数据或者中间结果。

有状态转换包括基于追踪状态变化的转换(updateStateByKey)和滑动窗口的转换

1.UpdateStateByKey(func)

2.Window Operations 窗口操作

2.2.2. Output/Action

Output Operations可以将DStream的数据输出到外部的数据库或文件系统

当某个Output Operations被调用时,spark streaming程序才会开始真正的计算过程(与RDD的Action类似)

| Output Operation | Meaning |

|---|---|

| print() | 打印到控制台 |

| saveAsTextFiles(prefix, [suffix]) | 保存流的内容为文本文件,文件名为"prefix-TIME_IN_MS[.suffix]". |

| saveAsObjectFiles(prefix,[suffix]) | 保存流的内容为SequenceFile,文件名为 “prefix-TIME_IN_MS[.suffix]”. |

| saveAsHadoopFiles(prefix,[suffix]) | 保存流的内容为hadoop文件,文件名为"prefix-TIME_IN_MS[.suffix]". |

| foreachRDD(func) | 对Dstream里面的每个RDD执行func |

2.3. 总结

第三章 Spark Streaming实战

3.1. WordCount

3.1.1. 需求&准备

●图解

●首先在linux服务器上安装nc工具

nc是netcat的简称,原本是用来设置路由器,我们可以利用它向某个端口发送数据

yum install -y nc

●启动一个服务端并开放9999端口,等一下往这个端口发数据

nc -lk 9999

●发送数据

3.1.2. 代码演示

package cn.itcast.streaming

import org.apache.spark.streaming.dstream.{DStream, ReceiverInputDStream}

import org.apache.spark.{SparkConf, SparkContext}

import org.apache.spark.streaming.{Seconds, StreamingContext}

object WordCount {

def main(args: Array[String]): Unit = {

//1.创建StreamingContext

//spark.master should be set as local[n], n > 1

val conf = new SparkConf().setAppName("wc").setMaster("local[*]")

val sc = new SparkContext(conf)

sc.setLogLevel("WARN")

val ssc = new StreamingContext(sc,Seconds(5))//5表示5秒中对数据进行切分形成一个RDD

//2.监听Socket接收数据

//ReceiverInputDStream就是接收到的所有的数据组成的RDD,封装成了DStream,接下来对DStream进行操作就是对RDD进行操作

val dataDStream: ReceiverInputDStream[String] = ssc.socketTextStream("node01",9999)

//3.操作数据

val wordDStream: DStream[String] = dataDStream.flatMap(_.split(" "))

val wordAndOneDStream: DStream[(String, Int)] = wordDStream.map((_,1))

val wordAndCount: DStream[(String, Int)] = wordAndOneDStream.reduceByKey(_+_)

wordAndCount.print()

ssc.start()//开启

ssc.awaitTermination()//等待停止

}

}

3.1.3. 执行

1.先执行nc -lk 9999

2.然后执行代码

3.不断的在1中输入不同的单词

hadoop spark sqoop hadoop spark hive hadoop

4.观察IDEA控制台输出

sparkStreaming每隔5s计算一次当前5s内的数据,然后将每个批次的数据输出

3.2. updateStateByKey

3.2.1. 问题

在上面的那个案例中存在这样一个问题:

每个批次的单词次数都被正确的统计出来,但是结果不能累加!

如果需要累加需要使用 updateStateByKey(func) 来更新状态.

3.2.2. 代码演示

package cn.itcast.streaming

import org.apache.spark.streaming.dstream.{DStream, ReceiverInputDStream}

import org.apache.spark.streaming.{Seconds, StreamingContext}

import org.apache.spark.{SparkConf, SparkContext}

object WordCount2 {

def main(args: Array[String]): Unit = {

//1.创建StreamingContext

//spark.master should be set as local[n], n > 1

val conf = new SparkConf().setAppName("wc").setMaster("local[*]")

val sc = new SparkContext(conf)

sc.setLogLevel("WARN")

val ssc = new StreamingContext(sc,Seconds(5))//5表示5秒中对数据进行切分形成一个RDD

//requirement failed: ....Please set it by StreamingContext.checkpoint().

//注意:我们在下面使用到了updateStateByKey对当前数据和历史数据进行累加

//那么历史数据存在哪?我们需要给他设置一个checkpoint目录

ssc.checkpoint("./wc")//开发中HDFS

//2.监听Socket接收数据

//ReceiverInputDStream就是接收到的所有的数据组成的RDD,封装成了DStream,接下来对DStream进行操作就是对RDD进行操作

val dataDStream: ReceiverInputDStream[String] = ssc.socketTextStream("node01",9999)

//3.操作数据

val wordDStream: DStream[String] = dataDStream.flatMap(_.split(" "))

val wordAndOneDStream: DStream[(String, Int)] = wordDStream.map((_,1))

//val wordAndCount: DStream[(String, Int)] = wordAndOneDStream.reduceByKey(_+_)

//====================使用updateStateByKey对当前数据和历史数据进行累加====================

val wordAndCount: DStream[(String, Int)] =wordAndOneDStream.updateStateByKey(updateFunc)

wordAndCount.print()

ssc.start()//开启

ssc.awaitTermination()//等待优雅停止

}

//currentValues:当前批次的value值,如:1,1,1 (以测试数据中的hadoop为例)

//historyValue:之前累计的历史值,第一次没有值是0,第二次是3

//目标是把当前数据+历史数据返回作为新的结果(下次的历史数据)

def updateFunc(currentValues:Seq[Int], historyValue:Option[Int] ):Option[Int] ={

// currentValues当前值

// historyValue历史值

val result: Int = currentValues.sum + historyValue.getOrElse(0)

Some(result)

}

}

3.2.3. 执行

1.先执行nc -lk 9999

2.然后执行以上代码

3.不断的在1中输入不同的单词,

hadoop spark sqoop hadoop spark hive hadoop

4.观察IDEA控制台输出

sparkStreaming每隔5s计算一次当前5s内的数据,然后将每个批次的结果数据累加输出。

3.3. reduceByKeyAndWindow

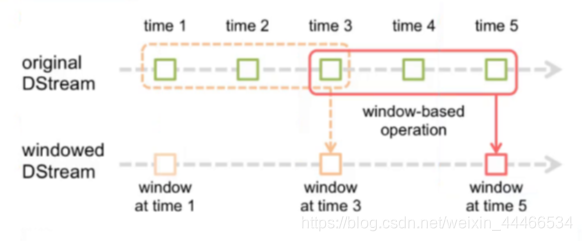

3.3.1. 图解

在短时间范围内去计算一个周期性频繁的一个大的时间段的这样的一个结果,这样的一个需求,用窗口函数很快就可以解决了。

滑动窗口转换操作的计算过程如下图所示,

我们可以事先设定一个滑动窗口的长度(也就是窗口的持续时间),并且设定滑动窗口的时间间隔(每隔多长时间执行一次计算),

比如设置滑动窗口的长度(也就是窗口的持续时间)为24H,设置滑动窗口的时间间隔(每隔多长时间执行一次计算)为1H

那么意思就是:每隔1H计算最近24H的数据

3.3.2. 代码演示

package cn.itcast.streaming

import org.apache.spark.streaming.dstream.{DStream, ReceiverInputDStream}

import org.apache.spark.streaming.{Seconds, StreamingContext}

import org.apache.spark.{SparkConf, SparkContext}

object WordCount3 {

def main(args: Array[String]): Unit = {

//1.创建StreamingContext

//spark.master should be set as local[n], n > 1

val conf = new SparkConf().setAppName("wc").setMaster("local[*]")

val sc = new SparkContext(conf)

sc.setLogLevel("WARN")

val ssc = new StreamingContext(sc,Seconds(5))//5表示5秒中对数据进行切分形成一个RDD

//2.监听Socket接收数据

//ReceiverInputDStream就是接收到的所有的数据组成的RDD,封装成了DStream,接下来对DStream进行操作就是对RDD进行操作

val dataDStream: ReceiverInputDStream[String] = ssc.socketTextStream("node01",9999)

//3.操作数据

val wordDStream: DStream[String] = dataDStream.flatMap(_.split(" "))

val wordAndOneDStream: DStream[(String, Int)] = wordDStream.map((_,1))

val wordAndCount: DStream[(String, Int)] = wordAndOneDStream.reduceByKeyAndWindow((a:Int,b:Int)=>a+b,Seconds(10),Seconds(5))

//4.使用窗口函数进行WordCount计数

//reduceFunc: (V, V) => V,集合函数

//windowDuration: Duration,窗口长度/宽度

//slideDuration: Duration,窗口滑动间隔

//注意:windowDuration和slideDuration必须是batchDuration的倍数

//windowDuration=slideDuration:数据不会丢失也不会重复计算==开发中会使用

//windowDuration>slideDuration:数据会重复计算==开发中会使用

//windowDuration<slideDuration:数据会丢失

//代码表示:

//windowDuration=10

//slideDuration=5

//那么执行结果就是每隔5s计算最近10s的数据

//比如开发中让你统计最近1小时的数据,每隔1分钟计算一次,那么参数该如何设置?

wordAndCount.print()

ssc.start()//开启

ssc.awaitTermination()//等待优雅停止

}

}

3.3.3. 执行

1.先执行nc -lk 9999

2.然后执行以上代码

3.不断的在1中输入不同的单词

hadoop spark sqoop hadoop spark hive hadoop

4.观察IDEA控制台输出

现象:sparkStreaming每隔5s计算一次当前在窗口大小为10s内的数据,然后将结果数据输出。

3.4. 统计一定时间内的热门词汇TopN

3.4.1. 需求

模拟百度热搜排行榜

统计最近10s的热搜词Top3,每隔5秒计算一次

WindowDuration = 10s

SlideDuration = 5s

3.4.2. 代码演示

package cn.itcast.streaming

import org.apache.spark.rdd.RDD

import org.apache.spark.streaming.dstream.{DStream, ReceiverInputDStream}

import org.apache.spark.streaming.{Seconds, StreamingContext}

import org.apache.spark.{SparkConf, SparkContext}

/*

* Desc 我们要模拟百度热搜排行榜统计最近10s的热搜词Top3,每隔5秒计算一次

*/

object WordCount4 {

def main(args: Array[String]): Unit = {

//1.创建StreamingContext

//spark.master should be set as local[n], n > 1

val conf = new SparkConf().setAppName("wc").setMaster("local[*]")

val sc = new SparkContext(conf)

sc.setLogLevel("WARN")

val ssc = new StreamingContext(sc,Seconds(5))//5表示5秒中对数据进行切分形成一个RDD

//2.监听Socket接收数据

//ReceiverInputDStream就是接收到的所有的数据组成的RDD,封装成了DStream,接下来对DStream进行操作就是对RDD进行操作

val dataDStream: ReceiverInputDStream[String] = ssc.socketTextStream("node01",9999)

//3.操作数据

val wordDStream: DStream[String] = dataDStream.flatMap(_.split(" "))

val wordAndOneDStream: DStream[(String, Int)] = wordDStream.map((_,1))

//4.使用窗口函数进行WordCount计数

val wordAndCount: DStream[(String, Int)] = wordAndOneDStream.reduceByKeyAndWindow((a:Int,b:Int)=>a+b,Seconds(10),Seconds(5))

val sorteDStream: DStream[(String, Int)] = wordAndCount.transform(rdd => {

val sortedRDD: RDD[(String, Int)] = rdd.sortBy(_._2, false) //逆序/降序

println("===============top3==============")

sortedRDD.take(3).foreach(println)

println("===============top3==============")

sortedRDD

}

)

//No output operations registered, so nothing to execute

sorteDStream.print

ssc.start()//开启

ssc.awaitTermination()//等待优雅停止

}

}

3.4.3. 执行

1.先执行nc -lk 9999

2.然后在执行以上代码

3.不断的在1中输入不同的单词

hadoop spark sqoop hadoop spark hive hadoop

4.观察IDEA控制台输出

第四章 整合kafka

4.1. Kafka快速回顾

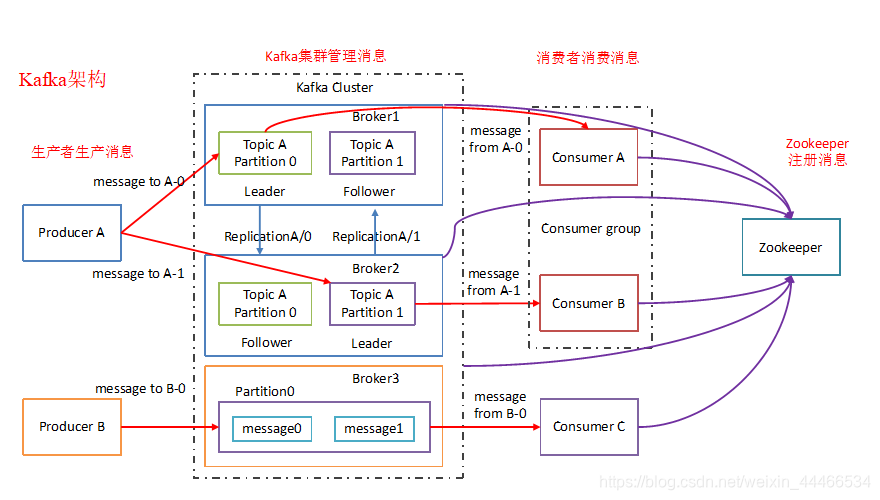

●核心概念图解

Broker : 安装Kafka服务的机器就是一个broker

Producer :消息的生产者,负责将数据写入到broker中(push)

Consumer:消息的消费者,负责从kafka中拉取数据(pull),老版本的消费者需要依赖zk,新版本的不需要

Topic: 主题,相当于是数据的一个分类,不同topic存放不同业务的数据 --主题:区分业务

Replication:副本,数据保存多少份(保证数据不丢失) --副本:数据安全

Partition:分区,是一个物理的分区,一个分区就是一个文件,一个Topic可以有1~n个分区,每个分区都有自己的副本 --分区:并发读写

Consumer Group:消费者组,一个topic可以有多个消费者/组同时消费,多个消费者如果在一个消费者组中,那么他们不能重复消费数据 --消费者组:提高消费者消费速度、方便统一管理

注意:一个Topic可以被多个消费者或者组订阅,一个消费者/组也可以订阅多个主题

注意:读数据只能从Leader读, 写数据也只能往Leader写,Follower会从Leader那里同步数据过来做副本!!!

●常用命令

#启动kafka

/export/servers/kafka/bin/kafka-server-start.sh -daemon

/export/servers/kafka/config/server.properties

#停止kafka

/export/servers/kafka/bin/kafka-server-stop.sh

#查看topic信息

/export/servers/kafka/bin/kafka-topics.sh --list --zookeeper node01:2181

#创建topic

/export/servers/kafka/bin/kafka-topics.sh --create --zookeeper node01:2181 --replication-factor 3 --partitions 3 --topic test

#查看某个topic信息

/export/servers/kafka/bin/kafka-topics.sh --describe --zookeeper node01:2181 --topic test

#删除topic

/export/servers/kafka/bin/kafka-topics.sh --zookeeper node01:2181 --delete --topic test

#启动生产者--控制台的生产者一般用于测试

/export/servers/kafka/bin/kafka-console-producer.sh --broker-list node01:9092 --topic spark_kafka

#启动消费者--控制台的消费者一般用于测试

/export/servers/kafka/bin/kafka-console-consumer.sh --zookeeper node01:2181 --topic spark_kafka--from-beginning

消费者连接到borker的地址

/export/servers/kafka/bin/kafka-console-consumer.sh --bootstrap-server node01:9092,node02:9092,node03:9092 --topic spark_kafka --from-beginning

4.2. 整合Kafka两种模式说明

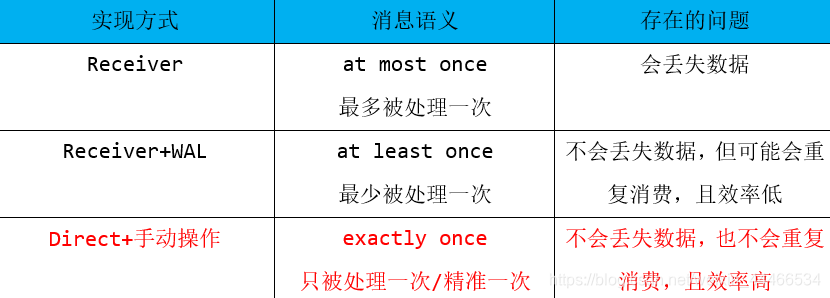

★面试题:Receiver & Direct

开发中我们经常会利用SparkStreaming实时地读取kafka中的数据然后进行处理,在spark1.3版本后,kafkaUtils里面提供了两种创建DStream的方法:

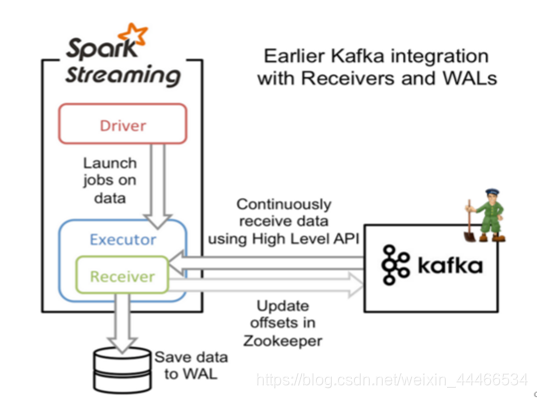

1.Receiver接收方式:

KafkaUtils.createDstream(开发中不用,了解即可,但是面试可能会问)

Receiver作为常驻的Task运行在Executor等待数据,但是一个Receiver效率低,需要开启多个,再手动合并数据(union),再进行处理,很麻烦

Receiver哪台机器挂了,可能会丢失数据,所以需要开启WAL(预写日志)保证数据安全,那么效率又会降低!

Receiver方式是通过zookeeper来连接kafka队列,调用Kafka高阶API,offset存储在zookeeper,由Receiver维护,

spark在消费的时候为了保证数据不丢也会在Checkpoint中存一份offset,可能会出现数据不一致

所以不管从何种角度来说,Receiver模式都不适合在开发中使用了,已经淘汰了

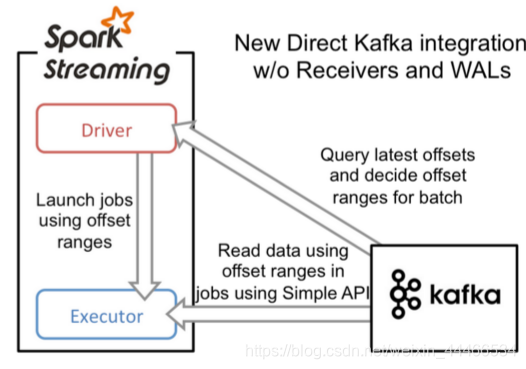

2.Direct直连方式:

KafkaUtils.createDirectStream(开发中使用,要求掌握)

Direct方式是直接连接kafka分区来获取数据,从每个分区直接读取数据大大提高了并行能力

Direct方式调用Kafka低阶API(底层API),offset自己存储和维护,默认由Spark维护在checkpoint中,消除了与zk不一致的情况

当然也可以自己手动维护,把offset存在mysql、redis中

所以基于Direct模式可以在开发中使用,且借助Direct模式的特点+手动操作可以保证数据的Exactly once 精准一次

总结:

Receiver接收方式

1、 多个Receiver接受数据效率高,但有丢失数据的风险。

2、 开启日志(WAL)可防止数据丢失,但写两遍数据效率低。

3、 Zookeeper维护offset有重复消费数据可能。

4、 使用高层次的API

Direct直连方式

1、 不使用Receiver,直接到kafka分区中读取数据

2、 不使用日志(WAL)机制。

3、 Spark自己维护offset

4、 使用低层次的API

●扩展:关于消息语义

●注意:

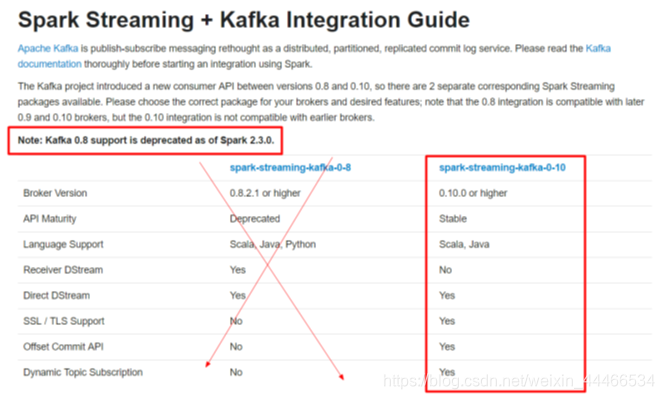

开发中SparkStreaming和kafka集成有两个版本:0.8及0.10+

0.8版本有Receiver和Direct模式(但是0.8版本生产环境问题较多,在Spark2.3之后不支持0.8版本了)

0.10以后只保留了direct模式(Reveiver模式不适合生产环境),并且0.10版本API有变化(更加强大)

●结论:

我们学习和开发都直接使用0.10版本中的direct模式

但是关于Receiver和Direct的区别面试的时候要能够答得上来

4.3. spark-streaming-kafka-0-8(了解)

4.3.1. Receiver

KafkaUtils.createDstream使用了receivers来接收数据,利用的是Kafka高层次的消费者api,偏移量由Receiver维护在zk中,对于所有的receivers接收到的数据将会保存在Spark executors中,然后通过Spark Streaming启动job来处理这些数据,默认会丢失,可启用WAL日志,它同步将接受到数据保存到分布式文件系统上比如HDFS。保证数据在出错的情况下可以恢复出来。尽管这种方式配合着WAL机制可以保证数据零丢失的高可靠性,但是启用了WAL效率会较低,且无法保证数据被处理一次且仅一次,可能会处理两次。因为Spark和ZooKeeper之间可能是不同步的。

官方现在已经不推荐这种整合方式

准备工作

1.启动zookeeper集群

zkServer.sh start

2.启动kafka集群

kafka-server-start.sh /export/servers/kafka/config/server.properties

3.创建topic

kafka-topics.sh --create --zookeeper node01:2181 --replication-factor 1 --partitions 3 --topic spark_kafka

4.通过shell命令向topic发送消息

kafka-console-producer.sh --broker-list node01:9092 --topic spark_kafka

hadoop spark sqoop hadoop spark hive hadoop

5.添加kafka的pom依赖

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-streaming-kafka-0-8_2.11</artifactId>

<version>2.2.0</version>

</dependency>

API

通过receiver接收器获取kafka中topic数据,可以并行运行更多的接收器读取kafak topic中的数据,这里为3个

val receiverDStream: immutable.IndexedSeq[ReceiverInputDStream[(String, String)]] = (1 to 3).map(x => {

val stream: ReceiverInputDStream[(String, String)] = KafkaUtils.createStream(ssc, zkQuorum, groupId, topics)

stream

})

如果启用了WAL(spark.streaming.receiver.writeAheadLog.enable=true)可以设置存储级别(默认StorageLevel.MEMORY_AND_DISK_SER_2)

代码演示

package cn.itcast.streaming

import org.apache.spark.streaming.dstream.{DStream, ReceiverInputDStream}

import org.apache.spark.streaming.kafka.KafkaUtils

import org.apache.spark.streaming.{Seconds, StreamingContext}

import org.apache.spark.{SparkConf, SparkContext}

import scala.collection.immutable

object SparkKafka {

def main(args: Array[String]): Unit = {

//1.创建StreamingContext

val config: SparkConf =

new SparkConf().setAppName("SparkStream").setMaster("local[*]")

.set("spark.streaming.receiver.writeAheadLog.enable", "true")

//开启WAL预写日志,保证数据源端可靠性

val sc = new SparkContext(config)

sc.setLogLevel("WARN")

val ssc = new StreamingContext(sc,Seconds(5))

ssc.checkpoint("./kafka")

//==============================================

//2.准备配置参数

val zkQuorum = "node01:2181,node02:2181,node03:2181"

val groupId = "spark"

val topics = Map("spark_kafka" -> 2)//2表示每一个topic对应分区都采用2个线程去消费,

//ssc的rdd分区和kafka的topic分区不一样,增加消费线程数,并不增加spark的并行处理数据数量

//3.通过receiver接收器获取kafka中topic数据,可以并行运行更多的接收器读取kafak topic中的数据,这里为3个

val receiverDStream: immutable.IndexedSeq[ReceiverInputDStream[(String, String)]] = (1 to 3).map(x => {

val stream: ReceiverInputDStream[(String, String)] = KafkaUtils.createStream(ssc, zkQuorum, groupId, topics)

stream

})

//4.使用union方法,将所有receiver接受器产生的Dstream进行合并

val allDStream: DStream[(String, String)] = ssc.union(receiverDStream)

//5.获取topic的数据(String, String) 第1个String表示topic的名称,第2个String表示topic的数据

val data: DStream[String] = allDStream.map(_._2)

//==============================================

//6.WordCount

val words: DStream[String] = data.flatMap(_.split(" "))

val wordAndOne: DStream[(String, Int)] = words.map((_, 1))

val result: DStream[(String, Int)] = wordAndOne.reduceByKey(_ + _)

result.print()

ssc.start()

ssc.awaitTermination()

}

}

4.3.2. Direct

Direct方式会定期地从kafka的topic下对应的partition中查询最新的偏移量,再根据偏移量范围在每个batch里面处理数据,Spark通过调用kafka简单的消费者API读取一定范围的数据。

Direct的缺点是无法使用基于zookeeper的kafka监控工具

Direct相比基于Receiver方式有几个优点

简化并行

不需要创建多个kafka输入流,然后union它们,sparkStreaming将会创建和kafka分区数一样的rdd的分区数,而且会从kafka中并行读取数据,spark中RDD的分区数和kafka中的分区数据是一一对应的关系。

高效

Receiver实现数据的零丢失是将数据预先保存在WAL中,会复制一遍数据,会导致数据被拷贝两次,第一次是被kafka复制,另一次是写到WAL中。而Direct不使用WAL消除了这个问题。

恰好一次语义(Exactly-once-semantics)

Receiver读取kafka数据是通过kafka高层次api把偏移量写入zookeeper中,虽然这种方法可以通过数据保存在WAL中保证数据不丢失,但是可能会因为sparkStreaming和ZK中保存的偏移量不一致而导致数据被消费了多次。

Direct的Exactly-once-semantics(EOS)通过实现kafka低层次api,偏移量仅仅被ssc保存在checkpoint中,消除了zk和ssc偏移量不一致的问题。

API

KafkaUtils.createDirectStream[String, String, StringDecoder, StringDecoder](ssc, kafkaParams, topics)

== 代码演示==

package cn.itcast.streaming

import kafka.serializer.StringDecoder

import org.apache.spark.streaming.dstream.{DStream, InputDStream}

import org.apache.spark.streaming.kafka.KafkaUtils

import org.apache.spark.streaming.{Seconds, StreamingContext}

import org.apache.spark.{SparkConf, SparkContext}

object SparkKafka2 {

def main(args: Array[String]): Unit = {

//1.创建StreamingContext

val config: SparkConf =

new SparkConf().setAppName("SparkStream").setMaster("local[*]")

val sc = new SparkContext(config)

sc.setLogLevel("WARN")

val ssc = new StreamingContext(sc,Seconds(5))

ssc.checkpoint("./kafka")

//==============================================

//2.准备配置参数

val kafkaParams = Map("metadata.broker.list" -> "node01:9092,node02:9092,node03:9092", "group.id" -> "spark")

val topics = Set("spark_kafka")

val allDStream: InputDStream[(String, String)] = KafkaUtils.createDirectStream[String, String, StringDecoder, StringDecoder](ssc, kafkaParams, topics)

//3.获取topic的数据

val data: DStream[String] = allDStream.map(_._2)

//==============================================

//WordCount

val words: DStream[String] = data.flatMap(_.split(" "))

val wordAndOne: DStream[(String, Int)] = words.map((_, 1))

val result: DStream[(String, Int)] = wordAndOne.reduceByKey(_ + _)

result.print()

ssc.start()

ssc.awaitTermination()

}

}

4.4. spark-streaming-kafka-0-10

●说明

spark-streaming-kafka-0-10版本中,API有一定的变化,操作更加灵活,开发中使用

●pom.xml

<!--<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-streaming-kafka-0-8_2.11</artifactId>

<version>${spark.version}</version>

</dependency>-->

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-streaming-kafka-0-10_2.11</artifactId>

<version>${spark.version}</version>

</dependency>

●API

http://spark.apache.org/docs/latest/streaming-kafka-0-10-integration.html

●创建topic

/export/servers/kafka/bin/kafka-topics.sh --create --zookeeper node01:2181 --replication-factor 3 --partitions 3 --topic spark_kafka

●启动生产者

/export/servers/kafka/bin/kafka-console-producer.sh --broker-list node01:9092,node01:9092,node01:9092 --topic spark_kafka

●代码演示

package cn.itcast.streaming

import org.apache.kafka.clients.consumer.ConsumerRecord

import org.apache.kafka.common.serialization.StringDeserializer

import org.apache.spark.streaming.dstream.{DStream, InputDStream}

import org.apache.spark.streaming.kafka010.{ConsumerStrategies, KafkaUtils, LocationStrategies}

import org.apache.spark.streaming.{Seconds, StreamingContext}

import org.apache.spark.{SparkConf, SparkContext}

object SparkKafkaDemo {

def main(args: Array[String]): Unit = {

//1.创建StreamingContext

//spark.master should be set as local[n], n > 1

val conf = new SparkConf().setAppName("wc").setMaster("local[*]")

val sc = new SparkContext(conf)3

sc.setLogLevel("WARN")

val ssc = new StreamingContext(sc,Seconds(5))//5表示5秒中对数据进行切分形成一个RDD

//准备连接Kafka的参数

val kafkaParams = Map[String, Object](

"bootstrap.servers" -> "node01:9092,node02:9092,node03:9092",

"key.deserializer" -> classOf[StringDeserializer],

"value.deserializer" -> classOf[StringDeserializer],

"group.id" -> "SparkKafkaDemo",

//earliest:当各分区下有已提交的offset时,从提交的offset开始消费;无提交的offset时,从头开始消费

//latest:当各分区下有已提交的offset时,从提交的offset开始消费;无提交的offset时,消费新产生的该分区下的数据

//none:topic各分区都存在已提交的offset时,从offset后开始消费;只要有一个分区不存在已提交的offset,则抛出异常

//这里配置latest自动重置偏移量为最新的偏移量,即如果有偏移量从偏移量位置开始消费,没有偏移量从新来的数据开始消费

"auto.offset.reset" -> "latest",

//false表示关闭自动提交.由spark帮你提交到Checkpoint或程序员手动维护

"enable.auto.commit" -> (false: java.lang.Boolean)

)

val topics = Array("spark_kafka")

//2.使用KafkaUtil连接Kafak获取数据

val recordDStream: InputDStream[ConsumerRecord[String, String]] = KafkaUtils.createDirectStream[String, String](ssc,

LocationStrategies.PreferConsistent,//位置策略,源码强烈推荐使用该策略,会让Spark的Executor和Kafka的Broker均匀对应

ConsumerStrategies.Subscribe[String, String](topics, kafkaParams))//消费策略,源码强烈推荐使用该策略

//3.获取VALUE数据

val lineDStream: DStream[String] = recordDStream.map(_.value())//_指的是ConsumerRecord

val wrodDStream: DStream[String] = lineDStream.flatMap(_.split(" ")) //_指的是发过来的value,即一行数据

val wordAndOneDStream: DStream[(String, Int)] = wrodDStream.map((_,1))

val result: DStream[(String, Int)] = wordAndOneDStream.reduceByKey(_+_)

result.print()

ssc.start()//开启

ssc.awaitTermination()//等待优雅停止

}

}

4.5. 扩展:Kafka手动维护偏移量

●API

http://spark.apache.org/docs/latest/streaming-kafka-0-10-integration.html

●启动生产者

/export/servers/kafka/bin/kafka-console-producer.sh --broker-list node01:9092,node01:9092,node01:9092 --topic spark_kafka

●代码演示

package cn.itcast.streaming

import java.sql.{DriverManager, ResultSet}

import org.apache.kafka.clients.consumer.ConsumerRecord

import org.apache.kafka.common.TopicPartition

import org.apache.kafka.common.serialization.StringDeserializer

import org.apache.spark.streaming.dstream.InputDStream

import org.apache.spark.streaming.kafka010.{OffsetRange, _}

import org.apache.spark.streaming.{Seconds, StreamingContext}

import org.apache.spark.{SparkConf, SparkContext}

import scala.collection.mutable

object SparkKafkaDemo2 {

def main(args: Array[String]): Unit = {

//1.创建StreamingContext

//spark.master should be set as local[n], n > 1

val conf = new SparkConf().setAppName("wc").setMaster("local[*]")

val sc = new SparkContext(conf)

sc.setLogLevel("WARN")

val ssc = new StreamingContext(sc,Seconds(5))//5表示5秒中对数据进行切分形成一个RDD

//准备连接Kafka的参数

val kafkaParams = Map[String, Object](

"bootstrap.servers" -> "node01:9092,node02:9092,node03:9092",

"key.deserializer" -> classOf[StringDeserializer],

"value.deserializer" -> classOf[StringDeserializer],

"group.id" -> "SparkKafkaDemo",

"auto.offset.reset" -> "latest",

"enable.auto.commit" -> (false: java.lang.Boolean)

)

val topics = Array("spark_kafka")

//2.使用KafkaUtil连接Kafak获取数据

//注意:

//如果MySQL中没有记录offset,则直接连接,从latest开始消费

//如果MySQL中有记录offset,则应该从该offset处开始消费

val offsetMap: mutable.Map[TopicPartition, Long] = OffsetUtil.getOffsetMap("SparkKafkaDemo","spark_kafka")

val recordDStream: InputDStream[ConsumerRecord[String, String]] = if(offsetMap.size > 0){//有记录offset

println("MySQL中记录了offset,则从该offset处开始消费")

KafkaUtils.createDirectStream[String, String](ssc,

LocationStrategies.PreferConsistent,//位置策略,源码强烈推荐使用该策略,会让Spark的Executor和Kafka的Broker均匀对应

ConsumerStrategies.Subscribe[String, String](topics, kafkaParams,offsetMap))//消费策略,源码强烈推荐使用该策略

}else{//没有记录offset

println("没有记录offset,则直接连接,从latest开始消费")

// /export/servers/kafka/bin/kafka-console-producer.sh --broker-list node01:9092 --topic spark_kafka

KafkaUtils.createDirectStream[String, String](ssc,

LocationStrategies.PreferConsistent,//位置策略,源码强烈推荐使用该策略,会让Spark的Executor和Kafka的Broker均匀对应

ConsumerStrategies.Subscribe[String, String](topics, kafkaParams))//消费策略,源码强烈推荐使用该策略

}

//3.操作数据

//注意:我们的目标是要自己手动维护偏移量,也就意味着,消费了一小批数据就应该提交一次offset

//而这一小批数据在DStream的表现形式就是RDD,所以我们需要对DStream中的RDD进行操作

//而对DStream中的RDD进行操作的API有transform(转换)和foreachRDD(动作)

recordDStream.foreachRDD(rdd=>{

if(rdd.count() > 0){//当前这一时间批次有数据

rdd.foreach(record => println("接收到的Kafk发送过来的数据为:" + record))

//接收到的Kafk发送过来的数据为:ConsumerRecord(topic = spark_kafka, partition = 1, offset = 6, CreateTime = 1565400670211, checksum = 1551891492, serialized key size = -1, serialized value size = 43, key = null, value = hadoop spark ...)

//注意:通过打印接收到的消息可以看到,里面有我们需要维护的offset,和要处理的数据

//接下来可以对数据进行处理....或者使用transform返回和之前一样处理

//处理数据的代码写完了,就该维护offset了,那么为了方便我们对offset的维护/管理,spark提供了一个类,帮我们封装offset的数据

val offsetRanges: Array[OffsetRange] = rdd.asInstanceOf[HasOffsetRanges].offsetRanges

for (o <- offsetRanges){

println(s"topic=${o.topic},partition=${o.partition},fromOffset=${o.fromOffset},untilOffset=${o.untilOffset}")

}

//手动提交offset,默认提交到Checkpoint中

//recordDStream.asInstanceOf[CanCommitOffsets].commitAsync(offsetRanges)

//实际中偏移量可以提交到MySQL/Redis中

OffsetUtil.saveOffsetRanges("SparkKafkaDemo",offsetRanges)

}

})

/* val lineDStream: DStream[String] = recordDStream.map(_.value())//_指的是ConsumerRecord

val wrodDStream: DStream[String] = lineDStream.flatMap(_.split(" ")) //_指的是发过来的value,即一行数据

val wordAndOneDStream: DStream[(String, Int)] = wrodDStream.map((_,1))

val result: DStream[(String, Int)] = wordAndOneDStream.reduceByKey(_+_)

result.print()*/

ssc.start()//开启

ssc.awaitTermination()//等待优雅停止

}

/*

手动维护offset的工具类

首先在MySQL创建如下表

CREATE TABLE `t_offset` (

`topic` varchar(255) NOT NULL,

`partition` int(11) NOT NULL,

`groupid` varchar(255) NOT NULL,

`offset` bigint(20) DEFAULT NULL,

PRIMARY KEY (`topic`,`partition`,`groupid`)

) ENGINE=InnoDB DEFAULT CHARSET=utf8;

*/

object OffsetUtil {

//从数据库读取偏移量

def getOffsetMap(groupid: String, topic: String) = {

val connection = DriverManager.getConnection("jdbc:mysql://localhost:3306/bigdata?characterEncoding=UTF-8", "root", "root")

val pstmt = connection.prepareStatement("select * from t_offset where groupid=? and topic=?")

pstmt.setString(1, groupid)

pstmt.setString(2, topic)

val rs: ResultSet = pstmt.executeQuery()

val offsetMap = mutable.Map[TopicPartition, Long]()

while (rs.next()) {

offsetMap += new TopicPartition(rs.getString("topic"), rs.getInt("partition")) -> rs.getLong("offset")

}

rs.close()

pstmt.close()

connection.close()

offsetMap

}

//将偏移量保存到数据库

def saveOffsetRanges(groupid: String, offsetRange: Array[OffsetRange]) = {

val connection = DriverManager.getConnection("jdbc:mysql://localhost:3306/bigdata?characterEncoding=UTF-8", "root", "root")

//replace into表示之前有就替换,没有就插入

val pstmt = connection.prepareStatement("replace into t_offset (`topic`, `partition`, `groupid`, `offset`) values(?,?,?,?)")

for (o <- offsetRange) {

pstmt.setString(1, o.topic)

pstmt.setInt(2, o.partition)

pstmt.setString(3, groupid)

pstmt.setLong(4, o.untilOffset)

pstmt.executeUpdate()

}

pstmt.close()

connection.close()

}

}

}

这篇就到这了,下篇更新Structured Streaming!!!