1.环境准备

1.进入kettle安装文件目录的data-integration\plugins\pentaho-big-data-plugin,修改plugin.properties文件

根据自己的hadoop版本添加不同的类型

2.修改完成后进入自己对应的版本进入不同的目录,我进入的是plugins\pentaho-big-data-plugin\hadoop-configurations\cdh514目录

将集群的Hadoop、Hive配置复制到该目录中core-site.xml、hdfs-site.xml、mapred-site.xml、yarn-site.xml、hive-site.xml 覆盖文件中的原文件

2.准备hive表

前提:开启HDFS、Yarn、HiveMetaStore、HiveServer2

开启HDFS、Yarn

开启HiveServer2

cd /export/servers/hive-1.1.0-cdh5.14.0

nohup bin/hive --service hiveserver2 &开启HiveMetaStore

nohup /export/servers/hive-1.1.0-cdh5.14.0/bin/hive --service metastore 2>&1 >> /var/log.log &查看是否开启

开始准备hive数据

进入hive

//创建hive数据库

create database kettle;

use kettle;

//创建表

CREATE TABLE dept(deptno int, dname string,loc string)

ROW FORMAT DELIMITED

FIELDS TERMINATED BY '\t';

CREATE TABLE emp(

empno int,

ename string,

job string,

mgr int,

hiredate string,

sal double,

comm int,

deptno int)

ROW FORMAT DELIMITED

FIELDS TERMINATED BY '\t';

//加入数据

insert into dept values

(10,'accounting','NEW YORK'),

(20,'RESEARCH','DALLAS'),

(30,'SALES','CHICAGO'),

(40,'OPERATIONS','BOSTON');

insert into emp values

(7369,'SMITH','CLERK',7902,'1980-12-17',800,NULL,20),

(7499,'ALLEN','SALESMAN',7698,'1980-12-17',1600,300,30),

(7521,'WARD','SALESMAN',7698,'1980-12-17',1250,500,30),

(7566,'JONES','MANAGER',7839,'1980-12-17',2975,NULL,20);进去kettle 准备转换

创建两个表输入

编写两个表输入

运用deptno来join合并两个表

删除无用或重复字段

添加输出步骤

设置输出连接hdfs

运行保存启动

这时候会发现报了个错!

删除hdfs上的输出文件

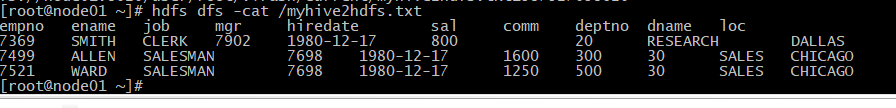

hdfs dfs -cat /myhive2hdfs.txt

重新运行启动spoon

查看hdfs上的输出文件