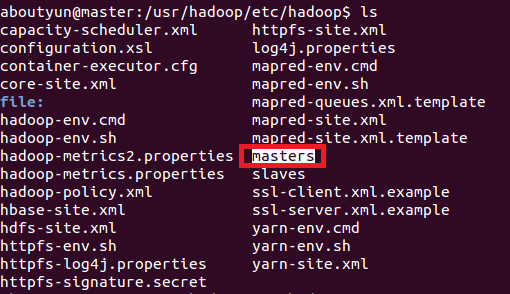

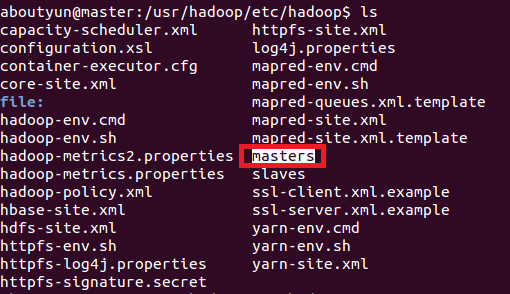

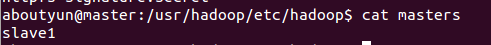

1.增加masters文件

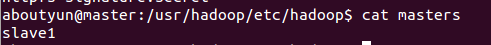

这里面放什么内容还是比较关键的,这里我们指定slave1节点上运行SecondaryNameNode。

注意:如果你想单独配置一台机器,那么在这个文件里面,填写这个节点的ip地址或则是hostname,如果是多台,则在masters里面写上多个,一行一个,我们这里指定一个

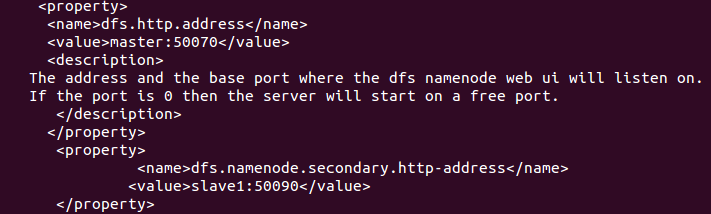

2.修改hdfs-site.xml

在下面文件中增加如下内容:(记得下面亦可写成ip地址,这里为了理解方便,写的是hostname)

<property>

<name>dfs.http.address</name>

<value>

master:50070</value>

<description>

The address and the base port where the dfs namenode web ui will listen on.

If the port is 0 then the server will start on a free port.

</description>

</property>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>

slave1:50090</value>

</property>

|

3.修改core-site.xml文件

- <property>

- <name>fs.checkpoint.period</name>

- <value>3600</value>

- <description>The number of seconds between two periodic checkpoints.

- </description>

- </property>

- <property>

- <name>fs.checkpoint.size</name>

- <value>67108864</value>

- </property>

-

复制代码

上面修改完毕,相应的节点(比如我修改的是slave1,那么slave1也要修改刚刚修改的几个文件)也做同样的修改。

上面修改完毕,相应的节点(比如我修改的是slave1,那么slave1也要修改刚刚修改的几个文件)也做同样的修改。

4.修改完了之后,执行

[root@Master hadoop-2.7.3]# sbin/hadoop-daemons.sh --config etc/hadoop --hosts masters start secondarynamenode

[root@Master hadoop-2.7.3]# jps

19649 ResourceManager

24646 Jps

19401 NameNode

然后查看节点:

接着在slave1中输入jps

[root@Slave1 hadoop]# jps

4384 NodeManager

4278 DataNode

4967 Jps

4926 SecondaryNameNode