前言

之前已经搭建过一个hadoop集群(搭建方法),在这个集群的基础上进行改进,引用Zookeeper来进行自动故障转移!

后续搭建Yarn-HA!!!点我!

搭建目标

HA简介

所谓HA(High Available),即高可用(7*24小时不中断服务)。

Hadoop集群有HDFS和YARN!Hadoop的HA指HDFS和YARN必须保证可用性强(不能轻易故障,保持24h可用)!

以HDFS为例:

必须进程: Namenode(1个) Danonode(N个)

可选进程: SecondaryNamenode (1个)

HA的核心: 保证Namenode和RecourceManager不能故障或在故障后可以快速容灾恢复!

HA的实现(以HDFS为例)

①为了避免Namenode的单点故障,可以启动多个Namenode!

②保证多个Namenode进程元数据必须同步

元数据: fsimage。 Namenode在格式化时,会生成空白的fsimage文件,此时让Namenode将格式化后的fsimage文件拷贝到另一个Namenode上即可!

edits:Namenode将edits文件发送给Journalnode,其他的Namnoede自己从Journalnode同步edits文件!

注意:

a)journalnode进程采用paxos协议设计,适合运行在奇数台机器!

b)如果要实现HA,至少要启动3台Journalnode!

c)如果启动了Journalnode,那么没有必要,也不能再启动 SecondaryNamenode

③当启动了多个Namenode时,只能选择其中的一个作为active状态的NN

其余的Namenode都只能作为standby状态

采用状态是为了标识哪个namenode是正在工作的,可以为客户端提供服务的NN,只有active状态的

NN可以接收客户端请求!

原则: 不能出现脑裂现象(不能同时出现两个active状态的namenode)

- 为什么要格式化?

格式化是为了:

①生成Namenode工作的目录(存放元数据)

②格式化是为了生成fsimage文件,每次NN启动都会先读取fsimage中的元数据

③为了生成Namenode的id和clusterId,所有的 Datanode在启动是都会根据clusterId向Namenode上报

HDFS的自动故障转移

①借助zookeeper集群

②一般采用sshfence,需要配置两台Namenode所运行机器的ssh互相联通

配置Zookeeper集群

1. 将压缩所包解压后修改cof文件名

重命名/opt/module/zookeeper-3.4.10/conf这个目录下的zoo_sample.cfg为zoo.cfg

mv zoo_sample.cfg zoo.cfg

2.在 /opt/module/zookeeper-3.4.10/目录下创建一个目录

mkdir -p zkData

3. 配置zoo.cfg文件

指定dataDir

指定dataDir

dataDir=/opt/module/zookeeper-3.4.10/zkData

指定服务端id以及leader端口号和选举互相通讯时端口号

#######################cluster##########################

server.102=hadoop102:2888:3888

server.103=hadoop103:2888:3888

server.104=hadoop104:2888:3888

配置参数解读

Server.A=B:C:D。

A是一个数字,表示这个是第几号服务器;

B是这个服务器的IP地址;

C是这个服务器与集群中的Leader服务器交换信息的端口;

D是万一集群中的Leader服务器挂了,需要一个端口来重新进行选举,选出一个新的Leader,而这个端口就是用来执行选举时服务器相互通信的端口。

4. 集群模式下配置一个文件myid

这个文件在dataDir目录下,这个文件里面有一个数据就是A的值,Zookeeper启动时读取此文件,拿到里面的数据与zoo.cfg里面的配置信息比较从而判断到底是哪个server。

在/opt/module/zookeeper-3.4.10/zkData目录下创建一个myid的文件

此文件为该节点的serverid 注意不能有空格和空行

这里配置的主机是hadoop102,为了方便所以配置为102!id可以随便起名字,原则是数字且不能重复。

vim myid

分发后再对每个节点上的myid进行修改!

配置并且启动zookeeper集群

@hadoop102 zookeeper-3.4.10]# bin/zkServer.sh start

@hadoop103 zookeeper-3.4.10]# bin/zkServer.sh start

@hadoop104 zookeeper-3.4.10]# bin/zkServer.sh start

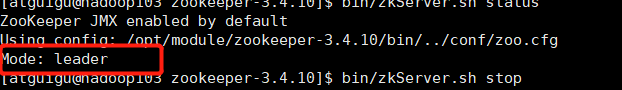

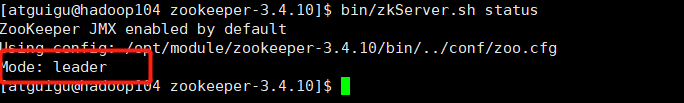

Zookeeper遵循poxos协议,必须半数以上启动,集群才可用,当集群启动半数以上时开始选leader,一般来讲id大的有优势,以三台为集群来为例,如果102,103启动成功,则103为leader,104再启动后,只能作为follower,如果103挂掉,这个时候重新选举,

如果选举成功,推测是104为leader,其他的均为follower。

此为先启动102和103时的leader

然后将104启动,停掉103的server,这时重新选举leader,id大的当选!

配置xcall脚本

点我!here!!!这里有常用的脚本。可方便参考!!!

注意!!!在每次使用ssh协议登录主机是必须重新source配置文件,否则会报错

配置HDFS-HA集群

在opt目录下创建一个ha文件夹

mkdir back

将/opt/app/下的 hadoop-2.7.2拷贝到/opt/back目录下作为一般集群的拷贝!方便转换HA和普通集群模式!

cp -r hadoop-2.7.2/ /opt/back

1. 配置hadoop-env.sh

export JAVA_HOME=/opt/module/jdk1.8.0_144

2. 配置core-site.xml

注意!!!!!

mycluster是作为一个参数,这样多个Namenode的情况下,active状态的Namenode挂掉以后,可以利用Zookeeper来将standby的Namenode激活成active状态!

<configuration>

<!-- 把两个NameNode)的地址组装成一个集群mycluster -->

<property>

<name>fs.defaultFS</name>

<value>hdfs://mycluster</value>

</property>

<!-- 指定hadoop运行时产生文件的存储目录 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/hadoop-2.7.2/data/tmp</value>

</property>

</configuration>

3. 配置hdfs-site.xml

| 属性名 | 属性值 |

|---|---|

| dfs.nameservices | mycluster(作为core-site里面fs.defaultFS属性值参数!) |

| dfs.ha.namenodes.mycluster | nn1,nn2(集群中NameNode节点都有哪些) |

| dfs.namenode.rpc-address.mycluster.nn1 | hadoop102:9000(nn1的RPC通信地址) |

| dfs.namenode.rpc-address.mycluster.nn2 | hadoop103:9000(nn2的RPC通信地址) |

| dfs.namenode.shared.edits.dir | qjournal://hadoop102:8485;hadoop103:8485;hadoop104:8485/mycluster(指定NameNode元数据在JournalNode上的存放位置) |

<configuration>

<!-- 完全分布式集群名称 -->

<property>

<name>dfs.nameservices</name>

<value>mycluster</value>

</property>

<!-- 集群中NameNode节点都有哪些 -->

<property>

<name>dfs.ha.namenodes.mycluster</name>

<value>nn1,nn2</value>

</property>

<!-- nn1的RPC通信地址 -->

<property>

<name>dfs.namenode.rpc-address.mycluster.nn1</name>

<value>hadoop102:9000</value>

</property>

<!-- nn2的RPC通信地址 -->

<property>

<name>dfs.namenode.rpc-address.mycluster.nn2</name>

<value>hadoop103:9000</value>

</property>

<!-- nn1的http通信地址 -->

<property>

<name>dfs.namenode.http-address.mycluster.nn1</name>

<value>hadoop102:50070</value>

</property>

<!-- nn2的http通信地址 -->

<property>

<name>dfs.namenode.http-address.mycluster.nn2</name>

<value>hadoop103:50070</value>

</property>

<!-- 指定NameNode元数据在JournalNode上的存放位置 -->

<property>

<name>dfs.namenode.shared.edits.dir</name>

<value>qjournal://hadoop102:8485;hadoop103:8485;hadoop104:8485/mycluster</value>

</property>

<!-- 配置隔离机制,即同一时刻只能有一台服务器对外响应 -->

<property>

<name>dfs.ha.fencing.methods</name>

<value>sshfence</value>

</property>

<!-- 使用隔离机制时需要ssh无秘钥登录-->

<property>

<name>dfs.ha.fencing.ssh.private-key-files</name>

<value>/home/zhengkw/.ssh/id_rsa</value>

</property>

<!-- 声明journalnode服务器存储目录-->

<property>

<name>dfs.journalnode.edits.dir</name>

<value>/opt/hadoop-2.7.2/data/jn</value>

</property>

<!-- 关闭权限检查-->

<property>

<name>dfs.permissions.enable</name>

<value>false</value>

</property>

<!-- 访问代理类:client,mycluster,active配置失败自动切换实现方式-->

<property>

<name>dfs.client.failover.proxy.provider.mycluster</name>

<value>org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider</value>

</property>

</configuration>

拷贝配置好的hadoop环境到其他节点

fence机制选取

fence是为了防止脑裂而设计的一种补刀机制!

| 属性名 | 属性值 |

|---|---|

| dfs.ha.fencing.methods | sshfence |

| dfs.ha.fencing.methods | shell |

笔者在配置hdfs-site.xml时选用的是sshfence,官方还提供一种fence为shell。

参考两篇博客高可用配置说明&HA配置理解

自动故障转移决定性配置项

hdfs-site

#在hdfs-site.xml中

<property>

<name>dfs.ha.automatic-failover.enabled</name>

<value>true</value>

</property>

core-site

#在core-site.xml文件中

<property>

<name>ha.zookeeper.quorum</name>

<value>hadoop102:2181,hadoop103:2181,hadoop104:2181</value>

</property>

启动Journalnode

- 在各个JournalNode节点上,输入以下命令启动journalnode服务(因为需要遵循paxos协议,所以必须最少启动3台!)

sbin/hadoop-daemon.sh start journalnode

- 在[nn1]上,对其进行格式化,并启动

bin/hdfs namenode -format

sbin/hadoop-daemon.sh start namenode

- 在[nn2]上,同步nn1的元数据信息

bin/hdfs namenode -bootstrapStandby

- 启动[nn2]

sbin/hadoop-daemon.sh start namenode

注意 必须保证格式化NN之前启动每个节点的 每个节点的 每个节点的!!JN

初始化ZK

(1)关闭所有HDFS服务:

sbin/stop-dfs.sh

(2)启动Zookeeper集群:

zkstart

(3)初始化HA在Zookeeper中状态(在hadoop的目录下操作!!!):

bin/hdfs zkfc -formatZK

测试HDFS-HA

群起zk和dfs服务

zhstart

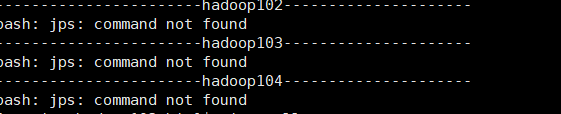

查看jps

xcall jps

验证

hadoop102

hadoop103

hadoop103

总结

- 一般情况下,NN启动时有30秒的安全模式,所以在这个模式下HDFS是不能写数据的,所以集群启动时,各个进程之间没有硬性顺序要求,但是如果是老龄机,请注意,优先启动zk,JN再启动NN和其他的进程!

- 第一次搭建时,一定要先启动每个节点journalnode,先启动每个节点journalnode,先启动每个节点journalnode!!!重要的事说3遍,不然会初始化的时候出现没有启动JN的主机上8485端口连接不上!因为需要遵循paxos协议,所以必须最少启动3台!!!

- 其次NN初始化,然后启动NN1,同步元数据给NN2,最后启动NN2。

- 停掉所有的NN服务,对zk进行初始化!

- 最后用群起脚本启动!脚本里,必须ZK先启动!!否则会出现所有NN都处于Standby!