动手学深度学习(2)

过拟合和欠拟合

接下来,我们将探究模型训练中经常出现的两类典型问题:

- 一类是模型无法得到较低的训练误差,我们将这一现象称作欠拟合(underfitting);

- 另一类是模型的训练误差远小于它在测试数据集上的误差,我们称该现象为过拟合(overfitting)。 在实践中,我们要尽可能同时应对欠拟合和过拟合。虽然有很多因素可能导致这两种拟合问题,在这里我们重点讨论两个因素:模型复杂度和训练数据集大小。

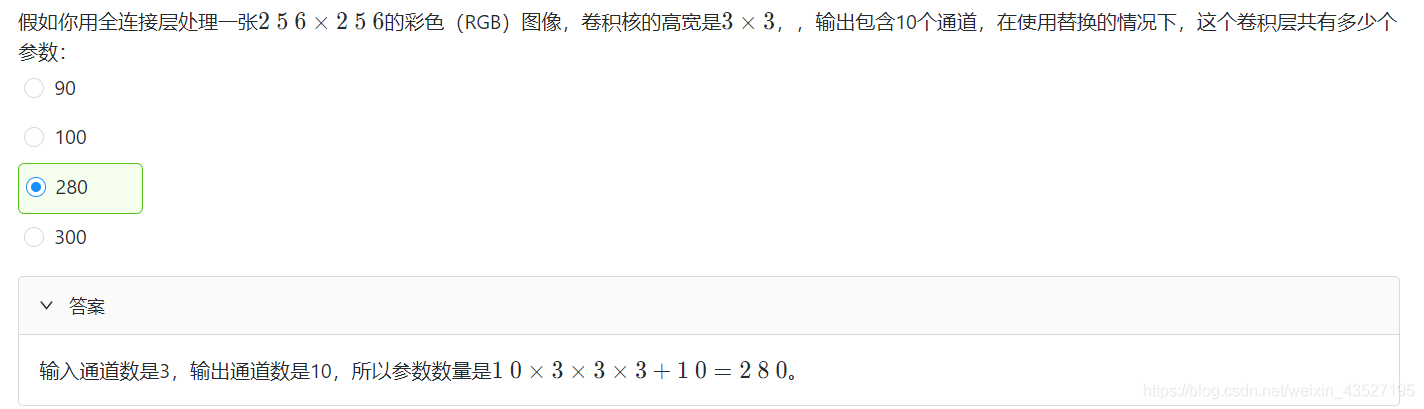

卷积神经网络参数计算

Convolutional Neural Networks

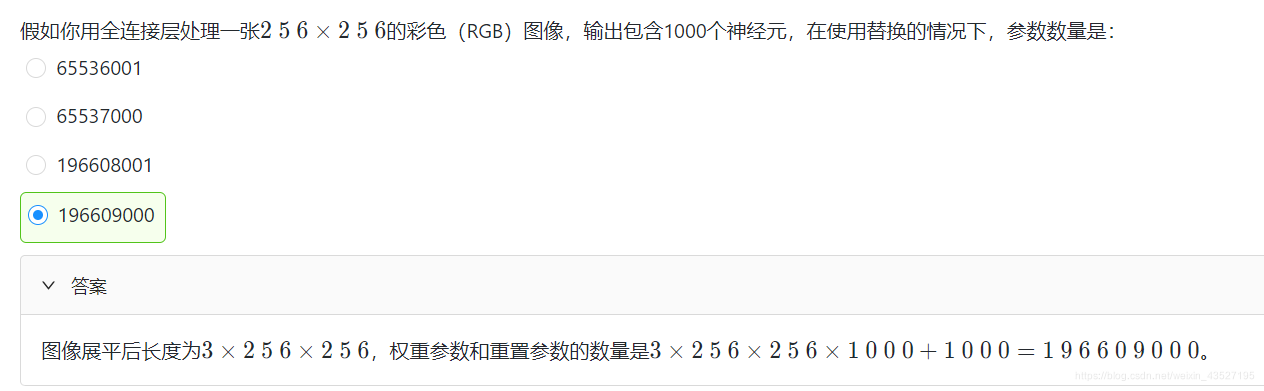

使用全连接层的局限性:

- 图像在同一列邻近的像素在这个向量中可能相距较远。它们构成的模式可能难以被模型识别。

- 对于大尺寸的输入图像,使用全连接层容易导致模型过大。

使用卷积层的优势: - 卷积层保留输入形状。

- 卷积层通过滑动窗口将同一卷积核与不同位置的输入重复计算,从而避免参数尺寸过大。

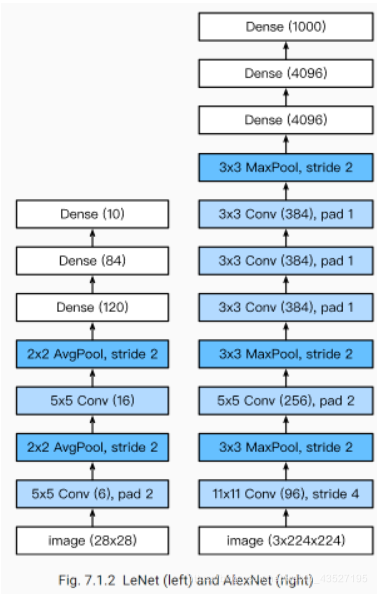

1.AlexNet

首次证明了学习到的特征可以超越手工设计的特征,从而⼀举打破计算机视觉研究的前状。

特征:

- 8层变换,其中有5层卷积和2层全连接隐藏层,以及1个全连接输出层。

- 将sigmoid激活函数改成了更加简单的ReLU激活函数。

- 用Dropout来控制全连接层的模型复杂度。

- 引入数据增强,如翻转、裁剪和颜色变化,从而进一步扩大数据集来缓解过拟合。

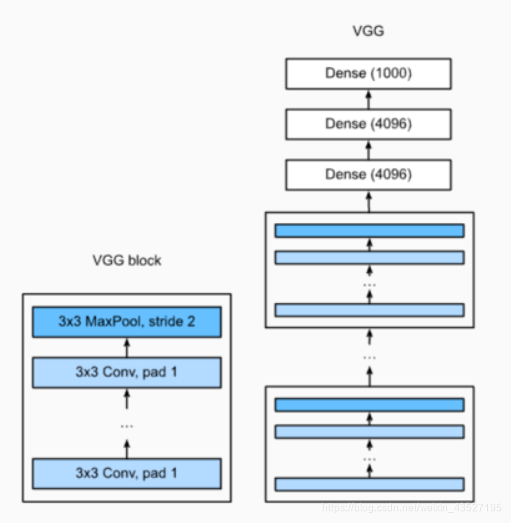

2.VGG

VGG:通过重复使⽤简单的基础块来构建深度模型。