1、准备环境

centos 6.5

hbase-2.2.3-bin.tar.gz(http://archive.apache.org/dist/hbase/)

apache-zookeeper-3.6.0

hadoop-3.2.1

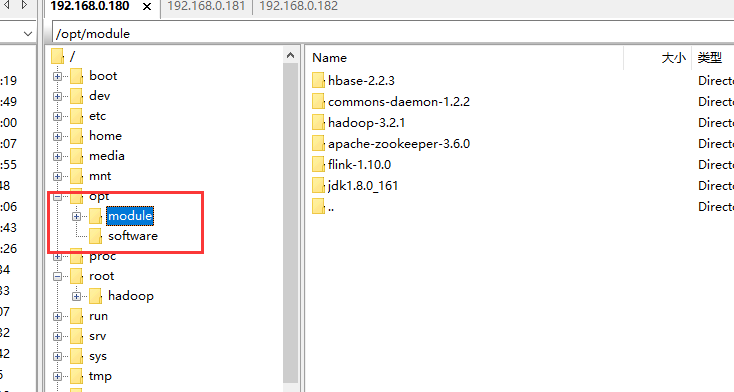

2、解压: tar zxvf /opt/software/hbase-2.2.3-bin.tar.gz -C /opt/module/

3、hbase 配置文件

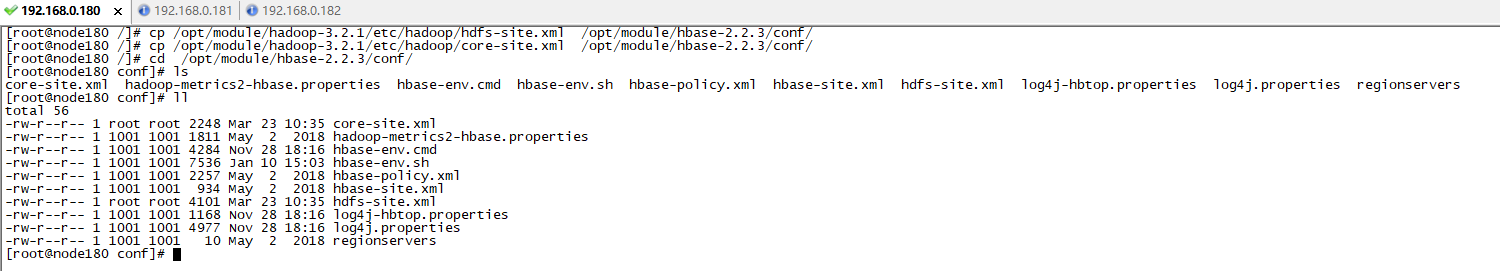

cp /opt/module/hadoop-3.2.1/etc/hadoop/hdfs-site.xml /opt/module/hbase-2.2.3/conf/

cp /opt/module/hadoop-3.2.1/etc/hadoop/core-site.xml /opt/module/hbase-2.2.3/conf/

修改hbase-env.sh

export JAVA_HOME=/export/servers/jdk1.8.0_141

//告诉hbase使用外部的zk

export HBASE_MANAGES_ZK=false

修改 hbase-site.xml

<configuration>

<!-- 指定hbase的路径,地址根据hdfs-site.xml的配置而定,当前是hadoop集群1(mycluster)的路径

此处的HDFS的地址就是etc/hadoop/core.site.xml中的fs.defaultFS)

-->

<property>

<name>hbase.rootdir</name>

<value>hdfs://mycluster/hbase</value>

</property>

<!-- 指定hbase是分布式的 -->

<property>

<name>hbase.cluster.distributed</name>

<value>true</value>

</property>

<!--指定hbase的master-->

<property>

<name>hbase.master</name>

<value>node180:60000</value>

</property>

<property>

<name>hbase.master.maxclockskew</name>

<value>180000</value>

</property>

<!-- zoojeeper集群,多个用“,”分割 -->

<property>

<name>hbase.zookeeper.quorum</name>

<value>node180,node181,node182</value>

</property>

<!-- 使用本地文件系统设置为false,使用hdfs设置为true。 在HBase 2.0.0 之后建议设置为false -->

<property>

<name>hbase.unsafe.stream.capability.enforce</name>

<value>true</value>

</property>

<!--指zookeeper集群data目录-->

<property>

<name>hbase.zookeeper.property.dataDir</name>

<value>/root/hbase/zookeeper/data</value>

</property>

<!--指hbase的tmp目录-->

<property>

<name>hbase.tmp.dir</name>

<value>/root/hbase/tmp</value>

</property>

</configuration>

修改 regionservers文件

node180

node181

node182

4、修改系统环境变量

编辑:vi /etc/profile

#hbase

export HBASE_HOME=/opt/module/hbase-2.2.3

export PATH=$HBASE_HOME/bin:$PATH

刷新配置:source /etc/profile

5、同步文件

scp -r /opt/module/hbase-2.2.3/ root@node181:/opt/module/

scp -r /opt/module/hbase-2.2.3/ root@node182:/opt/module/

同步完成、分别在服务器执行 查看版本 :hbase version

6、