1. Una red neuronal recurrente simple

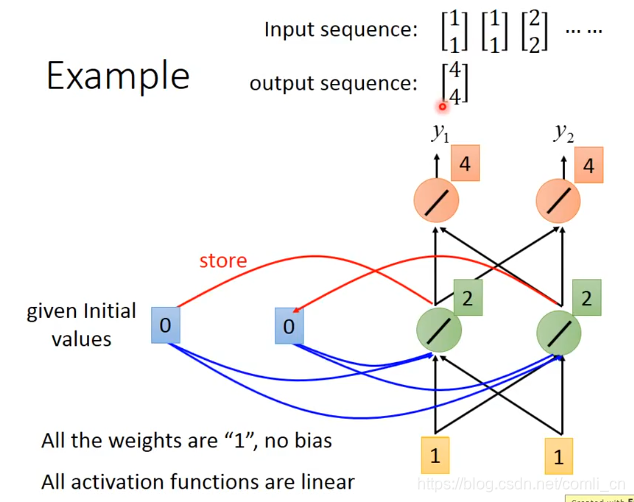

Como se muestra en la figura anterior, primero coloque el primer nodo de la secuencia de entrada (secuencia de entrada)

Ingrese la versión simple de la red de memoria que se muestra en la figura anterior, que se encuentra dentro del cuadro naranja de la figura. El cuadro azul es la unidad de memoria, que almacena la información calculada en el último punto de tiempo. Debido a que este es el primer punto de tiempo, al cuadro azul se le asigna primero un valor inicial.

. Y dado que se supone que el peso de todas las funciones de activación es 1, y todos los valores de polarización son 0, se calcula mediante el círculo verde

, Es decir, 1 + 1 + 0 + 0 = 2, el valor calculado debe almacenarse en el cuadro azul y, finalmente, calcularse mediante el círculo rojo claro

, En este punto se calcula el primer nodo de tiempo.

Como se muestra en la figura anterior, primero coloque el primer nodo de la secuencia de entrada (secuencia de entrada)

Ingrese la versión simple de la red de memoria que se muestra en la figura anterior, que se encuentra dentro del cuadro naranja de la figura. El cuadro azul es la unidad de memoria, que almacena la información calculada en el último punto de tiempo. Debido a que este es el primer punto de tiempo, al cuadro azul se le asigna primero un valor inicial.

. Y dado que se supone que el peso de todas las funciones de activación es 1, y todos los valores de polarización son 0, se calcula mediante el círculo verde

, Es decir, 1 + 1 + 0 + 0 = 2, el valor calculado debe almacenarse en el cuadro azul y, finalmente, calcularse mediante el círculo rojo claro

, En este punto se calcula el primer nodo de tiempo.

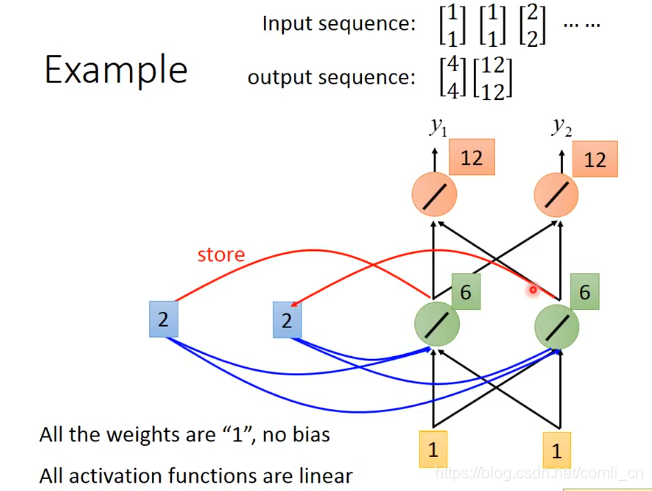

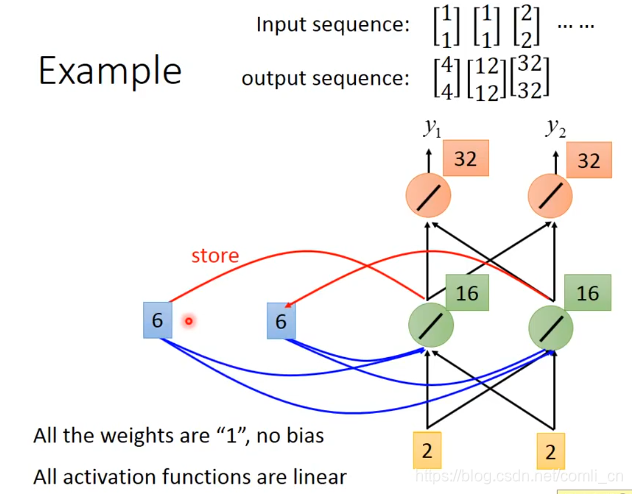

Luego repita el trabajo anterior: de

esta manera, obtiene la secuencia de salida (secuencia de salida).Cabe señalar aquí que el orden de la secuencia de entrada no se puede ajustar a voluntad, porque la secuencia de salida será diferente si se ajusta a voluntad

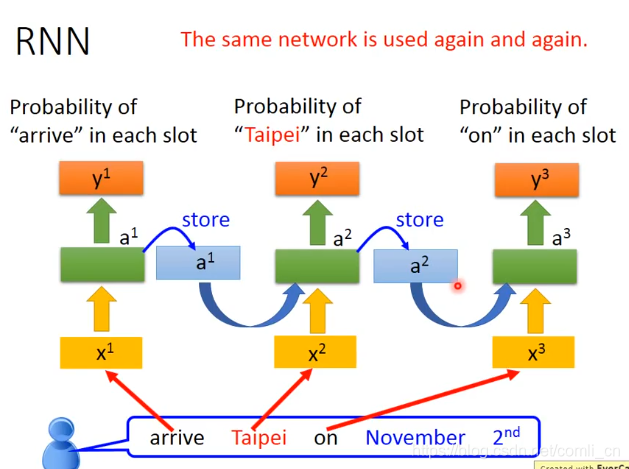

2. Ejemplos de aplicación de RNN (Elman Network)

Como se muestra en la figura anterior, para extraer la ubicación y la hora de la oración "llegar a Taipe el 2 de noviembre", puede poner esta oración en el RNN y procesarla, porque el RNN resumirá "llegar" de los datos del entrenamiento después de mucho entrenamiento. "La probabilidad de que un lugar siga a esta palabra es relativamente alta, por lo que la probabilidad es que el lugar en esta oración sea" Taipei ". Del mismo modo, se basará en las primeras tres palabras" llegar a Taipe el "y" 2 de noviembre " Una probabilidad indica que el "2 de noviembre" es una probabilidad relativamente alta en el mundo.

Como se muestra en la figura anterior, para extraer la ubicación y la hora de la oración "llegar a Taipe el 2 de noviembre", puede poner esta oración en el RNN y procesarla, porque el RNN resumirá "llegar" de los datos del entrenamiento después de mucho entrenamiento. "La probabilidad de que un lugar siga a esta palabra es relativamente alta, por lo que la probabilidad es que el lugar en esta oración sea" Taipei ". Del mismo modo, se basará en las primeras tres palabras" llegar a Taipe el "y" 2 de noviembre " Una probabilidad indica que el "2 de noviembre" es una probabilidad relativamente alta en el mundo.

El cuadro verde en la figura de arriba es la capa oculta, y puede haber varias capas ocultas más.

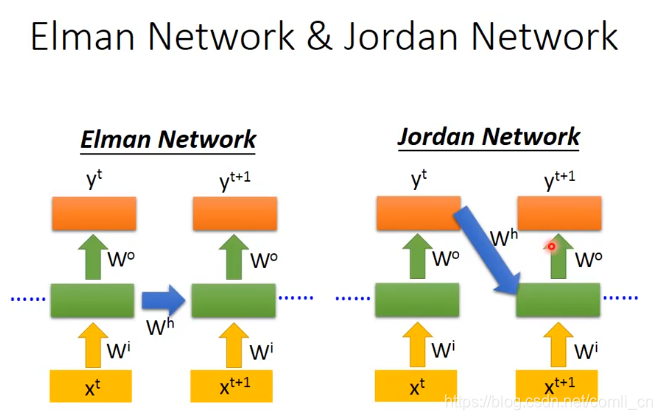

3. Otras formas de RNN

La diferencia entre Jordan Network y Elman Network en Jordan Network se muestra en la siguiente figura: los datos en la capa oculta son diferentes

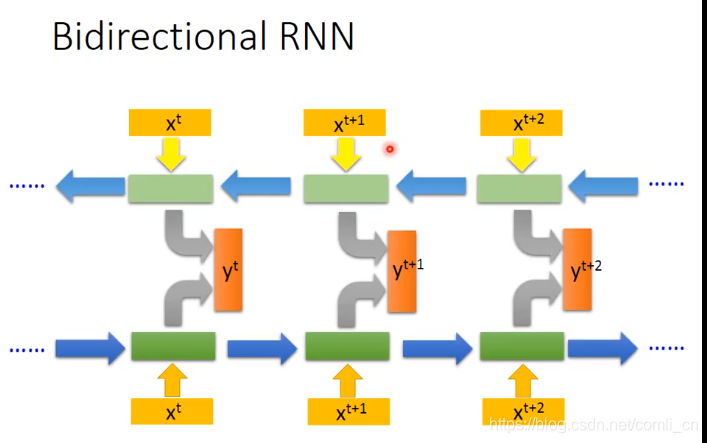

Bidireccional RNN

1 la referencia .

Referencia 2 .

Referencia 3: Pytorch el RNN .