L0正则化:L0是指向量中非0的个数。如果我们用L0范数来规则化一个参数矩阵W的话,就是希望W的大部分元素都是0。换句话说,让参数W是稀疏的。但不幸的是,L0范数的最优化问题是一个NP hard问题,而且理论证明,L1范数是L0范数的最优凸近似,因此通常使用L1范数来代替。

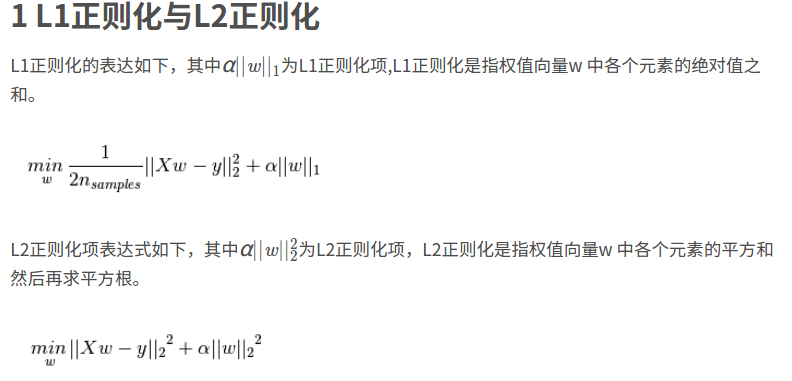

L1正则化:L1范数是指向向量中各个元素绝对值之和,也有个美称是“稀疏规则算子”(Lasso regularization)。

L2范数:也叫“岭回归”(Ridge Regression),也叫它“权值衰减weight decay”

但与L1范数不一样的是,它不会是每个元素为0,而只是接近于0。L2范数即是欧式距离。

正则化的作用

正则化的主要作用是防止过拟合,对模型添加正则化项可以限制模型的复杂度,使得模型在复杂度和性能达到平衡。

常用的正则化方法有L1正则化和L2正则化。L1正则化和L2正则化可以看作是损失函数的惩罚项。所谓“惩罚”就是对损失函数中的某些参数做一些限制。

L1和L2正则化的作用:

L1正则化可以产生稀疏权值矩阵,即产生一个稀疏模型,可以用于特征选择,一定程度上,L1也可以防止过拟合。

L2正则化可以防止模型过拟合(overfitting)

L2正则化可以直观理解为它对于大数值的权重向量进行严厉乘法,倾向于更加分散的权重向量。由于输入和权重之间的乘法操作,这样就有一个优良的特性:使网络更倾向于使用所有输入特征,而不是严重依赖输入特征中某些小部分特征。L2惩罚倾向于更小更分散的权重向量,这就会鼓励分类器最终将所有维度上的特征都用起来,而不是强烈依赖其中少数几个维度,这样做可以提高模型的范化能力,降低过拟合的风险。

L1正则化有一个有趣的性质,他会让权重向量在最优化的过程中变得稀疏(即非常接近0)。也就是说,使用L1正则化的神经元最后使用的是它们最重要的输入数据的稀疏子集,同事对于噪音输入则几乎是不变的了,相较于L1正则化,L2正则化中的权重向量大多是分散的小数字。

在实践中,如果不是特别关注某些明确的特征选择,一般说来L2正则化都会比L1正则化效果好。