持续更新。。。

文章目录

- 1. one-hot(独热)编码

- 1.1 为什么要独热编码?

- 1.2 为什么特征向量要映射到欧式空间?

- 1.3 独热编码优缺点

- 1.4 什么情况下(不)用独热编码?

- 1.5 什么情况下(不)需要归一化?

- 1.6 one-hot编码为什么可以解决类别型数据的离散值问题

- 1.7 Tree Model不太需要one-hot编码

- 1.8 独热编码的编程实现

- 2. LabelEncoder编码

- 3. 计数编码(频率编码Count编码)

- 4. Catboost编码

- 5. 树模型自动处理类别变量

- 6. 目标编码(target encoding)

- 7. 类别特征的交叉组合特征

- 贝叶斯目标编码(beta target encoding)

1. one-hot(独热)编码

独热编码即 One-Hot 编码,又称一位有效编码,其方法是使用N位状态寄存器来对N个状态进行编码,每个状态都由他独立的寄存器位,并且在任意时候,其中只有一位有效。

- 对长度为K的数组进行K编码

- 可以与大多数线性算法一起使用

- 删除第一列可避免共线性(pd.get_dummies中有参数可以达到这个目的,其实就是用全0来表示一种类别其它都用1-0表示)

- 稀疏格式对于内存友好(csr_matrix)

- 大多数当前的处理方法都不能很好地对待缺失值,以及新数据中的新类别

- xgboost、lightgbm和catboost等树模型中不适合使用one-hot编码

1.1 为什么要独热编码?

正如上文所言,独热编码(哑变量 dummy variable)是因为大部分算法是基于向量空间中的度量来进行计算的,为了使非偏序关系的变量取值不具有偏序性,并且到圆点是等距的。使用one-hot编码,将离散特征的取值扩展到了欧式空间,离散特征的某个取值就对应欧式空间的某个点。将离散型特征使用one-hot编码,会让特征之间的距离计算更加合理。离散特征进行one-hot编码后,编码后的特征,其实每一维度的特征都可以看做是连续的特征。就可以跟对连续型特征的归一化方法一样,对每一维特征进行归一化。比如归一化到[-1,1]或归一化到均值为0,方差为1。

1.2 为什么特征向量要映射到欧式空间?

将离散特征通过one-hot编码映射到欧式空间,是因为,在回归,分类,聚类等机器学习算法中,特征之间距离的计算或相似度的计算是非常重要的,而我们常用的距离或相似度的计算都是在欧式空间的相似度计算,计算余弦相似性,基于的就是欧式空间。

1.3 独热编码优缺点

- 优点:独热编码解决了分类器不好处理属性数据的问题,在一定程度上也起到了扩充特征的作用。它的值只有0和1,不同的类型存储在垂直的空间。

- 缺点:当类别的数量很多时,特征空间会变得非常大。在这种情况下,一般可以用PCA来减少维度。而且one hot encoding+PCA这种组合在实际中也非常有用。

1.4 什么情况下(不)用独热编码?

- 用:独热编码用来解决类别型数据的离散值问题

- 不用:将离散型特征进行one-hot编码的作用,是为了让距离计算更合理,但如果特征是离散的,并且不用one-hot编码就可以很合理的计算出距离,那么就没必要进行one-hot编码。 有些基于树的算法在处理变量时,并不是基于向量空间度量,数值只是个类别符号,即没有偏序关系,所以不用进行独热编码。 Tree Model不太需要one-hot编码: 对于决策树来说,one-hot的本质是增加树的深度。

- 总的来说,要是one hot encoding的类别数目不太多,建议优先考虑。

1.5 什么情况下(不)需要归一化?

- 需要: 基于参数的模型或基于距离的模型,都是要进行特征的归一化。

- 不需要:基于树的方法是不需要进行特征的归一化,例如随机森林,bagging 和 boosting等。

1.6 one-hot编码为什么可以解决类别型数据的离散值问题

- 首先,one-hot编码是N位状态寄存器为N个状态进行编码的方式

- eg:高、中、低不可分,→ 用0 0 0 三位编码之后变得可分了,并且成为互相独立的事件

- 类似 SVM中,原本线性不可分的特征,经过project之后到高维之后变得可分了

- GBDT处理高维稀疏矩阵的时候效果并不好,即使是低维的稀疏矩阵也未必比SVM好

1.7 Tree Model不太需要one-hot编码

对于决策树来说,one-hot的本质是增加树的深度

tree-model是在动态的过程中生成类似 One-Hot + Feature Crossing 的机制

- 一个特征或者多个特征最终转换成一个叶子节点作为编码 ,one-hot可以理解成三个独立事件

- 决策树是没有特征大小的概念的,只有特征处于他分布的哪一部分的概念 one-hot可以解决线性可分问题 但是比不上label econding

- one-hot降维后的缺点: 降维前可以交叉的降维后可能变得不能交叉

1.8 独热编码的编程实现

2. LabelEncoder编码

为每个类别变量赋予唯一的数字ID,一般用于非数字型的类别变量

- 对于基于非线性树的算法很有用(仅限于lightgbm和catboost这类可以直接处理类别的算法,xgb还是要进行别的处理)

- 不增加维度

- 将cat_var-> num_id映射随机化,然后进行平均再训练,以降低准确性。(我是真不懂)

- 可以与其他特征进行组合,以提高模型对于该类别特征的利用率

2.1 LabelEncoder编码的编程实现

具体可以参考我的另外一篇博客链接: 类别变量赋予唯一的数字ID.

3. 计数编码(频率编码Count编码)

- 将类别特征替换为训练集中的计数(一般是根据训练集来进行计数,属于统计编码的一种,统计编码,就是用类别的统计特征来代替原始类别,比如类别A在训练集中出现了100次则编码为100)

- 对线性和非线性算法均有用

- 可能对异常值敏感

- 可以添加对数转换,可以很好地处理计数(主要是针对count编码之后特征分布不规则的问题和常规的处理不规则分布的连续特征是一样的方式)

- 用’1’替换新数据中没见过的类别(没见过的类别如果有n个则编码为n)

- 可能会产生冲突:相同的编码,不同的变量(不同类别出现次数一样)

计数编码的效果有时候要好于LabelEncoder编码

3.1 计数编码中采用对数转换

推荐链接:数据预处理-对数变换

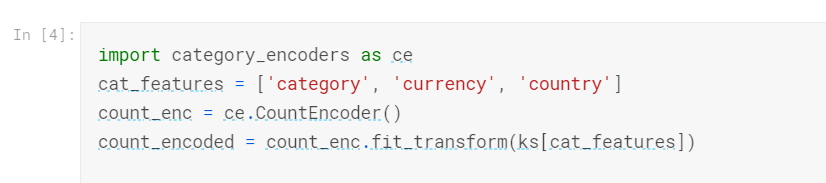

3.2 计数编码的编程实现

我们将使用categorical-encodings包来获取这种编码。编码器本身可用作CountEncoder。该编码器和其他类别编码器的工作方式类似于使用.fit和.transform方法的scikit-learn转换器。

或者:

4. Catboost编码

- 我们来看一下CatBoost编码。这类似于目标编码,因为它基于给定值的目标概率。但是,使用CatBoost时,对于每一行,仅从前几行计算目标概率

- 通常和树模型lightgbm一起使用效果极佳

4.1 Catboost编码的实现

利用好category_encoders库

5. 树模型自动处理类别变量

- XgBoost和Random Forest,不能直接处理categorical feature,必须先编码成为numerical feature。

- lightgbm和CatBoost,可以直接处理categorical feature。

- lightgbm: 需要先做label encoding。用特定算法(On Grouping for Maximum Homogeneity)找到optimal split,效果优于ONE。也可以选择采用one-hot encoding。

- CatBoost: 不需要先做label encoding。可以选择采用one-hot encoding,target encoding (with regularization)。

6. 目标编码(target encoding)

-

按目标变量的比例对分类变量进行编码(二分类或回归)(如果是多分类其实也可以编码,例如类别A对应的标签1有100个,标签2有100个,标签3有100个,则可以编码为【1/3,1/3,1/3】)

-

注意避免过拟合!(原始的target encoding直接对全部的训练集数据和标签进行编码,会导致得到的编码结果太过依赖与训练集)

-

堆叠形式:输出平均的目标的单变量模型

-

以交叉验证的方式进行(一般会进行交叉验证,比如划分为10折,每次对9折进行标签编码然后用得到的标签编码模型预测第10折的特征得到结果,其实就是常说的均值编码)

-

添加平滑以避免将变量编码设置为0。(某些类别可能只包含部分的类别会出现0值,此时会进行拉普拉斯平滑,不过对于回归则没有这种问题)

-

添加随机噪声以应对过拟合(我一般用交叉验证不怎么加噪声)

-

正确应用时:线性和非线性的最佳编码

6.1 当某一个类别变量过多时进行目标编码为何会导致过拟合

- 目标编码尝试对分类特征中每个级别的目标总体平均值进行测量。这意味着,当每个级别的数据更少时,估计的均值将与“真实”均值相距更远,方差更大。

- 类别变量的数据很少,估算值可能比其他功能的噪声大。如果该模型具有很高的预测性,因此将在很大程度上依赖此功能。

6.2 利用category_encoders库实现目标编码

7. 类别特征的交叉组合特征

多个类别特征之间进行交叉组合特征,将两个或者两个以上的类别属性合并成一个,往往组合特征之后的特征会比原单一的特征效果更好。

利用itertools.combinations遍历每对特征,将它们组合为交互特征

7.1 类别特征的交叉组合特征的实现

贝叶斯目标编码(beta target encoding)

待更新。。。