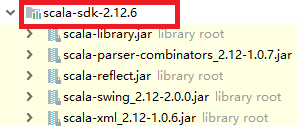

出现这个问题原因是原因Maven导入的spark依赖的是Scala版本和本地版本不一致。

这里我导入的Maven导入的spark依赖的是Scala版本是2.11而本地是2.12

<dependencies>

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-core_2.11</artifactId>

<version>2.4.0</version>

</dependency>

参考https://mvnrepository.com/artifact/org.apache.spark/spark-core上面的spark和Scala混搭版本

之后修改Maven导入的spark依赖的是Scala版本,解决了问题

<dependencies>

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-core_2.12</artifactId>

<version>2.4.5</version>

</dependency>

参考https://mvnrepository.com/artifact/org.apache.spark/spark-hive上面的spark和Scala和hive混搭版本.