scrapy爬虫框架学习(一)scrapy的配置和项目创建

1.scrapy安装

装有anaconda的情况下,进入anaconda命令行用pip安装

pip install scrapy

根据情况还需要安装pypiwin32(Windows系统)和service_identity,用pip安装即可

2.scrapy项目的创建

anaconda命令行进入要创建项目的目录下:

scrapy startproject projectname

创建好了项目文件夹,命令行进入这个文件夹创建爬虫:

scrapy genspider spidername "运行的域名"

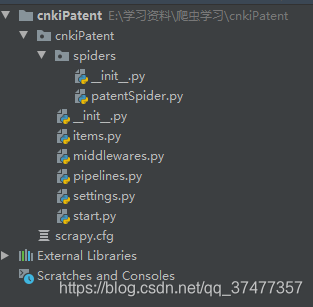

3.scrapy项目结构

- spiders:自己创建的spider,爬虫的主要逻辑都在patentSpider.py

- items.py定义数据结构

- middlewares.py引擎和爬虫之间以及下载器之间的中间件

- pipelines.py存储数据的方法

- settings.py框架的设置

- start.py代替命令行的运行脚本