神经网络基础知识总结

前馈神经网络

前馈神经网络描述的是网络的结构,是指每一层的神经元只接受前一层神经元的输入,并且输出到下一层。

BP神经网络

BP神经网络在百度百科上的解释是一种按照误差逆向传播算法训练的多层前馈神经网络。BP即Back Propagation,就是常用的反向传播算法。

MLP

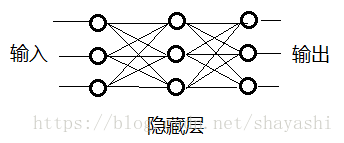

MLP是多层感知机也成为多层神经网络,是一种前向结构,包括输入层、隐藏层和输出层。至少三层结构(即隐藏层只有一层网络),如图所示。

CNN

CNN就是著名的卷积神经网络,是一种前馈神经网络。CNN不同于前面的网络只有线性连接,CNN包括卷积(convolution)操作、汇合(pooling)操作和非线性激活函数映射(即线性连接)。经典的CNN网络有Alex-Net、VGG-Nets、Network-In-Network等。

RNN

RNN是循环神经网络。

激活函数

激活函数又称为非线性映射函数,讲神经元的输入映射到输出。常用的激活函数包括:Sigmoid型函数、tanh(x)型函数、ReLU(修正线性单元)、Leaky ReLU、参数化ReLU、随机化ReLU和ELU(指数化线性单元)。

目标函数

目标函数是计算预测结果和真实结果的误差。目标函数可以分为分类任务的目标函数和回归任务的目标函数。

分类任务的目标函数包括:交叉熵损失函数、合页损失函数、坡道损失函数、大间隔交叉熵损失函数、中心损失函数。

回归任务的目标函数包括:L1损失函数、L2损失函数、Tukey’s biweight损失函数。

优化算法

常用的网络模型优化算法包括:随机梯度下降法、基于动量的随机梯度下降法、Nesterov型动量随机下降法、Adagrad法、Adadelta法、RMSProp法、Adam法。

超参数

神经网络主要超参数包括:输入图像像素、学习率、正则化参数、神经网络层数、批处理大小、卷积层参数(卷积核大小、卷积操作步长、卷积核个数)、汇合层参数(汇合核大小、汇合步长)、目标函数、优化算法、激活函数、学习周期等。