1.1 网络结构

ESN通过随机地部署大规模系数链接的神经元构成网络隐层,一般称为"储备池"。ESN网络具有的特点如下:

(1)包含数目相对较多的神经元;

(2)神经元之间的连接关系随机产生;

(3)神经元之间的链接具有稀疏性;

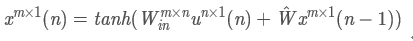

网络结构:

可以看出网络主要三层结构构成:

1.输入层(Input Layer):

输入向量u(n)其维度为:n×1

输入层→存储池的连接权重为:

注意该权重是不需要训练的,随机初始化完成即可

2.储存池(Reservoir):

存储池接受两个方向的输入一个来自于输入层u(n),另外一个来自存储池前一个状态的输出x(n−1),

其中状态反馈权重相同均不需要训练,由随机初始状态决定,所以为大型稀疏矩阵,其中的非0元素表明了存储池中被激活的神经元:

3.输出层(Readout):

存储池→输出层为线性连接关系,即满足:

实际训练过程中需要训练线性连接的权重。

核心思想:使用大规模随机稀疏网络(存储池)作为信息处理媒介,将输入信号从低维输入空间映射到高维度状态空间,在高维状态空间采用线性回归方法对网络的部分连接权重进行训练,而其他随机连接的权重在网络训练过程中保持不变。

1.2 ESN关键参数

1.3 ESN算法过程

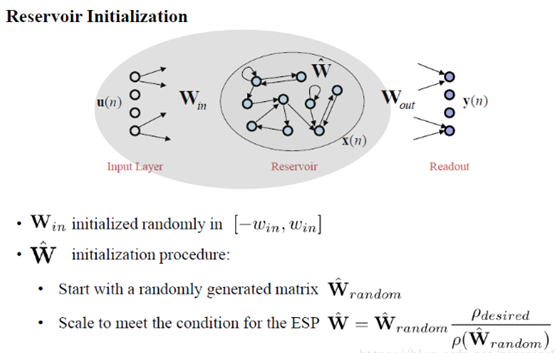

1.权重参数初始化

输出层权重初始化

存储池内部反馈权重初始化

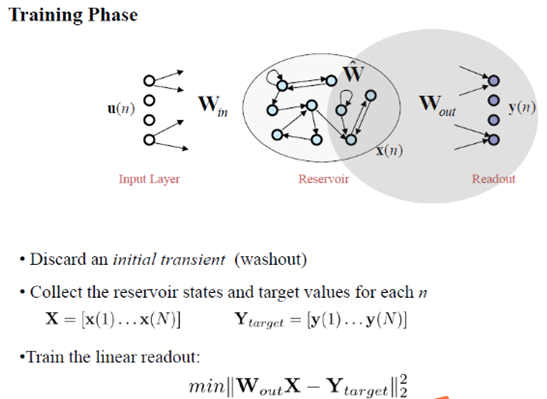

2.训练阶段

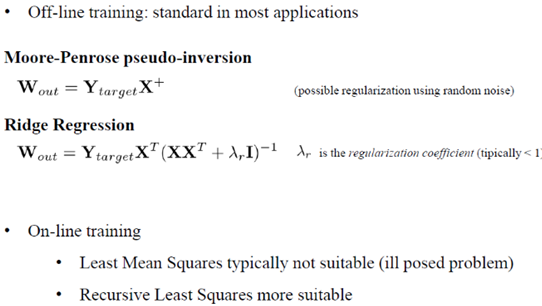

上述介绍的是训练算法分为离线训练和在线训练两种情况,一般情况下,由于矩阵X可能为奇异矩阵,

所以X的逆矩阵采用伪逆算法或者正则化技术:岭回归(Ridge Regression)算法。

1.3 ESN超参数

整个网络只需要训练WoutWout,所以它的训练过程非常快,这是ESN的优点之一。另外,对于一维时序数列的处理和预测,ESN有很好的优势。但对于高维的时序数列,比如说视频帧处理,ESN就不太能胜任了。

为了让这个网络能够正常的运转,还有一些地方是需要注意的:

之所以叫回声状态网络,是因为前面时刻输入的信息会通过WW回回荡在储备池中,就像回声一样。为了避免储备池状态爆炸,WW的特征值必须要小于等于1。这也就引入了ESN中谱半径的概念:WW的最大特征值。

由于网络中只有WoutWout是可变的,为了尽可能多的表示不同的数据规律,WW必须要设置的非常大,才能从中找出各种不同的特征进行输出。另一方面,WW的稀疏性也很重要,Hinton在多伦多大学的公开课里解释是:建立一个松散的连接,这样某一信息可以在网络中的一小部分回荡,而不会迅速的传播到其他部分。